具有高AI性能和效率的最新SoC系統助力本地處理大型語言模型

隨著 AI 技術的不斷進步,十年前還只能在書本和科幻電影中看到的功能,如今隨處可見。然而,迄今為止,對性能有著高要求的最新生成式 AI 技術應用通常只能運行在云端。

直到最近,生成式 AI 的主要應用還是倚靠耗電量巨大的服務器,這些服務器的任務本是開發和訓練大型語言模型(LLM)。LLM 的出現本身就是一項突破,它只是邁出了一系列重要變革中的第一步。

目前,人們非常關注并推動著端側大模型技術的廣泛發展,因為該技術將使生成式 AI 能夠部署到更多應用中,獲益良多。具體來說,這些用例將大大增加生成式 AI 在智能城市、工業自動化、機器人和智能駕駛等市場的端側設備中的廣泛應用。

生成式 AI 要在前端領域取得成功,需要注意四要素:AI 的隱私、性能,能效和高生產率,這些因素決定了市場轉化的速度。

前端集成也有能源效率、設備微調和可靠性方面的技術挑戰。這些問題本身就很棘手,因此向開發人員提供的解決方案須兼顧性能和成本,才能克服這些障礙。

為了應對這些相互沖突的挑戰,定制化的芯片成為首選解決方案。

生成式AI的高能效SoC

安霸觀察到前端應用對高能效 AI 處理器的需求,因此推出了一系列 AI SoC,適用于各種前端的生成式 AI 應用。

在大多數用于前端應用的高性能多模式分析用例中,第一步通常是在所有照明條件下捕獲高質量視頻。為此,需要一個即使在低光照條件下也能提供出色圖像質量的圖像信號處理器(ISP)。同樣,高對比度場景的捕捉也必須使用具有先進的高動態范圍(HDR)能力的處理器,這樣才能捕捉到非常清晰的細節,為安防視頻分析、自主移動機器人(AMR)和智能駕駛感知算法提供高品質的圖像輸入,從而得到通用的解決方案。此外,通過高效的視頻編碼技術,安霸的 SoC 還能以極低的碼率傳輸高分辨率的視頻流。

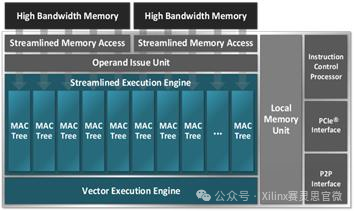

安霸 SoC 中的專有 CVflow AI 引擎,除了支持 LLM 處理外,還支持同時運行多個神經網絡(NN),在運行各類計算機視覺算法時維持低功耗。安霸的 Cooper 開發者平臺包含一套功能豐富的工具,使得客戶很方便地把在PC上開發的神經網絡移植到安霸芯片平臺。

安霸的生成式 AI 芯片解決方案在模型的參數上具備高擴展性,從支持多達 340 億個參數的多模態 LLM 的 N1 系列,到支持多達 30 億個參數的較小視覺語言模型 (VLM) 的 CV7 系列。

如果你的應用需要超強的前端處理能力,那么安霸的旗艦款 N1 系列 SoC 是最佳選擇之一。N1 可以接收多個高分辨率攝像頭數據流輸入,同時運行多達 340 億個參數的多模態 LLM,并且支持連接更多的外圍設備。N1 芯片集成了神經向量處理器 (NVP)、高級圖像信號處理器(ISP)、16 個 Arm Cortex-A78AE CPU, 以及用于 3D 用戶界面的 GPU,單顆芯片可提供高性能神經網絡計算。不僅性能卓越,N1 芯片的每次推理功耗僅為業界領先 GPU 解決方案的一小部分。

N1 芯片非常適合為多種應用提供生成式 AI,包括工業機器人、智慧城市、智能醫療成像和診斷、多攝像頭 AI 處理中心、運行多模態 LLM 的終端 AI 服務器以及智駕車隊遠程信息處理等。設備端通過運行多模態 LLM 促進了 生成式 AI 功能的實現,例如對視頻和圖像輸入進行智能上下文搜索;使用自然語言命令控制機器人;以及多才多藝的 AI 助手,比如代碼、文本和圖像的生成等。

雖然這些系統多種多樣,但它們在很大程度上都依賴于攝像頭和自然語言理解的結合。在這種情況下,設備端的生成式 AI 處理可提高運行速度和增強隱私保護,同時降低總成本。本地處理也是特定應用大語言模型處理的理想選擇,這些大語言模型通常在前端針對每個用例進行微調,而不是采用服務器方法,即使用更大、功耗更高的大語言模型來覆蓋所有用例。

N1 系列芯片基于安霸功能強大的第三代 CVFlow 架構設計,因此具有出色的網絡推理性能,廣泛兼容各類神經網絡,包括多模態大模型。例如,N1 SoC 在單流模式下以低于 50 瓦的功耗運行 Llama2-13B,每秒可推理 25 個 token。結合預移植模型的易集成性,這一新型解決方案可幫助設備制造商快速將生成式 AI 部署到任何對功耗敏感的應用中,如 AI 智能盒子、送貨機器人等產品。

第四要素-生產率

Cooper 是安霸自研的開發者平臺,提供靈活的模塊化開發環境,可與安霸任何 AI SoC(包括 CV2,CV5, CV7 系列和 N1 系列)配合使用。它因強調合作而得名,適用于各種應用,包括機器人、AIoT、汽車和消費類視頻設備。

是圍繞一個名為 Cooper Foundry 的軟件平臺構建的,該開發平臺由以下四個軟件模塊組成:

Cooper Core 核心組件:包含基于 Linux 的操作系統、編譯器和 SDK。

Cooper Foundation AI 應用組件:用于在前端構建和部署 ML 應用程序

Cooper Vision 視覺感知組件:包含多模態傳感器處理和融合的構建模塊

Cooper UX 應用交互組件:用于分析和開發

全面的 Cooper 開發平臺加快了產品上市速度

該開發平臺在 Cooper Metal 上運行。Cooper Metal 是一套硬件參考板,包括高能效 AI SoC、開發套件和模塊,它還集成了常見的第三方開源軟件工具。

為了展示這些功能,安霸利用其最新的 AI SoC 在 Cooper 上開發了一個演示系統。其中,安霸將業界領先的具有 AI 功能的 ISP 與多模態視覺語言模型相融合,后者還考慮到了視頻幀中的圖像數據。

作為向開發人員提供的單獨演示的一部分,安霸使用 N1 SoC 建立了一個系統,支持處理多達 16 個視頻流。它允許用戶使用自然語言搜索任何異常或不尋常事件的上下文,甚至搜索特定的內容,如特定品牌或型號的汽車。

在 CV7 系列 SoC 的基礎上,可以更低功耗構建具有 1-4 個視頻流小型系統。這些系統可運行“CLIP”等視覺語言模型,整個系統的功耗低于 5W。

總結

生成式 AI 是一項變革性技術,由于其處理過程通常在 GPU 上,消耗大量電能,它曾一度被局限于成本高昂的服務器中。基于安霸高效的 AI SoC 搭建的端側 LLM 推理設備,其每次AI推理所需的功耗極低,領先行業。安霸 N1 SoC 將生成式 AI 引入終端設備和可內部部署的硬件,應用范圍更加廣泛,例如安防視頻分析、機器人技術和眾多工業自動化需求。此外,與 GPU 及其他 AI 加速器相比,安霸提供了完整的 SoC 和系統解決方案,每生成一個 token 的能效比大幅提升,可達 3 倍,并可快捷、低成本地部署。

原文標題:生成式AI賦能前端,未來已來

文章出處:【微信公眾號:Ambarella安霸半導體】歡迎添加關注!文章轉載請注明出處。

-

soc

+關注

關注

38文章

4161瀏覽量

218162 -

AI

+關注

關注

87文章

30728瀏覽量

268886 -

安霸

+關注

關注

3文章

42瀏覽量

12930

原文標題:生成式AI賦能前端,未來已來

文章出處:【微信號:AMBARELLA_AMBA,微信公眾號:Ambarella安霸半導體】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

安霸生成式AI芯片解決方案助力本地處理大型語言模型

安霸生成式AI芯片解決方案助力本地處理大型語言模型

評論