循環(huán)神經(jīng)網(wǎng)絡(luò)(Recurrent Neural Network,簡(jiǎn)稱RNN)和遞歸神經(jīng)網(wǎng)絡(luò)(Recursive Neural Network,簡(jiǎn)稱RvNN)是深度學(xué)習(xí)中兩種重要的神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu)。它們?cè)谔幚硇蛄袛?shù)據(jù)方面具有顯著的優(yōu)勢(shì),但它們?cè)诮Y(jié)構(gòu)和工作原理上存在一些關(guān)鍵的區(qū)別。

- 循環(huán)神經(jīng)網(wǎng)絡(luò)(RNN)

1.1 RNN的結(jié)構(gòu)

循環(huán)神經(jīng)網(wǎng)絡(luò)是一種具有循環(huán)連接的神經(jīng)網(wǎng)絡(luò),其核心思想是將前一個(gè)時(shí)間步的輸出作為下一個(gè)時(shí)間步的輸入。RNN的結(jié)構(gòu)可以表示為:

在RNN中,每個(gè)時(shí)間步的輸入包括兩部分:當(dāng)前時(shí)間步的輸入x(t)和前一個(gè)時(shí)間步的輸出h(t-1)。通過(guò)將這兩部分輸入進(jìn)行合并,RNN可以在每個(gè)時(shí)間步更新其隱藏狀態(tài)h(t)。隱藏狀態(tài)h(t)可以被視為網(wǎng)絡(luò)的“記憶”,它存儲(chǔ)了序列中之前信息的抽象表示。

1.2 RNN的工作原理

RNN的工作原理可以概括為以下幾個(gè)步驟:

- 初始化隱藏狀態(tài)h(0)為零向量或隨機(jī)向量。

- 對(duì)于序列中的每個(gè)時(shí)間步t,計(jì)算當(dāng)前時(shí)間步的輸入x(t)。

- 將當(dāng)前時(shí)間步的輸入x(t)和前一個(gè)時(shí)間步的隱藏狀態(tài)h(t-1)進(jìn)行合并,得到新的輸入向量。

- 將新的輸入向量輸入到一個(gè)非線性變換函數(shù)(如tanh或ReLU)中,更新隱藏狀態(tài)h(t)。

- 將隱藏狀態(tài)h(t)作為下一個(gè)時(shí)間步的輸入h(t-1)。

- 重復(fù)步驟2-5,直到處理完序列中的所有時(shí)間步。

1.3 RNN的優(yōu)點(diǎn)

- 能夠處理序列數(shù)據(jù),具有記憶功能,可以捕捉序列中的長(zhǎng)期依賴關(guān)系。

- 可以處理任意長(zhǎng)度的序列數(shù)據(jù),具有較好的靈活性。

- 在自然語(yǔ)言處理、語(yǔ)音識(shí)別等領(lǐng)域有廣泛的應(yīng)用。

1.4 RNN的缺點(diǎn)

- 訓(xùn)練過(guò)程中容易出現(xiàn)梯度消失或梯度爆炸的問(wèn)題,導(dǎo)致訓(xùn)練困難。

- 難以捕捉長(zhǎng)距離依賴關(guān)系,對(duì)于長(zhǎng)序列數(shù)據(jù)的處理效果有限。

- 遞歸神經(jīng)網(wǎng)絡(luò)(RvNN)

2.1 RvNN的結(jié)構(gòu)

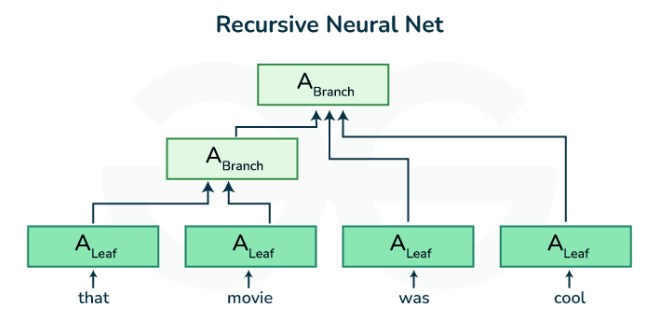

遞歸神經(jīng)網(wǎng)絡(luò)是一種樹(shù)狀結(jié)構(gòu)的神經(jīng)網(wǎng)絡(luò),其核心思想是將輸入數(shù)據(jù)分解為多個(gè)子問(wèn)題,然后遞歸地解決這些子問(wèn)題。RvNN的結(jié)構(gòu)可以表示為:

在RvNN中,每個(gè)節(jié)點(diǎn)代表一個(gè)子問(wèn)題,節(jié)點(diǎn)的輸入是子問(wèn)題的輸入數(shù)據(jù),節(jié)點(diǎn)的輸出是子問(wèn)題的解。節(jié)點(diǎn)之間的連接表示子問(wèn)題之間的依賴關(guān)系。

2.2 RvNN的工作原理

RvNN的工作原理可以概括為以下幾個(gè)步驟:

- 將輸入數(shù)據(jù)分解為多個(gè)子問(wèn)題。

- 對(duì)于每個(gè)子問(wèn)題,計(jì)算其輸入數(shù)據(jù)的特征表示。

- 將特征表示輸入到一個(gè)非線性變換函數(shù)中,得到子問(wèn)題的解。

- 根據(jù)子問(wèn)題之間的依賴關(guān)系,將子問(wèn)題的解進(jìn)行合并,得到更高層次的解。

- 重復(fù)步驟3-4,直到得到最終的輸出。

2.3 RvNN的優(yōu)點(diǎn)

- 可以處理具有層次結(jié)構(gòu)的數(shù)據(jù),如樹(shù)形數(shù)據(jù)、圖數(shù)據(jù)等。

- 可以遞歸地解決子問(wèn)題,具有較好的可擴(kuò)展性。

- 在自然語(yǔ)言處理、計(jì)算機(jī)視覺(jué)等領(lǐng)域有廣泛的應(yīng)用。

2.4 RvNN的缺點(diǎn)

- 對(duì)于沒(méi)有層次結(jié)構(gòu)的數(shù)據(jù),RvNN的性能可能不如RNN。

- 訓(xùn)練過(guò)程中可能需要更多的計(jì)算資源。

- RNN和RvNN的比較

3.1 結(jié)構(gòu)上的比較

RNN是一種具有循環(huán)連接的神經(jīng)網(wǎng)絡(luò),其核心是將前一個(gè)時(shí)間步的輸出作為下一個(gè)時(shí)間步的輸入。而RvNN是一種樹(shù)狀結(jié)構(gòu)的神經(jīng)網(wǎng)絡(luò),其核心是將輸入數(shù)據(jù)分解為多個(gè)子問(wèn)題,然后遞歸地解決這些子問(wèn)題。

3.2 工作原理上的比較

RNN的工作原理是通過(guò)更新隱藏狀態(tài)來(lái)捕捉序列中的信息,而RvNN的工作原理是通過(guò)遞歸地解決子問(wèn)題來(lái)捕捉數(shù)據(jù)的層次結(jié)構(gòu)。

-

數(shù)據(jù)

+關(guān)注

關(guān)注

8文章

7250瀏覽量

91426 -

深度學(xué)習(xí)

+關(guān)注

關(guān)注

73文章

5557瀏覽量

122604 -

循環(huán)神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

0文章

38瀏覽量

3094 -

遞歸神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

0文章

12瀏覽量

400

發(fā)布評(píng)論請(qǐng)先 登錄

全連接神經(jīng)網(wǎng)絡(luò)和卷積神經(jīng)網(wǎng)絡(luò)有什么區(qū)別

卷積神經(jīng)網(wǎng)絡(luò)如何使用

【案例分享】基于BP算法的前饋神經(jīng)網(wǎng)絡(luò)

【案例分享】ART神經(jīng)網(wǎng)絡(luò)與SOM神經(jīng)網(wǎng)絡(luò)

如何構(gòu)建神經(jīng)網(wǎng)絡(luò)?

人工神經(jīng)網(wǎng)絡(luò)和bp神經(jīng)網(wǎng)絡(luò)的區(qū)別

卷積神經(jīng)網(wǎng)絡(luò)與循環(huán)神經(jīng)網(wǎng)絡(luò)的區(qū)別

深度神經(jīng)網(wǎng)絡(luò)與基本神經(jīng)網(wǎng)絡(luò)的區(qū)別

循環(huán)神經(jīng)網(wǎng)絡(luò)和卷積神經(jīng)網(wǎng)絡(luò)的區(qū)別

遞歸神經(jīng)網(wǎng)絡(luò)是循環(huán)神經(jīng)網(wǎng)絡(luò)嗎

遞歸神經(jīng)網(wǎng)絡(luò)與循環(huán)神經(jīng)網(wǎng)絡(luò)一樣嗎

rnn是遞歸神經(jīng)網(wǎng)絡(luò)還是循環(huán)神經(jīng)網(wǎng)絡(luò)

BP神經(jīng)網(wǎng)絡(luò)和人工神經(jīng)網(wǎng)絡(luò)的區(qū)別

遞歸神經(jīng)網(wǎng)絡(luò)的實(shí)現(xiàn)方法

遞歸神經(jīng)網(wǎng)絡(luò)和循環(huán)神經(jīng)網(wǎng)絡(luò)的模型結(jié)構(gòu)

評(píng)論