隨著人工智能技術的飛速發展,大語言模型(LLM)已成為自然語言處理領域的核心工具,廣泛應用于智能客服、文本生成、機器翻譯等多個場景。然而,大語言模型的高計算復雜度和資源消耗成為其在實際應用中面臨的主要挑戰。本文將從多個維度深入探討如何加速大語言模型的推理過程,以期為相關領域的研究者和開發者提供參考。

一、引言

大語言模型,如GPT系列、BERT等,基于Transformer架構,通過海量數據的訓練,具備了強大的語言理解和生成能力。然而,這些模型龐大的參數量和復雜的計算需求,使得其推理速度較慢,難以滿足實時響應的需求。因此,加速大語言模型推理成為了一個亟待解決的問題。

二、模型壓縮技術

模型壓縮是一種減少模型大小和計算需求的技術,旨在保持模型性能的同時降低其資源消耗。主要方法包括:

- 剪枝 :通過移除模型中不重要的參數或連接,減少模型復雜度。剪枝技術可以分為非結構化剪枝和結構化剪枝兩種,前者直接刪除單個權重,后者則刪除整個神經元或層。

- 量化 :將模型中的浮點數權重和激活值轉換為低精度整數,如8位或4位量化,以減少內存占用和計算量。量化通常會導致一定的精度損失,但合理的量化策略可以在保持性能的同時顯著降低推理時間。

- 知識蒸餾 :通過一個小而快的“學生”模型學習一個龐大且復雜的“教師”模型的知識,從而在保持性能的同時減小模型尺寸。

三、硬件優化

使用特定的硬件加速器可以顯著提高大語言模型的推理速度。這些硬件通常具有并行處理能力,能夠高效地執行大量的矩陣運算。

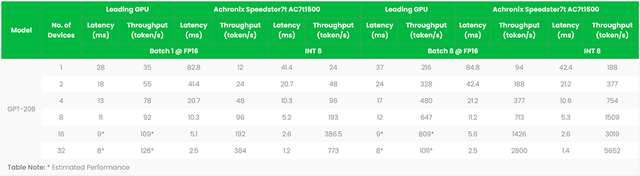

- GPU :圖形處理單元(GPU)具有強大的并行計算能力,適合處理大量并行的矩陣乘法運算,是加速深度學習模型推理的常用硬件。

- TPU :張量處理單元(TPU)是谷歌專為機器學習設計的專用集成電路(ASIC),進一步優化了矩陣運算的性能,比GPU更適合用于加速大語言模型的推理。

- FPGA :現場可編程門陣列(FPGA)可以根據特定任務進行定制,實現高效的硬件加速。通過為Transformer等特定模型設計專用的FPGA加速器,可以進一步提升推理速度。

四、模型微調與結構優化

- 模型微調 :通過對模型進行微調,可以使其更適應特定的任務或數據集,從而在不犧牲準確性的情況下提高推理速度。例如,使用adapters進行微調,可以在不改變原始模型參數的情況下,通過添加額外的參數來提高模型在特定任務上的性能。

- 模型結構優化 :設計更高效的網絡結構可以減少計算量同時保持性能。例如,使用深度可分離卷積或注意力機制的變體來替代傳統的卷積層或自注意力層。

五、高效的推理引擎與算法優化

- 推理引擎 :如SiliconLLM等專為大模型推理設計的加速引擎,可以顯著降低部署成本并加速生成式AI產品的落地。這些引擎通常集成了多種優化技術,包括模型壓縮、硬件加速等。

- 算法優化 :研究和開發更高效的算法可以減少模型在推理時的計算復雜度。例如,優化注意力機制的計算過程,通過稀疏化或近似化等方法減少不必要的計算。

六、并行計算與緩存技術

- 并行計算 :利用多線程或分布式計算技術將推理任務分散到多個處理器或計算機上執行,可以顯著提高整體的處理速度。例如,使用分布式訓練框架將模型分割成多個部分并行處理。

- 緩存和預取技術 :通過智能地緩存數據和預取可能需要的信息可以減少內存訪問時間。例如,在大語言模型推理過程中使用KV緩存技術存儲和復用前序詞塊在計算注意力機制時產生的Key和Value向量,以減少大量計算上的冗余。

七、存內計算技術

存內計算技術(Compute-In-Memory, CIM)通過在內存芯片中直接進行數據處理來減少數據在傳統計算架構中從存儲器到處理器之間的傳輸需求。這種技術可以顯著降低能源消耗并減少推理任務的延遲。例如,X-Former和iMCAT等CIM硬件平臺通過優化參數管理、提升計算效率和硬件利用率來加速Transformer模型的推理過程。

八、實際應用場景優化

不同的應用場景對LLM的推理性能有不同的需求。因此,需要根據實際應用場景來選擇合適的優化策略。例如,對于需要實時響應的場景可以優先考慮降低時延;而對于需要處理大量數據的場景可以優先考慮提高吞吐量和優化顯存使用。

九、挑戰與展望

挑戰

- 精度與效率的平衡 :在模型壓縮過程中,如何找到一個合適的平衡點,既能顯著減少模型的體積和計算復雜度,又能保持較高的預測精度,是一個具有挑戰性的問題。過度的壓縮可能導致模型性能的急劇下降,影響實際應用效果。

- 硬件異構性與兼容性 :隨著技術的發展,市場上出現了多種類型的硬件加速器,如GPU、TPU、FPGA等,它們各自具有不同的架構和性能特點。如何設計出一種能夠跨平臺兼容且高效利用這些硬件資源的推理框架,是一個亟待解決的問題。

- 動態場景下的優化 :在實際應用中,大語言模型往往需要處理各種類型的輸入數據和任務需求。如何根據輸入數據的特性和任務要求,動態地調整模型的參數、結構和推理策略,以實現最優的性能表現,是一個具有挑戰性的研究方向。

- 隱私保護與安全性 :隨著大語言模型在更多領域的應用,數據隱私和模型安全成為越來越重要的問題。如何在加速推理的同時,確保用戶數據的隱私保護和模型的安全性,是一個需要深入研究的課題。

展望

- 更高效的壓縮與量化技術 :未來,隨著算法和硬件技術的不斷進步,我們有望看到更高效的模型壓縮與量化技術。這些技術將能夠在保持模型性能的同時,進一步減少模型的體積和計算復雜度,從而實現更快的推理速度。

- 自適應的推理框架 :為了應對動態場景下的優化需求,未來的推理框架將更加注重自適應性和靈活性。這些框架將能夠根據輸入數據的特性和任務要求,自動調整模型的參數、結構和推理策略,以實現最優的性能表現。

- 軟硬協同優化 :未來的大語言模型推理加速將更加注重軟硬件的協同優化。通過緊密結合硬件加速器的特性和軟件算法的優化,我們可以實現更加高效的推理過程,從而進一步提升模型的性能表現。

- 隱私保護與安全性的提升 :隨著技術的不斷發展,我們將看到更多針對大語言模型隱私保護和安全性的解決方案。這些方案將采用加密技術、差分隱私、聯邦學習等方法來保護用戶數據的隱私和模型的安全性。

- 跨模態與多任務的融合 :未來的大語言模型將不僅僅局限于文本處理領域,而是會向跨模態(如文本、圖像、語音等)和多任務方向發展。這將為模型的推理加速帶來新的挑戰和機遇。通過融合不同模態的數據和任務需求,我們可以實現更加智能和高效的推理過程。

總之,加速大語言模型推理是一個充滿挑戰和機遇的領域。隨著技術的不斷進步和應用場景的不斷拓展,我們有理由相信,未來的大語言模型將具備更快的推理速度、更高的性能和更廣泛的應用前景。

-

人工智能

+關注

關注

1791文章

47183瀏覽量

238246 -

模型

+關注

關注

1文章

3226瀏覽量

48807 -

GPT

+關注

關注

0文章

352瀏覽量

15342

發布評論請先 登錄

相關推薦

【大語言模型:原理與工程實踐】揭開大語言模型的面紗

【大語言模型:原理與工程實踐】大語言模型的評測

【大語言模型:原理與工程實踐】大語言模型的應用

【《大語言模型應用指南》閱讀體驗】+ 基礎知識學習

壓縮模型會加速推理嗎?

HarmonyOS:使用MindSpore Lite引擎進行模型推理

NVIDIA DLI 實戰培訓 | 加速大語言模型開發的核心技能

現已公開發布!歡迎使用 NVIDIA TensorRT-LLM 優化大語言模型推理

NVIDIA加速微軟最新的Phi-3 Mini開源語言模型

FPGA和ASIC在大模型推理加速中的應用

如何加速大語言模型推理

如何加速大語言模型推理

評論