據統計,我國視障人數達1731萬人,聽力殘疾患者2780萬人。視聽障礙者對出行和交流需求迫切,但現有設施和輔具局限性大,使他們面臨出行難題。因此,我們開發了一款安全、精準、語音與手部交互的導航避障設備,配備AI導航小車和家屬端App,旨在滿足視聽障礙者的實時定位和信息交流需求。

設備包含導航避障、語音交互和觸摸交互模塊,支持定位、路徑規劃和實時避障功能。語音交互模塊可通過語音指示小車到達目的地,也可提供天氣查詢和笑話講解。觸摸交互模塊則幫助視聽障礙者進行盲文信息交流。應用App與觸摸模塊配合使用,顯示實時位置,提升出行安全性,促進與家人的信息互動。

經過盲人行走測試,使用本產品較普通盲杖可縮短行走時間約40%;軌跡路徑測試顯示,本產品行走路徑更合理,更符合日常行人行走習慣,凸顯了其導航避障的優勢。

產品設計

設計原理

設計中使用ROS與Python,結合激光雷達、超聲波測距模塊和萬向輪等硬件,并利用物聯網技術,旨在開發一款適用于視聽障礙者的出行輔助系統。該系統解決了他們出行中的困難與不便,通過降低出行難度與成本,體現了對他們的關懷,使其能夠享受科技發展帶來的便利。

1、語音交互模塊:針對僅存在視覺障礙的用戶,利用高度的聽覺靈敏性,該模塊具備語音識別和導航功能,使用戶能夠通過語音與AI導航小車進行交流和導航。

2、觸摸交互模塊:考慮到同時存在視聽障礙的用戶,設計了觸摸交互模塊和配套的應用App。通過觸摸交互模塊,用戶可以進行盲文信息交互,并利用震動功能實現基本的信息傳遞,同時與家人保持溝通。

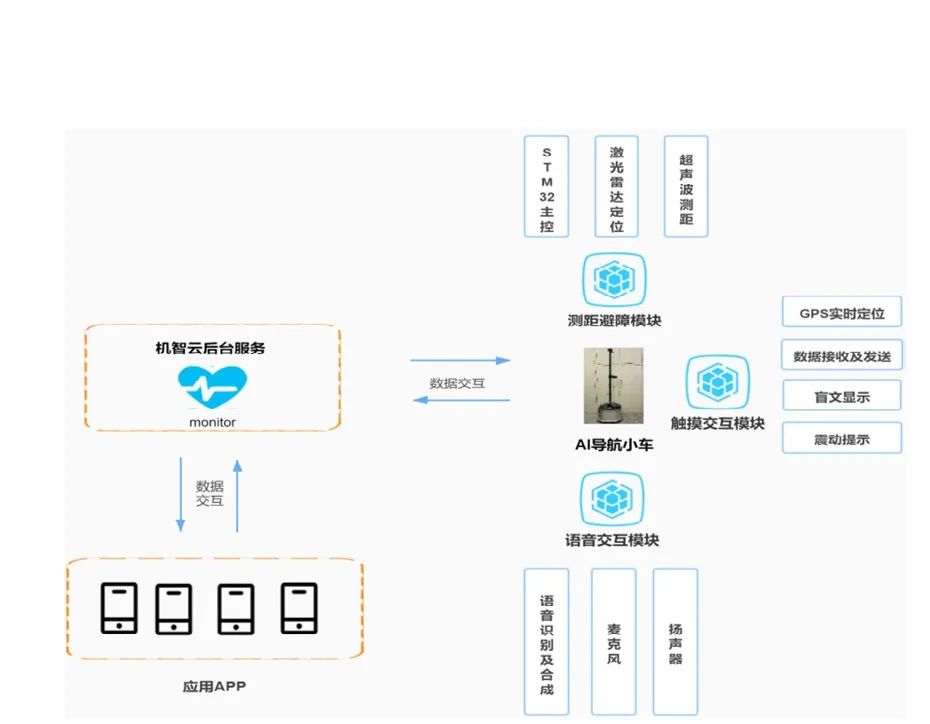

視聽智障者出行輔助AI小車系統架構

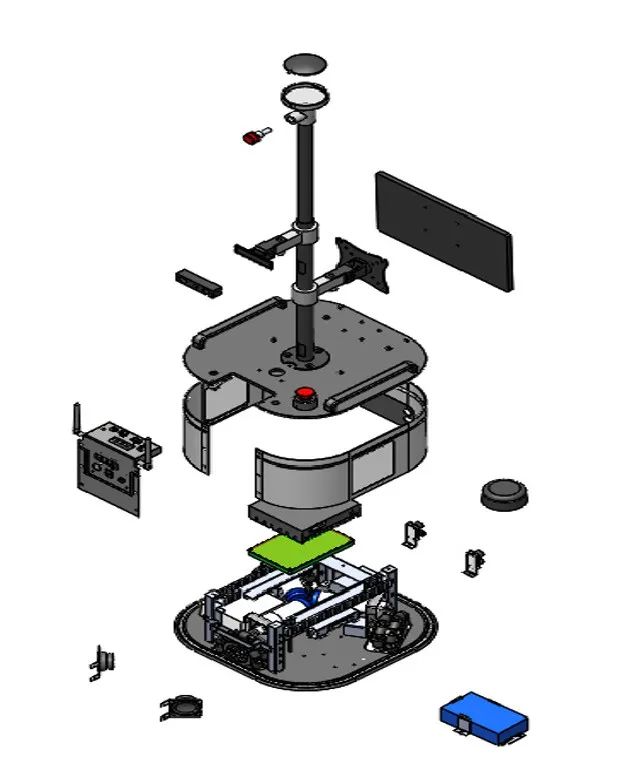

視聽障礙者出行輔助AI小車設計圖

視聽障礙者出行輔助AI小車實物圖

系統架構

本產品由AI導航小車及應用App組成,具有導航避障和信息交互兩大功能,信息交互功能包括語音交互、觸摸交互、實時位置三大部分。AI導航小車具有導航避障、語音交互、觸摸交互三大模塊,可以通過激光雷達對道路進行識別并規劃行駛路線,并在行駛過程中通過超聲波傳感器實時探測避障,對行人進行語音提醒,接收來自家屬或監護人的消息并通過觸摸交互模塊將信息傳遞給使用者,還可通過機智云物聯網服務,把小車狀態數據回傳給應用App。

家屬或監護人可通過應用App給使用者發送消息,并實時查看使用者的位置信息。本產品在AI導航小車上還設置有SOS按鈕,用戶按下此按鈕,小車會立即進行急停,并在應用App端給家屬實時顯示位置,達到安全出行的目的。

項目配置

實現過程

實現過程

導航避障模塊

在特定的地圖設置終點后,AI導航小車利用激光雷達掃描建圖,識別當前位置,并規劃到達終點的路徑。路徑規劃好后,開始引導使用者往終點行走。在行走過程中,一方面通過超聲波測距,避免撞到障礙物或行人;一方面不斷掃描及定位,重新規劃路徑,最終將使用者安全帶到終點。

設計原理

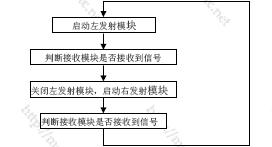

要想實現導航避障,需要完成定位、路徑規劃、避障功能。AI導航小車在導航過程中需要時刻確定當前位置,amcl是一種概率定位系統,以2d方式對AI導航小車定位,使用粒子濾波跟蹤機器人在已知地圖中的位姿。move_base能通過激光雷達掃描結果獲取AI導航小車周圍信息,生成全局和局部代價地圖,進行全局路徑規劃和局部路徑規劃,并且繞過障礙物到達目標點,全局路徑規劃采用A*算法,局部路徑規劃采用DWA算法。

定位及路徑規劃功能實現

定位及路徑規劃功能實現使用思嵐A2激光雷達,通過其核心測距順時針旋轉,可實現對周圍環境的360度全方位掃描測距檢測,從而獲得周圍環境的輪廓圖。

AI導航小車在陌生的環境下,需要先使用激光雷達進行SLAM建圖。SLAM英文名字為simultaneous localization and m Apping,翻譯成中文名是同步定位與建圖,主要應用于未知環境的探索。

AI導航小車首先是對自身進行定位,定位所需傳感器通常是電機編碼器、IMU、激光雷達。在定位的基礎上,激光雷達或者攝像頭來對自身定位進行修正,并利用期間獲取的環境信息不斷更新構建的環境地圖。

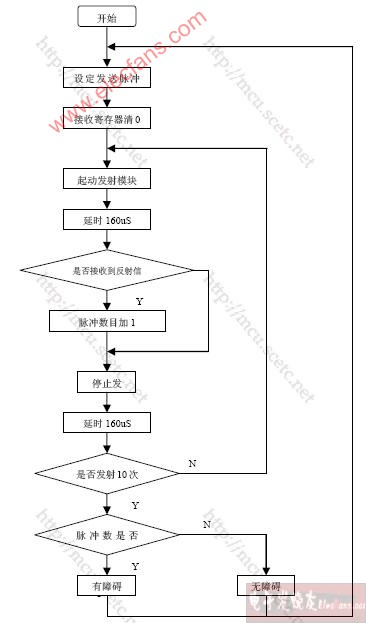

避障功能實現

AI導航小車在引導過程中,除了按已規劃好的路徑行駛,還需避讓突然進入的障礙物。主要通過對前方障礙物測距實現,這里使用的是HC-SR04超聲波測距模塊。

測距功能主要由STM32微控制器、超聲波模塊完成。通過STM32微控制器收到指令后使超聲波發射器向某一方向發射超聲波,途中碰到障礙物就立即反彈回來。根據計時器記錄的時間,計算出發射點到障礙物的距離,再通過向主控制器查詢超聲波數據實現測距。當AI導航小車檢測并計算到障礙物距離過近時,播放語音提醒使用者及行人,同時避開障礙物,重新規劃路線,繼續引導使用者安全行走。

此外,還要設置思嵐A2激光雷達的膨脹半徑和代價比例因子,確保機器小車在遇到障礙物后適當的距離內進行自動避障。

小車行駛處理路徑規劃及過程中的避障信號,控制電機轉動,達到準確行駛的目的STM32微控制器獲取激光雷達,超聲波等其他傳感器的信號,控制電機。

語音交互模塊

對于僅存在視覺障礙不存在聽覺障礙的用戶,可通過語音交互模塊,與AI導航小車進行對話,比如詢問天氣、講笑話,也可語音指定小車到達指定地點。

設計原理

語音交互是由麥克風采集聲音模擬信號,通過語音識別技術解析出語音信息,8代Inter處理器工控機將解析出的語音信息,利用語音合成技術,在經過揚聲器輸出聲音,并執行相應的動作,實現語音交互。

語音識別功能實現

由麥克風采集聲音模擬信號,通過科大訊飛語音識別技術解析出語音信息,識別轉換成文字。

語音導航功能實現

8代Inter處理器工控機解析識別的語音信息,當識別到對應指令時,利用語音合成技術,再經過揚聲器輸出聲音并執行相應動作。導航過程中,8代Inter處理器工控機需要不斷和STM32控制器、激光雷達進行實時數據通信,如獲取電機編碼、超聲波等傳感器數據。

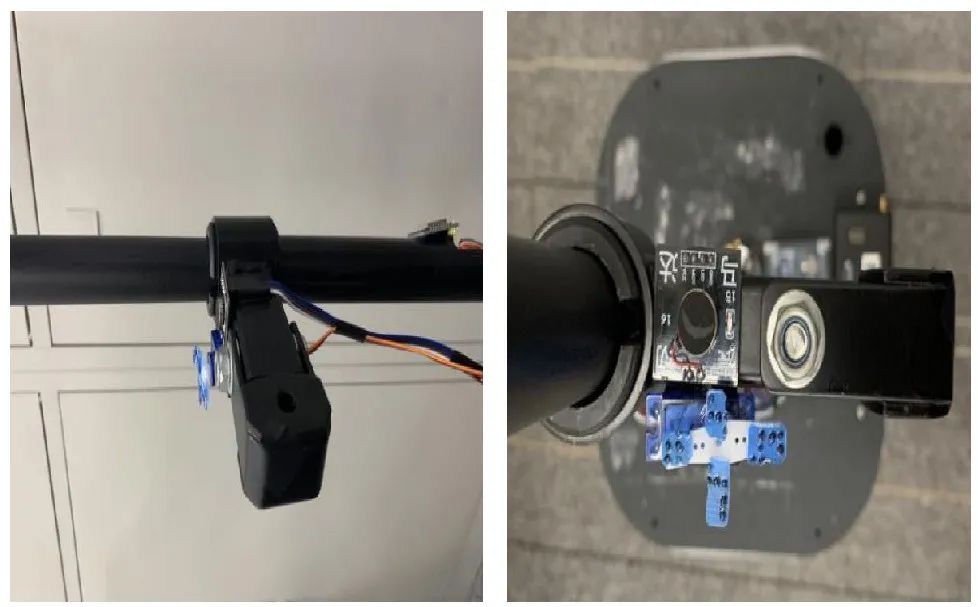

觸摸交互模塊

設計原理

觸摸交互模塊為視聽障礙人士獲知信息的主要窗口,承擔向他們傳達提示、通知信息及實現視聽障礙者與家屬雙向對話等功能,主要是由主控制器STM32、舵機模塊、ATK-esp8266

WIFI模塊和SIM868模塊組成。

例如,ATK-ESP8266 WIFI模塊通過連接WIFI后進入配網模式且連上機智云服務器后,當按下應用App中的按鈕“回家”,通過ATK-ESP8266 WIFI模塊將指令發送到主控制器STM32。此時,握手處就會傳來短促的震動來提示用戶有消息傳來,并且舵機也會根據接收到的指令轉到相應的角度0°,舵機到達指定角度后,用戶用手觸摸舵機上的盲文數字,即可以知道家人發送的消息提示。同理,當家人按下應用App上的其他按鈕后,震動提醒,舵機轉動到相應的角度。完整的指令即動作如下:

(1)應用App按下按鈕“回家”,舵機識別動作1,

觸摸交互模塊實物圖舵機轉動0°,顯示盲文數字1;

(2)應用App按下按鈕“離家”,舵機識別動作2,舵機轉動90°,顯示盲文數字2;

(3)應用App按下按鈕“公園”,舵機識別動作3,舵機轉動90°,顯示盲文數字3;

(4)應用App按下按鈕“醫院”,舵機識別動作4,舵機轉動180°,顯示盲文數字4;

此外,產品設有“SOS”按鍵。在發生緊急情況時,盲人可以通過按下此按鍵來實現急停,并迅速向家人發送自己的坐標,通知家人自己位置信息。

盲文信息交互功能實現

盲文信息交互功能主要為通過主控制器收到的指令后轉動舵機,轉動到相應的角度以顯示對應的盲文數字按鈕,以此向視聽障礙人士提供消息,由主控制器STM32、舵機模塊、ATK-ESP8266 WIFI模塊和盲文數字按鈕組成。

將MG996R舵機的GND引腳和+5V引腳分別與主控制器的GND引腳和+5V相連;信號線(PWM)引腳連接到主控制器的PA6引腳。當主控制器接收到不同的指令信號,舵機轉動不同的角度,使盲文數字按鈕轉到預定的位置供用戶觸摸。

本項目使用了ATK-ESP8266 WIFI模塊連接在主控制器上,實現應用App與主控制器之間的實時數據和相關指令的接收和發送。ATK-ESP8266 Wi Fi模塊與主控制器的VCC引腳與GND引腳相連;ATK-ESP8266 Wi Fi模塊的RXD引腳和TXD引腳分別與主控器STM32中USART3的TXD引腳(PB10)與RXD引腳(PB11)相連。由于本項目中并沒有控制ATK-ESP8266 WIFI模塊的RST和IO_0引腳,因此將這兩引腳懸空處理。

主控制器先對一系列外設和協議進行初始化,ESP8266 WIFI模組進入配網模式。在user Handle()函數中,連上機智云服務器,應用App會顯示設備已連接狀態,同時看到采集的定位數據和主控制器D0綠燈閃爍。此外,通過操控應用App按鈕,可以發送經過機智云服務器處理過的指令消息,通過ATK-ESP8266 WIFI模塊發送至主控制器上,使得主控制器執行相應程序使得功能模塊執行相應的動作。

震動功能實現

震動馬達被內置在觸摸模塊里,做輔助提示作用,受主控制器控制。當小車前進、轉彎或者接收到應用App通過ESP8266 Wi Fi模塊發送的指令時,震動馬達模塊都會進行短暫震動,以提示視聽障礙者。當小車檢測到障礙物而需要停止時,震動馬達模塊便會一直震動直至視聽障礙者停下,以提醒視聽障礙者有需要避讓的障礙物。

急停按鈕

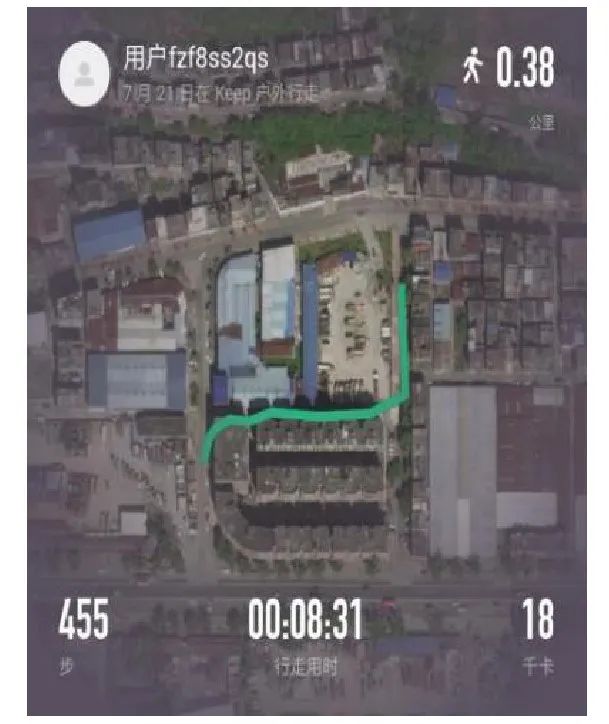

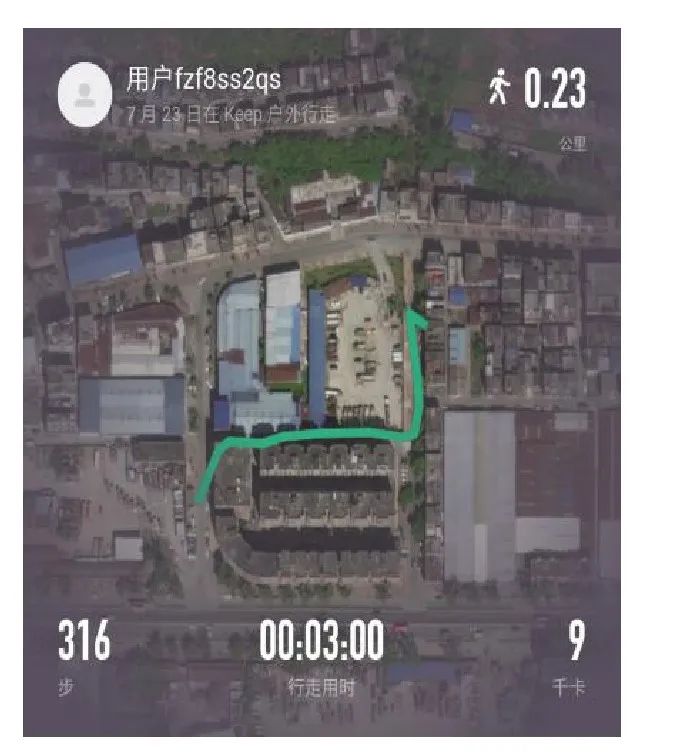

模擬使用普通盲杖行走路徑

模擬使用本產品行走路徑

正常行走路徑

實時位置定位功能實現

實時位置定位功能使用SIM868模塊。SIM868模塊與主控制器的VCC引腳與GND引腳相連;SIM868模塊的RXD引腳與TXD引腳則連接在主控制器中USART2的TXD引腳(PA2)和RXD引腳(PA3)。其他引腳因沒有進行控制,因此不做處理,懸空即可。

獲取實時位置坐標數據的方式是通過主控制器發送AT指令到SIM868模塊。

主控制器上電后通過串口USART2發送指令“AT+CGNSPWR=1”打開GPS電源;發送指令“AT+CGNSSEQ=”“RMC”定義NMEA解析;發送指令“AT+CGNSINF”獲取GPS定位信息;發送指令“AT+CGNSURC=2”間隔2s輸出位置坐標數據即每隔2s將位置坐標數據傳輸至主控制器,最后經由SIM868_Get_GPSLocation()函數對位置坐標數據進一步解析處理,將處理后的數據發送至應用App。

應用App

應用App是家人獲知視聽障礙者情況和與其溝通的“窗口”。應用App使用ROS平臺制作。在應用App上,可以很方便地獲取視聽障礙者位置、對話、小車運行狀況等信息,還可以在窗口上直接向視聽障礙者發送對話信息。

應用App通過與機智云后臺連接,綁定機智云WiFi模塊,從而能夠與AI導航小車進行信息傳輸。

當應用App向AI導航小車發送對話信息時,發送對應指令消息到機智云云服務中,云服務將指令消息傳到AI導航小車,AI導航小車接收到指令消息,處理后通過觸摸模塊的數據處理,傳遞對應的消息。

當AI導航小車發送定位信息時,先將信息發送到云服務,云服務再推送到應用App,應用App對定位信息進行顯示,讓家屬或監護人實時了解使用者的位置信息。

產品測試效果

產品測試一:隨機尋找三位行人(第1位為中年女性、第2位為年輕男性、第3位為中年男性),起點和終點相同(起點和終點相差100m)的情況下測試他們模擬使用普通盲杖行走、模擬使用本產品、正常行走這三種情況下行走分別所耗費的時間(模擬視聽障礙者:戴上眼罩和耳塞)。

如圖所示,在相同位移的情況下,普通行人模擬視聽障礙者使用本產品與使用普通盲杖相比,1號測試者的行走時間縮短了約45%,2號測試者的行走時間縮短了約39%,3號測試者的行走時間縮短了約36%,說明本產品輔助出行具有較好的引導效果。

隨機找三位行人在3種不同情況下行走所耗費的時間

產品測試二:在相同起始點與終點、相同路段情況下,本小組成員通過Keep軟件記錄了模擬使用普通盲杖行走、模擬使用本產品、正常行走這三種情況下行走的軌跡路徑(模擬視聽障礙者:戴上眼罩和耳塞)。

如圖所示,在相同起始點與終點、相同路段情況下,模擬使用本產品與模擬使用普通盲杖相比,行走時間縮短了29%。更為重要的是,通過keep軟件的軌跡記錄,可以看出模擬使用本產品與模擬使用普通盲杖相比,使用本產品的行走路徑更合理,且更貼近日常生活中普通行人的行走路徑,凸顯了本產品導航避障的優勢。

項目創新點

1、精準導航避障:利用激光雷達和超聲波傳感器,本產品能夠精準實時規劃路線和規避障礙物,確保視聽障礙者安全、精準出行。

2、信息交互窗口:針對視聽障礙者的聽覺和觸覺靈敏性,設計了語音交互模塊和觸摸交互模塊。語音交互模塊具備語音識別和導航功能,支持用戶與設備的語音交流;觸摸交互模塊則實現了盲文信息交互。此外,配備應用App,包含SOS按鈕和實時定位功能,使用戶能夠與家人進行基本的信息傳遞,滿足日常人際溝通需求。

-

AI

+關注

關注

87文章

30728瀏覽量

268886 -

激光雷達

+關注

關注

968文章

3967瀏覽量

189824 -

ROS

+關注

關注

1文章

278瀏覽量

17001

發布評論請先 登錄

相關推薦

智行者——視聽障礙者出行輔助AI小車設計

智行者——視聽障礙者出行輔助AI小車設計

評論