電子發燒友網報道(文/梁浩斌)過去幾年中爆發的AI算力需求,英偉達GPU成為了最大的贏家,無論是自動駕駛還是AI大模型,比如特斯拉、小鵬、OpenAI、字節跳動等廠商都在爭相搶購英偉達GPU產品,獲得足夠的算力構建自己的計算中心,用于訓練不同應用的AI模型。

AI領域眾星捧月也造就了英偉達市值曾突破三萬億美元,并短暫登頂全球第一的位置。不過蘋果卻反其道而行之,在7月底蘋果公司揭露的官方論文顯示,蘋果自研大模型AFM背后,完全沒有英偉達GPU的影子。

蘋果大模型訓練,選擇了谷歌芯片

在蘋果近期揭露的一篇技術論文中,詳細介紹了蘋果在端側和服務器側的大模型。在大模型預訓練的階段,蘋果基礎模型是在AXLearn框架上進行訓練的,據蘋果介紹,AXLearn框架是蘋果公司在2023年發布的開源項目,這個框架建立在JAX和XLA的基礎上,允許模型在各種硬件和云平臺上進行高效和可擴展性訓練,包括TPU以及云端和本地的GPU。

蘋果采用了數據并行、張量并行、序列并行和完全分片數據并行(FSDP)的組合來沿多個維度擴展訓練,如數據規模、模型規模和序列長度。

其中,蘋果的AFM服務器端大模型是蘋果規模最大的語言模型,該模型在8192個TPUv4芯片上進行了預訓練,這些芯片被配置成8*1024個芯片集群,通過數據中心網絡(DCN)連接。預訓練有三個階段,首先使用 6.3 萬億個Tokens開始,接著使用 1 萬億個Tokens繼續訓練,最后使用 1000 億個Tokens進行上下文長度的擴展。

而在AFM的端側模型上,蘋果對其進行了大幅修剪,論文披露AFM端側模型是一個擁有30億參數的模型,該模型是從64億參數的服務器模型中蒸餾而來,而這個服務器模型則是在完整的6.3萬億參數量上進行訓練。

與服務器端模型不同的是,AFM端側模型采用的芯片是谷歌的TPUv5,論文中的信息顯示,AFM端側模型是在一個由2048個TPUv5p芯片組成的集群上進行訓練的。

谷歌在去年12月發布了TPUv5p,面向云端AI加速,谷歌稱之為“迄今為止最強大、可擴展性最強和最靈活的人工智能加速器”。

TPUv5p在bfloat16精度下可以提供459 teraFLOPS(每秒可執行459萬億次浮點運算)算力;在Int8精度下,TPU v5p可以提供918 teraOPS(每秒可執行918萬億次整數運算);支持95GB的HBM內存,帶寬高達2.76 TB/s。

相比上一代的TPU v4,TPUv5p實現了每秒浮點運算次數提高一倍,內存帶寬是前代的三倍,訓練大模型速度提升2.8倍,并且性價比是前代的2.1倍。

除了蘋果之外,目前采用谷歌TPU系列芯片進行大模型訓練的還有谷歌自家的Gemini、PaLM,以及OpenAI前副總裁創立的Anthropic所推出的Claude大模型,上個月Anthropic發布的Llama 3.1 405B還被認為是最強開源大模型。

蘋果、谷歌、Anthropic的實例,證明了TPU在大模型訓練上的能力。但相比于英偉達,TPU目前在大模型領域的應用依舊只是冰山一角,背后更多的大模型公司,包括OpenAI、特斯拉、字節跳動等巨頭,主力AI數據中心依然是普遍采用英偉達GPU。

英偉達的挑戰者們

一直以來,圍繞CUDA打造的軟件生態,是英偉達在GPU領域最大的護城河,尤其是隨著目前AI領域的發展加速,市場火爆,英偉達GPU+CUDA的開發生態則更加穩固,AMD、英特爾等廠商雖然在努力追趕,但目前還未能看到有威脅英偉達地位的可能。

但市場的火爆難免吸引更多的玩家入局,對英偉達發起挑戰,或者說是在AI廣闊的市場空間中,希望分得一杯羹。

首先是英偉達在GPU領域的最大對手AMD ,今年一月有研究人員在Frontier超算集群上,利用其中8%左右的GPU,訓練出一個GPT 3.5級別規模的大模型。而Frontier超算集群是完全基于AMD硬件的,由37888個MI250X GPU和9472個Epyc 7A53 CPU組成,這次研究也突破了在AMD硬件上突破了先進分布式訓練模型的難點,為AMD平臺訓練大模型驗證了可行性。

同時,CUDA生態也在逐步擊破,今年7月英國公司Spectral Compute推出了可以為AMD GPU原生編譯CUDA源代碼的方案,大幅提高了AMD GPU對CUDA的兼容效率。

英特爾的Gaudi 3 也在發布時直接對標英偉達H100,并宣稱在模型訓練速度和推理速度上分別比英偉達H100提高了40%和50%。

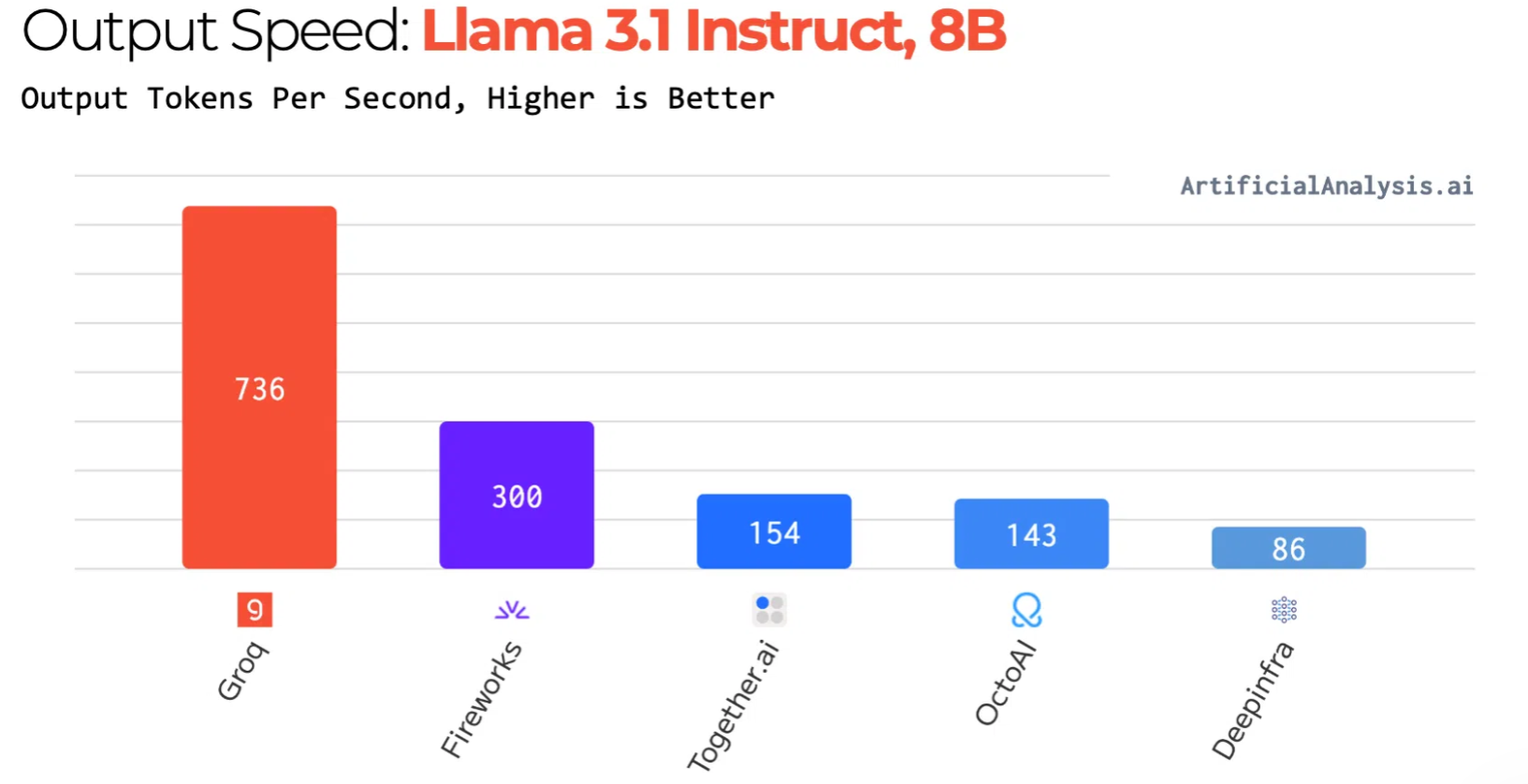

除了芯片巨頭外,也不乏來自初創公司的沖擊。比如Groq推出的LPU、Cerebras推出的Wafer Scale Engine 3、Etched推出的Sohu等等。國內方面,有走多卡集群訓練路線的初創公司,比如摩爾線程在今年6月宣布與羽人科技合作成功實現了摩爾線程夸娥(KUAE)千卡智算集群與羽人系列模型解決方案的訓練兼容適配,高效完成了70億參數羽人大語言模型YuRen-7b的訓練測試。

摩爾線程夸娥方案基于全功能MTT S4000 GPU,該GPU采用了第三代MUSA內核,單卡支持48GB顯存容量和768GB/s的顯存帶寬,FP16算力為100TFLOPS。值得一提的是,MTT S4000計算卡借助摩爾線程自研開發工具,可以充分兼容現有CUDA軟件生態,實現CUDA代碼零成本遷移到MUSA平臺。

天數智芯也與智源研究院、愛特云翔合作,提供天垓100加速卡、構建算力集群及全程技術支持,實現基于自主通用GPU的大模型CodeGen(高效編碼)項目,通過中文描述來生成可用的C、Java、Python代碼以實現高效編碼。

另外值得一提的是,國內還有一家走TPU路線的AI芯片公司——中昊芯英。該公司在2023年底推出了國內首款量產TPU AI訓練芯片“剎那”,據稱在處理大模型訓練和推理任務時相比英偉達A100,性能提高近150%,能耗下降30%,單位算力成本僅為A100的42%。

當然,除了芯片公司,據現有的信息,目前主流的云服務供應商,比如前面提到的谷歌,還有亞馬遜、微軟、Meta、阿里巴巴、字節跳動、百度、華為等都有自研芯片的布局,其中還包括用于AI大模型訓練的芯片。

寫在最后

從長遠來看,自研芯片是云服務供應商有效降低算力成本的方式之一,當AI大模型訓練成為了云計算的重要用途時,自研AI訓練芯片自然也是云服務廠商的長遠之計。蘋果作為消費電子巨頭已經邁出了重要的一步,即擺脫對英偉達的算力依賴,并且還有大量的挑戰者正在蠢蠢欲動。星星之火,可以燎原,英偉達在AI訓練領域的地位,可能沒有表面看起來那么穩固。

-

gpu

+關注

關注

28文章

4944瀏覽量

131217 -

蘋果

+關注

關注

61文章

24545瀏覽量

203932 -

AI

+關注

關注

88文章

35109瀏覽量

279594 -

英偉達

+關注

關注

22文章

3950瀏覽量

93722 -

大模型

+關注

關注

2文章

3139瀏覽量

4062

發布評論請先 登錄

AI大模型不再依賴英偉達GPU?蘋果揭秘自研大模型

AI大模型不再依賴英偉達GPU?蘋果揭秘自研大模型

評論