GPU技術,即圖形處理器(Graphics Processing Unit)技術,是一種專門設計用于處理圖像和圖形數據的微處理器技術。隨著計算機圖形學和計算機視覺技術的快速發展,GPU技術已經從最初的圖形渲染擴展到多個領域,成為現代計算機系統中不可或缺的一部分。下面將從GPU的定義、結構、工作原理、應用以及發展趨勢等方面對GPU技術進行詳細介紹。

一、GPU的定義

GPU全稱為Graphics Processing Unit,即圖形處理器,是一種專門用于處理圖像和圖形的微處理器。與計算機的中央處理器(CPU)不同,GPU被設計用于執行復雜的圖形渲染和計算任務,具有高度的并行處理能力和高效的計算效率。GPU通常包含數以千計的流處理器(Streaming Processors),這些流處理器可以并行處理大量數據,從而實現高效的圖形渲染和計算。

二、GPU的結構

GPU的結構復雜而精細,主要包括控制單元、緩存存儲器、流處理器和顯存接口等幾個關鍵部分。

- 控制單元 :負責管理和控制GPU的各個部分,確保它們能夠協同工作,高效地完成圖形渲染和計算任務。

- 緩存存儲器 :用于存儲待處理的圖形數據和中間結果,以加速圖形渲染和計算過程。緩存存儲器的大小和速度對GPU的性能有重要影響。

- 流處理器 :也稱為著色器,是GPU的核心部分,負責執行圖形渲染和計算任務。流處理器可以并行處理大量數據,實現高效的圖形渲染和計算。

- 顯存接口 :連接GPU和顯存的接口,用于傳輸圖形數據和指令。顯存接口的速度和帶寬對GPU的性能也有重要影響。

三、GPU的工作原理

GPU的工作原理主要是通過并行處理來加速圖形渲染和計算。在圖形渲染過程中,GPU會將輸入的3D模型數據轉換為2D圖像數據,并在屏幕上顯示出來。這個過程包括頂點處理、圖元組裝、光柵化、紋理映射等多個步驟。

- 頂點處理 :GPU首先處理3D模型中的頂點數據,包括位置、顏色、紋理坐標等。頂點處理階段會對頂點進行變換、裁剪和投影等操作,以確定它們在屏幕上的位置。

- 圖元組裝 :在頂點處理之后,GPU會將處理后的頂點組合成圖元(如三角形、四邊形等)。圖元組裝階段會確定哪些頂點應該被組合在一起形成圖元。

- 光柵化 :光柵化是將圖元轉換為屏幕上的像素點的過程。GPU會計算每個圖元覆蓋的像素點,并為這些像素點生成相應的顏色值。

- 紋理映射 :紋理映射是將紋理圖像應用到3D模型表面的過程。GPU會根據紋理坐標和紋理圖像來計算每個像素點的最終顏色值。

除了圖形渲染外,GPU還可以用于通用計算(GPGPU)。通過編程語言和API(如CUDA和OpenCL),開發者可以將原本由CPU執行的計算任務轉移到GPU上執行。由于GPU具有大量的流處理器和高效的并行計算能力,因此可以大大加速這些計算任務的執行速度。

四、GPU的應用

GPU技術的應用領域非常廣泛,涵蓋了游戲開發與圖形渲染、科學計算與模擬、人工智能與深度學習、加密貨幣挖礦、影音編輯和渲染以及數據分析與大數據處理等多個領域。

- 游戲開發與圖形渲染 :GPU是游戲開發中不可或缺的一部分。它能夠處理復雜的3D圖形和特效,并將其實時顯示在屏幕上。游戲開發者可以利用GPU算力來創建逼真的游戲畫面和流暢的動畫效果。

- 科學計算與模擬 :GPU在科學計算領域也扮演著重要角色。科學家們可以利用GPU加速計算來處理復雜的模擬和計算問題,如氣象模擬、天體物理學模擬、分子動力學模擬等。GPU的高并行處理能力使得這些計算任務能夠更快速地完成,加快了科研進程。

- 人工智能與深度學習 :GPU算力在人工智能和深度學習領域中具有重要地位。深度神經網絡模型的訓練和推理需要大量的計算資源,而GPU的并行計算能力可以加速這個過程。通過將算力分配給不同的神經元和神經層,GPU能夠大幅提高訓練和推理速度,推動了人工智能技術的發展。

- 加密貨幣挖礦 :隨著加密貨幣的興起,GPU算力也成為加密貨幣挖礦的重要工具之一。比特幣、以太坊等加密貨幣的挖礦過程需要進行復雜的算術運算,而GPU的高并行處理能力可以更快地完成這些計算任務,從而提高挖礦效率。

- 影音編輯和渲染 :影音編輯軟件和渲染器也可以借助GPU算力來提高工作效率。例如,視頻編輯軟件可以通過GPU加速來實時預覽高分辨率的視頻,而3D渲染器可以利用GPU計算功能來加速建模和渲染過程,使得電影和動畫制作更加高效。

- 數據分析與大數據處理 :現代數據分析和大數據處理需要處理龐大的數據集和復雜的算法。GPU算力可以加速這些任務,使數據分析師和科學家能夠更快地完成數據處理、模型訓練和模擬實驗等工作。

五、GPU技術的發展趨勢

隨著技術的不斷進步和應用領域的不斷擴大,GPU技術將繼續發展并展現出更廣闊的應用前景。以下是GPU技術未來發展的幾個重要趨勢:

1. 架構創新

- 混合架構 :未來的GPU可能會采用更加靈活的混合架構,結合不同類型的計算單元來優化不同類型的工作負載。例如,一些GPU可能會集成高性能的矢量處理器、張量處理器(針對AI計算)以及傳統的圖形處理器,以更好地滿足游戲、科學計算和AI等多方面的需求。

- 可編程性增強 :隨著GPU在通用計算領域的應用越來越廣泛,其可編程性也將得到進一步提升。未來的GPU可能會支持更高級的編程語言和更靈活的編程模型,使得開發者能夠更容易地將傳統CPU上的算法遷移到GPU上執行。

2. 性能與能效比的提升

- 更高效的芯片設計 :隨著半導體工藝的不斷進步,GPU芯片將能夠集成更多的晶體管,并通過更先進的電路設計和優化來提高性能和能效比。這將使得GPU在保持高性能的同時,能夠減少功耗和熱量產生,提高系統的整體效率和穩定性。

- 智能電源管理 :未來的GPU可能會配備更智能的電源管理系統,能夠根據工作負載的實時變化動態調整功耗和性能,以在性能和能效之間找到最佳平衡點。這種智能電源管理技術將有助于提高GPU的能效比,并延長移動設備和服務器的續航時間。

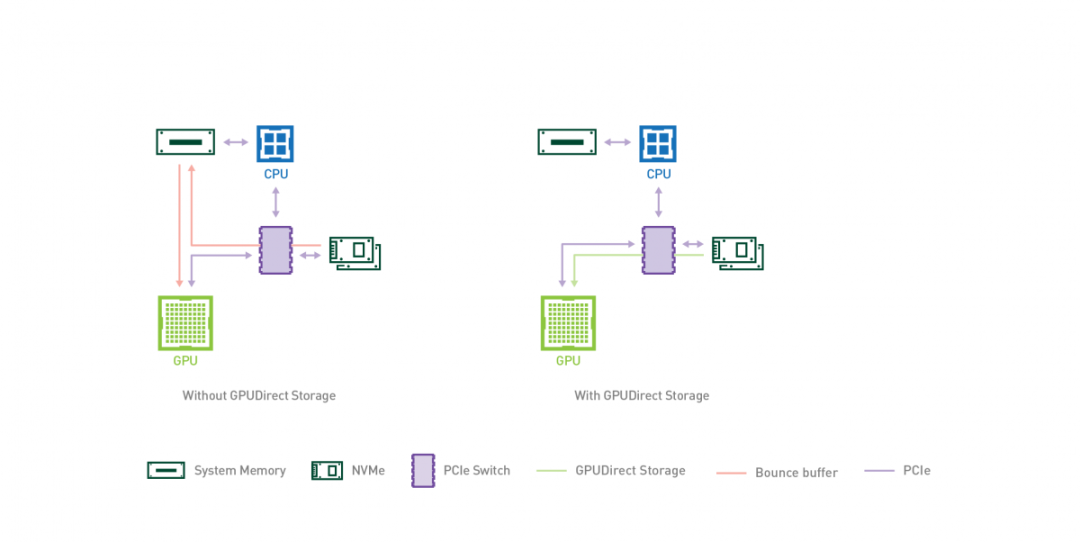

3. 內存與存儲技術的革新

- 高速顯存 :隨著GPU計算能力的不斷提升,對顯存帶寬和容量的需求也在不斷增加。未來的GPU可能會采用更高帶寬和更大容量的顯存技術,如HBM(高帶寬內存)和GDDR6X等,以支持更復雜和更高分辨率的圖形渲染和計算任務。

- 內存層次結構優化 :為了進一步提高GPU的計算效率,未來的GPU可能會采用更優化的內存層次結構,包括更大容量的緩存和更高效的內存訪問策略。這將有助于減少內存延遲和提高數據訪問速度,從而提升GPU的整體性能。

4. 軟件與生態系統的完善

- 軟件優化 :隨著GPU在各個領域的應用日益廣泛,針對GPU優化的軟件工具也將不斷增多和完善。這些工具將包括編譯器、調試器、性能分析工具等,以幫助開發者更好地利用GPU的計算資源并優化其應用程序的性能。

- 生態系統建設 :未來的GPU生態系統將更加完善和開放。各大GPU廠商將積極與軟件開發者、ISV(獨立軟件供應商)和系統集成商等合作伙伴合作,共同推動GPU技術的應用和發展。這將有助于形成更加繁榮和健康的GPU生態系統,并促進整個計算機行業的進步和創新。

5. 新興應用領域的拓展

- 元宇宙與虛擬現實 :隨著元宇宙概念的興起和虛擬現實技術的不斷發展,GPU在圖形渲染和實時計算方面的優勢將得到進一步發揮。未來的GPU可能會針對這些新興應用領域進行特別優化和定制,以提供更逼真的虛擬環境和更流暢的交互體驗。

- 邊緣計算與物聯網 :隨著物聯網設備的普及和邊緣計算需求的增加,GPU在邊緣計算領域的應用也將不斷拓展。未來的GPU可能會采用更加緊湊和低功耗的設計,以適應邊緣設備的需求,并為物聯網應用提供強大的計算支持。

六、結論

綜上所述,GPU技術作為計算機系統中不可或缺的一部分,正在不斷發展并展現出廣闊的應用前景。通過架構創新、性能提升、內存與存儲技術革新以及軟件與生態系統的完善等多方面的努力,GPU將在游戲開發與圖形渲染、科學計算與模擬、人工智能與深度學習、加密貨幣挖礦、影音編輯和渲染以及數據分析與大數據處理等多個領域發揮更加重要的作用。同時,隨著新興應用領域的不斷拓展和技術的不斷進步,GPU技術將繼續引領計算機行業的發展和創新。

-

gpu

+關注

關注

28文章

4955瀏覽量

131398 -

計算機

+關注

關注

19文章

7670瀏覽量

90904 -

圖形處理器

+關注

關注

0文章

202瀏覽量

27057

發布評論請先 登錄

聊聊GPU通信技術

【「算力芯片 | 高性能 CPU/GPU/NPU 微架構分析」閱讀體驗】+NVlink技術從應用到原理

評論