「Speech recognition for medical conversations」論文介紹了作者們開發用于醫療轉寫的語音識別系統的經歷,這個系統的功能就是自動把醫生和病人間的對話自動轉錄為文字。為了達到這個目標,谷歌的研究人員們沿著兩個思路構建了這個系統:一個是基于音素的連接性時間分類(Connectionist Temporal Classification)模型,另一個是基于字母“聆聽、關注、拼寫”(Listen Attend and Spell)的模型。

醫療AI已經火熱了很有一陣子了,計算機視覺相關研究的進步讓醫學圖像輔助診斷改頭換面,不僅準確率日新月異,醫療影像創業公司也已經遍地開花。

那么除了醫療影像之外,深度學習還能以別的方式幫助醫生、服務病人嗎?答案當然是肯定的,谷歌大腦就發出一篇博文,介紹了他們利用深度學習幫助醫生撰寫醫療文檔的研究進展。

理解醫療對話

如果醫生能更好地與整個團隊溝通自己的想法、擔憂和未來計劃,相信肯定可以給病人帶來更高的醫療服務質量,而高質量的文檔記錄就能在這個過程中起到幫助。醫生們最想做的事情當然是多花點時間在照顧病人上,然而實際上醫生們常常需要花一半的工作時間在電子醫療檔案(EHR)中寫文檔記錄。與之相關的是,一份對醫生的調查報告中也顯示出,參與調查的醫生中超過一半都顯示出了工作超負荷、精疲力竭的某些癥狀。

為了減輕一些文本記錄的負擔,有些醫生已經開始聘請醫療速記員參與到他們的日常工作中。這些速記員跟著醫生,記錄下醫生和患者之間的溝通對話,然后在EHR中建立記錄。近期也有一項研究顯示,速記員的引入不僅提高了醫生的滿意程度,同時也提高了醫學圖表的質量和準確度。不過,醫生和患者之間對話的數量遠遠超過了現有的醫療速記員的工作能力。

谷歌的研究人員們了解到這一狀況后就開始考慮,谷歌的語音識別技術如今已經有了長足的發展、也已經應用在了GoogleAssistant、GoogleHome和GoogleTranslate中,那它是否也能用來記錄醫生和病人之間的對話、幫助醫生和速記員更快地總結整理筆記呢?

在近期發表的「Speech recognition for medical conversations」論文中,谷歌的研究人員們就表明了可以為醫學對話建立自動語音識別的文本轉寫系統。當前多數用于醫學領域的自動語言識別(ASR)解決方案關注的重點都是轉寫醫生說的話(也就是說,是帶有可預計的醫療詞匯的單說話人語音識別);而谷歌這項研究就展示出構建出一個能夠處理多說話人的狀況的、能覆蓋從天氣到復雜醫療診斷等多種領域的自動語音識別模型也是可行的。

斯坦福大學的醫生和研究者們已經在如何提升醫生滿意度方面做了許許多多的研究,而通過這種技術,谷歌大腦的研究人員們也將與他們一起合作,更多地研究自動語音識別等深度學習的技術能夠如何幫助醫生更好地完成文檔記錄過程。在一項前瞻性研究中,谷歌的研究人員正在探究能從醫療對話中提取哪些類型的醫療相關信息,以便幫醫生節省使用EHR系統的時間。這項研究是完全經過病人同意的,并且為了保護病人的隱私,錄音的內容也是無法追蹤到病人身份的。

谷歌希望這些技術不僅能夠幫助醫生在每天的工作中找回醫療實踐中原有的那些快樂,更能夠幫助病人們獲得更專注、更完善的醫療關注,最終引向更好的醫療服務。

論文簡介這篇論文中介紹了作者們開發用于醫療轉寫的語音識別系統的經歷,這個系統的功能就是自動把醫生和病人間的對話自動轉錄為文字。為了達到這個目標,谷歌的研究人員們沿著兩個思路構建了這個系統:一個是基于音素的連接性時間分類(Connectionist Temporal Classification)模型,另一個是基于字母“聆聽、關注、拼寫”(Listen Attend and Spell)的模型。為了訓練這些模型,谷歌的研究人員們用了大約1萬4千小時的匿名對話語音及轉寫結果作為語料。由于轉寫結果中有一些噪音以及對齊的問題,谷歌的研究人員們花費了相當多的精力研究如何清洗這些數據,并構造了一個用于數據分割的兩步策略。

對于基于CTC的模型來說,數據清洗并構建一個對應的語言模型是成功的關鍵。而基于LAS的模型,谷歌的研究人員們發現它們對對齊、轉寫噪聲都有很高的抵抗性,并且不需要使用語言模型。最終,CTC模型可以達到20.1%的單詞錯誤率,LAS模型則可以達到18.3%。作者們的分析表明,兩個模型在關鍵的醫療用語上都有優秀的表現,確實可以用于實際的醫療對話轉寫中。

-

谷歌

+關注

關注

27文章

6172瀏覽量

105624 -

AI

+關注

關注

87文章

31097瀏覽量

269434

原文標題:除了醫療影像,醫學領域AI還能做什么?

文章出處:【微信號:hc3i8068,微信公眾號:HC3i中國數字醫療網】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

谷歌發布Gemini 2.0 AI模型

高能點焊電源技術在現代工業制造中的應用與研究進展

從發展歷史、研究進展和前景預測三個方面對混合鍵合(HB)技術進行分析

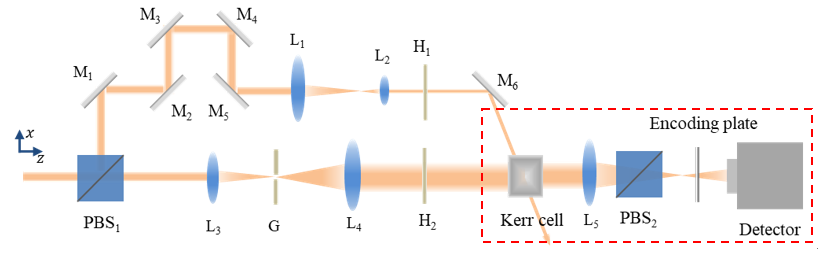

上海光機所在多路超短脈沖時空同步測量方面取得研究進展

AI大模型的最新研究進展

AI for Science:人工智能驅動科學創新》第4章-AI與生命科學讀后感

《AI for Science:人工智能驅動科學創新》第二章AI for Science的技術支撐學習心得

GE醫療與亞馬遜云科技達成戰略合作,通過生成式AI加速醫療健康領域轉型

導熱紙(膜)的研究進展 | 晟鵬技術突破導熱芳綸紙

量子計算+光伏!本源研究成果入選2023年度“中國地理科學十大研究進展”

綜述:高性能銻化物中紅外半導體激光器研究進展

谷歌AI運用幫助醫生撰寫醫療文檔的研究進展分析

谷歌AI運用幫助醫生撰寫醫療文檔的研究進展分析

評論