在人工智能飛速發展的今天,大語言模型(LLM)為各個行業帶來了全新的場景和機遇。諸如客戶服務數字人,計算機輔助藥物研發的生成式虛擬篩選,基于檢索增強生成(RAG)的企業多模態 PDF 數據提取,網絡安全流數據過濾、處理和分類優化等工作流,正在無縫集成和運行在定制化的企業 AI 應用,企業還能夠基于專有業務數據和用戶反饋數據,不斷優化 AI 應用。

同時,企業也面臨著如何高效、安全地部署 LLM 的挑戰。阿里云計算巢基于 NVIDIA 加速計算技術,通過阿里云云市場為企業和開發者提供NVIDIA AI Enterprise軟件套件,其包含了NVIDIA NIM Agent Blueprint、NVIDIA NIM和NVIDIA NeMo等企業級 AI 開發工作流和 AI 開發工具鏈。其中,NVIDIA NIM 提供可靠、高性能的 LLM 推理服務,結合阿里云計算巢實現一站式云上部署,助力企業加速實現 LLM 的 SaaS 化。

本文以 Llama3 為例,介紹該方案的整體架構和部署方式。

NVIDIA NIM:

易于使用的預構建容器工具

NVIDIA NIM 微服務是一套易于使用的預構建容器工具,目的是幫助企業客戶在云、數據中心和工作站上安全、可靠地部署高性能 AI 模型。作為 NVIDIA AI Enterprise 的一部分,NIM 具備以下核心優勢:

安全、靈活的部署:NIM 在不同環境的 CUDA GPU 加速基礎設施和 Kubernetes 發行版中經過嚴格驗證和基準測試,它支持企業在云、數據中心、工作站上安全可靠地部署高性能的 AI 推理,只需 5 分鐘即可完成部署。

加速產品上市:企業通過預構建、持續維護的微服務,能夠快速將產品推向市場,縮短開發周期。

開發者友好:開發者使用標準 API 和幾行代碼即可輕松將 NIM 集成到企業級 AI 應用程序中。

優化的推理引擎:NIM 基于Triton 推理服務器、TensorRT、TensorRT-LLM和 PyTorch 等強大的推理引擎構建, 提供行業領先的吞吐率、延遲和 token 生成速度,確保服務響應更快。

企業級支持:NIM 采用企業級基礎容器構建,提供嚴格的驗證、定期安全更新,適合企業生產環境部署。

阿里云計算巢:專為服務商

及其客戶打造的云集成 PaaS 平臺

阿里云計算巢服務是一個開放給企業應用服務商(包括:企業應用服務商、IT 集成服務商、交付服務商和管理服務提供商等)及其用戶的服務管理 PaaS 平臺,提供軟件上云的“一站式”解決方案。

阿里云計算巢能提供軟件的交付、部署、運維流程標準化的服務,支持軟件和資源的一體化交付,真正實現了軟件的開箱即用。

阿里云計算巢服務集成了阿里云一系列底層產品能力,通過通用的應用管控框架、租戶管理框架,幫助服務商提升服務的交付效率、管理效率和服務能力,在提升用戶滿意度的同時降低運營成本;并為用戶提供了統一管理多種應用服務的平臺,提升用戶使用服務的效率和安全性,降低用戶獲取服務和管理服務的成本。

方案介紹

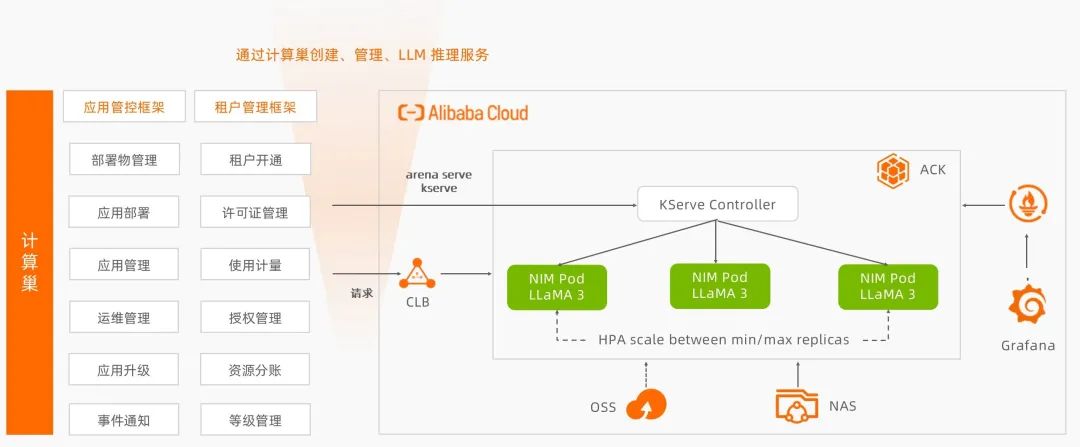

下圖展示了通過阿里云計算巢快速部署 NVIDIA NIM 的整體架構。以 Llama3 為例,我們通過計算巢來創建、管理 LLM 推理服務:在阿里云容器服務 ACK (容器服務 Kubernetes 版)集群上,我們使用阿里云 ACK 的云原生 AI 套件,集成開源推理服務框架 KServe,來部署 NVIDIA NIM。

同時,結合 ACK 的 Prometheus 和 Grafana 監控服務,快速搭建監控大盤,實時觀測推理服務狀態;利用 NVIDIA NIM 提供豐富的監控指標,如 num_requests_waiting,配置推理服務彈性擴縮容策略。

這里列出的云上資源,以及阿里云彈性計算服務(ECS)、專有網絡(VPC) 等基礎資源,都可以通過計算巢來輕松配置,一鍵拉起,最終實現一個云上高性能、可實時觀測、極致彈性的大語言模型推理服務。用戶只需要根據該服務創建實例,便可部署該服務。

圖 1. 通過阿里云計算巢快速部署

NVIDIA NIM 架構圖

(圖片來源于阿里云,如您有任何疑問或需要使用本圖片,請聯系阿里云)

部署流程

1. 參考 NVIDIA NIM 文檔,生成NVIDIA NGC API Key,用于訪問需要部署的模型鏡像。以本文用到的 Llama-3-8B-Instruct 為例,可以通過NVIDIA NGC 目錄來獲取。

同時,請閱讀并承諾遵守 Llama 模型的自定義可商用開源協議。

2. 在阿里云計算巢服務目錄中找到“基于 NVIDIA NIM 快速部署 LLM 模型推理服務”,并進入實例部署頁面。

如下圖所示,主要配置服務的基本信息和云上資源,以及第一步中獲取的 NVIDIA NGC API Key,需要填寫在下圖相應位置。

圖 2. 在阿里云計算巢創建服務實例

(圖片來源于阿里云,如您有任何疑問或需要使用本圖片,請聯系阿里云)

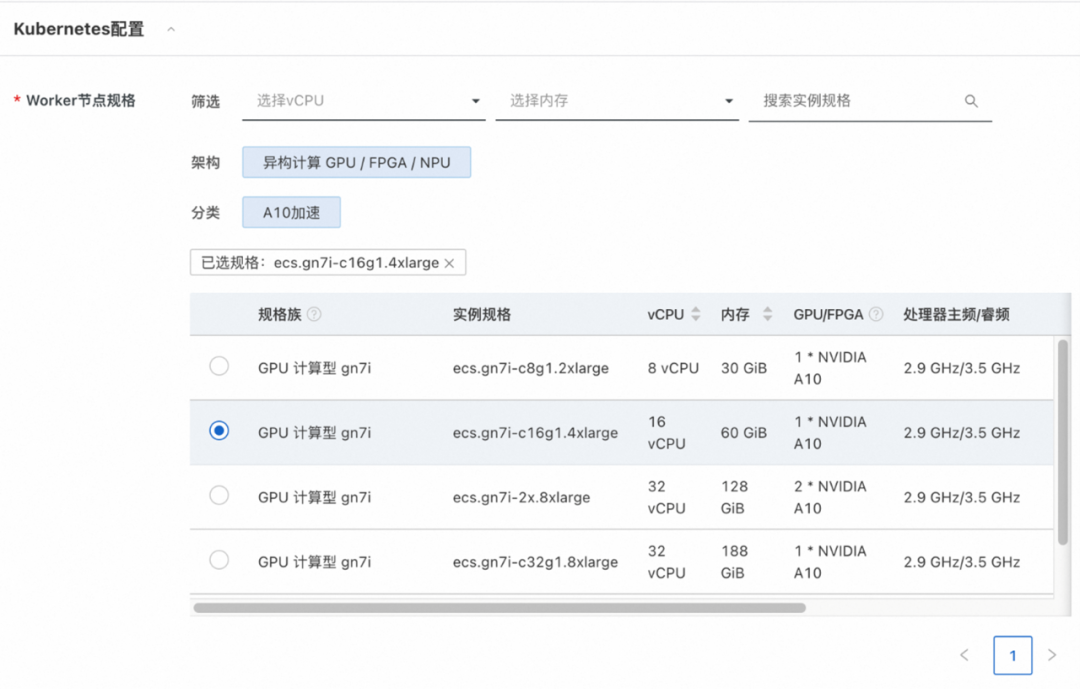

因為服務部署在阿里云 ACK 集群之上,這里也包含了 Kubernetes 配置:

圖 3. 阿里云 ACK 集群上 Kubernetes

選項頁面

(圖片來源于阿里云,如您有任何疑問或需要使用本圖片,請聯系阿里云)

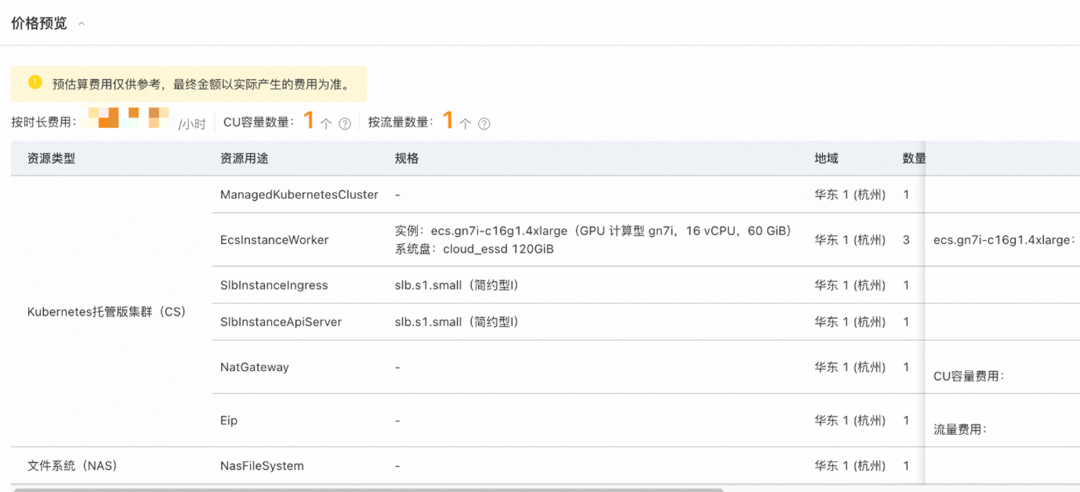

3. 按照頁面提示完成所有配置之后,點擊下一步:確認訂單,在這里確認第 2 步配置的服務實例信息和價格預覽。

圖 4. 確認服務實例信息和價格預覽

(圖片來源于阿里云,如您有任何疑問或需要使用本圖片,請聯系阿里云)

部署過程中,用戶需要創建和訪問阿里云資源,當阿里云賬號屬于 RAM 賬號時,需要開通以下權限,頁面上也有開通這些權限的入口。

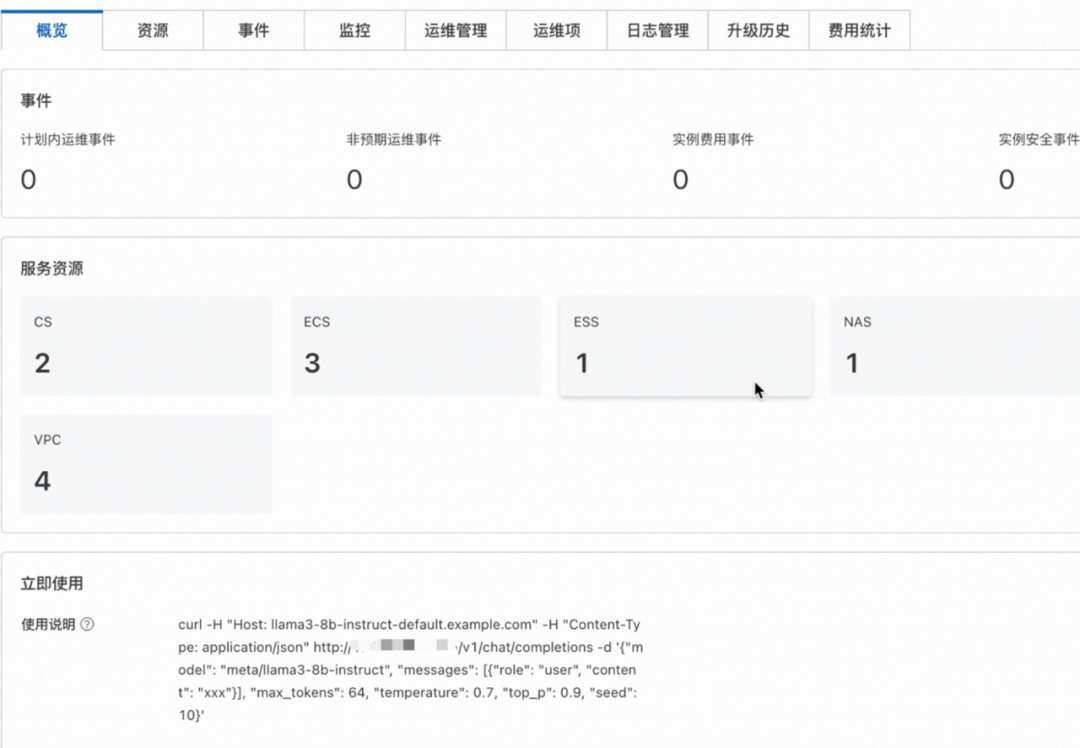

4. 點擊立即創建,開始部署。過程中會涉及阿里云資源的創建、NIM 模型鏡像的拉取等。拉取過程的日志,可通過”點擊資源 tab-> 找到 ACK 集群->頁面左側的工作負載->無狀態”來查看。部署完成后,進入服務實例詳情查看使用說明。通過 curl 發送 HTTP 請求訪問推理服務,修改 content 字段,便可自定義和推理服務交互的內容。

圖 5. 服務實例詳情頁面截圖

(圖片來源于阿里云,如您有任何疑問或需要使用本圖片,請聯系阿里云)

通過阿里云的云市場獲取

NVIDIA AI Enterprise 使用該方案

NVIDIA NIM 是 NVIDIA AI Enterprise 的一部分,正式使用時須獲得 NVIDIA AI Enterprise 的許可證授權。現在,企業用戶可以通過阿里云云市場獲取 NVIDIA AI Enterprise 來使用該方案。阿里云市場提供了概念驗證(PoC)測試服務和購買 NVIDIA AI Enterprise 許可證,共兩個下單頁面。

PoC 測試服務

提供 90 天 NVIDIA AI Enterprise PoC License,暨 90 天免費試用,而使用時須支付阿里云計算資源的費用。

通過阿里云的云市場購買 NVIDIA AI Enterprise 許可證

該頁面提供的信息僅供參考,用戶需要通過該頁面的“NVIDIA 服務咨詢”釘釘來溝通采購,最終通過云市場官網推送下單鏈接獲取 NVIDIA AI Enterprise 許可證。

總結

本文介紹了通過阿里云計算巢快速部署 NVIDIA NIM 的方案收益和部署方式,該方案充分利用了 NIM 的安全與高性能的無縫 AI 推理功能,以及計算巢的軟件一站式上云和交付能力,從而打造極致彈性、高性能、可實時觀測的云上 LLM 推理服務。

作者信息

毛亦姝

NVIDIA 解決方案架構師,主要負責生成式 AI 模型的訓練、推理在云上的落地,多年互聯網算法工作經驗。

-

NVIDIA

+關注

關注

14文章

5309瀏覽量

106412 -

AI

+關注

關注

88文章

35164瀏覽量

279979 -

人工智能

+關注

關注

1806文章

49028瀏覽量

249539 -

阿里云

+關注

關注

3文章

1014瀏覽量

44190

原文標題:通過阿里云計算巢部署 NVIDIA NIM,加速企業大語言模型 SaaS 化

文章出處:【微信號:NVIDIA-Enterprise,微信公眾號:NVIDIA英偉達企業解決方案】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

【產品活動】阿里云GPU云服務器年付5折!阿里云異構計算助推行業發展!

一張圖看懂阿里云新發布的物聯網設備上云神器——HiTSDB + IoT套件

阿里云彈性高性能計算產品商業化正式發布

AI開發者福音!阿里云推出國內首個基于英偉達NGC的GPU優化容器

阿里云免費使用及手冊

阿里云專有宿主機(公測)發布

阿里云HPC助力新制造 | 上汽仿真計算云SSCC

阿里展示“云到端”整體方案

NVIDIA NIM 革命性地改變模型部署,將全球數百萬開發者轉變為生成式 AI 開發者

借助NVIDIA NIM加速AI應用部署

評論