轉載自:數智地球

航空建筑深度估計是三維數字城市重建中的一項重要任務,基于深度學習的多視圖立體(MVS)方法在該領域取得了較好的成果。目前的主要方法通過修改MVS 框架實現建筑物的深度估計,缺乏對建筑物內在結構的考慮,易導致精度不足等問題。

本文提出了一種新穎的由粗到細的多視圖立體三維重建框架 EG-MVSNet,利用邊緣信息感知抽取機制以及邊緣信息多維融合機制實現了建筑物邊緣信息指導的深度估計,使得模型能夠估計準確的建筑物深度圖,進而實現高精度的建筑物三維點云重建。

我們分別在WHU-MVS 數據集和LuoJia-MVS 數據集上進行大量實驗,實驗結果表明我們的方法達到了最佳水平,并具有在其他領域推廣使用的潛力。本文相關科研成果已于2023年12月被ISPRS期刊接收。

背景介紹

近年來,MVSNet通過構建基于CNN特征的代價體,并使用3D CNN對其進行正則化,在獲取深度圖等任務中表現出色。一些研究人員嘗試將該方法應用于基于航空圖像的大規模航空MVS重建,如 RED-Net、MS-REDNet 和 HDC-MVSNet,卻未考慮建筑物體本身結構特征,導致重建精度較低。

具體來說,航拍視角通常會將建筑物與相鄰地形緊緊相連,因此當航拍圖像采用傾斜攝影、照明不足或圖像分辨率較低時,較難分辨出建筑物與地形的邊緣,導致相鄰地形的邊緣干擾建筑物表面深度值的分布,我們將該現象定義為深度粘連。該問題會導致航拍建筑物深度估計不準確,進一步影響到建筑物的精確重建。

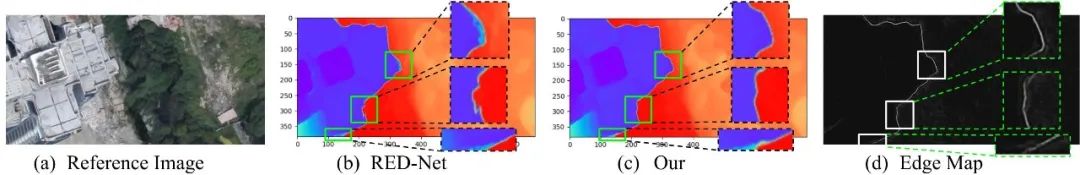

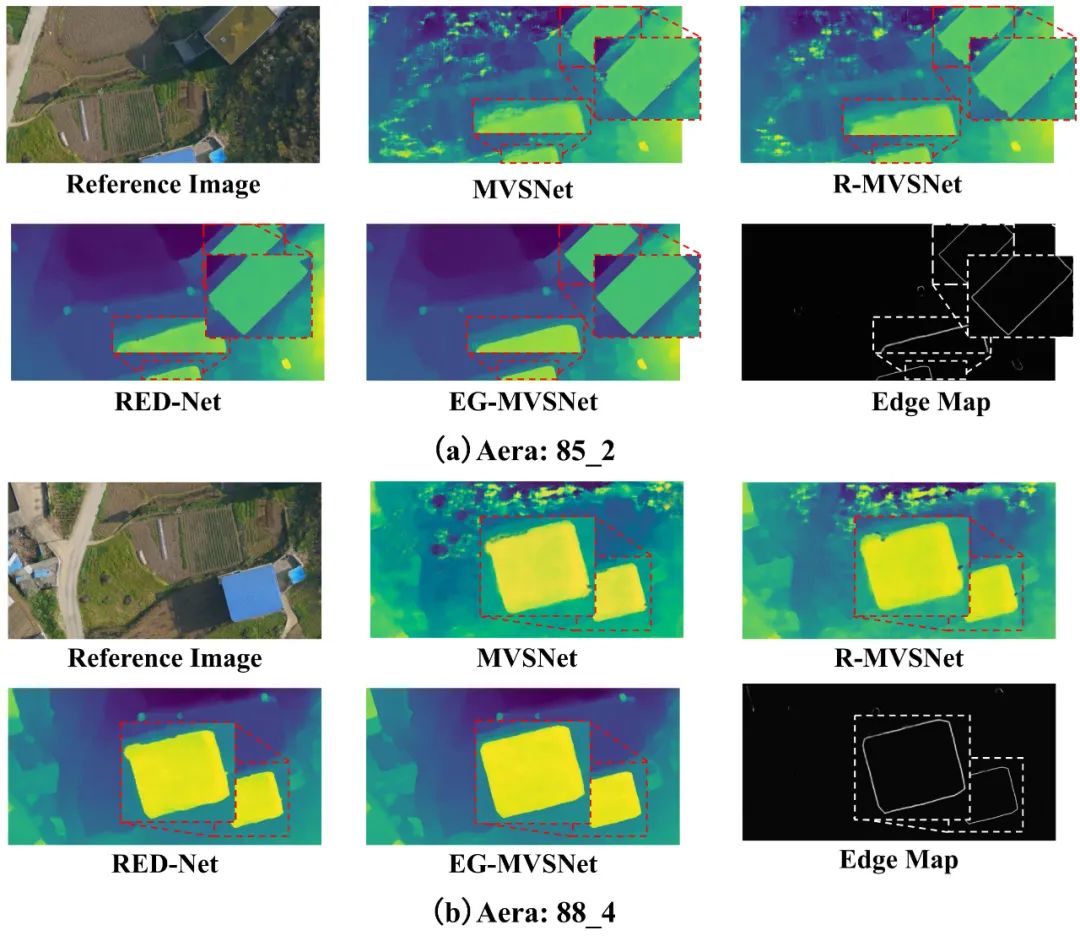

如圖1中(b)所示,可以清楚地觀察到,不考慮建筑物邊緣信息的通用方法在航空建筑物圖像深度估計結果中容易出現前景(建筑物)與背景(地形)之間深度粘連的問題。

圖1 深度粘連問題的對比結果

在邊緣檢測領域,邊緣信息明確對應著劇烈的梯度變化,因此融合邊緣信息有助于獲得更精確、更銳利的遮罩,緩解深度粘連問題。如圖1中(c)和(d)所示,在引入邊緣特征信息后可獲得更加精確的結果。綜上所述,如何提取有效的建筑物邊緣信息,同時將其融合至MVSNet網絡框架中是本文的主要研究內容。

方法介紹

2.1 整體框架

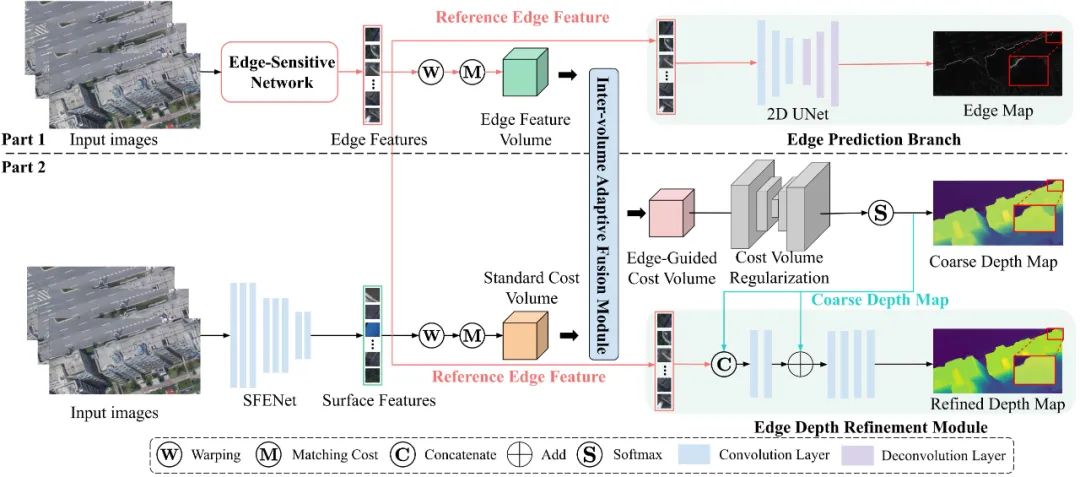

圖2 EG-MVSNet框架。網絡由兩部分組成,分別獲得邊緣圖、粗深度圖和精深度圖(紅框中展示了各圖的細節對比)。圖中粗體部分為提出的模塊,SFENet和代價體正則化網絡的架構源自RED-Net。

網絡流程描述:

(1)建筑物邊緣特征提取:第一部分的目的是獲取精確可靠的建筑邊緣特征,以便實現特征融合。具體來說,為了有效編碼邊緣特征,我們提出了一個邊緣感知網絡(Edge-Sensitive Network, ESNet)。基于提取的邊緣特征,可以通過可微的單映性變換構建邊緣特征體 ,該特征體可以和標準代價體進行融合,從而在第二部分對深度估計隱式地三維引導正則化。為確保 ESNet 主要關注建筑邊緣特征而非其他無關特征,我們利用類似于 UNet 的邊緣預測分支(EPB)預測邊緣圖 ,并利用建筑邊緣深度損失(BED-Loss)計算邊緣圖與生成的GT真實邊緣圖之間的損失,從而實現對于邊緣提取分支的約束。

(2)建筑物邊緣特征融合:第二部分旨在將建筑邊緣特征融合至標準MVS框架,即分別從2D和3D兩個維度對深度圖預測進行引導。為了實現隱式的三維引導,設計體間自適應融合模塊(Inter-volume Adaptive Fusion Module, IAFM)融合邊緣特征體和標準代價體,從而得到邊緣引導代價體,進一步通過3D-UNet來預測粗深度圖。為了實現顯式的2D引導,設計邊緣深度細化模塊(EDRM),利用邊緣特征來細化粗糙深度圖,得到細化的深度圖。

2.2 邊緣感知網絡(ESNet)

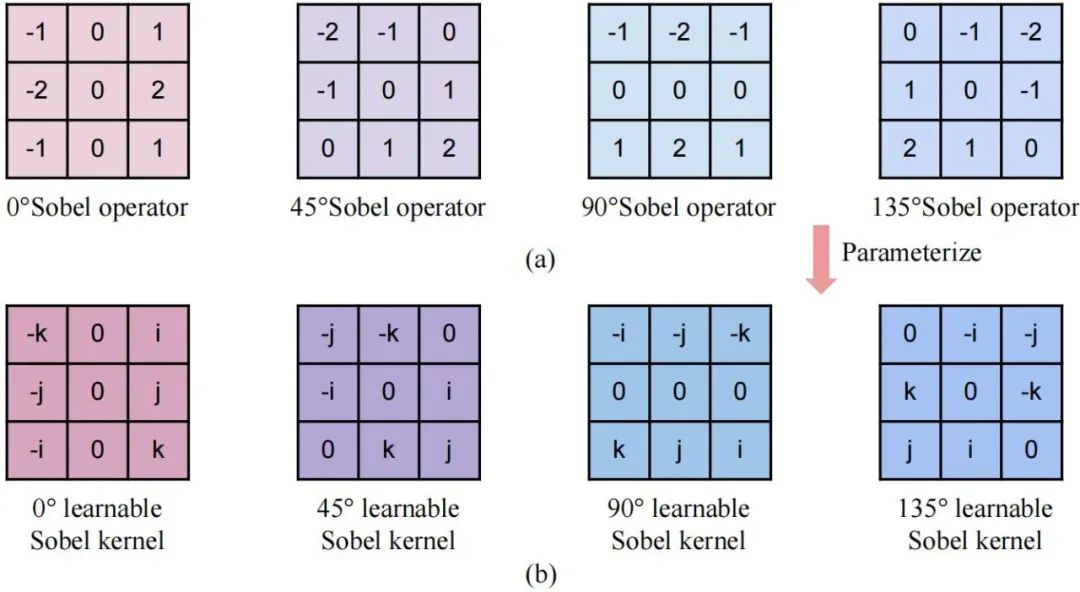

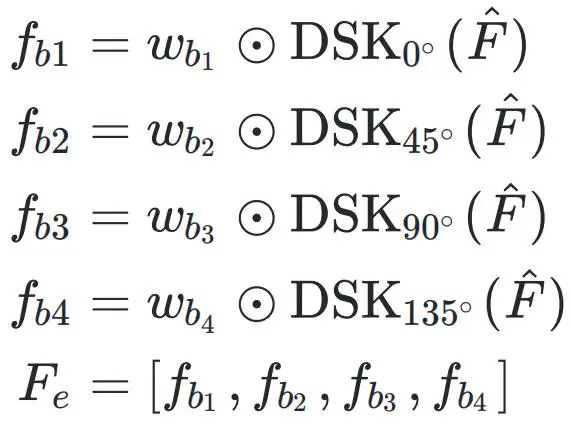

為提取精確的建筑物邊緣特征我們提出ESNet 。目前的邊緣檢測網絡缺乏識別航空圖像中建筑物邊緣的能力,因此ESNet 的設計考慮到了建筑物和MVSNet的特點。具體來說,由于索貝爾算子在經典的邊緣檢測算法中被廣泛用于獲取線性信息,因此為了捕捉建筑物的剛性結構,我們將傳統的索貝爾算子轉化為動態的索貝爾核(DSK),如圖3所示。

圖3 不同形式的索貝爾算子和可學習索貝爾核的圖示。(a) 顯示了四種不同形式的不可學習索貝爾算子。(b) 顯示參數化后的可微分索貝爾核

基于上述動態的索貝爾核,可以將索貝爾算子轉換為可學習的卷積核實現模型優化,提高模型對于線性特征的編碼能力。線性特征是由水平線、垂直線和斜線組成的,如果僅使用單一方向的線性特征提取 DSK(如 0° DSK 或 90° DSK),提取的斜線特征往往不夠充分。因此,我們將上述不同的 DSK 組合至同一層中,實現對任意方向的線性特征進行編碼,有效捕捉了建筑物的邊緣結構。

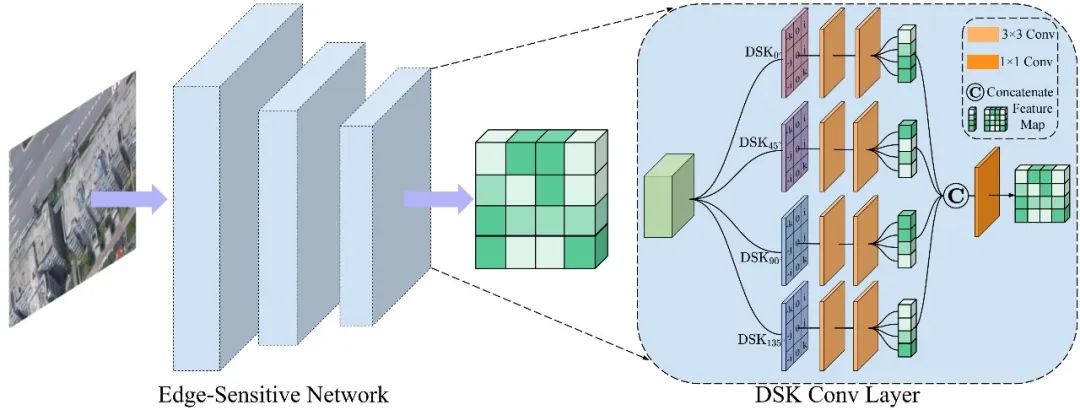

圖4 ESNet圖示。左圖:ESNet 由三個級聯 DSK卷積組成。右圖:每個DSK卷積層的四路DSK

DSK 卷積層示意圖如圖4所示,使用四個不同方向的可微分DSK構建 DSK卷積層從而實現對于復雜建筑的邊緣感知,進一步將每個分支提取的特征圖串聯起來,得到最終的建筑物邊緣特征圖。每個分支分別對應 0° DSK、45° DSK、90° DSK 和 135° DSK,每個分支使用不同類型的可微分 DSK 來提取線性特征。使用兩個卷積層對特征進行去噪和降采樣,融合各分支提取的特征之后,得到最終的建筑邊緣特征圖。DSK卷積層的公式定義如下:

其中,[·]表示連接操作,wbi 分別代表各分支的卷積權重。

2.3 邊緣預測網絡(EPB)

基于ESNet提取的邊緣特征,我們提出了一個類似于UNet的邊緣預測分支。通過對邊緣特征進行回歸,約束ESNet,使網絡重點關注建筑物邊緣特征,同時減少對其他無關特征的提取。考慮到邊緣圖預測類似于語義分割任務,且UNet在語義分割任務中已經取得了巨大成功,因此我們考慮在UNet的基礎上設計我們的邊緣圖預測分支,對邊緣特征進行回歸以生成邊緣圖用于損失計算。EPB的整體架構如圖2右上角所示。

具體來說,EPB使用2D UNet網絡回歸參考圖像邊緣特征,得到邊緣圖。EPB采用了編碼器-解碼器結構,可以有效地從寬廣的感受野中收集鄰近信息,而不會產生過多的內存和計算消耗。在下采樣階段,邊緣特征被逐步下采樣為對應于不同尺度的四個邊緣中間特征圖。隨后,解碼器對邊緣中間特征圖進行上采樣,以恢復原始圖像大小,獲得邊緣圖。

EPB明確利用邊緣特征,同時隱式地優化了深度圖,有效減輕了深度粘連問題。這一預測過程提高了邊緣特征的準確性和可靠性,而邊緣特征在我們的整體框架中發揮著關鍵作用。此外,EPB提供可視化結果,對于驗證方法的有效性并確保其達到預期目標至關重要。

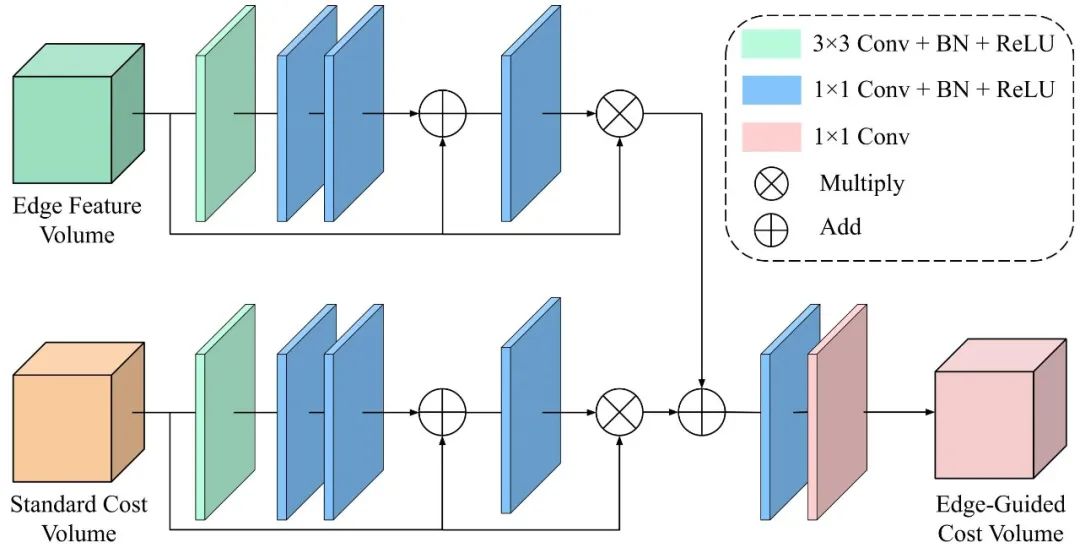

2.4 體間自適應融合模塊(IAFM)

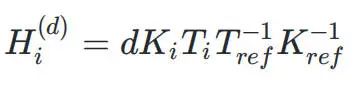

IAFM 的設計目的是將第1部分提取的2D建筑邊緣特征融入到MVS框架中,以此來指導3D代價體的正則化。因此需要將2D邊緣特征轉換為3D特征,以實現這種結合。MVSNet中的3D代價體是通過匹配不同深度、不同視圖以及不同空間位置的2D特征點之間的相似性來構建的。受這一機制的啟發,我們也采用了可微分單映性變換(differentiable homography warping)來構建3D邊緣特征體,變換公式如下所示:

式中,T, K 分別代表相機的內外參數。通過上述操作,我們將2D邊緣特征轉換至3D域。然而,在構建的邊緣特征體中,并非所有的邊緣匹配信息都是有效的,我們的目標是在融合過程中只將有效信息有選擇地融合到3D代價體中,而忽略無關信息。直接求和可能會導致邊緣特征體中的無效代價信息影響到代價體中的有效代價信息,如表面代價信息。因此,如果能自適應地將有效的邊緣代價信息整合到代價體中,就能減輕無效代價信息的影響。

受啟發于注意力機制,我們提出了一種基于注意力機制的體間自適應融合模塊(IFAM),通過利用注意力機制(由多個疊加卷積構建)來增強邊緣代價信息,抑制非邊緣代價信息,從而增強邊緣特征體與代價體的融合。我們的IFAM 結構如圖5所示。

圖5 IFAM圖示

具體來說,IFAM 通過應用多個帶跳轉連接的疊加卷積來計算邊緣特征體的邊緣增強體。同樣,標準代價體的信息增強體也通過類似的機制獲得。IFAM 通過元素相加的方式實現融合,在兩個卷積層之后得到最終的邊緣引導代價體。因此,IFAM可以定義成如下公式:

綜上,IAFM即可通過使用邊緣特征引導標準代價體,進而獲得更精確、更有效的深度圖。

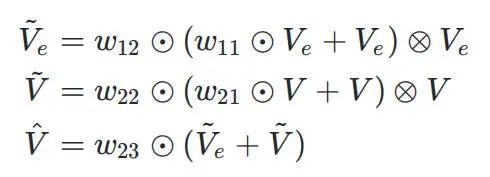

2.5 邊緣深度細化模塊(EDRM)

然從概率體中得到深度圖是一個有效的輸出,但由于正則化過程中涉及到較大的感受野,可能會出現深度邊界過度平滑或模糊等問題,這是語義分割和圖像去噪任務中的一個常見問題。因此,可以在粗深度圖中加入邊緣特征,以獲得更詳細的邊緣信息并明確深度邊界,進而緩解上述問題。

受此啟發,通過探索使用2D邊緣特征完善初始粗深度圖,進而增強建筑邊緣深度估計結果并提高深度圖的整體質量。因此提出邊緣深度細化模塊(EDRM),利用提取的參考邊緣特征來優化深度圖。

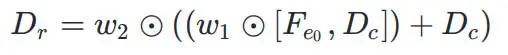

EDRM的結構見圖2右下方。在該模塊中,我們首先將粗深度圖Dc與邊緣特征Fe0連接起來,然后將通過應用于粗深度圖的兩個卷積層獲得的邊緣殘差信息納入其中。這一聚合過程能夠整合邊緣信息,并生成邊緣增強深度圖。最后,使用四個卷積層對邊緣增強深度圖進行過濾,生成細化深度圖Dr。EDRM的公式可以定義為:

實驗結果

3.1 WHU-MVS數據集

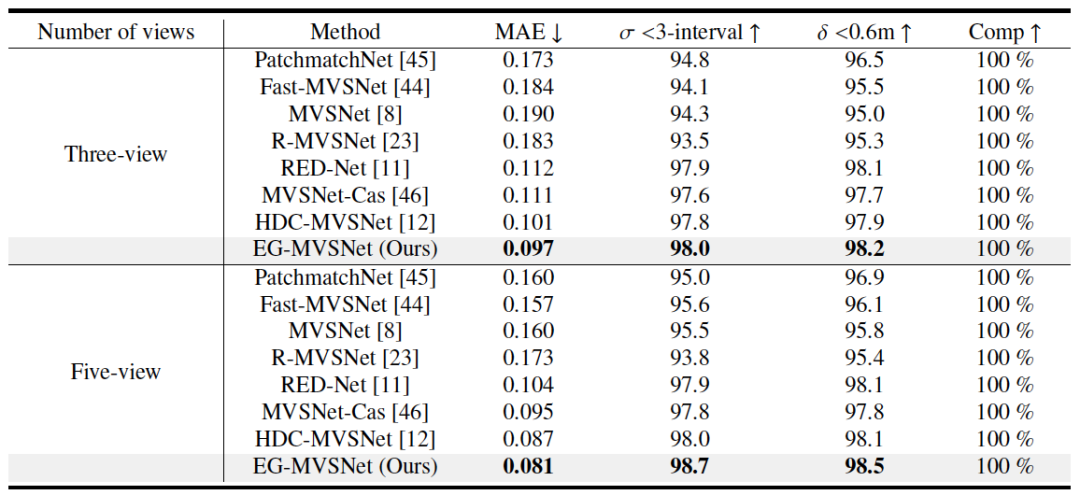

EG-MVSNet在WHU-MVS數據集上的結果如下表1所示:

表1 EG-MVSNet在WHU-MVS數據集定量分析

我們在WHU-MVS數據集上與現有最優方法的定量對比如上表所示。我們具體對比了兩種視圖作為輸入(三視圖和五視圖)的結果,從結果上可以看出我們的方法都取得了最優性能。其中,我們的方法在MAE指標上,在三視圖上得到了0.097的結果,在五視圖上得到了0.081的結果,相較其他方法均得到了顯著提升。

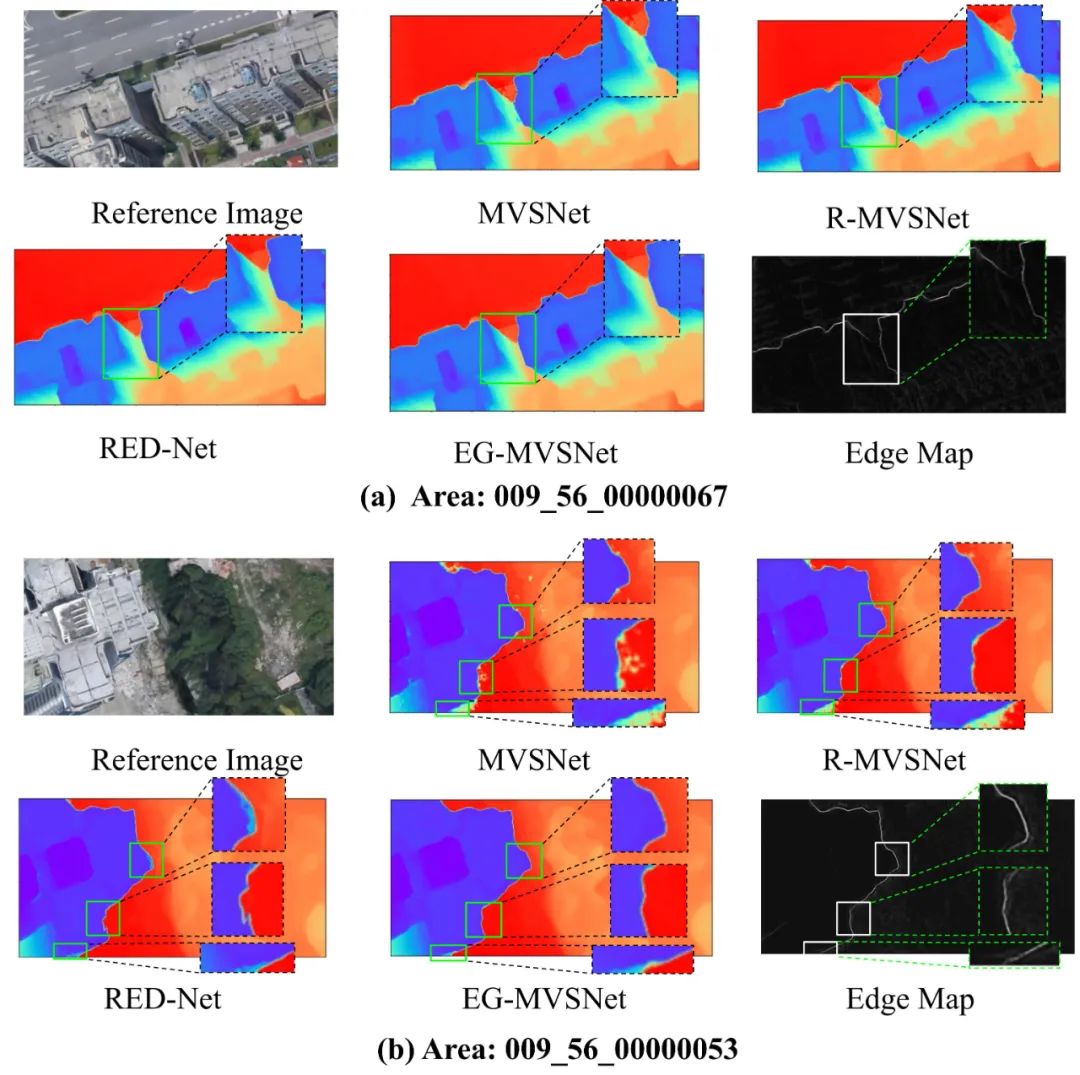

EG-MVSNet在WHU-MVS數據集上深度估計對比圖如下圖6所示:

圖6 EG-MVSNet在WHU-MVS數據集深度估計對比圖

圖6展示了EG-MVSNet與大多數最優方法的定性結果對比。如圖中邊緣圖的結果可以看出,我們的方法能夠準確的估計出建筑物的邊緣圖。對比圖中局部細節的深度圖結果可以看出,我們的方法能夠估計出更加準確的深度結果,有效的解決了深度粘連的問題。

3.2 LuoJia-MVS數據集

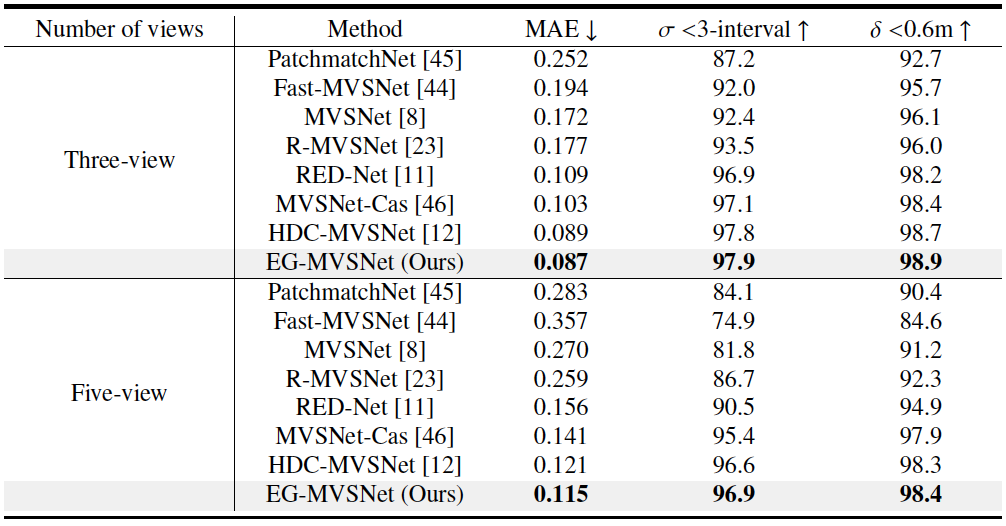

EG-MVSNet在Luo-Jia-MVS數據集上的結果如下表2所示:

表2 EG-MVSNet在LuoJia-MVS數據集定量分析

表2展示了我們的模型的其他地物要素類型數據集上的泛化能力。從上表可以看出無論是在三視圖估計亦或五視圖的深度估計上,我們的模型均可以取得相對不錯的效果。

EG-MVSNet在LuoJia-MVS數據集上可視化效果對比圖如下圖7所示:

圖7 EG-MVSNet 在LuoJia-MVS數據集上可視化效果對比圖

從圖7可以看出,相比較于其他方法深度估計結果所展現出的深度粘連問題,我們的方法得益于能夠準確的估計出建筑物的深度圖并且進行充分的融合,能夠有效的解決深度粘連的問題,進一步的提升了模型深度估計的質量。

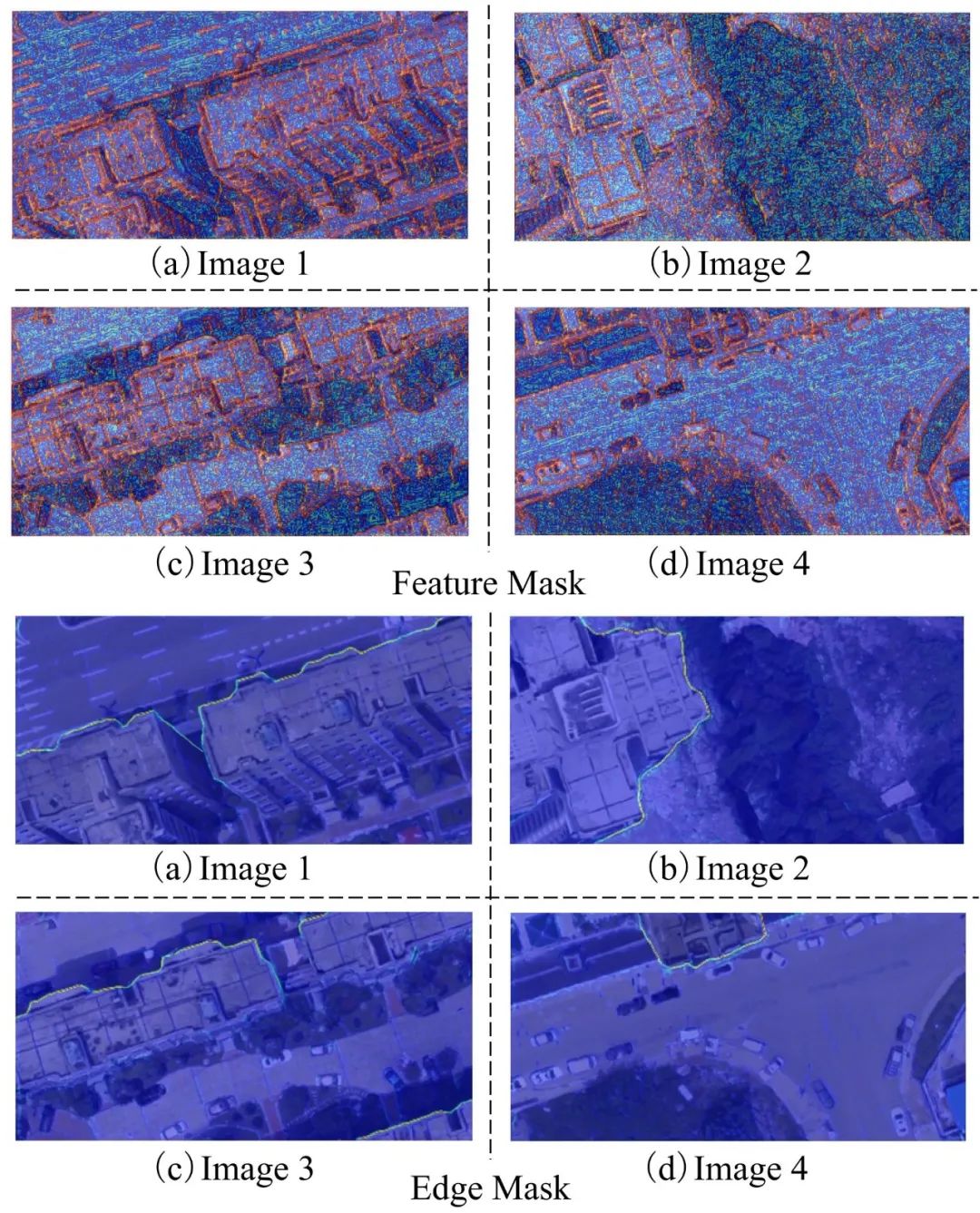

3.3 邊緣特征可視化

圖8 邊緣特征可視化結果

圖8為模型提取的邊緣特征圖可視化結果,觀察可知基于DSK卷積層,模型提取了十分準確的建筑邊緣線性特征。從圖中右側部分可以看出模型估計的邊緣圖和原始圖像中建筑物的邊緣十分貼合,進一步證明了模型估計邊緣的準確性。

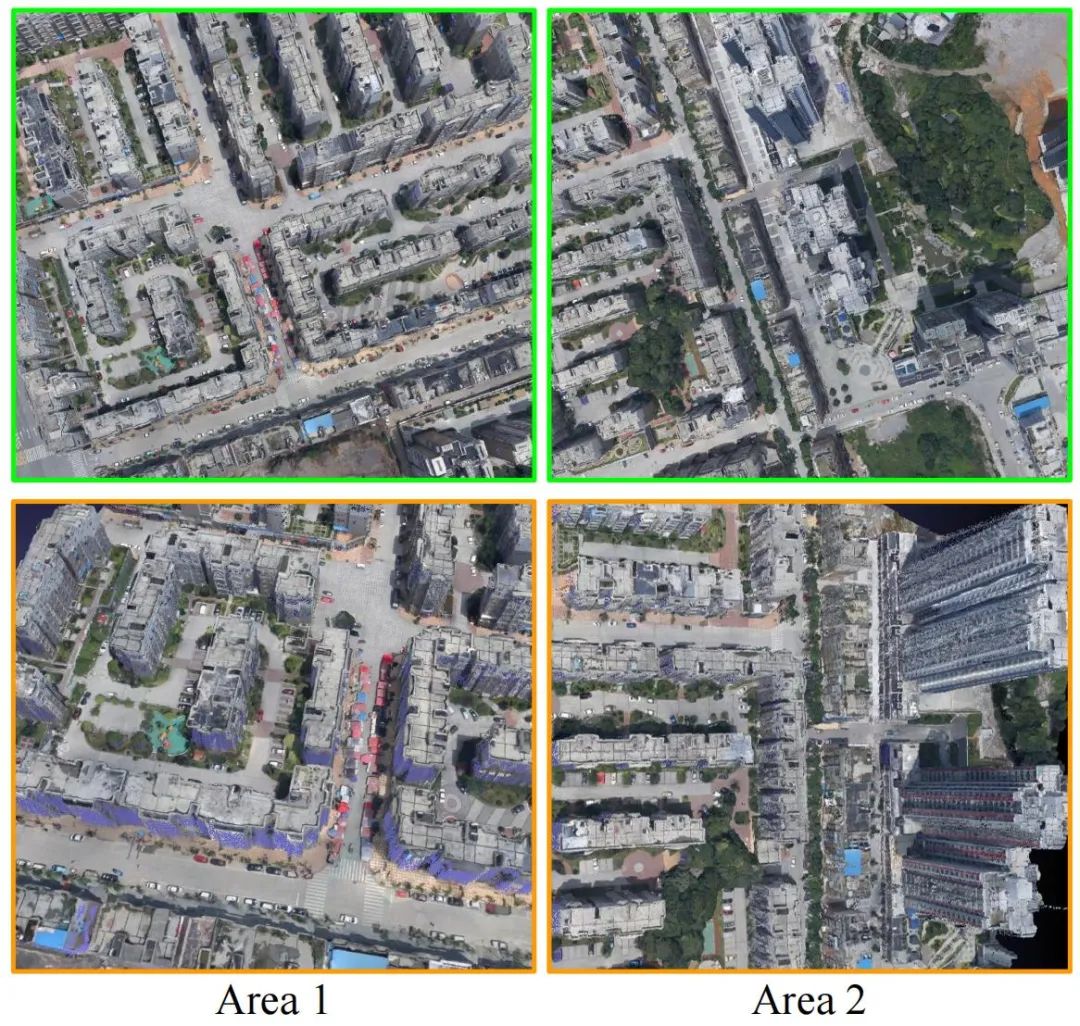

3.4 重建結果

如圖9所示是我們的模型對于城市區域的點云重建結果:

圖9 城市區域點云重建實驗結果

如圖9所示,EG-MVSNet通過引入建筑物邊緣信息,基于高精度深度圖,較好地完成了城市區域的點云重建任務。

結論

我們提出了一種用于大規模航空建筑物多視圖立體的邊緣信息引導深度推理網絡 EG-MVSNet,通過引入建筑物邊緣特征信息緩解深度粘連的問題,從而進一步提高了估計深度圖的精度。

該網絡包括用于提取建筑物邊緣特征的邊緣感知網絡(ESNet)、用于建筑物邊緣預測網絡(EPB)和用于邊緣信息融合的體間自適應融合模塊(IAFM)以及邊緣深度細化模塊(EDRM)。

實驗結果表明,我們提出的方法達到了最先進的性能,與所有列出的方法相比,具有極強的泛化能力。此外通過額外的定性實驗以及可視化展示證明了我們的方法能夠有效的提取建筑物的邊緣信息,有效的解決了深度粘連的問題。

-

航空

+關注

關注

2文章

790瀏覽量

27337 -

三維重建

+關注

關注

0文章

26瀏覽量

9919 -

深度學習

+關注

關注

73文章

5500瀏覽量

121111

原文標題:建筑物邊緣感知和邊緣融合的多視圖立體三維重建方法

文章出處:【微信號:vision263com,微信公眾號:新機器視覺】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

建筑物邊緣感知和邊緣融合的多視圖立體三維重建方法

建筑物邊緣感知和邊緣融合的多視圖立體三維重建方法

評論