作者:Sebastian Raschka 博士,

翻譯:張晶,Linux Fundation APAC Open Source Evangelist

編者按:本文并不是逐字逐句翻譯,而是以更有利于中文讀者理解的目標,做了刪減、重構和意譯,并替換了多張不適合中文讀者的示意圖。

原文地址:https://magazine.sebastianraschka.com/p/understanding-multimodal-llms

在過去幾個月中,OpenVINO?架構師 Yury閱讀了眾多有關多模態大語言模型的論文和博客,在此基礎上,推薦了一篇解讀多模態大語言模型的最佳文章《Understand Multimodal LLMs》--- 能讓讀者很好的理解大語言模型(LLMs)是如何演進為視覺語言模型(VLMs)的。

閱讀本文之前,可以先在自己的電腦上運行當前最新的視覺大語言模型Llama 3.2 Vision模型,感受一下視覺語言模型能干什么!

一,什么是多模態大語言模型

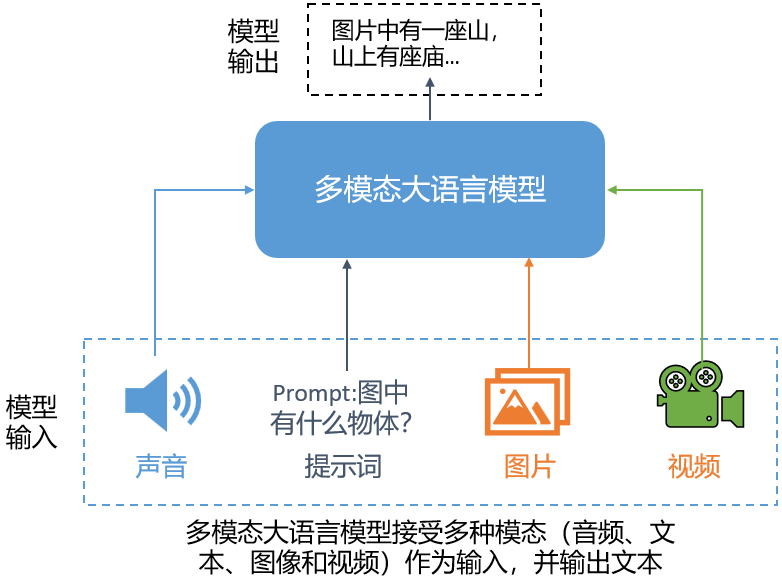

多模態大語言模型是能夠處理多種“模態”類型輸入的大語言模型,其中每個“模態”指的是特定類型的數據,例如:文本、聲音、圖像、視頻等,處理結果以文本類型輸出。

多模態大語言模型的一個經典而直觀的應用是解讀圖片:輸入圖像和提示詞,模型生成該圖像的描述(文本),如下圖所示。

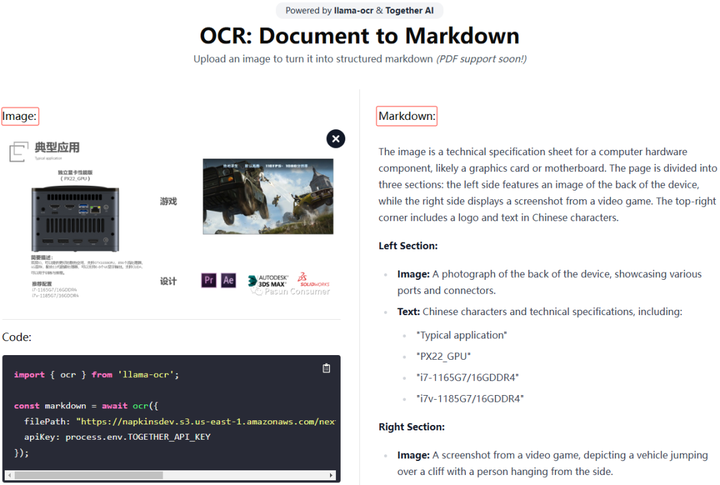

當然,還有許多其他應用,例如:從圖片中提取信息并將其轉換為 LaTeX 或 Markdown。

二,構建多模態大語言模型的常見方式

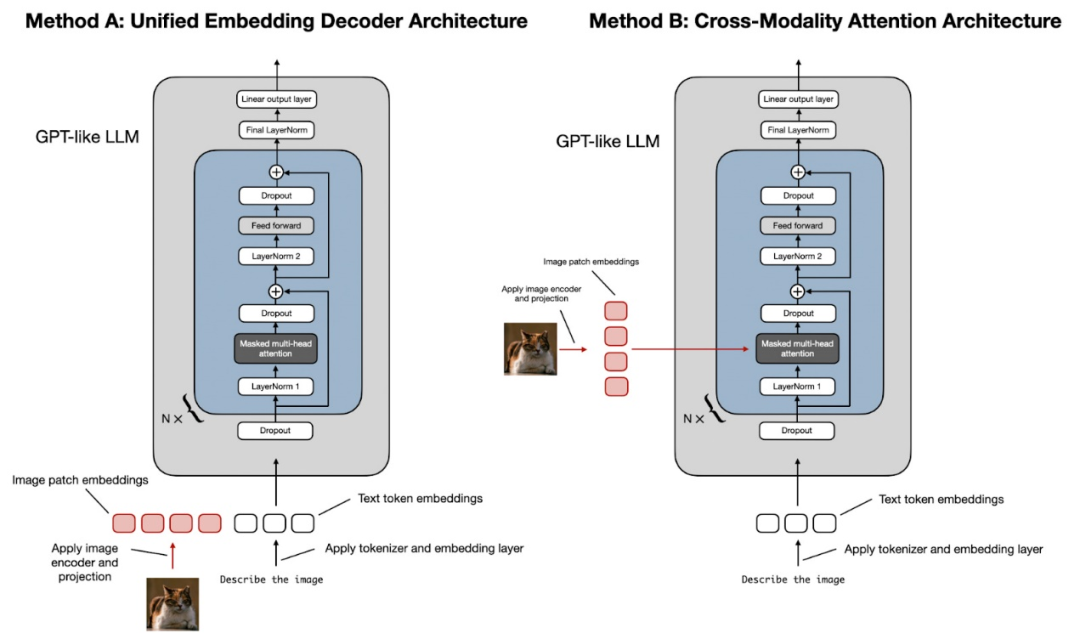

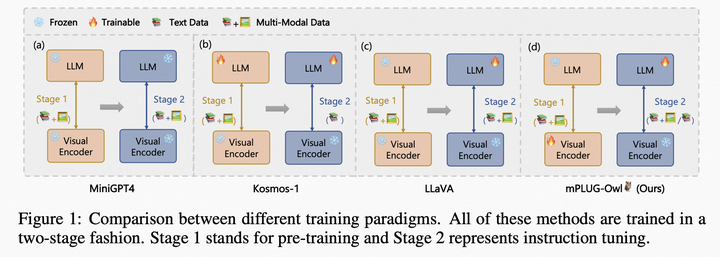

構建多模態 LLM 有兩種主要方式:

方法 A:統一嵌入解碼器架構(Unified Embedding Decoder Architecture);

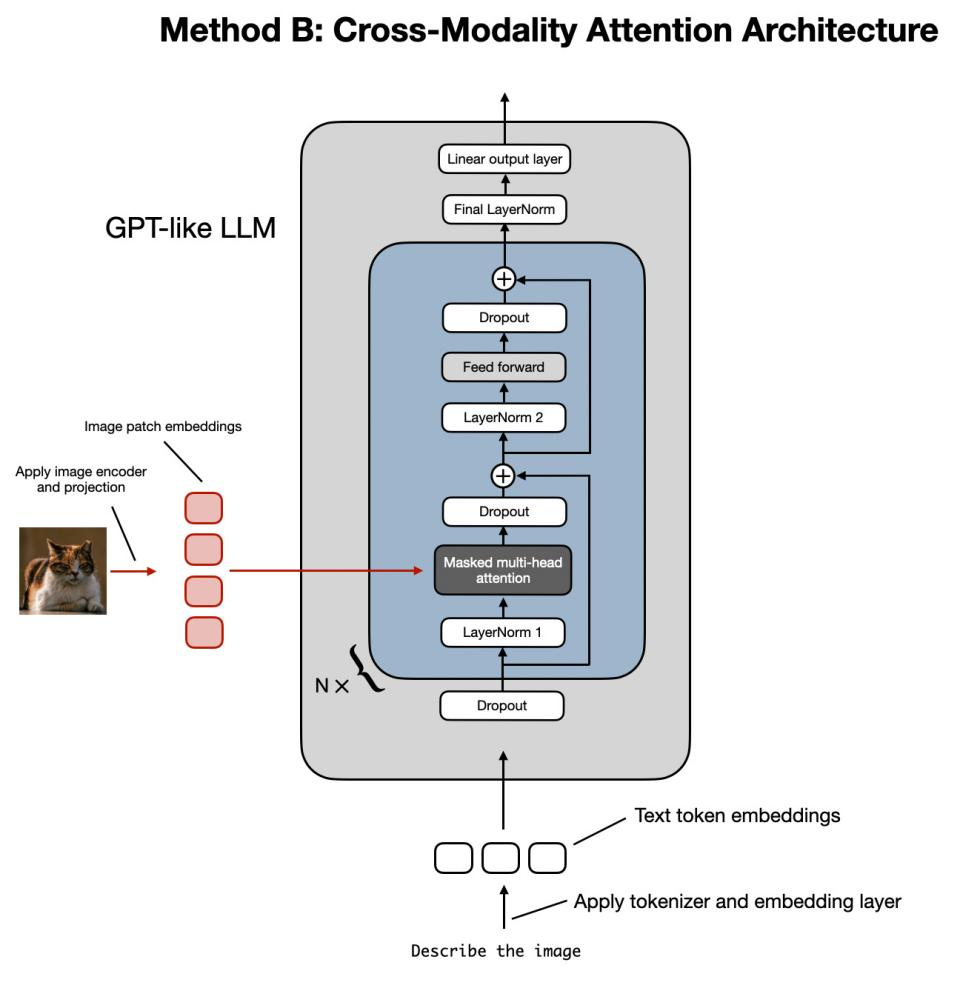

方法 B:跨模態注意架構(Cross-modality Attention Architecture approach)。

(順便說一句,Sebastian認為這些技術目前還沒有正式的術語,但如果您遇到過,請告訴他。例如,更簡短的描述可能是“僅解碼器(Decoder-Only)”和“基于交叉注意(Cross-Attention-Based)”)

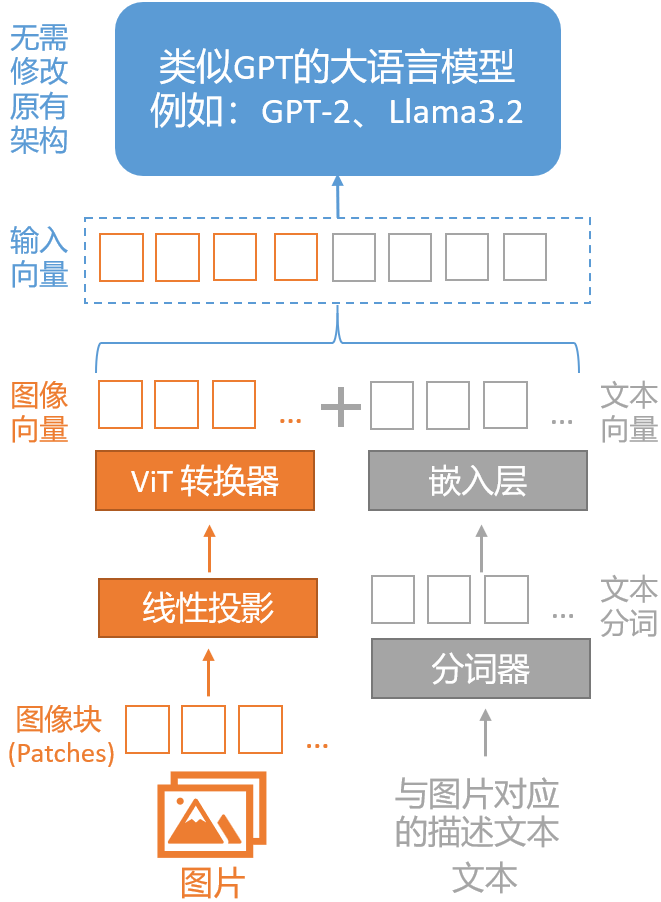

如上圖所示,統一嵌入解碼器架構使用單個解碼器模型,與僅解碼器(Decoder-Only)的 LLM 架構(如 GPT-2 或 Llama 3.2)非常相似。在這種方法中,圖像被轉換為與原始文本分詞(本文將大語言模型語境下的Token,統一翻譯為分詞)具有相同嵌入大小的分詞,從而允許 LLM 在連接后同時處理文本和圖像輸入分詞。

跨模態注意架構采用交叉注意機制,將圖像和文本嵌入直接集成到注意層中。

三,統一嵌入解碼器架構

統一嵌入解碼器架構是一種將圖像向量和文本向量組合成嵌入向量后輸入給大語言模型的架構,其優點是:無需修改原有的大語言模型架構。

在統一嵌入解碼器架構中,圖像跟文本一樣,先被轉換為分詞(Token),然后被轉換為嵌入向量,最后跟文本嵌入向量一起,送入原來的大語言模型進行訓練或推理。

1,文本向量化

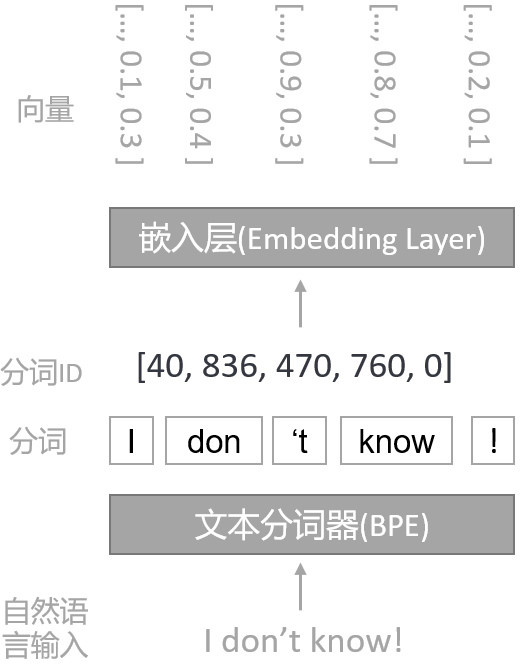

自然語言本文在輸入大語言模型前,會先經過分詞器(Tokenizer)變成分詞,然后經過嵌入層變成向量。

自然語言是非常高維的數據,因為每個可能的單詞都被視為一個特征。通過分詞化,可以將文本映射到一個固定大小的向量空間中(例如,GPT2模型用的分詞器算法是BPE,詞匯表大小是50,257),這有助于減少數據的維度,使得模型訓練更加高效。

分詞數據經過嵌入層(Embedding Layer)轉換成向量數據后,方便模型進行特征提取、捕捉豐富的語義信息和上下文關系,并提高模型的性能和計算效率。

將自然語言文本分詞化和向量化已經成為Transformer架構模型的標準數據預處理步驟。

2,圖像向量化

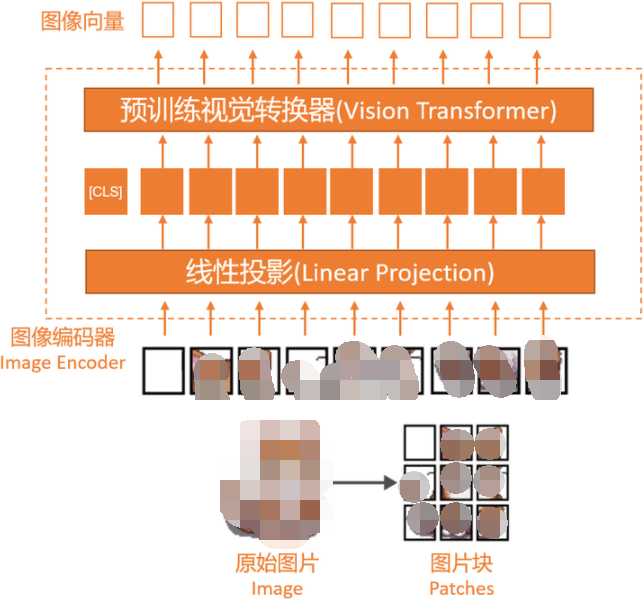

類似于文本的分詞化和向量化,圖像的向量化是通過圖像編碼器模塊(而不是分詞器)實現的。原始圖像首先會被分割成更小的塊(patches),這與分詞器(Tokenizer)將自然語言的單詞(Word)拆成分詞(Token)類似。

隨后,圖像編碼器會把這些塊由線性投影(Linear Projection)模塊和預訓練視覺轉換器(Vision Transformer)進行編碼,最終轉換成向量,其大小與文本向量相同。

上圖中的“線性投影”由一個單一的線性層(即全連接層)組成,這個層的目的是將被展平為向量的圖像塊投影到與變換器編碼器兼容的嵌入尺寸。

當前普遍使用的視覺變換器是CLIP或OpenCLIP等,負責把展平的圖像塊變換為圖像向量。由于圖像塊向量具有與文本分詞向量相同的向量維度,我們可以簡單地將它們串聯起來作為大語言模型的輸入,如本節開頭的圖片所示。

到此,統一嵌入解碼器架構(Unified Embedding Decoder Architecture)介紹完畢。

下一篇文章,我們將繼續介紹:跨模態注意架構(Cross-modality Attention Architecture approach)。

如果你有更好的文章,歡迎投稿!

稿件接收郵箱:nami.liu@pasuntech.com

更多精彩內容請關注“算力魔方?”!

審核編輯 黃宇

-

語言模型

+關注

關注

0文章

520瀏覽量

10268

發布評論請先 登錄

相關推薦

【《大語言模型應用指南》閱讀體驗】+ 基礎知識學習

如何利用LLM做多模態任務?

自動駕駛和多模態大語言模型的發展歷程

機器人基于開源的多模態語言視覺大模型

韓國Kakao宣布開發多模態大語言模型“蜜蜂”

李未可科技正式推出WAKE-AI多模態AI大模型

一文理解多模態大語言模型——上

一文理解多模態大語言模型——上

評論