當谷歌宣布其第二代專用集成電路來加速公司的機器學習處理時,筆者的電話開始響個不停,問這對半導體行業的潛在影響。世界上最大的數據中心“Super7”的其它成員是否都急于為AI制造自己的芯片?這對AI芯片和平臺的領先供應商NVIDIA、AMD、Intel等其它公司以及許多希望進入這個利潤豐厚市場的初創公司有何影響?當GPU和FPGA開始看起來如此有前途的時候,它們的游戲結束了嗎?為了回答這些問題,讓我們進入這些互聯網巨頭的頭腦,看看他們可能在計劃什么。

AI的硅景觀

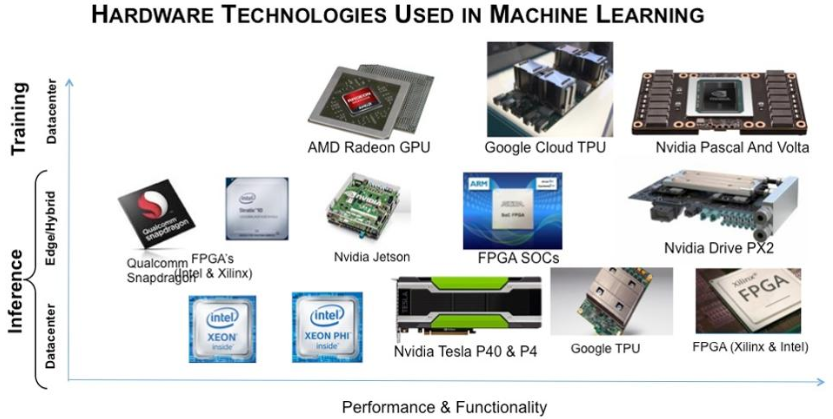

正如筆者在今年早些時候的一篇文章中所探討的,有四種主要類型的技術可用于加速深度神經網絡的訓練和使用:CPU、GPU、FPGA和ASIC。老式備用CPU具有無限可編程的優勢,性能不錯,但不是很出色。它主要用于推理工作負載,其中訓練好的神經網絡引導計算對輸入數據項做出準確的預測。另一方面,Intel和Xilinx的FPGA在極低功耗下提供出色的性能,但也提供了更大的靈活性,允許設計人員更改底層硬件以最好地支持不斷變化的軟件。FPGA主要用于機器學習推理,視頻算法和成千上萬的小批量專用應用。然而,編程FPGA硬件所需的技能很難獲得,并且FPGA的性能在某些工作負載下無法接近高端GPU的性能。

如今,機器學習、訓練和推理、云和邊緣都使用了許多類型的硬件加速器。從技術上講,GPU是一種用于處理圖形算法的ASIC。不同之處在于,ASIC提供指令集和庫,允許對GPU進行編程,以對本地存儲的數據進行操作,作為許多并行算法的加速器。GPU擅長執行矩陣運算(主要是矩陣乘法),這是圖形、AI和許多科學算法的基礎。基本上,GPU是非常快速和相對靈活的。

另一種選擇是設計一個專用于執行固定操作的定制ASIC,因為整個芯片的邏輯區域可以專用于一組特定功能。在谷歌TPU的情況下,它們可以很好地實現高度并行,而處理神經網絡是一種“令人尷尬的并行”工作負載。把ASIC想象成一輛飆車;它可以跑得很快,但它只能載一個人直線行駛四分之一英里。你不能開著它繞著街區轉,也不能開著它在橢圓形跑道上跑。

這里有一個問題:設計ASIC可能是一項昂貴的工作,耗資數千萬甚至數億美元,需要一個相當昂貴的工程師團隊。支付所有這些開發費用意味著需要成千上萬的芯片在設計的使用壽命(通常是2-3年)內攤銷這些費用。此外,芯片需要經常更新,以跟上新技術和制造工藝的步伐。最后,由于設計師在開發過程的早期就凍結了邏輯,當新想法出現在快速發展的領域(如AI)時,他們將無法快速做出反應。另一方面,FPGA(在一定程度上甚至是GPU)可以重新編程以實現新功能。

谷歌為什么要制造TPU?

如果仔細想想谷歌的業務,就會發現它有三個特點,很可能促使它投資于AI定制芯片。檢查這些因素可能有助于評估其它公司進行類似投資的潛在可能性。

戰略意圖

谷歌曾多次表示要成為一家“AI First”的公司。換句話說,AI技術在整個業務中發揮著戰略作用:搜索、自動駕駛汽車、谷歌云、谷歌家庭,以及許多其它新的和現有的產品及服務。因此,谷歌想要控制自己的硬件(TPU)加速器和自己的軟件框架(TensorFlow)是有道理的,他們將在這些框架上構建自己的產品和服務。該公司愿意投資,以使自己比其它擁有類似抱負的公司更有優勢。

所需規模

谷歌的計算基礎設施是世界上最大的,這種規模意味著它可能擁有所需的容量,以證明開發和維護自己的AI加速硬件平臺的巨大成本是合理的。事實上,谷歌聲稱TPU使公司不必再建造12個數據中心來處理AI負載。

讓我們做一些敏感性分析,以了解單個ASIC周期所需的可能規模。為了便于討論,假設谷歌花費了1億美元,包括掩模生產,每個芯片將為他們節省大約1K美元。作為參考,一個45 TFLOPS的單個Cloud TPU芯片可能比NVIDIA Volta GPU在峰值120 TFLOPS時的性能略高1/3,所以需要3個TPU芯片來取代一個高端GPU。這意味著谷歌部署100K的TPU,大概可以實現收支平衡(不考慮資金的時間價值)。

這對大多數公司來說都是很大的籌碼,即使對谷歌來說也是如此。另一方面,如果開發芯片和TPU板只需要6000萬美元,每個芯片節省2K美元,那么他們只需要30K芯片就可以實現收支平衡。因此,大型數據中心可能需要30-100K的芯片,才能在2-3年的時間內實現收支平衡。

谷歌云計算的重要性

谷歌的高管們不能滿足于在全球云計算市場上落后于亞馬遜和微軟。在Diane Greene的領導下,他們在谷歌云上投入了大量資金,現在正在享受行業中最快的增長。谷歌可以利用谷歌云TPU的定價權和性能,以及TensorFlow的普及,在云計算機器學習發展中占據市場份額時發揮潛在顯著優勢。然而,谷歌表示,使用他們的云TPU的價格將與高端GPU的云訪問價格相當。谷歌并不打算直接出售TPU。

還有誰像谷歌?

坦率地說,雖然所有其它Super 7成員(亞馬遜、阿里巴巴、百度、Facebook、微軟和騰訊)都有能力建立自己的加速器,但沒有人能像百度那樣在這三個方面都表現得如此出色。此外,在實際接近的公司中,有幾家似乎正在朝著不同的方向發展:

百度最近公開表示,它正在與英偉達合作,在云、家庭和汽車領域開展AI計劃。這并不意味著百度有朝一日不能也不會制造自己的芯片,但就目前而言,該公司似乎滿足于專注于自己的軟件和服務。此外,百度的云業務仍然是其業務中相對較小的一部分。

微軟是第二大云服務提供商,擁有大量(5000名)穩定的AI工程師,并致力于通過其面向企業客戶的工具和API使AI“民主化”。然而,該公司已經決定(至少目前)在Azure和Bing基礎設施中使用英特爾的Altera FPGA,相信在快速變化的世界中,它可以從更靈活的硬件平臺中受益。此外,微軟使用NVIDIA的GPU來訓練其神經網絡。

亞馬遜可能是最接近上述谷歌模式的。AWS規模龐大,該公司正在大力投資AI。雖然亞馬遜可能傾向于使用Apache MXNet框架進行AI開發,但它的AWSAI云服務支持所有主要框架,使其成為AI開發領域的開放軟件。此外,以英偉達為基礎的Ying和以TPU為中心的Yang可能是一個有效的策略。亞馬遜以前也走過ASIC的道路;為了削減AWS基礎設施的成本和延遲,它在2012年收購了Ana Purna Labs。目前,該公司已經在以色列有了一個芯片團隊。最后,像百度一樣,亞馬遜似乎熱衷于使用FPGA,因為它們具有可編程的特性。

結論

筆者并不是在預測其它的Super 7公司都不會跳出GPU這條船,跳上自己的ASIC,但在筆者看來,很多公司都不太可能這么做——至少不會很快。

他們似乎都在用大量的數據開發機器學習模型,并忙于將這些模型應用于各種產品和服務中。構建ASIC和支持它的軟件是一個持續且昂貴的提議,可能會分散注意力。或者,將用于訓練的GPU的性能與用于推理的FPGA的靈活性和效率相結合,也有很大的希望。所以筆者個人并不認為GPU的天要塌下來了,至少在不久的將來不會。AMD當然相信對GPU有很大的需求,并將他們的Vega技術瞄準了這一點。

原文鏈接:

https://moorinsightsstrategy.com/will-asic-chips-become-the-next-big-thing-in-ai/

-

asic

+關注

關注

34文章

1202瀏覽量

120536 -

AI

+關注

關注

87文章

31000瀏覽量

269333

原文標題:ASIC芯片會成為AI的下一件大事嗎?

文章出處:【微信號:SSDFans,微信公眾號:SSDFans】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

英偉達組建ASIC團隊,挖掘臺灣設計服務人才

ASIC集成電路與通用芯片的比較

ASIC芯片會成為AI的下一件大事嗎

ASIC芯片會成為AI的下一件大事嗎

評論