本項目探討如何將機器學習(Machine learning)應用到物聯網(IoT,Internet of Things)中。我們將使用 Android Things 作為我們的物聯網平臺,并且采用 Google TensorFlow 作為我們的機器學習引擎。如今,機器學習與物聯網都是技術話題中的大熱門。

機器學習是計算機科學中的一個領域,它使計算機系統能夠利用數據進行 “學習”(即逐步提高特定任務的性能),而不需要進行顯式編程(Explicitly programmed)。

換句話說,在進行訓練步驟以后,系統就可以預測結果(即使這不是專門為這些結果進行編程的)。另一方面,我們都了解物聯網以及連接設備的概念。最有前途的話題之一便是如何將機器學習應用于物聯網之中,以構建能夠 “學習” 的專家系統。此外,該系統會運用這些知識來控制和管理實物。

下面列舉一些應用到機器學習,以及物聯網能產生重要價值的領域:

-

預測維護(Predictive maintenance)中的工業物聯網(IIoT,Industrial IoT)。

-

在消費者物聯網(Consumer IoT)中,機器學習可以使設備變得更加智能化,從而適應我們的習慣。

在本教程中,我們將探索如何使用 Android Things 和 TensorFlow 將機器學習應用到物聯網中。這一 Android Things 物聯網項目背后的基本思想就是,探索如何構建一個能夠識別一些基本形狀(比如箭頭)并被控制的機器人小車(Robot car)。我們已經介紹過如何使用 Android Things 構建機器人小車,我建議您在開始此項目之前先閱讀那篇教程。

本次機器學習和物聯網項目主要涵蓋以下主題:

-

如何使用 Docker 配置 TensorFlow 環境

-

如何訓練 TensorFlow 系統

-

如何集成 TensorFlow 與 Android Things

-

如何使用 TensorFlow 輸出結果來控制機器人小車

本項目衍生自 Android Things TensorFlow 圖像分類器。

我們開始吧!

如何在 Tensorflow 中創建一個圖像分類器

在開始之前,我們有必要先安裝并配置好 TensorFlow 環境。我并非機器學習專家,所以我需要找一些速成的東西并準備好使用,以便我們可以構建 TensorFlow 圖像分類器。因此,我們可以使用 Docker 來運行一個搭載了 TensorFlow 的映像。照著以下步驟進行:

1. 克隆 TensorFlow 倉庫:

gitclonehttps://github.com/tensorflow/tensorflow.git cd/tensorflow gitcheckoutv1.5.0

2. 創建一個目錄(/tf-data),該目錄將保存我們在項目中需要用到的所有文件。

3. 運行 Docker:

dockerrun-it\--volume/tf-data:/tf-data\--volume/tensorflow:/tensorflow\ --workdir/tensorflowtensorflow/tensorflow:1.5.0bash

使用這些命令,我們就可以運行一個交互式 TensorFlow 環境并增加(Mount)一些我們將在項目中使用到的目錄。

如何訓練 TensorFlow

在 Android Things 系統能夠識別圖像之前,我們有必要先訓練 TensorFlow 引擎,以構建其模型。以此為由,收集一些圖片是有必要的。如前所述,我們希望使用箭頭來控制 Android Things 機器人小車 —— 所以我們必須收集至少四種類型的箭頭:

-

向上箭頭

-

向下箭頭

-

左箭頭

-

右箭頭

為訓練該系統,我們有必要對這四種不同的圖像類別創建一個“知識庫”。在 /tf-data 中一個名為 images 的目錄下創建四個目錄,命名如下:

-

up-arrow

-

down-arrow

-

left-arrow

-

right-arrow

現在是時候去搜集圖像資源了。我使用的是 Google 圖片搜索,您也可以使用其他方法進行搜集。為了簡化圖片下載過程,您應該安裝 Chrome 插件,它能夠一鍵下載所有圖片。可別忘了,您下載的圖像越多,其訓練過程(Training process)越好(即使創建模型的時間可能會有所增加)。

打開瀏覽器,開始查找以下四類圖像:

每個類別我分別下載了 80 張圖。我并不關心圖片的擴展。

一旦所有類別都有其圖像,請按照以下步驟操作(在 Docker 界面中):

python/tensorflow/examples/image_retraining/retrain.py\ --bottleneck_dir=tf_files/bottlenecks\ --how_many_training_steps=4000\ --output_graph=/tf-data/retrained_graph.pb\ --output_labels=/tf-data/retrained_labels.txt\ --image_dir=/tf-data/images

這操作可能需要花費一些時間,所以要耐心等待。最后,在你的文件夾 /tf-data 中應有兩個文件:

-

retrained_graph.pb

-

retrained_labels.txt

第一個文件包含我們的模型,這是 TensorFlow 訓練過程的結果。而第二個文件則包含了與我們的四個圖像類別相關的標簽。

如何測試 Tensorflow 模型

如果你想測試模型,以檢查一切是否正常,你可以使用以下命令:

pythonscripts.label_image\ --graph=/tf-data/retrained-graph.pb\ --image=/tf-data/images/[category]/[image_name.jpg]

優化模型

在能夠使用這個 TensorFlow 模型到 Android Things 項目中之前,我們有必要優化它:

python/tensorflow/python/tools/optimize_for_inference.py\--input=/tf-data/retrained_graph.pb\--output=/tf-data/opt_graph.pb\--input_names="Mul"\--output_names="final_result"

這就是我們的模型。我們將使用此模型將機器學習應用于物聯網(即集成 Android Things 與 TensorFlow)。其目標是為 Android Things 應用提供智能識別箭頭圖像,并作出相應反應,從而控制機器人小車的方向。

如果您想了解更多關于 TensorFlow 的細節,以及如何生成模型,請查看官方文檔和這個教程。

如何使用 Android Things 和 TensorFlow 將機器學習應用到物聯網中

一旦 TensorFlow 數據模型準備就緒,我們就可以進入下一步:如何集成 Android Things 與 TensorFlow。為達成這一目的,我們可以將此任務分為兩步:

-

硬件部分,我們將電機和其他外圍設備(Peripheral)連接到 Android Things 板上

-

實現應用程序

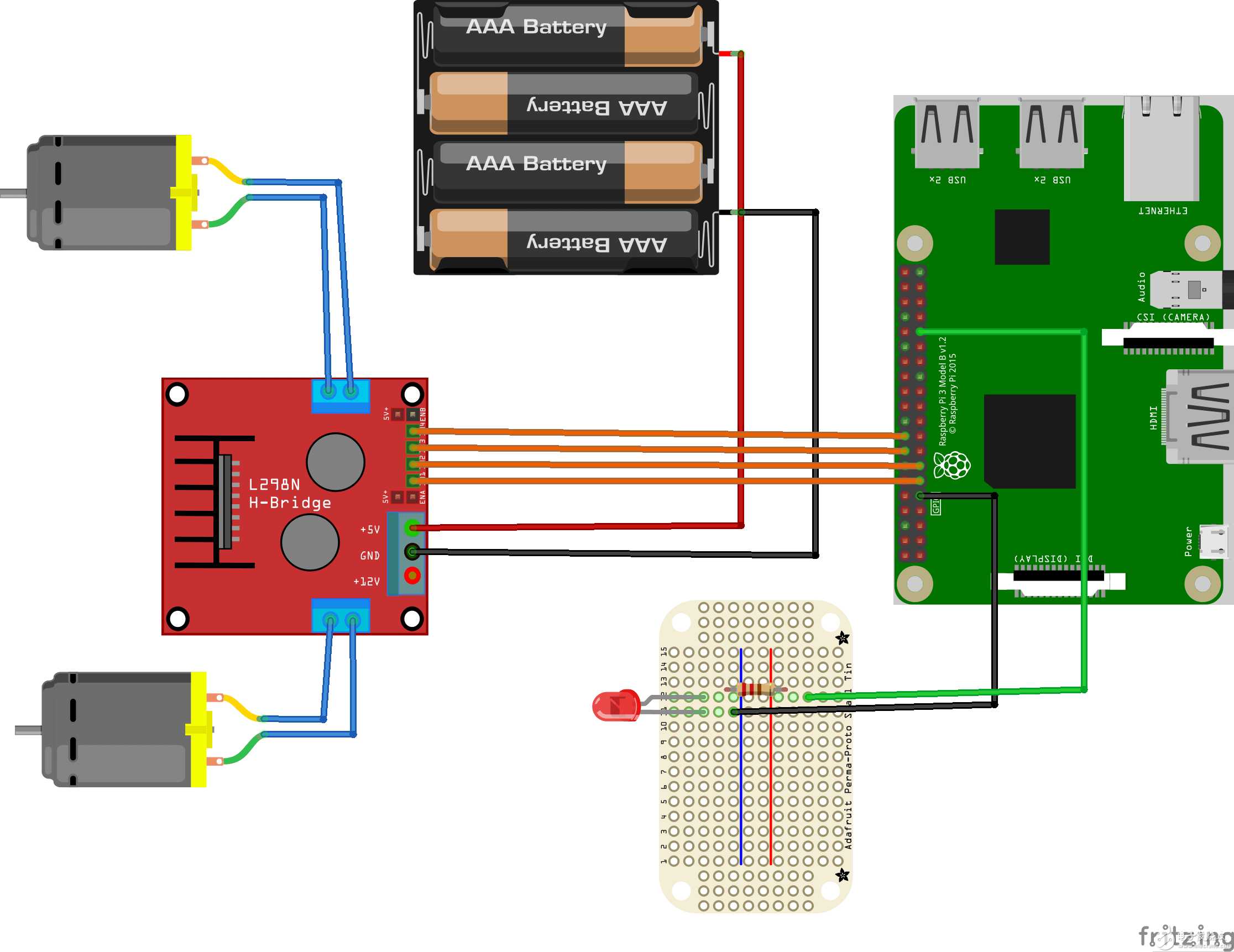

Android Things 原理圖

在深入探討如何連接外圍設備之前,我們先看看下面這個 Android Things 項目中使用的組件列表:

我不在此介紹如何使用 Android Things 控制電機,因為我們已經在之前的文章中介紹過這一點。

以下是原理圖:

上圖中,相機組件并未表現出來。其最終的結果如下:

基于 TensorFlow 實現 Android Things App

最后一步便是實現 Android Things 應用程序。為此,我們可以重用 GitHub 上名為 TensorFlow 圖像分類器示例的示例項目。在開始之前,先克隆 GitHub 倉庫,以便您可以修改源代碼。

該 Android Things 應用與原來的應用有所不同,在于:

-

它不使用按鈕來啟動相機捕捉圖像

-

它使用不同的模型

-

它使用一個閃爍的 LED 進行通知,攝像機在 LED 停止閃爍后拍攝照片

-

它在 TensorFlow 檢測到圖像(箭頭)時控制電機。此外,在從步驟 3 開始循環之前,先打開電機 5 秒

要處理閃爍的 LED,請使用以下代碼:

privateHandlerblinkingHandler=newHandler();privateRunnableblinkingLED=newRunnable(){

@Overridepublicvoidrun(){

try{

//Ifthemotorisrunningtheappdoesnotstartthecam

if(mc.getStatus())

return;

Log.d(TAG,"Blinking..");

mReadyLED.setValue(!mReadyLED.getValue());

if(currentValue<=?NUM_OF_TIMES)?{

???????currentValue++;

???????blinkingHandler.postDelayed(blinkingLED,?

???????????????????????BLINKING_INTERVAL_MS);

?????}

?????else?{

??????mReadyLED.setValue(false);

??????currentValue?=?0;

??????mBackgroundHandler.post(mBackgroundClickHandler);

?????}

???}?catch?(IOException?e)?{

?????e.printStackTrace();

???}

??}};

當 LED 停止閃爍時,應用程序將捕獲圖像。

現在有必要關注如何根據檢測到的圖像來控制電機。修改方法如下:

@OverridepublicvoidonImageAvailable(ImageReaderreader){

finalBitmapbitmap;

try(Imageimage=reader.acquireNextImage()){

bitmap=mImagePreprocessor.preprocessImage(image);

}

finalListresults=

mTensorFlowClassifier.doRecognize(bitmap);

Log.d(TAG,

"GotthefollowingresultsfromTensorflow:"+results);

//Checktheresult

if(results==null||results.size()==0){

Log.d(TAG,"Nocommand..");

blinkingHandler.post(blinkingLED);

return;

}

Classifier.Recognitionrec=results.get(0);

Floatconfidence=rec.getConfidence();

Log.d(TAG,"Confidence"+confidence.floatValue());

if(confidence.floatValue()

在這種方法中,當 TensorFlow 返回匹配捕獲圖像的可能標簽后,應用程序會將結果與可能的方向進行比較,從而控制電機。

最后,是時候使用在剛開始時創建的模型了。拷貝 assets 文件夾下的 opt_graph.pb 與 reatrained_labels.txt 文件,并替換現有文件。

打開 Helper.java 并修改以下幾行:

publicstaticfinalintIMAGE_SIZE=299;privatestaticfinalintIMAGE_MEAN=128;privatestaticfinalfloatIMAGE_STD=128;privatestaticfinalStringLABELS_FILE="retrained_labels.txt";publicstaticfinalStringMODEL_FILE="file:///android_asset/opt_graph.pb";publicstaticfinalStringINPUT_NAME="Mul";publicstaticfinalStringOUTPUT_OPERATION="output";publicstaticfinalStringOUTPUT_NAME="final_result";

運行應用程序,試試向相機展示箭頭,并檢查結果。機器人小車必須按照所示的箭頭進行移動。

小結

在本教程的最后,我們介紹了如何運用 Android Things 與 TensorFlow 將機器學習應用到物聯網中。我們可以使用圖像控制機器人小車,并根據顯示的圖像移動機器人小車。

-

機器學習

+關注

關注

66文章

8506瀏覽量

134728 -

IOT

+關注

關注

188文章

4308瀏覽量

202111 -

tensorflow

+關注

關注

13文章

330瀏覽量

61208 -

Android Things

+關注

關注

0文章

10瀏覽量

4235

發布評論請先 登錄

物聯網的應用范圍有哪些?

Nordic nRF54 系列芯片:開啟 AI 與物聯網新時代?

物聯網就業有哪些高薪崗位?

安科瑞EIOT能源物聯網平臺如何應用到連鎖門店中

評論