一般數(shù)據(jù)保護條例(GDPR)對數(shù)據(jù)科學產(chǎn)生了很大的影響。現(xiàn)在GDPR有99條正文條款和173篇聲明(Recital),長而復雜,但是隨著時間的推移以及條款的執(zhí)行,它可能會變得更加復雜。同時,由于GDPR的存在,律師和隱私工程師將成為未來大型數(shù)據(jù)科學項目的核心組成部分。

1.GDPR是否禁止機器學習?

總的來說,在GDPR生效后,ML不會在歐盟被禁止。

但是,從技術(shù)的角度來看,這個問題的答案是肯定的。GDPR作為法律條文,確實做出了對使用自動化決策的全面禁止的規(guī)定。當GDPR使用“自動化決策”這個術(shù)語時,該法規(guī)指的是任何模型都可以在沒有人直接參與決策的情況下做出決定。這可能包括數(shù)據(jù)主體的自動“概要分析”,例如將其分類為“潛在客戶”或“40-50歲男性”等特定組,以確定貸款申請人是否有資格獲得貸款。

因此,GDPR對ML模型的產(chǎn)生的影響是在沒有人直接參與決策制定的情況下,它們是否可以自動部署。如果可以自動部署,那么在大量的ML模型中這種自動部署的設(shè)置將會被默認禁止。盡管有許多律師或數(shù)據(jù)科學家確實反對過,但參與起草和解釋GDPR的歐盟官方工作組還是堅持該項規(guī)定。

當然,GDPR禁止ML也有例外情況。簡單來說,該法規(guī)確定了使用自主決策合法的三個領(lǐng)域:合同處理的必要性,其他法律另行授權(quán)的情況,或數(shù)據(jù)主體明確同意的情況。

但是,讓用戶同意并不容易,用戶可以同意許多不同類型的數(shù)據(jù)處理,并且他們也可以在任何時候撤銷同意,這意味著用戶同意需要細化和進一步的規(guī)范。

那么,GDPR是否真的禁止使用ML模型?當然不是,但在許多應用ML的例子中,它使得這些模型及其輸入數(shù)據(jù)的部署和管理變得越來越困難。

2. ML有沒有“解釋權(quán)”

作者去年寫了一篇專門討論這個問題的文章。潛在的解釋能力的存在可能會對數(shù)據(jù)科學產(chǎn)生巨大的影響,因為ML模型的預測能力很大程度上很難解釋,即使有可能,也很難解釋。

在GDPR的第13-15條中反復聲明,數(shù)據(jù)主體有權(quán)獲得“有關(guān)所涉邏輯的有意義的信息”以及自動決策的“重要性和設(shè)想的后果”。然后,在GDPR的第22條中規(guī)定,數(shù)據(jù)主體有權(quán)利不受上述影響類型的影響。最后,作為該條例中包含的一項非約束性評論的一部分,第71條聲明(Recital)表示,數(shù)據(jù)主體除了能夠?qū)@些決定提出質(zhì)疑之外,還有權(quán)對自動決策做出解釋。綜上所述,這三項規(guī)定在數(shù)據(jù)主體和處理數(shù)據(jù)的模型之間創(chuàng)建了許多新的復雜的義務,這表明了一種相當強大的可解釋性權(quán)利。

雖然理論上,歐盟監(jiān)管機構(gòu)可以以最嚴格的方式解釋這些條款,但是現(xiàn)實中要想實現(xiàn)充分合理解釋似乎是不可能的。歐盟監(jiān)管機構(gòu)甚至可以將這些條款解讀為,當ML被用于在沒有人為干預的情況下做出決定時,以及當這些決定對數(shù)據(jù)主體產(chǎn)生重大影響時,這些人有權(quán)獲得關(guān)于正在發(fā)生的事情的一些基本形式的信息。在GDPR中被稱為“有意義的信息”和“設(shè)想的后果”可能會在此背景下被讀出。歐盟監(jiān)管機構(gòu)可能會將注意力集中在一個數(shù)據(jù)主體上,該數(shù)據(jù)主體基于有關(guān)模型的信息和其部署的上下文的相關(guān)信息,對數(shù)據(jù)的使用做出明智的決定。

3. 數(shù)據(jù)主體是否有能力要求模型在沒有數(shù)據(jù)的情況下進行訓練?

作者認為在實踐中答案是否定的。在GDPR下,所有數(shù)據(jù)的使用都需要有法律依據(jù),《條例》第6條規(guī)定了六個相應的依據(jù)。最重要的兩個是“合法利益”的基礎(chǔ),以及用戶明確同意使用該數(shù)據(jù)的地方。當處理的法律基礎(chǔ)是后者時,數(shù)據(jù)主體將會保留對這些數(shù)據(jù)的極大控制權(quán),也就是說,他們可以在任何時候撤銷,而處理這些數(shù)據(jù)的法律依據(jù)將不再存在。

因此,如果一個組織從一個數(shù)據(jù)主體收集數(shù)據(jù),用戶同意將他們的數(shù)據(jù)用于訓練一個特定模型,然后數(shù)據(jù)主體隨后撤回該同意,那么用戶何時可以強制模型重新訓練新數(shù)據(jù)呢?

只有當該模型繼續(xù)使用該用戶的數(shù)據(jù)時,答案才會出現(xiàn)。正如GDPR的29條規(guī)定的那樣,即使撤銷同意后,撤回之前所發(fā)生的所有處理仍然合法。因此,如果這些數(shù)據(jù)被合法的用于創(chuàng)建模型或預測,那么這些數(shù)據(jù)所產(chǎn)生的任何東西都可能被保留下來。在實踐中,一旦用一組訓練數(shù)據(jù)創(chuàng)建了一個模型,訓練數(shù)據(jù)就可以在不影響模型的情況下被刪除或修改。

然而,從技術(shù)上講,一些研究表明,模型可能會保留關(guān)于訓練數(shù)據(jù)的信息,即使在訓練數(shù)據(jù)被刪除之后,這些信息仍然可能被發(fā)現(xiàn),正如研究人員Nicolas Papernot等人所寫的那樣。這意味著,在某些情況下,在不重新訓練模型的情況下刪除數(shù)據(jù)不能保證訓練數(shù)據(jù)不會被重新發(fā)現(xiàn),或者不能保證原始數(shù)據(jù)不會被繼續(xù)使用。

但是訓練數(shù)據(jù)通過模型被重新發(fā)現(xiàn)幾乎是不可能的。作者認為,這種重新發(fā)現(xiàn)只是在學術(shù)環(huán)境中進行的,與企業(yè)數(shù)據(jù)科學家的日常相差甚遠。盡管這在理論上是有可能的,但這似乎是一個邊緣案例,監(jiān)管者和數(shù)據(jù)科學家只有在這種特定類型的實例變得更加現(xiàn)實的情況下才能解決這個問題。

-

機器學習

+關(guān)注

關(guān)注

66文章

8423瀏覽量

132752

原文標題:GDPR到底是如何影響機器學習的?

文章出處:【微信號:Imgtec,微信公眾號:Imagination Tech】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

相關(guān)推薦

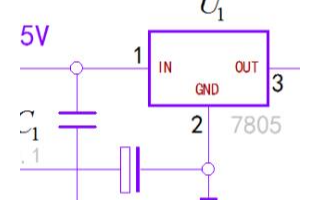

最常見的7805集成穩(wěn)壓電路,2個特殊的用法

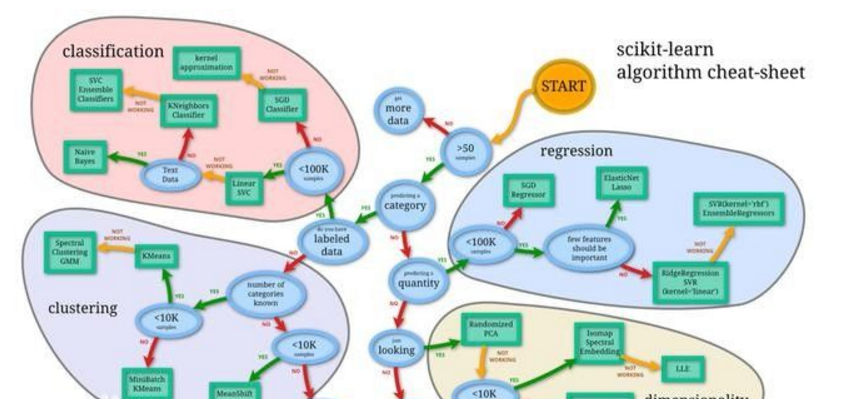

機器學習中最常見錯誤解決方案

三個方面解析電磁兼容的常見問題

如何避免三個常見的機器學習錯誤?

labview有哪些常見問題?labview三個常見問題和解決方法概述

深度學習中最常見的10個方法盤點

對象存儲適合AI和機器學習工作負載的三個原因

微軟推出了三個新的學習模塊

機器學習和深度學習的關(guān)鍵區(qū)別

使用霍爾效應傳感器進行設(shè)計的三個常見設(shè)計缺陷以及解決方案

Qt中的三個exec之間有什么聯(lián)系

機器視覺照明的三個核心

機器人標定技術(shù)的分類及三個步驟

GDPR與機器學習之間三個最常見的問題

GDPR與機器學習之間三個最常見的問題

評論