自動駕駛會影響人們的傳統駕駛倫理觀,而且還會創造出新的駕駛倫理觀念,因此對自動駕駛的倫理決策制定基本框架是具有前瞻性的。

設想,一個醉漢突然沖向馬路,因撞上了正在行駛的自動駕駛車輛而死亡。在現有的法律框架下,人們不會苛責任何一個正常的理性人,因為幾乎沒有可能避免這樣的意外事故。但是自動駕駛汽車,可能會改變人們對過錯的判斷標準,因為未來,這個標準將是合理機器人(reasonable robot)標準。此外,相較于人工駕駛,自動駕駛更具有“可責性”。

因為,自動駕駛車輛的決策基礎是事前的系統編程,所以可以理解為,對于交通事故的損害結果具有事前的“預謀”和“故意”。

《2018年全球自動駕駛法律政策研究報告》關于全球政策分析第六章《倫理:自動駕駛的阿喀琉斯之踵》中,針對相關政策給出了分析與答案,以下為具體內容:

探索自動駕駛的具體倫理規則

在自動駕駛汽車倫理問題上歷來存在巨大爭議。像“電車難題”這樣的倫理困境,人類尚且難以給出兩全之策,機器又該如何妥善處置呢?

有學者指出對電車難題的討論是沒有意義的。德國車輛制造商梅賽德斯更是直截了當地給出了自己的答案,即梅賽德斯將優先保護車上人員安全,同時指出電車難題不是一個真正的問題,因為該公司將“致力于提高和完善技術和風險防范策略,完全避免兩難情況的出現”。

美國交通部2016年將倫理問題作為自動駕駛汽車15項安全評估標準之后,2017年卻將其從中刪除,這一轉變表明倫理事項并非當前的核心問題。然而,德國則嘗試應對自動駕駛汽車帶來的倫理問題,并為自動駕駛汽車提出了20項倫理準則,但這些原則能否落實到技術層面也備受爭議。

2017年6月,德國聯邦交通部自動駕駛倫理委員提交了《自動駕駛汽車倫理報告》,該報告指出三項宏觀倫理要求:

其一,自動駕駛的首要目標是提升所有交通參與者的安全,在同等程度上降低所有交通參與者的風險;

其二,認為自動駕駛系統發生事故并不超出倫理界限;

其三,雖然自動駕駛技術能夠降低風險,提高道路安全,但如果以法律命令要求必須使用和普及這種技術,在倫理層面就是有問題的。

在微觀上,該報告從倫理困境,網聯安全和車輛數據保護,人機交互,新技術背景下其他領域的倫理問題,責任認定等角度提出了多項具體要求,主要包括以下三方面:

(1)明確優先選項并進行限制

諸如“電車難題”這樣的倫理困境,其核心在于不同利益具有各自合理性的同時又相互排斥,不論從功利主義還是義務論的角度解釋,侵犯任何一方的權益均難具說服力。例如,小孩和老人的生命,乘客和行人的生命,五個人和一個人的生命等等。因此,在討論倫理抉擇時,需要首先明確的是,所謂“優先選項”并非“否定選項”,因為倫理絕對不鼓勵損害任何一方的利益,且任何一方的利益都具有合理性和正當性,任何抉擇都將產生道德遺憾。

在具體規范中,明確和限制對優先選項的選擇主要體現在兩個方面,其一是對人的保護優先于所有其他利益考量,即在用盡所有技術防御仍無法避免的危險中,對人類生命的保護在法律上高于一切。也即,在技術可行性框架范圍內,為了避免人身傷害,接受對動物或財物的損害。

其二是禁止歧視,即在發生不可避免的危險時,嚴格禁止將個人特征(如年齡、性別、身體及精神狀況等)作為評判標準。禁止對受害者進行區別對待,禁止對被害人進行相互抵消,禁止認為根據主體數量決定“五個人的生命價值高于一個人的生命價值”。

(2)保留人對車輛的控制權并禁止事先編程

在以個人為中心、促進自由發展的同時,關于技術的立法策略應該是追求個人選擇權最大化。如果要求每個駕駛員都按照編程做出倫理決策,等于剝奪了駕駛員自主選擇的權利。德國自動駕駛倫理原則第1條指出,技術應遵循個人自治原則(the principle of personal autonomy),個人也應對自身享有的行動自由負責。與此類似,阿西洛馬人工智能原則的第16條也指出,人類應該來決定如何和是否讓人工智能系統去完成人類選擇的目標。而這一點,也是確保車上人員能夠長遠地享有車輛絕對控制權的重要途徑。

保留人對車輛的控制主權同時還體現在禁止程序開發人員對倫理抉擇進行事先編程。德國自動駕駛倫理原則指出,對于兩難局面,即必須在人的生命之間做出損害甚至犧牲一方以拯救其他當事方的選擇的極端情況,兩難決策(dilemmatic decisions)不能被標準化和編程化,具體決定應視具體情況而定。

(3)強調通過技術防范倫理困境

政策不該將機器人或者學習算法置于人類生命決定者的角色,而應積極探索其他解決思路。目前主要的思路,就是技術手段。通過技術防范倫理困境主要體現在三方面:

其一,自動駕駛技術應盡量避免事故的發生,對于兩難局面(dilemmatic conflict),應該事先就做出防范此類風險的策略。因此,從車輛的設計和編程開始,就應考慮以一種具備防御性和可預期的方式駕駛,并全面應用和完善技術,盡可能地降低可能給交通弱勢群體(vulnerable road users)造成的風險。

其二,公眾對于自動化技術的研發情況享有知情權,應該以盡可能透明的形式整理出自動駕駛車輛使用及編程準則,并告知公眾,同時由專業的獨立機構對其進行審查。

其三,制造商或運營商有義務在技術可行及合理的范圍內,對已交付的系統程序進行監督,并及時改進和更新系統,以確保和提高自動駕駛車輛防范倫理風險的能力。

自動駕駛技術未來發展繞不開人機倫理爭議

雖然當前各國紛紛認可自動駕駛技術的法律地位,但將來是否以法律命令要求必須使用和普及這項技術,現在還未達成共識。

2015年,伊隆·馬斯克在一次采訪中表示,汽車技術的進步有朝一日可能使人類操作的汽車成為非法。這引出了一個問題,未來誰將成為合法的司機,未來的法律政策在人機之間作何選擇。

雖然各國的自動駕駛汽車法律政策無論是針對測試還是商用都強調人類司機的絕對控制權,在自動駕駛模式下是如此,在輔助駕駛模式下更是如此。但如果將來自動駕駛技術的安全性可以達到非常高的安全水平,在所有的駕駛環境中都能夠作出比人類更優的決策和判斷,使得交通事故成為小概率事件,法律政策又該作何選擇?屆時,考慮到人類駕駛顯著的負外部性,允許人類駕駛將比允許自動駕駛更不道德?

當前來看,在人機切換的選擇下,將司機從駕駛活動中解脫出來,又希望其在必要時介入,是一個充滿悖論的選擇。業界對困擾人機切換的“離手”(hands-off)問題尚未找到有效的解決方法。無論是輔助駕駛還是自動駕駛,很多事故其實是在人機切換時司機反應不及時、注意力不集中而導致的。未來的汽車設計是否可以不用再考慮人類駕駛這一因素,這既有來自當前法律的障礙,也有來自于倫理的障礙。

德國等歐盟國家強調技術應遵循個人自治原則,不應限制個人行動自由。德國自動駕駛汽車倫理報告承認,具備防撞功能的高度自動化系統能降低風險、增強安全性,這是社會和倫理層面需要鼓勵的,但如果以法律命令要求必須使用和普及這種技術,則會引發“人受制于技術、人的主體地位受到貶損”等道德爭議。當然,無人駕駛汽車的設計選擇還面臨著來自司機群體的壓力和反抗。想必隨著技術的成熟和普及應用,自動駕駛取代人類駕駛、自動駕駛優先于人類駕駛等倫理道德爭議將熱烈起來。

無論如何,可以的肯定是,無人駕駛汽車的設計選擇將深刻影響汽車制造、保險等相關產業和人類世界。雖然我們無法準確預知未來,但卻可以選擇對自動駕駛汽車未來發展路徑保持開放,可以選擇不把人類駕駛員這一緊箍咒加諸其上,讓技術和市場決定誰來主宰未來交通。

-

無人駕駛

+關注

關注

98文章

4054瀏覽量

120451 -

自動駕駛

+關注

關注

784文章

13786瀏覽量

166400

原文標題:未來的自動駕駛能有“責任心”嗎?

文章出處:【微信號:IV_Technology,微信公眾號:智車科技】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

淺析基于自動駕駛的4D-bev標注技術

自動駕駛技術的典型應用 自動駕駛技術涉及到哪些技術

FPGA在自動駕駛領域有哪些優勢?

FPGA在自動駕駛領域有哪些應用?

自動駕駛識別技術有哪些

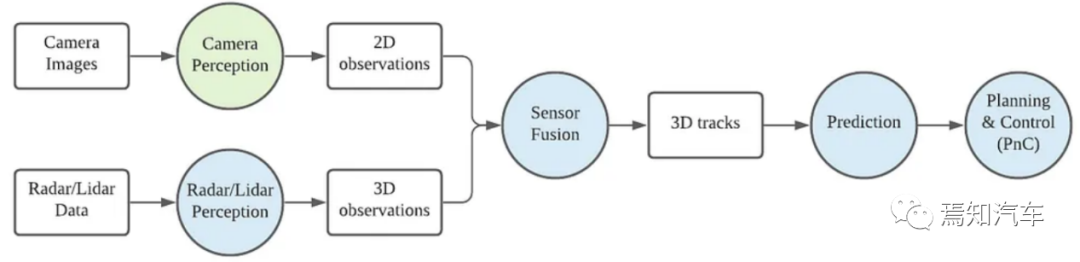

未來已來,多傳感器融合感知是自動駕駛破局的關鍵

自動駕駛發展問題及解決方案淺析

華為自動駕駛技術怎么樣?

自動駕駛感知算法提升處理策略

淺析自動駕駛的具體倫理規則

淺析自動駕駛的具體倫理規則

評論