英偉達(dá)推出基于風(fēng)格的生成器新結(jié)構(gòu),由此得到的升級(jí)版GAN圖像生成效果逼真到可怕!將面部細(xì)節(jié)分離出來,由模型進(jìn)行單獨(dú)調(diào)整,從而大幅度超越其他模型,GAN 2.0橫空出世?

GAN 2.0來了?!

我們知道GAN能夠生成逼真的圖片,但沒有想到字面意義上的“逼真”會(huì)如此快到來。

下面是一組完全由計(jì)算機(jī)生成的圖片,重復(fù)一遍:全部是計(jì)算機(jī)生成的圖片!

這組效果驚艷到可怕的成果,出自英偉達(dá)的研究人員最近提出的一種新的生成器架構(gòu),基于風(fēng)格遷移,將面部細(xì)節(jié)分離出來,由模型進(jìn)行單獨(dú)調(diào)整,從而大幅度超越傳統(tǒng)GAN等模型,生成的面部圖像結(jié)果簡(jiǎn)直逼真到可怕,可以說是GAN 2.0。

這種生成器架構(gòu)提取的圖像風(fēng)格,不是筆劃或顏色空間,而是圖像的組成(居中,向左或向右看等)和臉部的物理特征(膚色,雀斑,頭發(fā))。

該研究的論文已經(jīng)發(fā)表在Arxiv上:

https://arxiv.org/pdf/1812.04948.pdf

連Ian Goodfellow也服氣!

圖像逼真到可怕,能生成世界萬(wàn)物

有CV研究人員看過上圖效果以后表示,機(jī)器學(xué)習(xí)模型非常擅長(zhǎng)生成逼真的人臉,但這個(gè)新架構(gòu)生成的人臉圖像已經(jīng)真實(shí)到讓我再也不敢相信機(jī)器。

英偉達(dá)研究人員在論文中寫道,他們提出的新架構(gòu)可以完成自動(dòng)學(xué)習(xí),無(wú)監(jiān)督地分離高級(jí)屬性(例如在人臉上訓(xùn)練時(shí)的姿勢(shì)和身份)以及生成圖像中的隨機(jī)變化,并且可以對(duì)合成進(jìn)行更直觀且特定于比例的控制。

換句話說,這種新的GAN在生成和混合圖像,特別是人臉圖像時(shí),可以更好地感知圖像之間有意義的變化,并且在各種尺度上針對(duì)這些變化做出引導(dǎo)。

例如,研究人員使用的舊系統(tǒng)可能產(chǎn)生兩個(gè)“不同”的面部,這兩個(gè)面部其實(shí)大致相同,只是一個(gè)人的耳朵被抹去了,兩人的襯衫是不同的顏色。而這些并不是真正的面部特異性特征,不過系統(tǒng)并不知道這些是無(wú)需重點(diǎn)關(guān)注的變化,而當(dāng)成了兩個(gè)人來處理。

在上面的動(dòng)圖中,其實(shí)面部已經(jīng)完全變了,但“源”和“樣式”的明顯標(biāo)記顯然都得到了保留,例如最底下一排圖片的藍(lán)色襯衫。為什么會(huì)這樣?請(qǐng)注意,所有這些都是完全可變的,這里說的變量不僅僅是A + B = C,而且A和B的所有方面都可以存在/不存在,具體取決于設(shè)置的調(diào)整方式。

下面這些由計(jì)算機(jī)生成的圖像都不是真人。但如果我告訴你這些圖像是真人的照片,你可能也不會(huì)懷疑:

這個(gè)模型并不完美,但確實(shí)有效,而且不僅僅可用于人類,還能用于汽車、貓、風(fēng)景圖像的生成。

所有這些類型的圖像都或多或少可以單獨(dú)隔離出來,再現(xiàn)小型、中型和大型特征的相同范例。

基于風(fēng)格的生成器架構(gòu):生成圖像效果質(zhì)的飛躍

英偉達(dá)研究人員介紹,新的生成器在傳統(tǒng)的分布質(zhì)量指標(biāo)方面改進(jìn)了最先進(jìn)的技術(shù),使得插值特性明顯變好,并且更好地解決了變量隱因子問題。

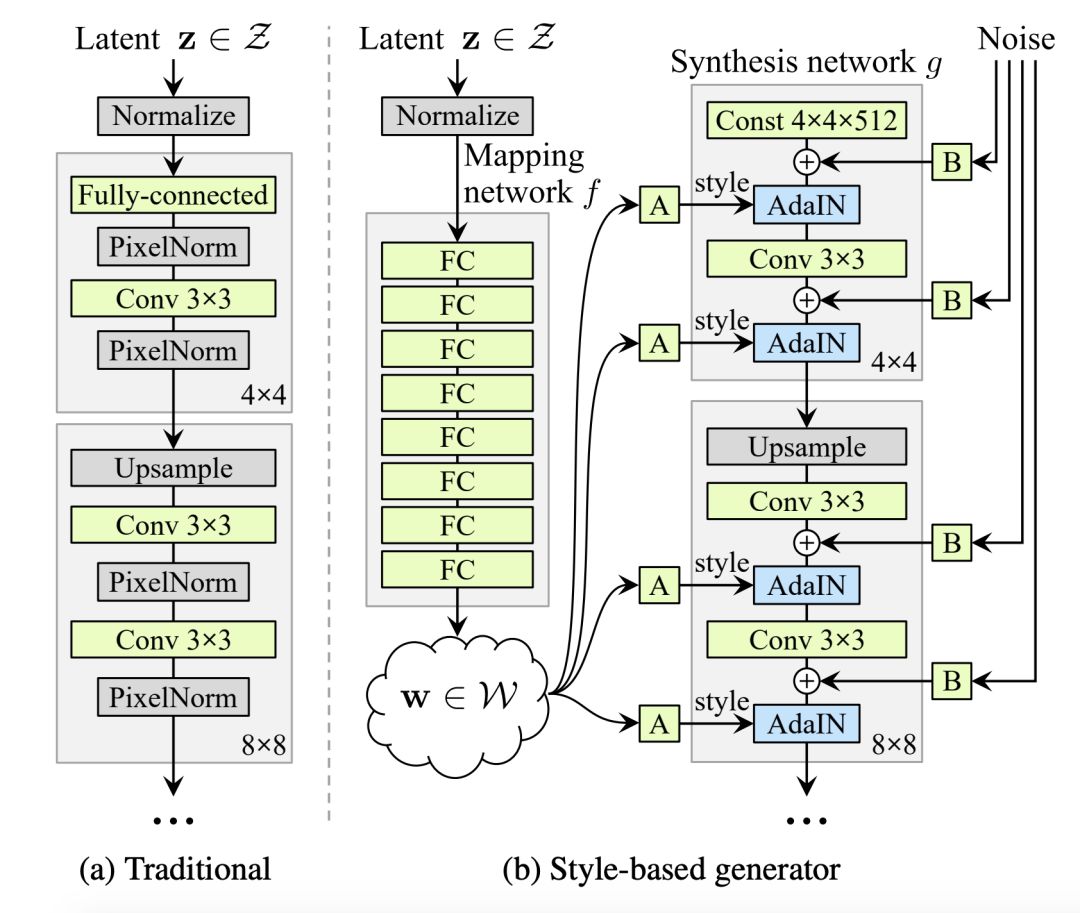

傳統(tǒng)生成器架構(gòu)和基于風(fēng)格的生成器架構(gòu)對(duì)比

傳統(tǒng)方式中,隱碼(latent code)是通過輸入層提供給生成器的,即前饋網(wǎng)絡(luò)的第一層(圖1a)。而英偉達(dá)團(tuán)隊(duì)完全省略了輸入層,從一個(gè)學(xué)習(xí)的常量(learned constant)開始,從而脫離了傳統(tǒng)的設(shè)計(jì)(圖1b,右)。在輸入隱空間Z中,給定一個(gè)隱碼z,一個(gè)非線性網(wǎng)絡(luò) f:Z→W首先生成w∈W(圖1b,左)。

英偉達(dá)團(tuán)隊(duì)的發(fā)生器架構(gòu)可以通過對(duì)樣式進(jìn)行特定尺度的修改來控制圖像合成。可以將映射網(wǎng)絡(luò)和仿射變換看作是一種從學(xué)習(xí)分布(learned distribution)中為每種樣式繪制樣本的方法,而將合成網(wǎng)絡(luò)看作是一種基于樣式集合生成新圖像的方法。修改樣式的特定子集可能只會(huì)影響圖像的某些方面。

樣式混合

英偉達(dá)團(tuán)隊(duì)采用混合正則化,其中給定比例的圖像是使用兩個(gè)隨機(jī)隱碼生成的,而不是一個(gè)在訓(xùn)練期間生成給定百分比的圖像。

在生成這樣的圖像時(shí),只需在合成網(wǎng)絡(luò)中隨機(jī)選擇的一個(gè)點(diǎn)上,從一個(gè)隱碼切換到另一個(gè)——稱之為樣式混合的操作。

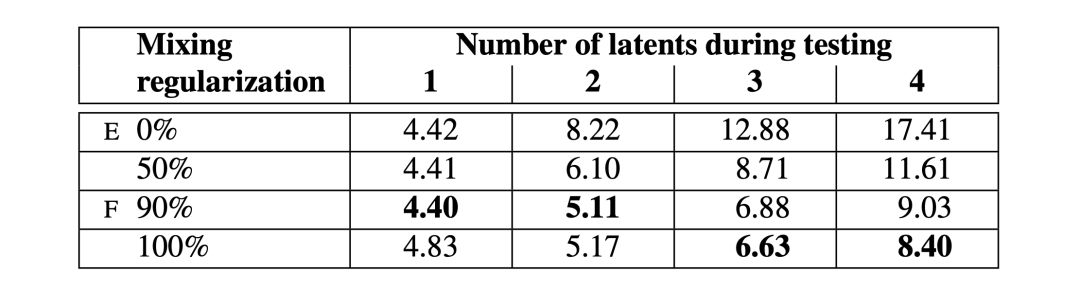

表2顯示了在訓(xùn)練過程中啟用混合正則化是如何產(chǎn)生顯著改進(jìn)的,在測(cè)試時(shí)混合了多個(gè)延遲的場(chǎng)景中,改進(jìn)的FID表明了這一點(diǎn)。

表2

圖3給出了在不同尺度上混合兩個(gè)潛碼合成圖像的例子。可以看到,樣式的每個(gè)子集控制圖像的高級(jí)屬性。

圖3

隨機(jī)變化

人類肖像中有許多方面可以被視為隨機(jī)的,例如毛發(fā),雀斑或皮膚毛孔的確切位置。只要它們遵循正確的分布,任何這些屬性都可以隨機(jī)化而不影響對(duì)圖像的感知。

圖4顯示了相同底層圖像的隨機(jī)實(shí)現(xiàn),這些圖像是使用具有不同噪聲實(shí)現(xiàn)的生成器生成的。

圖4

可以看到,噪聲只影響隨機(jī)屬性,使整體組成和身份等高級(jí)屬性保持不變。

圖5進(jìn)一步說明了將隨機(jī)變化應(yīng)用于不同子層的效果。

圖5

整體效應(yīng)與隨機(jī)性的分離

在基于樣式的生成器中,樣式會(huì)影響整個(gè)圖像,因?yàn)橥暾奶卣鲌D像會(huì)被縮放并帶有相同的值。

因此,可以相干地控制姿態(tài)、燈光或背景風(fēng)格等全局效果。同時(shí),噪聲被獨(dú)立地添加到每個(gè)像素上,因此非常適合于控制隨機(jī)變化。

如果網(wǎng)絡(luò)試圖控制例如使用噪聲的擺姿,這將導(dǎo)致空間不一致的決定,然后將受到鑒別器的“懲罰”。因此,網(wǎng)絡(luò)學(xué)會(huì)了在沒有明確指導(dǎo)的情況下,適當(dāng)?shù)厥褂萌趾捅镜赝ǖ?channel)。

兩種自動(dòng)化方法,任何生成器都能升級(jí)

為了量化插值質(zhì)量和分離,英偉達(dá)提出了兩種新的自動(dòng)化方法,適用于任何生成器體系架構(gòu)。

研究人員還發(fā)布了一個(gè)新的面部圖像數(shù)據(jù)集:數(shù)據(jù)收集自Flickr上的7萬(wàn)張面部圖像,數(shù)據(jù)已經(jīng)對(duì)齊和裁剪。研究人員使用亞馬遜Mechanical Turk來清除雕像、繪畫和其他異常圖像。

鑒于目前此類項(xiàng)目所使用的標(biāo)準(zhǔn)數(shù)據(jù)集主要是名人走紅毯的照片,本數(shù)據(jù)集應(yīng)該能夠提供變化更豐富的面部圖像組合。

這些數(shù)據(jù)集不久后即將開放下載。

GAN 2.0已經(jīng)如此,GAN 3.0將會(huì)如何?

使用基于風(fēng)格的生成器的GAN,在各個(gè)方面都優(yōu)于傳統(tǒng)的GAN,可以說是 GAN 2.0。

英偉達(dá)團(tuán)隊(duì)相信,對(duì)高階屬性與隨機(jī)效應(yīng)分離的研究,以及中間隱空間(intermediate latent space)的線性,將會(huì)對(duì)提高GAN合成的理解和可控性有很大的幫助。

可以注意到,平均路徑長(zhǎng)度度量可以很容易地用作訓(xùn)練中的正則化器,也許線性可分度量的某些變體也可以作為一個(gè)正則化器。

除了人像,GAN 2.0還可以生成房間、汽車等各種場(chǎng)景。有了這個(gè)利器,以后何愁圖像數(shù)據(jù)集?

看著這些計(jì)算機(jī)生成的“人”,是如此的真實(shí)但又虛擬。愛上一個(gè)不存在的人,似乎完全合情合理。

總的來說,在訓(xùn)練期間直接塑造中間隱空間(intermediate latent space)的方法將為未來的工作提供有趣的途徑。

所以,期待一下全新的判別器架構(gòu),屆時(shí)得到的GAN 3.0,會(huì)如何沖擊我們的視覺和認(rèn)知呢?

-

GaN

+關(guān)注

關(guān)注

19文章

1944瀏覽量

73653 -

英偉達(dá)

+關(guān)注

關(guān)注

22文章

3783瀏覽量

91250

原文標(biāo)題:GAN 2.0!英偉達(dá)“風(fēng)格遷移”面部生成器,世間萬(wàn)物逼真呈現(xiàn)

文章出處:【微信號(hào):AI_era,微信公眾號(hào):新智元】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

使用C2000?嵌入式模式生成器(EPG)進(jìn)行設(shè)計(jì)

Freepik攜手Magnific AI推出AI圖像生成器

TSMaster 測(cè)試報(bào)告生成器操作指南

飛凌嵌入式ElfBoard ELF 1板卡-在線二維碼生成器

深度學(xué)習(xí)生成對(duì)抗網(wǎng)絡(luò)(GAN)全解析

英偉達(dá)將推出生成式AI專業(yè)認(rèn)證

火了這么久的大模型,到底能為模組產(chǎn)業(yè)帶來什么?

針對(duì)高速光模塊應(yīng)用,小華半導(dǎo)體推出HC32F472系列模擬豐富MCU新品

Sora出世 服務(wù)器產(chǎn)業(yè)鏈?zhǔn)芤鏄O大!

賈揚(yáng)清質(zhì)疑Groq CEO“其芯片價(jià)格接近免費(fèi)” 前員工:不切實(shí)際!

英偉達(dá)市值躍居全球第四 文生視頻大模型Sora帶動(dòng)

MicroClock可編程 時(shí)鐘生成器5X1503數(shù)據(jù)手冊(cè)

英偉達(dá)推出基于風(fēng)格的生成器新結(jié)構(gòu),GAN 2.0橫空出世

英偉達(dá)推出基于風(fēng)格的生成器新結(jié)構(gòu),GAN 2.0橫空出世

評(píng)論