本文主要介紹了 Face++DetectionTeam 在 2018 年做 COCO skeleton 的工作。

Background

人體關鍵點檢測(Human Keypoint Detection)又稱為人體姿態識別,旨在準確定位圖像之中人體關節點的位置,是人體動作識別、人體行為分析、人機交互的前置任務。作為當前計算機視覺不可或缺的熱門研究領域之一,人體姿態識別有著大量的落地場景和廣闊的應用前景,現有及可期的場景應用有人體步態識別、體感游戲、AI 美體、虛擬現實、增強現實、康復訓練、體育教學等等,可廣泛賦能于游戲、手機、醫療、教育、數字現實等不同領域。

人體關鍵點檢測任務對于現實生活有著很大的潛在用途,目前公開的比賽中最權威的是 MS COCO Keypoint track 的比賽,也是該領域最有挑戰的比賽,參賽隊不乏 Facebook,Google 及微軟這樣的國際巨頭,也不乏 CMU 等頂尖研究機構,是該領域最先進方法的試金石。曠視科技 Detection 組在2017,2018 年兩次奪得該比賽的冠軍,2017 年曠視 COCO Keypoint 比賽冠軍工作 CPN 在業界具有深遠影響,并獲得廣泛使用。這里,我們將介紹曠視 2018 年 COCO Keypoint 比賽奪冠的工作。

人體姿態識別主流方法目前分為兩種:單階段和多階段,雖然后者遵照從粗糙到精細的邏輯更貼合任務本質,但是目前表現似乎沒有優于單階段方法,我們認為,目前多階段方法差強人意的性能主要歸因于多種不合理的設計。我們的工作從 1)網絡設計、2)特征流、3)損失函數入手提出一系列改進措施,工作成果在 MS COCO Keypoint 數據集上超越現有方法取得當前最優結果,論文已公開于 Arxiv,鏈接請見:arxiv.org/abs/1901.0014

Introduction

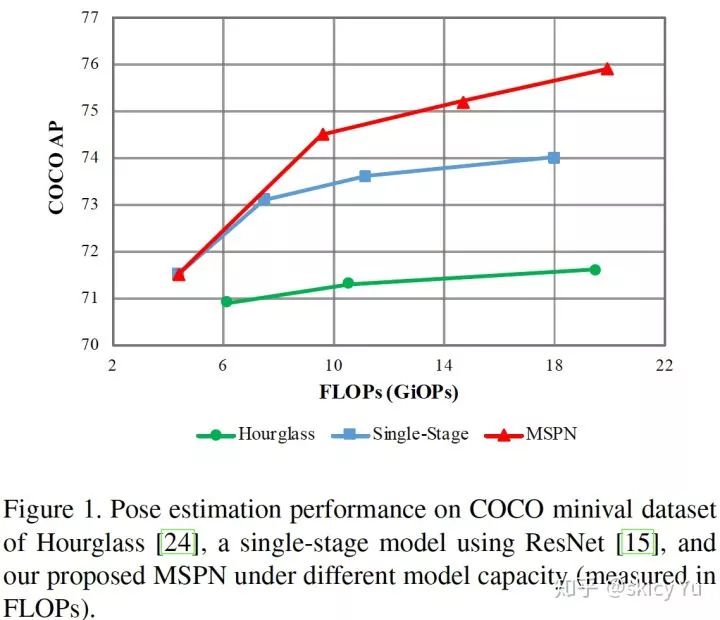

圖1

深度卷積網絡出現之后,人體姿態識別飛速發展。現階段最優方法[1,2]網絡結構較為簡單,多是采用單階段網絡設計,比如 2017 COCO Keypoint 挑戰賽冠軍方法[1]采用基于 ResNet-Inception 的網絡結構,最新的 Simple Baseline[2] 采用 ResNet 網絡結構。另一種網絡結構則采用多階段網絡設計,即把一個輕量級網絡作為單元網絡,接著將其簡單地堆疊到多階段。

直觀上講,多階段的天然逐級優化特性會更適用于這個任務,但是當前存在的多階段網絡并沒有單階段網絡在 COCO 上表現好。我們試圖研究這一挑戰性問題,提出當前多階段網絡的欠佳表現主要是由于設計不足導致的,并可通過一系列 1)網絡結構、2)特征流、3)損失函數方面的創新性優化,最大化發掘多階段網絡的潛力,實現目前最先進的效果。

因此,我們提出新型的多階段姿態估計網絡 MSPN,具體改進有 3 個方面:

目前多階段網絡里的單元網絡離最優比較遠,使用已經驗證的網絡(如 Resnet)要比主流的多階段方法(如 Hourglass)采用的輕量級網絡好很多,究其原因主要是下采樣 Encoder 需要承載更多內容,而輕量級網絡滿足不了。

由于重復下采樣,上采樣會丟失信息從而不利于學習,我們提出融合多階段特征以加強信息流動,來緩解這一問題。

我們觀察到關節點的定位是逐級精細優化的,因此提出由粗到精的學習策略,并采用多尺度監督提升訓練。由圖 1 可知,當提升單階段網絡容量時,精度會趨近于飽和,而增長遇到瓶頸;對于目前主流的多階段網絡,當堆疊多于 2 個單元網絡后,精度提升非常有限。對于我們提出的 MSPN,隨著單元網絡的堆疊數增加,精度會持續提升。

在 MS COCO 基準上,MSPN 在 test-dev 數據集上獲得 76.1 AP;在 MS COCO 2018 中,test-dev 達到 78.1 AP,test-challenge 76.4 AP, 相比去年冠軍提升了 4.3 AP。

--------多階段網絡---------

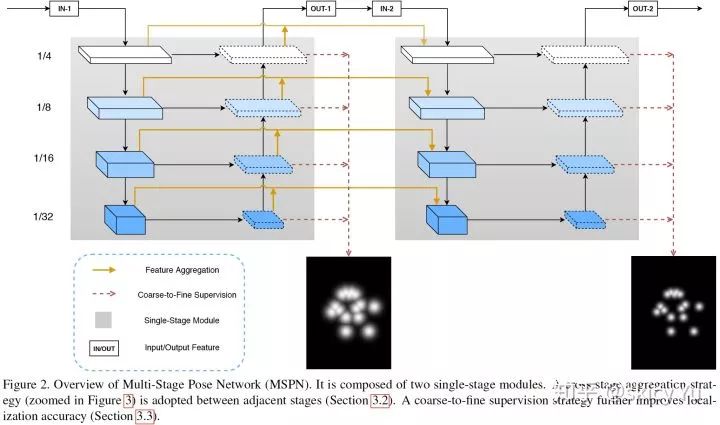

圖2

多階段姿態估計網絡 MSPN 如圖 2 所示。它采用自上向下的框架,即首先使用人體檢測算法給出人體框,據此摳圖,并進行單人人體姿態估計。如上所述,MSPN 的新突破有 3 點:第一,使用圖像分類表現較好的網絡(如 ResNet)作為多階段網絡的單元網絡;第二,提出逐階段傳遞的信息聚集方式,降低信息損失;第三,引入由粗到精的監督,并進行多尺度監督。

------有效的單階段子單元網絡設計-----

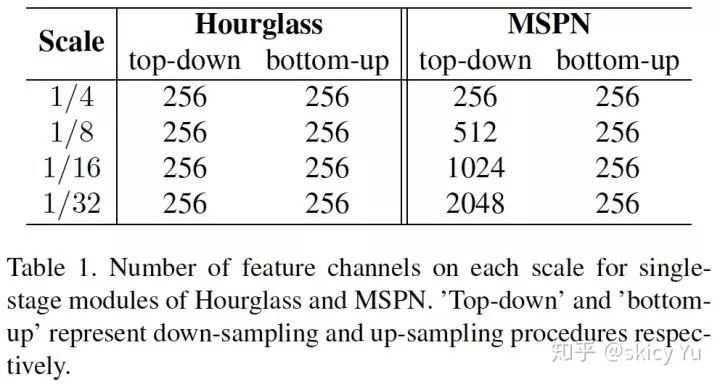

表1

目前主流的多階段網絡全部基于 Hourglass 變體。從表 1 可知,Hourglass 在重復下采樣和上采樣的過程中,卷積層的通道數是相同的。這是因為高層語義信息更強,需要更多通道表征。

下采樣時,Hourglass 變體會導致特征編碼(Encoder)無法很好地表達特征,從而造成一定程度上的特征信息丟失。相比于下采樣,上采樣很難更優地表征特征,所以增加下采樣階段的網絡能力對整體網絡會更有效。

--------------跨階段特征融合-------------

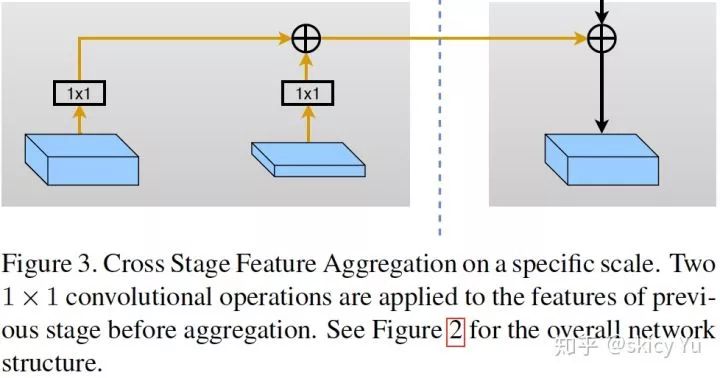

圖3

多階段網絡在重復的上采樣和下采樣過程中,很容易造成信息流失,我們提出了一種有效的跨階段特征融合方法來應對這一現象。如圖 3 所示,上一階段上、下采樣的特征經過 1x1 卷積相加到后一階段下采樣部分,從而實現多階段之間的特征融合,有效緩解特征流失。

---------------由粗到精監督--------------

圖4

人體姿態估計如果要定位較有挑戰性的關節點(如隱藏關節點)需要較強的領域上下文信息。同時,對于基于回歸 heatmap 的任務,作為 GT 的高斯核越小,回歸精度越準。考慮到以上兩點,并結合多階段網絡的自身逐級遞進優化的特性,我們提出基于多階段的由粗到精的監督方式。每個階段方式的監督heatmap的高斯核逐漸減小,可較理想地兼顧領域上下文信息和精準度。由于中間監督對于深度神經網絡有較好效果[3],我們在每個階段內部也采用了多尺度的中間監督。

-------------實驗-------------

實驗中,我們使用 MegDet [4]獲得人體檢測框,并使用 COCO(80 類)之中人這一類的結果作為人體框結果,沒有單獨針對人進行訓練。摳圖之前,框擴展為高寬 4:3 的比例。訓練中,我們采用 Adam 作為優化策略,初始學習率為 5e-4,Weight Decay 為 1e-5。數據增強方面,主要采用翻轉、旋轉(-45度~+45度)、尺度變換(0.7~1.35)。姿態估計網絡圖像輸入尺寸為 384x288。消融實驗中,圖像輸入尺寸為 256x192。測試方面,沿用 [5] 中的策略,即采用翻轉求平均,最大值位置向次大值位置偏移 1/4 作為最終位置。所有消融實驗在 COCO minival 上進行。

消融實驗

多階段網絡

我們通過一系列實驗驗證多階段網絡設計的重要性。

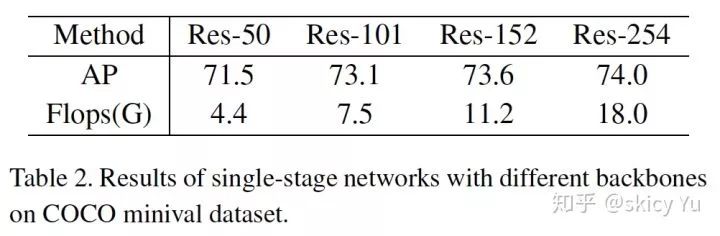

表2

首先,我們通過實驗觀察單階段網絡增加模型復雜度的表現。從表 2 可知,ResNet-50 作為 Backbone 的單階段網絡精度可以達到 71.5,ResNet-101 可以提升 1.6 個點,但是繼續往高增加復雜度,精度的提升幅度逐漸變小,趨近于飽和。

表3

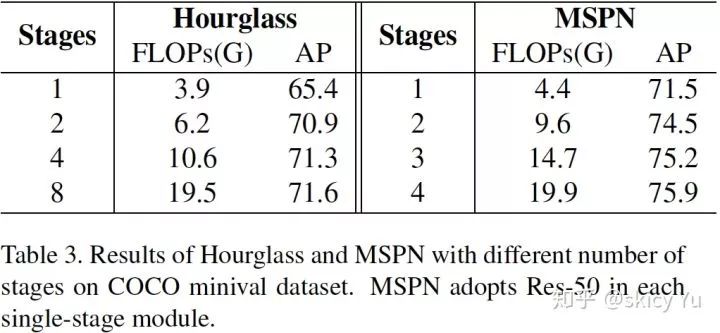

我們同時對比了當前主流的多階段網絡 Hourglass 與該工作在精度提升方面的差異。由表 3 可知,Hourglass 在第 2 個階段以上疊加新階段提升非常有限:從 2 個階段到 8 個階段,計算量增加 3 倍,而精度只漲了 0.7 AP。相比于 Hourglass 的增長受限,MSPN 從第 2 個階段以上疊加新階段會持續提升精度。

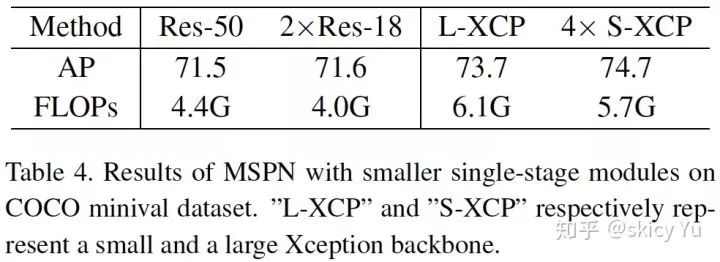

為驗證我們對多階段網絡有效改進的泛化性,我們嘗試把其他網絡作為單元網絡。如表 4,兩階段的 ResNet-18 會稍高于相當計算量的單階段 ResNet-50 網絡。4 階段小計算量的 X-ception 網絡會比同計算量單階段的大計算量的 X-ception 網絡高出近 1 AP。

表4

跨階段特征融合以及由粗到精監督

表5

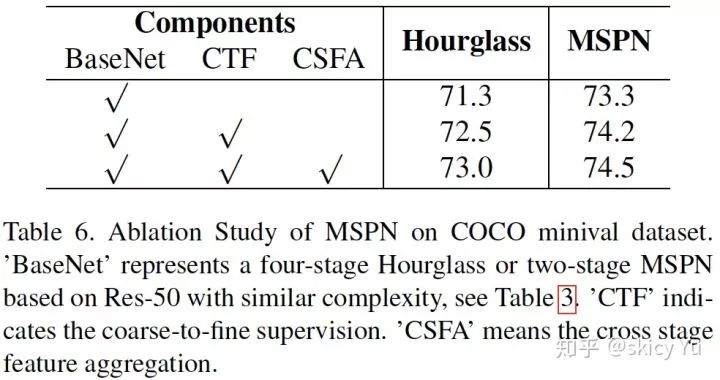

表 5 的實驗可以驗證跨階段特征融合以及由粗到精監督的有效性。對于 4 階段的 Hourglass 和 2 階段的 MSPN 借助以上兩種策略均實現漲點。

------------實驗結果-------------

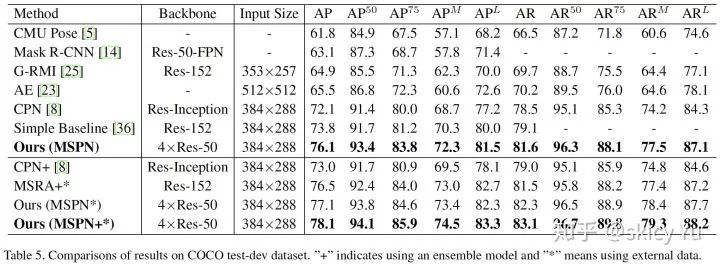

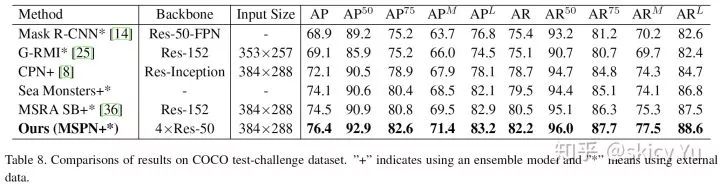

表6

表7

表 6 和表 7 分別對比 MSPN 與當前最優方法在 COCO test-dev 數據集和 COCO test-challenge 數據集上的精度差異。可以看出,MSPN 均超過當前最優方法,在 test-dev 上領先2.3 AP,在 test-challenge上領先 1.9 AP。

----------------總結---------------

我們提出了針對人體姿態估計更有效的多階段網絡設計思想,并用充分的實驗驗證其有效性,該網絡在 COCO 數據集上突破當前的精度瓶頸,實現了新的 state-of-the-art。我們同時也驗證了該工作所涉及的多階段網絡設計思想的泛化性。

--------------結果例圖-----------

圖5

-

人機交互

+關注

關注

12文章

1206瀏覽量

55382 -

網絡

+關注

關注

14文章

7553瀏覽量

88732 -

數據集

+關注

關注

4文章

1208瀏覽量

24689

原文標題:COCO 2018 Keypoint冠軍算法解讀

文章出處:【微信號:rgznai100,微信公眾號:rgznai100】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

發布一個基于face++的人臉識別程序

Face ID也是無法工作

Face ID也是無法工作。

opencv和face++如何進行人臉檢測嗎?

2016高交會思必馳攜手曠視Face++展現人工智能技術力量

人臉識別技術大總結1—Face Detection Alignment

team+提出2018年企業實時通訊4大市場趨勢

哪些公司入股曠視科技Face++

曠視科技face++股東名單_曠視科技face++歷史幾輪融資情況

Megvii Face++面部識別技術介紹

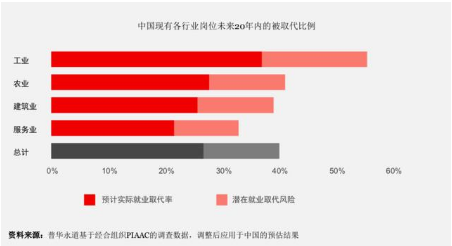

人工智能及相關技術在未來20年 或將取代中國現有約26%的工作崗位

萬物智聯時代——2018年AIOT產業藍皮書正式發布

艾邁斯半導體與Face++攜手打造領先的3D技術

低亮度人臉檢測、附源碼——CVPR2021之 Low Light Face Detection【一文讀懂】

Face++ Detection Team在2018年做COCO skeleton的工作

Face++ Detection Team在2018年做COCO skeleton的工作

評論