OpenAI擔(dān)心其N(xiāo)LP模型“過(guò)于強(qiáng)大”或遭濫用而不公開(kāi)代碼及模型的做法似乎引發(fā)眾怒。今天外網(wǎng)AI圈幾乎全是對(duì)OpenAI的批評(píng)及嘲諷,盡管微弱的支援聲夾雜其中。“公開(kāi)代碼”再次成為焦點(diǎn),這次你站在哪一邊?

OpenAI火了,雖然并非以他們希望的方式。

昨天,OpenAI在官博宣布,他們構(gòu)建了一個(gè)強(qiáng)大的NLP模型,但正因?yàn)檫@個(gè)模型過(guò)于強(qiáng)大,能夠生成以假亂真的句子,為了避免其遭到濫用,他們決定不公開(kāi)模型的具體結(jié)構(gòu)和代碼 (而僅發(fā)布了一個(gè)小很多的樣例)。

“大型的通用語(yǔ)言模型可能會(huì)產(chǎn)生重大的社會(huì)影響,”O(jiān)penAI的官博這樣寫(xiě)道,他們的這個(gè)模型現(xiàn)在公布出來(lái),“可能被用于生成假新聞、在線假裝某人的身份、在社交媒體上發(fā)布虛假內(nèi)容或故意誤導(dǎo)言論,以及自動(dòng)生成垃圾郵件/網(wǎng)絡(luò)釣魚(yú)內(nèi)容”。

OpenAI還援引了DeepFake,這是計(jì)算機(jī)視覺(jué)界一個(gè)臭名昭著的例子,DeepFake由于其強(qiáng)大的圖像生成能力,成了一個(gè)“假臉生成器/換臉器”,制造出大量惡意的虛假視頻、音頻和圖像而被禁用。

OpenAI還在博客中寫(xiě)了對(duì)相關(guān)政策的討論,包括確保AI研究安全可靠,符合倫理道德標(biāo)準(zhǔn)。但沒(méi)想到的是,良苦的用心,卻遭到網(wǎng)友幾乎一邊倒的批評(píng)和譏諷。

OpenAI干脆改名“CloseAI”算了!

我也做了個(gè)超強(qiáng)大的MNIST模型,要不要擔(dān)心它被濫用而不公開(kāi)呢?

更有甚者,比如下面這位Ben Recht,還發(fā)了一條Twitter長(zhǎng)文進(jìn)行嘲諷:

今天我要介紹我們的論文“Do ImageNet Classifiers Generalize to ImageNet?”我們嘗試按照原論文描述復(fù)現(xiàn)其結(jié)果,但發(fā)現(xiàn)這樣做實(shí)在太難!

……我們完全可以基于一個(gè)不能公開(kāi)的數(shù)據(jù)集構(gòu)建一個(gè)超大模型,在我們自己的標(biāo)準(zhǔn)ML范式中很難發(fā)生過(guò)擬合。

但是,測(cè)試集上的一個(gè)微小改動(dòng)就會(huì)導(dǎo)致分布結(jié)果大幅變化,你可以想見(jiàn)把模型和代碼全都公布出來(lái)以后會(huì)發(fā)生什么!

PS 這篇論文還在arxiv等候?qū)徍税l(fā)布,要不是我們的最終版PDF過(guò)大,那就是因?yàn)閍rxiv也學(xué)著OpenAI的做法,覺(jué)得AI/ML研究太過(guò)危險(xiǎn)而不能公開(kāi)。

OpenAI:新NLP模型很強(qiáng)大,公布后可能遭濫用

從研究的角度來(lái)看,OpenAI昨天宣布的“強(qiáng)大”NLP模型GPT-2,技術(shù)突破性體現(xiàn)在兩個(gè)方面。首先,是模型的容量空前巨大。

根據(jù)OpenAI的研究主管Dario Amodei介紹,GPT-2的參數(shù)有15億,是上一個(gè)版本GPT大小的12倍,訓(xùn)練數(shù)據(jù)集則擴(kuò)大了15倍。

GPT-2在一個(gè)包含約1000萬(wàn)篇文章的數(shù)據(jù)集上進(jìn)行訓(xùn)練,而這些文章來(lái)源是從Reddit上點(diǎn)贊超過(guò)三票的鏈接里爬出來(lái)的,大小是40GB,相當(dāng)于3.5萬(wàn)本《白鯨記》(Moby Dick)。

實(shí)際上,GPT2就是一個(gè)自動(dòng)文本生成器,但鑒于其訓(xùn)練數(shù)據(jù)量直接影響模型的性能,也使GPT2成為一個(gè)更加通用的語(yǔ)言生成模型,這也正是其第二個(gè)突破所在:相比以往的文本模型,GPT2能完成更多的任務(wù),包括機(jī)器翻譯、文本總結(jié),以及閱讀理解,而且有的時(shí)候,其性能還超過(guò)了專門(mén)為某種任務(wù)——比如閱讀理解——構(gòu)建的模型。

也正因如此,致使OpenAI違背其名稱中宣揚(yáng)的“Open”理念,不公開(kāi)這個(gè)模型。“如果你無(wú)法預(yù)測(cè)模型能夠做什么,你就不得不去做各種實(shí)驗(yàn),但這個(gè)世界上有太多太多比我們更聰明更厲害,更善于拿這個(gè)模型去做壞事的人存在。”

OpenAI宣傳主管Jack Clark在接受《衛(wèi)報(bào)》采訪時(shí)表示:“我們并不是說(shuō)我們知道什么該做,我們也并不是在通過(guò)這種方法在表明這樣做就是對(duì)的,我們還在探討更嚴(yán)謹(jǐn)和謹(jǐn)慎的做法。我們算是摸著石頭過(guò)河。”

OpenAI給出了其模型強(qiáng)大的例子,可以參見(jiàn)昨天新智元的報(bào)道。

網(wǎng)友觀點(diǎn):不公開(kāi)代碼和訓(xùn)練集就干脆別發(fā)表!

至于持反對(duì)觀點(diǎn)的網(wǎng)友這邊,很多人恰恰是因?yàn)榱私饽P驮谟?xùn)練集和測(cè)試集上表現(xiàn)的區(qū)別,才紛紛反對(duì)OpenAI不公開(kāi)全部代碼和數(shù)據(jù)集的做法。

其次,OpenAI“擔(dān)心AI研究太危險(xiǎn)而不公開(kāi)”的理由,也成了眾矢之的。比如Denny Britz在Twitter上發(fā)文稱:

是不是又該舊話重提,“AI能自己生成語(yǔ)言,所以不能再研究AI了!”

去年,加拿大蒙特利爾大學(xué)的計(jì)算機(jī)科學(xué)家們希望展示一種新的語(yǔ)音識(shí)別算法,他們希望將其與一名著名科學(xué)家的算法進(jìn)行比較。唯一的問(wèn)題:該benchmark的源代碼沒(méi)有發(fā)布。研究人員不得不從已公開(kāi)發(fā)表的描述中重現(xiàn)這一算法。但是他們重現(xiàn)的版本無(wú)法與benchmark聲稱的性能相符。蒙特利爾大學(xué)實(shí)驗(yàn)室博士生Nan Rosemary Ke說(shuō):“我們嘗試了2個(gè)月,但都無(wú)法接近基準(zhǔn)的性能。”

人工智能(AI)這個(gè)蓬勃發(fā)展的領(lǐng)域正面臨著實(shí)驗(yàn)重現(xiàn)的危機(jī),就像實(shí)驗(yàn)重現(xiàn)問(wèn)題過(guò)去十年來(lái)一直困擾著心理學(xué)、醫(yī)學(xué)以及其他領(lǐng)域一樣。AI研究者發(fā)現(xiàn)他們很難重現(xiàn)許多關(guān)鍵的結(jié)果,這導(dǎo)致了對(duì)研究方法和出版協(xié)議的新認(rèn)識(shí)。法國(guó)國(guó)家信息與自動(dòng)化研究所的計(jì)算神經(jīng)科學(xué)家Nicolas Rougier說(shuō):“這個(gè)領(lǐng)域以外的人可能會(huì)認(rèn)為,因?yàn)槲覀冇写a,所以重現(xiàn)性是有保證的。但完全不是這樣。”

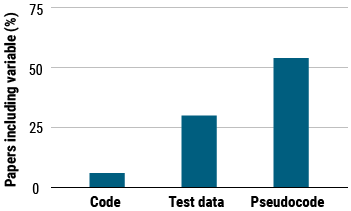

AAAI 2018會(huì)議上,reproducibility問(wèn)題被提上議程,一些團(tuán)隊(duì)對(duì)這個(gè)問(wèn)題進(jìn)行了分析。挪威科技大學(xué)計(jì)算機(jī)科學(xué)家Odd Erik Gundersen報(bào)告了一項(xiàng)調(diào)查的結(jié)果,調(diào)查針對(duì)過(guò)去幾年在兩個(gè)AI頂會(huì)上發(fā)表的論文中提出的400種算法,結(jié)果只有6%的研究者分享了算法的代碼,只有三分之一的人分享了他們測(cè)試算法的數(shù)據(jù),而只有一半分享了“偽代碼”。

針對(duì)主要會(huì)議上發(fā)表的400篇AI論文的調(diào)查顯示,只有6%的論文包含算法的代碼,約30%包含測(cè)試數(shù)據(jù),54%包含偽代碼。

CREDITS: (GRAPHIC) E. HAND/SCIENCE; (DATA) GUNDERSEN AND KJENSMO, ASSOCIATION FOR THE ADVANCEMENT OF ARTIFICIAL INTELLIGENCE 2018

研究人員說(shuō),這些缺失的細(xì)節(jié)的原因有很多:代碼可能是一項(xiàng)正在進(jìn)行中的工作,所有權(quán)歸某一家公司,或被一名渴望在競(jìng)爭(zhēng)中保持領(lǐng)先地位的研究人員緊緊掌握。代碼可能依賴于其他代碼,而其他代碼本身未發(fā)布。或者代碼可能只是丟失了,在丟失的磁盤(pán)上或被盜的筆記本電腦上——Rougier稱之為“我的狗吃了我的程序”問(wèn)題。

假設(shè)你可以獲得并運(yùn)行原始代碼,它仍然可能無(wú)法達(dá)到你的預(yù)期。在機(jī)器學(xué)習(xí)領(lǐng)域,計(jì)算機(jī)從經(jīng)驗(yàn)中獲取專業(yè)知識(shí),算法的訓(xùn)練數(shù)據(jù)可以影響其性能。這也是這次OpenAI沒(méi)有公開(kāi)其全部代碼和訓(xùn)練集遭到網(wǎng)友反對(duì)的主要原因。

在這場(chǎng)意外掀起的激烈爭(zhēng)論中,你站在哪一邊呢?

-

AI

+關(guān)注

關(guān)注

87文章

31155瀏覽量

269482 -

代碼

+關(guān)注

關(guān)注

30文章

4803瀏覽量

68752 -

計(jì)算機(jī)視覺(jué)

+關(guān)注

關(guān)注

8文章

1698瀏覽量

46033

原文標(biāo)題:OpenAI擔(dān)心自家AI太強(qiáng)大不公開(kāi)代碼,網(wǎng)友嘲諷:改名CloseAI算了

文章出處:【微信號(hào):AI_era,微信公眾號(hào):新智元】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

臨江而立:智慧邊坡監(jiān)測(cè)守護(hù)長(zhǎng)江岸坡安全

非球面透鏡背后的焦點(diǎn)研究

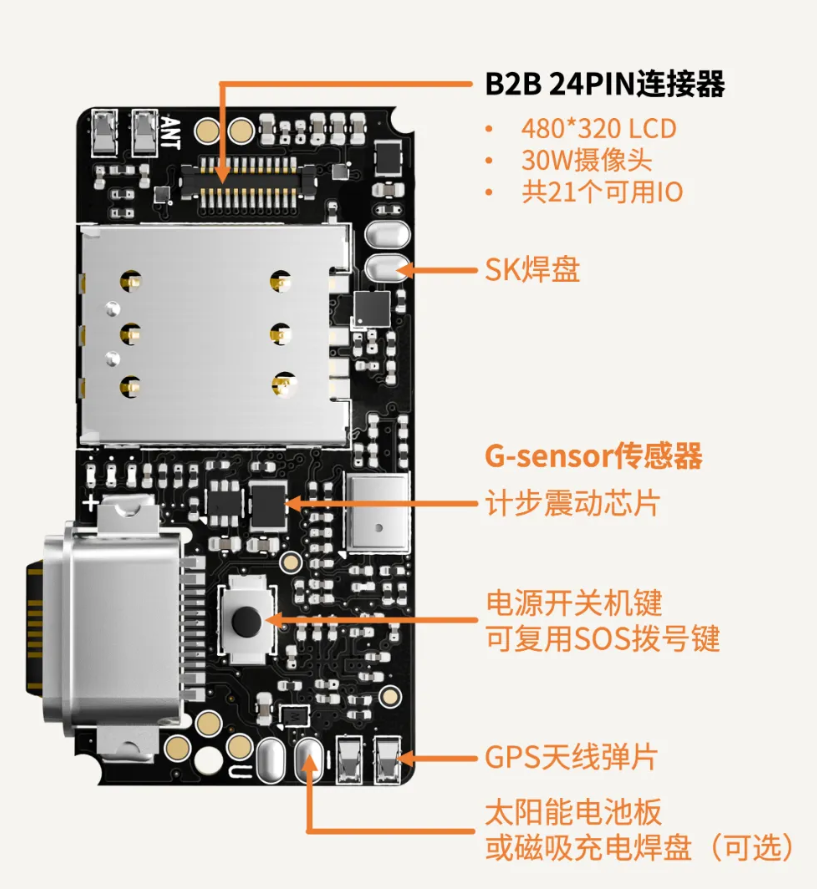

Air201公開(kāi)但沒(méi)全公開(kāi)?你要的資料在這里!

求助,一個(gè)超級(jí)難找到的元器件,有禮金相送

京東方HV320WHB-N00一邊白屏案例

TPA3255加了PFFB后一邊輸出聲音很小是什么原因?

TPA3255有直流輸出,一邊1V,一邊2.2V,是什么原因?

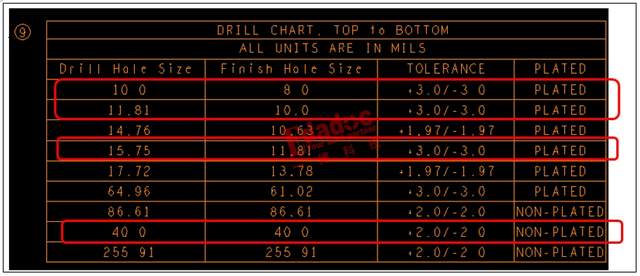

PCB生產(chǎn),在鉆咀和成品孔徑之間,你會(huì)優(yōu)先滿足哪一項(xiàng)呢

一邊光模塊一邊光纖收發(fā)器可以嗎

MWC上海如期而至,AI和5G-A成為焦點(diǎn)

陶瓷基板技術(shù)PK:DBC vs DPC,你站哪一邊?

“公開(kāi)代碼”再次成為焦點(diǎn),這次你站在哪一邊?

“公開(kāi)代碼”再次成為焦點(diǎn),這次你站在哪一邊?

評(píng)論