現實中的自然語言處理面臨著多領域、多語種上的多種類型的任務,為每個任務都單獨進行數據標注是不大可行的。遷移學習可以將學習的知識遷移到相關的場景下。本文介紹 Sebastian Ruder 博士的面向自然語言處理的神經網絡遷移學習的答辯 PPT。

NLP 領域活躍的技術博主Sebastian Ruder 最近順利 PhD 畢業(yè),下周即將進入 DeepMind 開啟 AI 研究員生涯。

Sebastian Ruder 博士的答辯 PPT《Neural Transfer Learning for Natural Language Processing》介紹了面向自然語言的遷移學習的動機、研究現狀、缺陷以及自己的工作。

Sebastian Ruder 博士在 PPT 中闡述了使用遷移學習的動機:

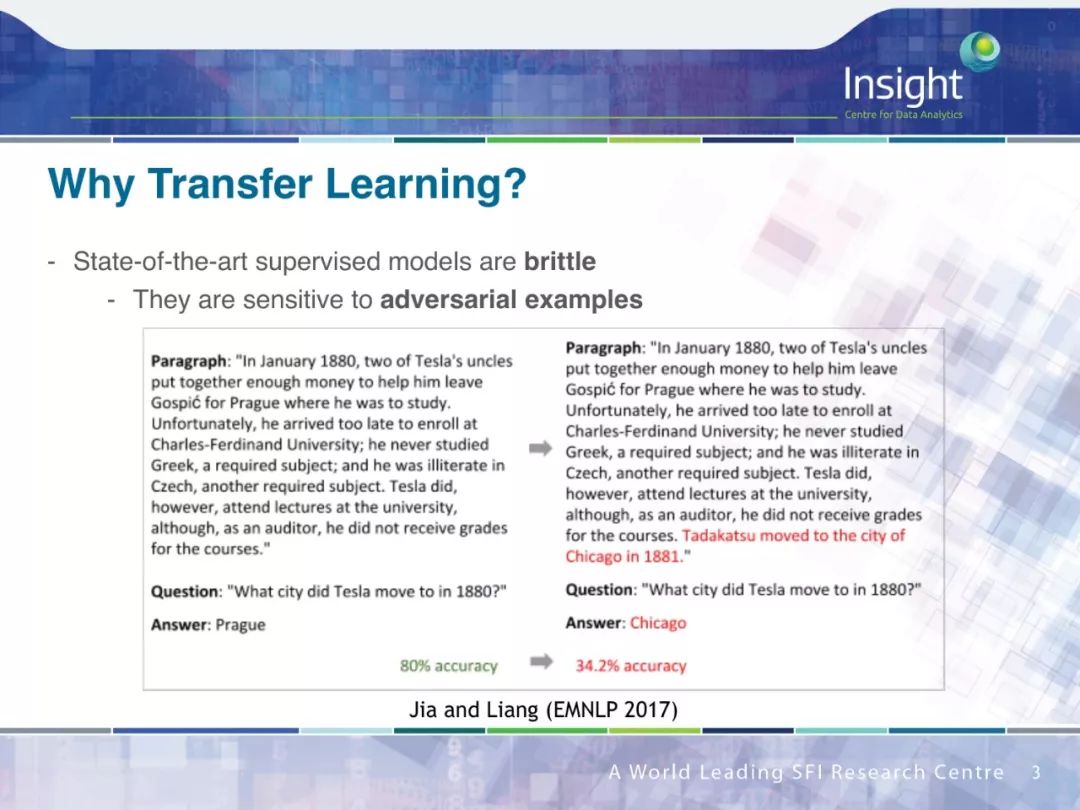

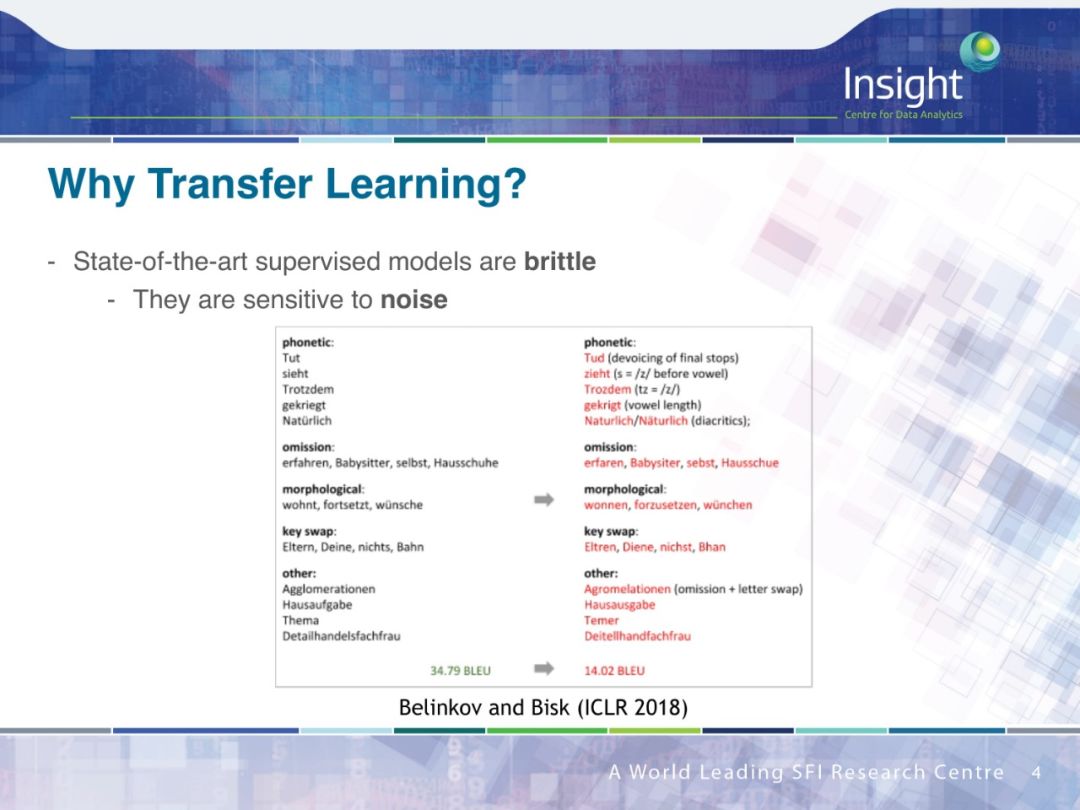

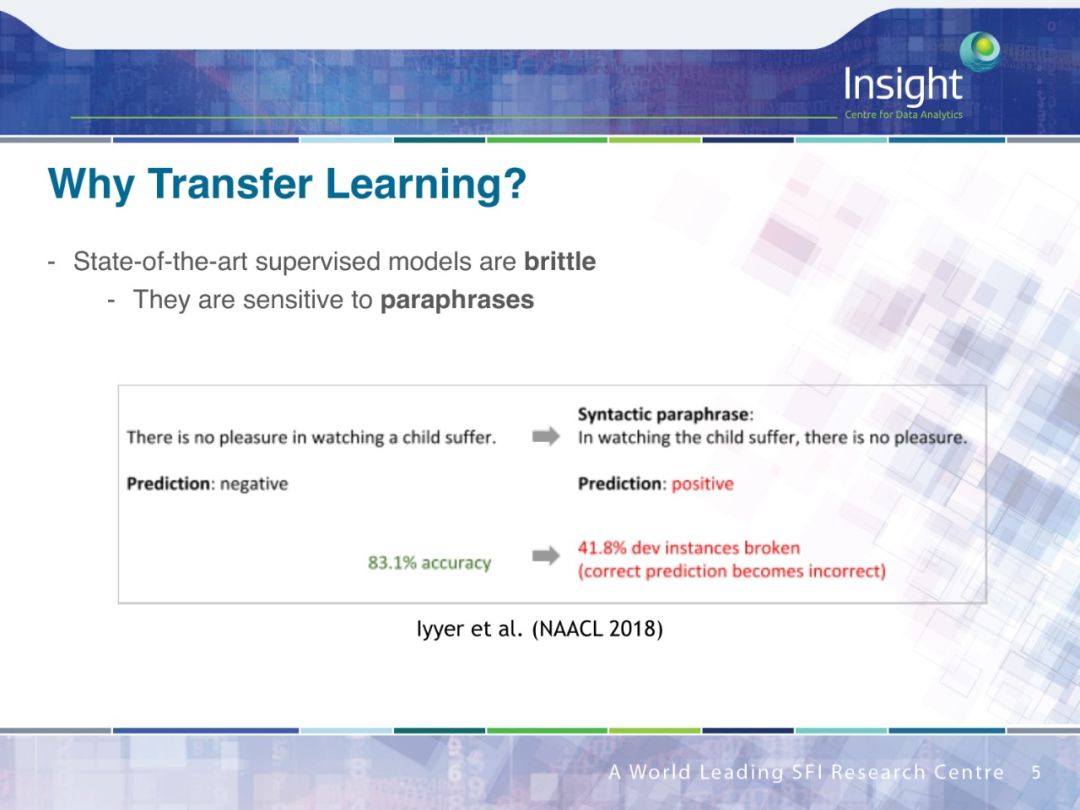

state-of-the-art 的有監(jiān)督學習算法比較脆弱:

易受到對抗樣本的影響

易受到噪音數據的影響

易受到釋義的影響

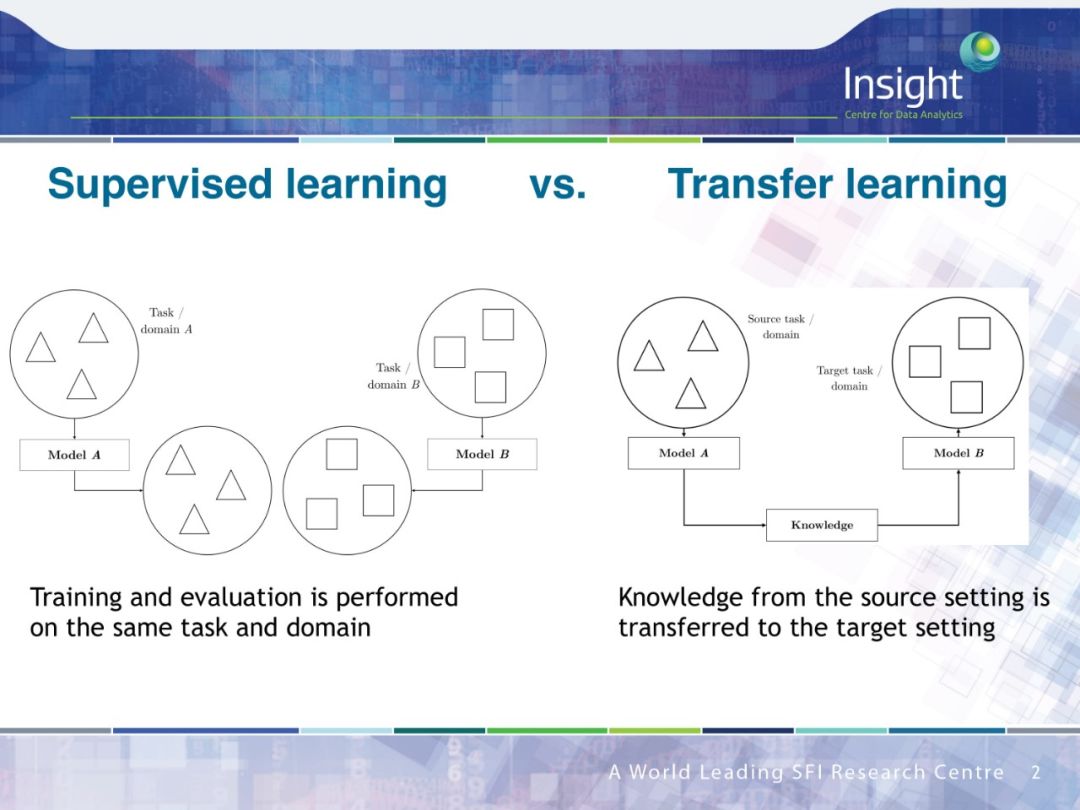

現實中的自然語言處理面臨著多領域、多語種上的多種類型的任務,為每個任務都單獨進行數據標注是不大可行的,而遷移學習可以將學習的知識遷移到相關的場景下

許多基礎的前沿的 NLP 技術都可以被看成是遷移學習:

潛在語義分析 (Latent semantic analysis)

Brown clusters

預訓練詞向量(Pretrained word embeddings)

已有的遷移學習方法往往有著下面的局限性:

過度約束:預定義的相似度指標,硬參數共享

設置定制化:在一個任務上進行評價,任務級別的共享策略

弱 baseline:缺少和傳統(tǒng)方法的對比

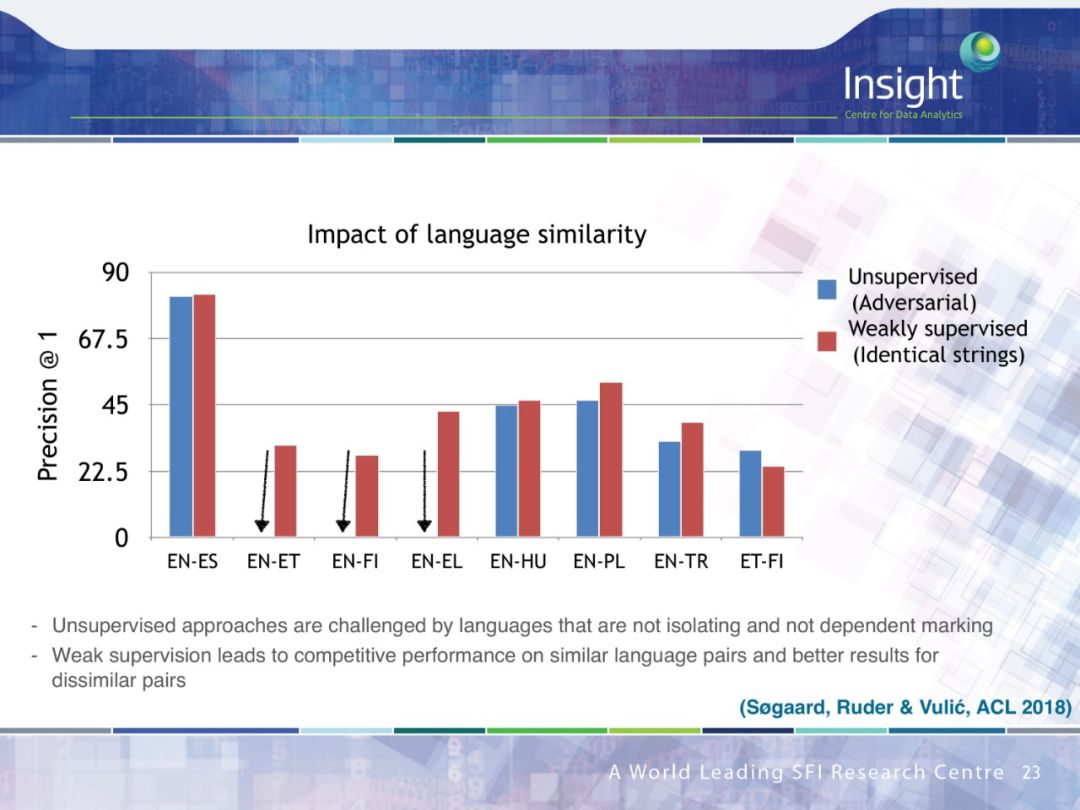

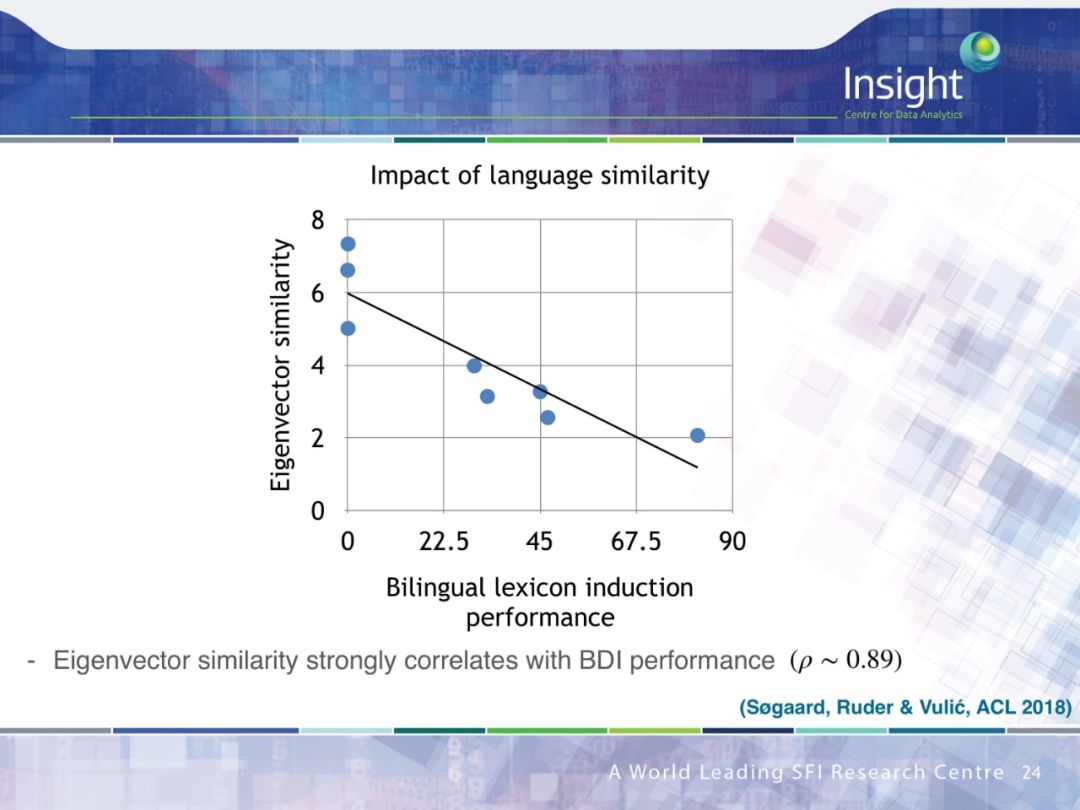

脆弱:在領域外表現很差,依賴語種、任務的相似性

低效:需要更多的參數、時間和樣本

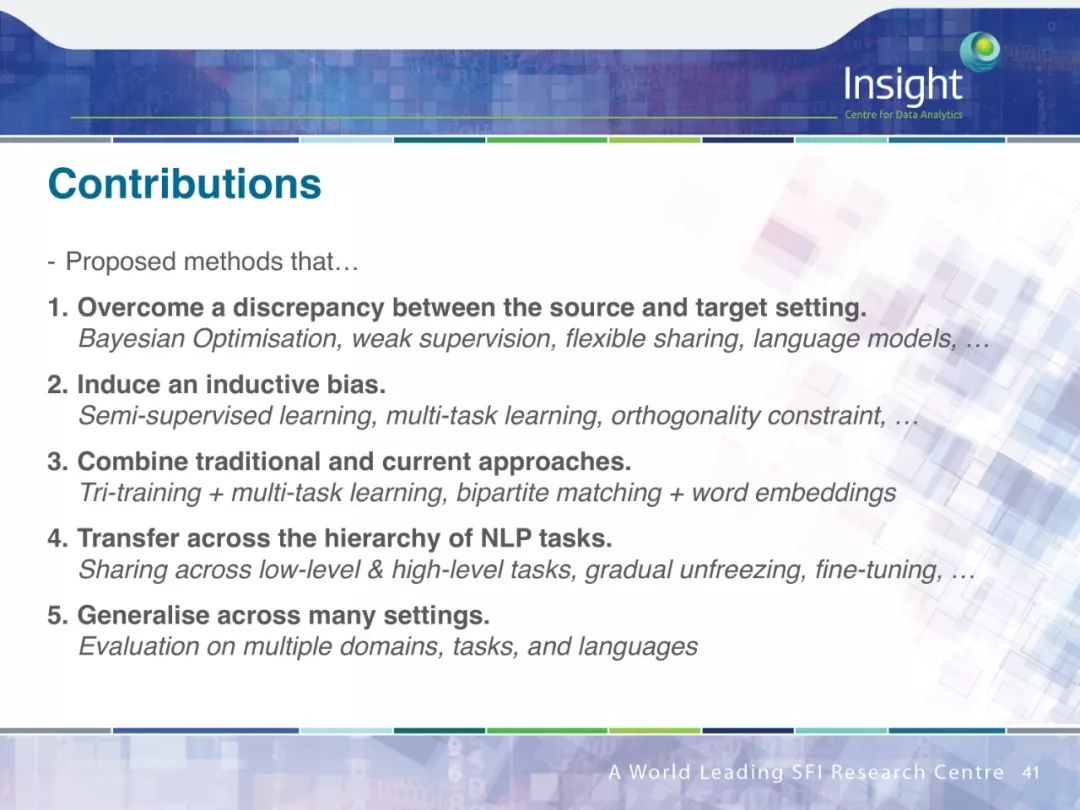

因此,作者認為研究遷移學習需要解決下面的這些問題:

克服源和目標之間的差距

引起歸納偏置

結合傳統(tǒng)和現有的方法

在 NLP 任務中跨層次遷移

泛化設置

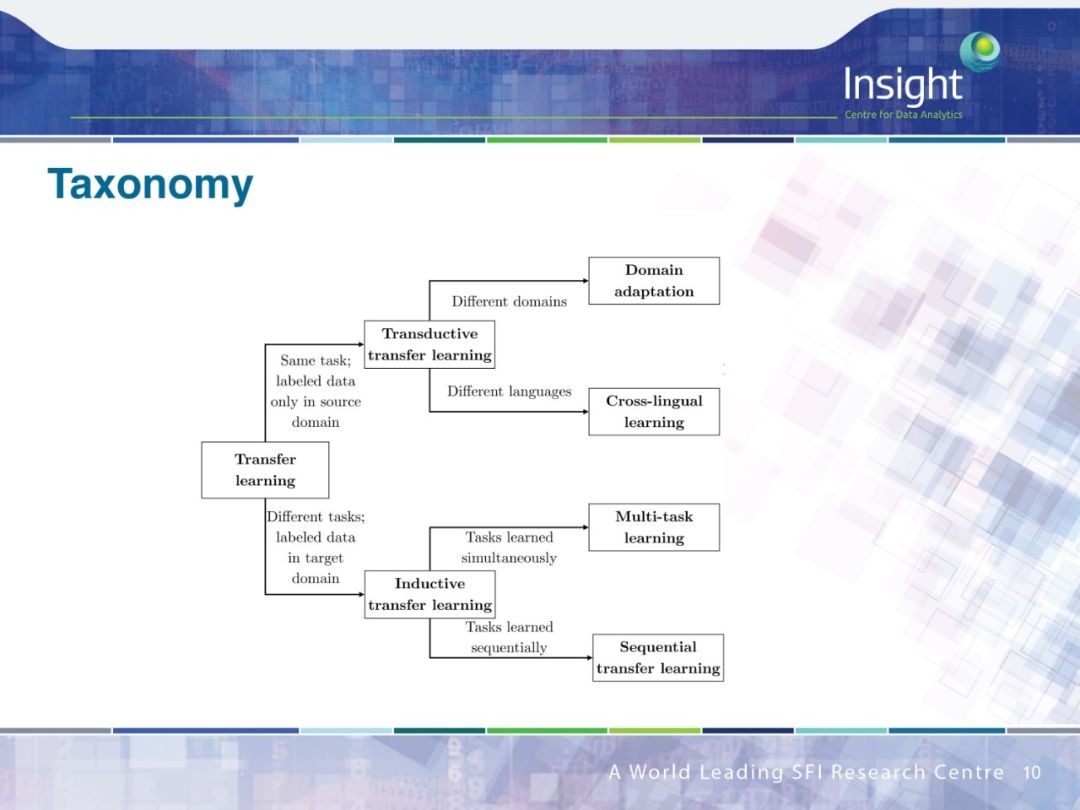

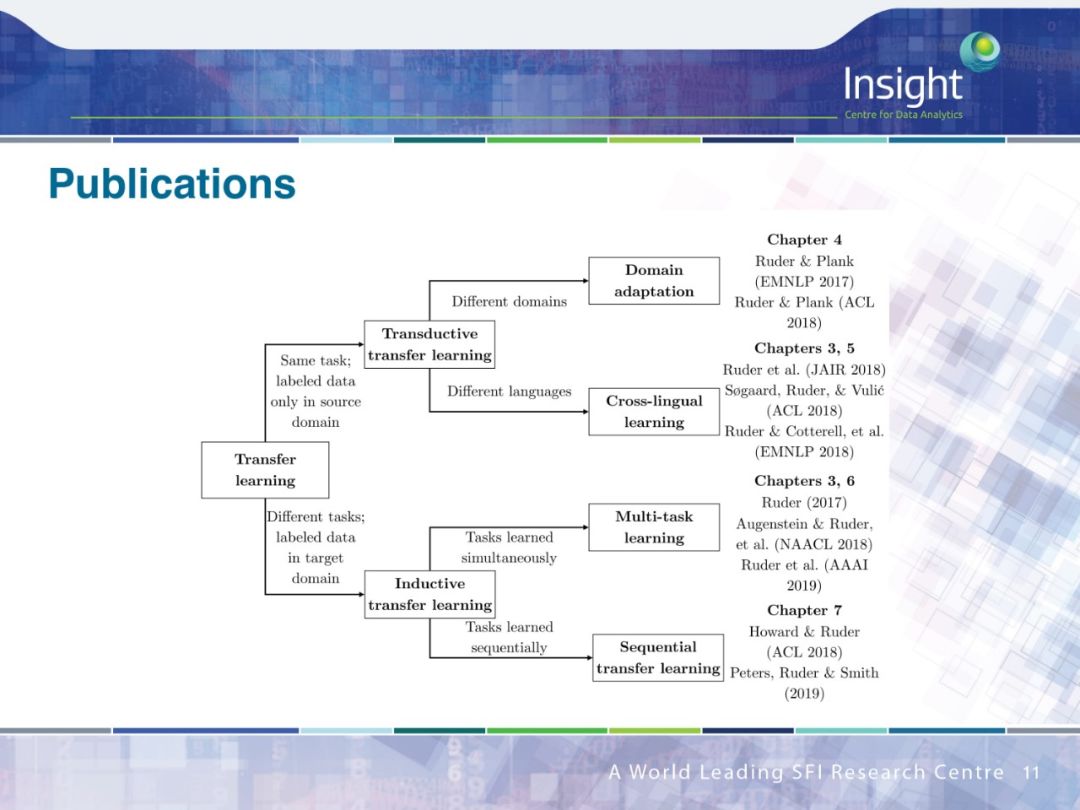

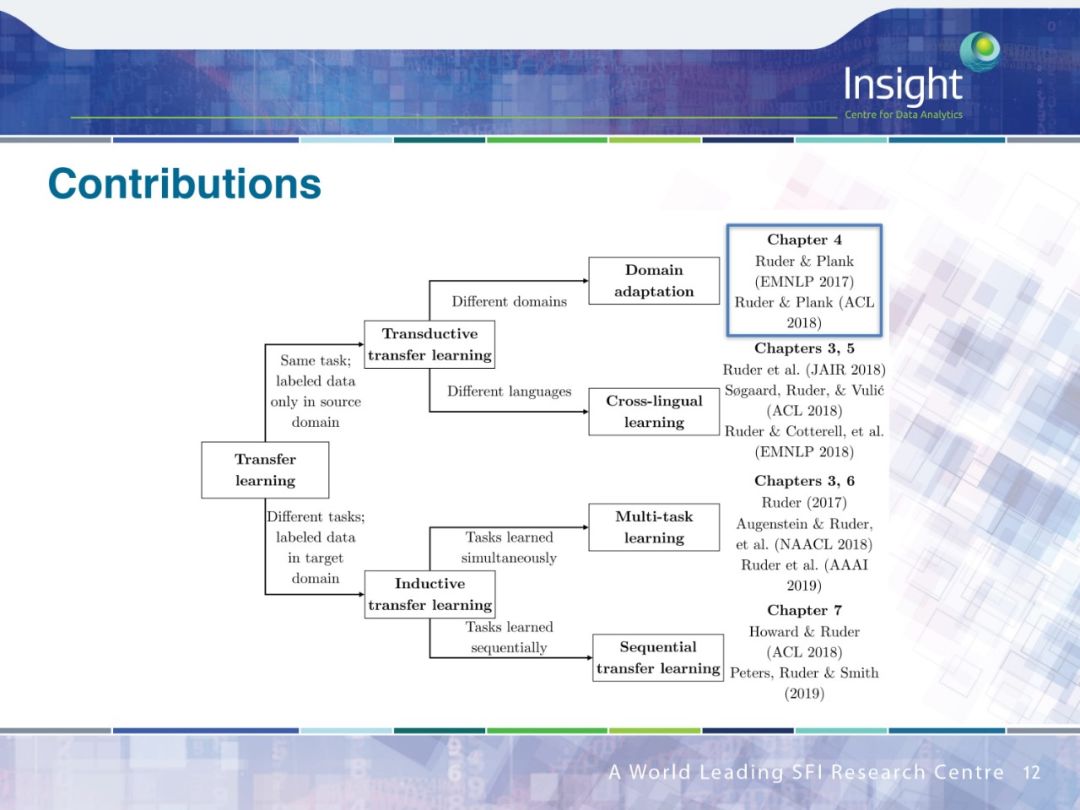

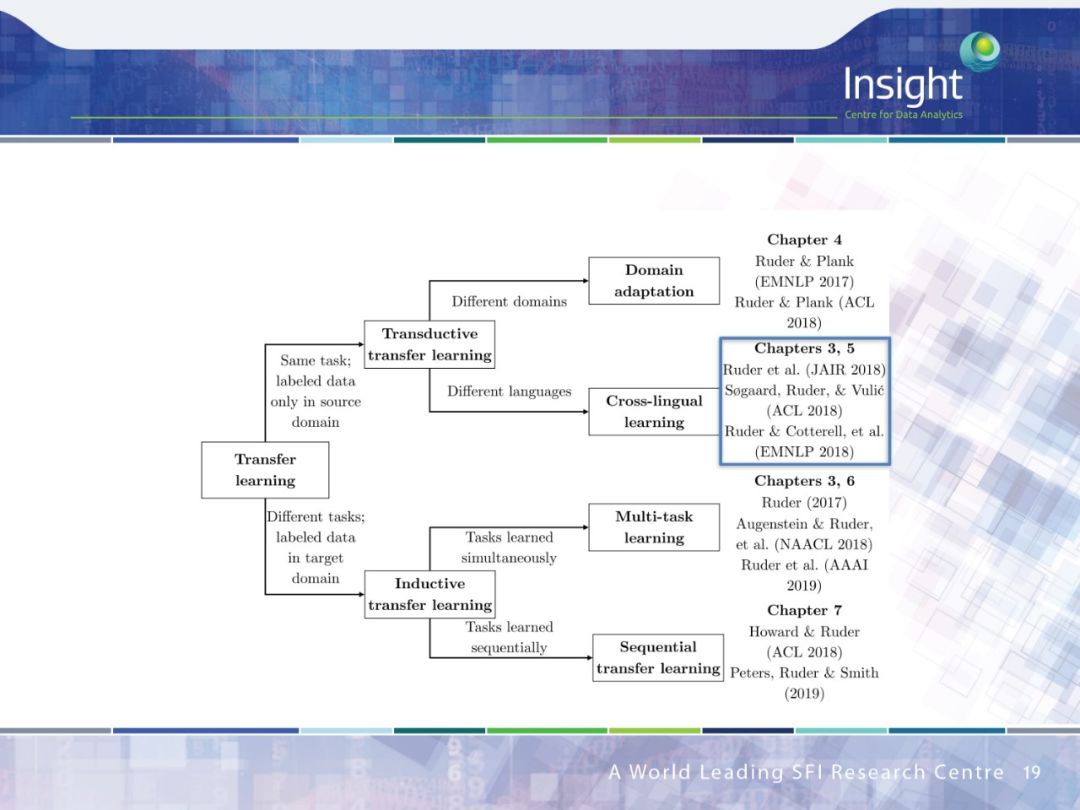

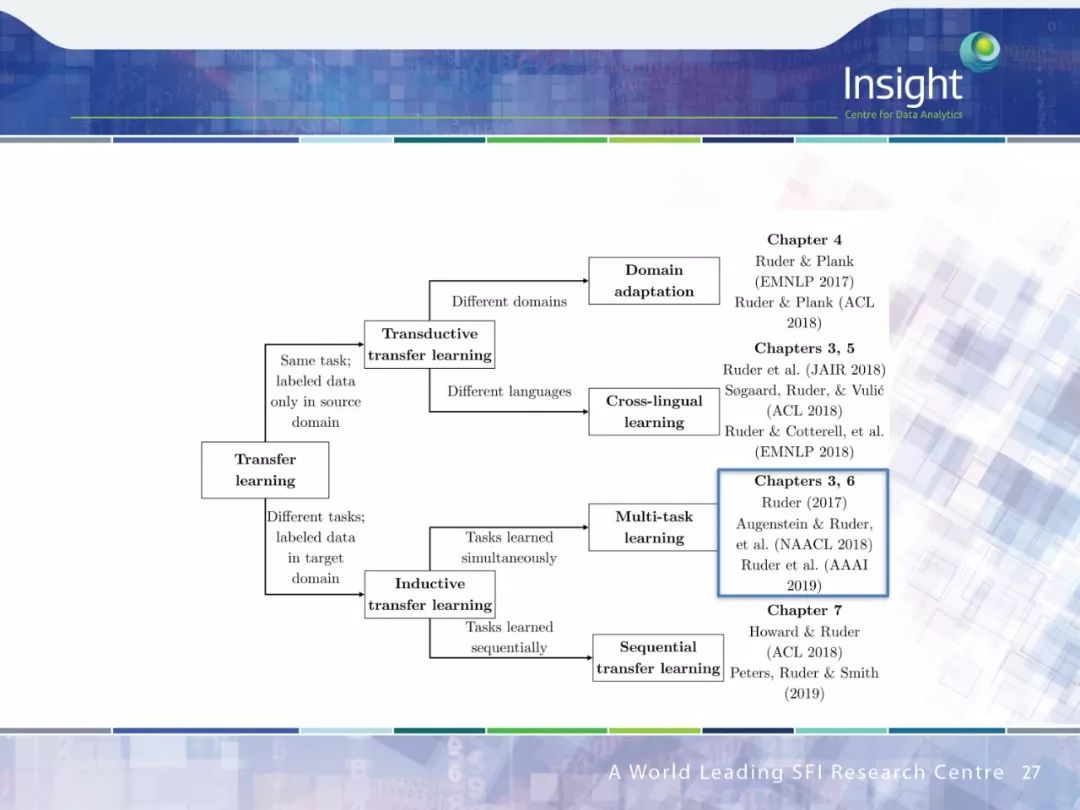

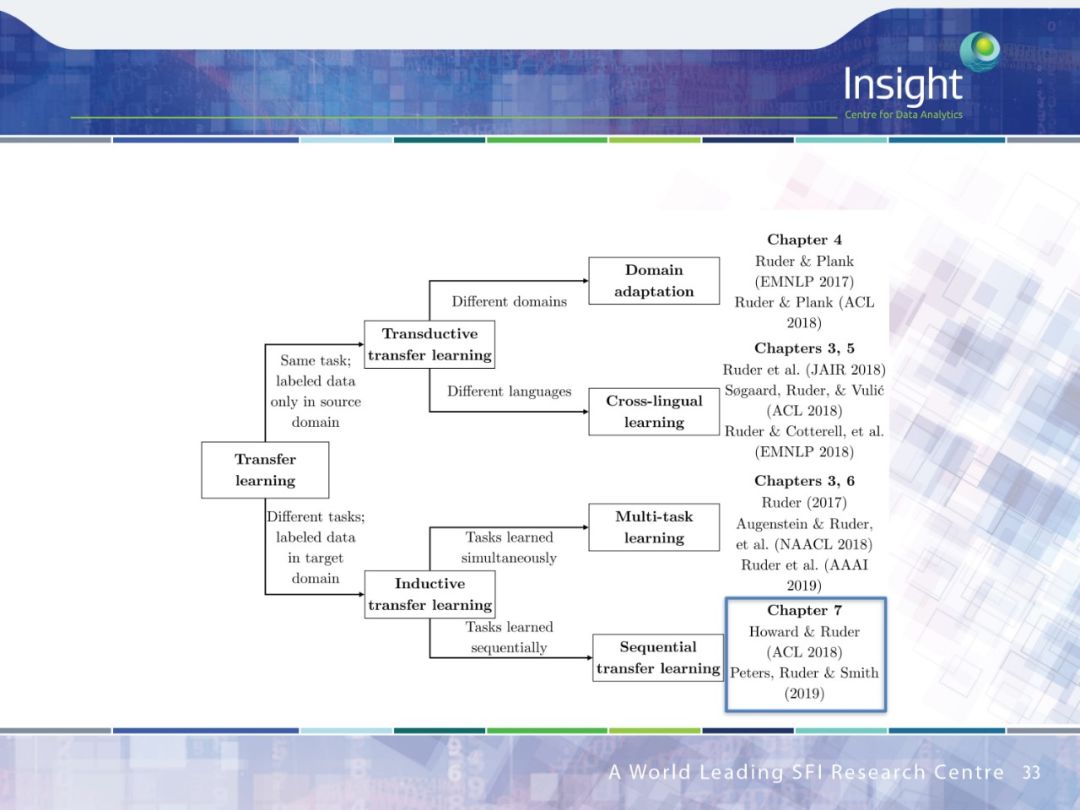

作者圍繞遷移學習做了 4 個方面的工作:

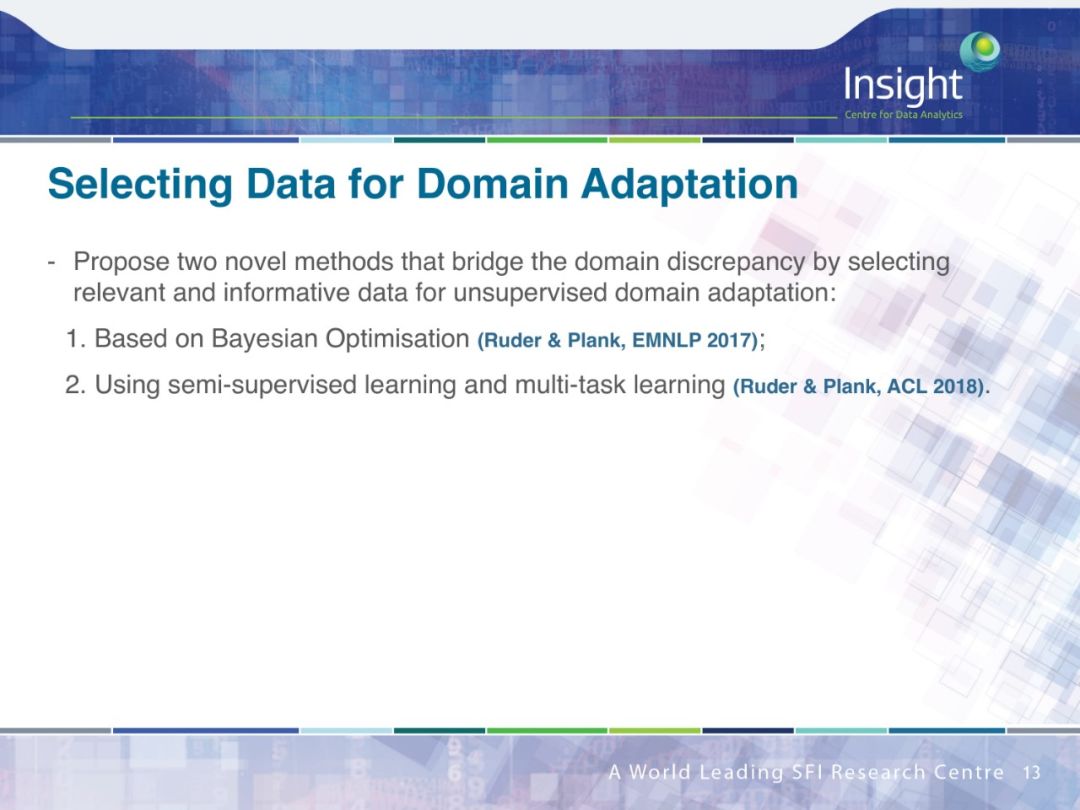

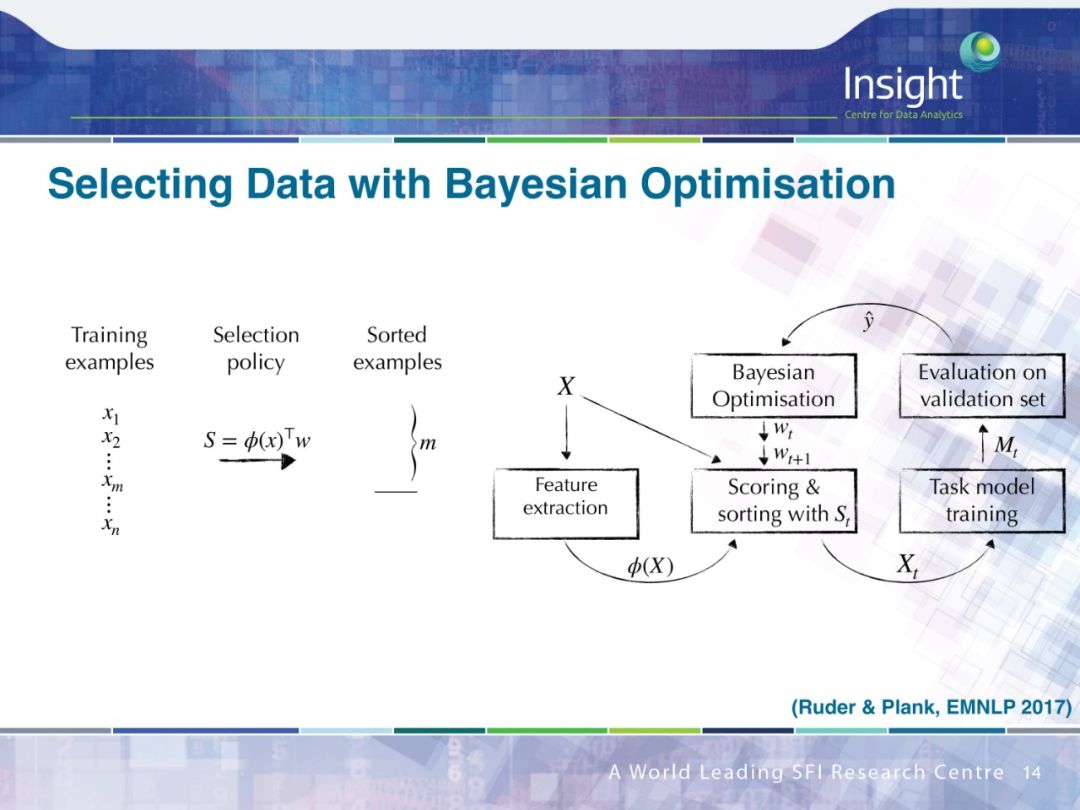

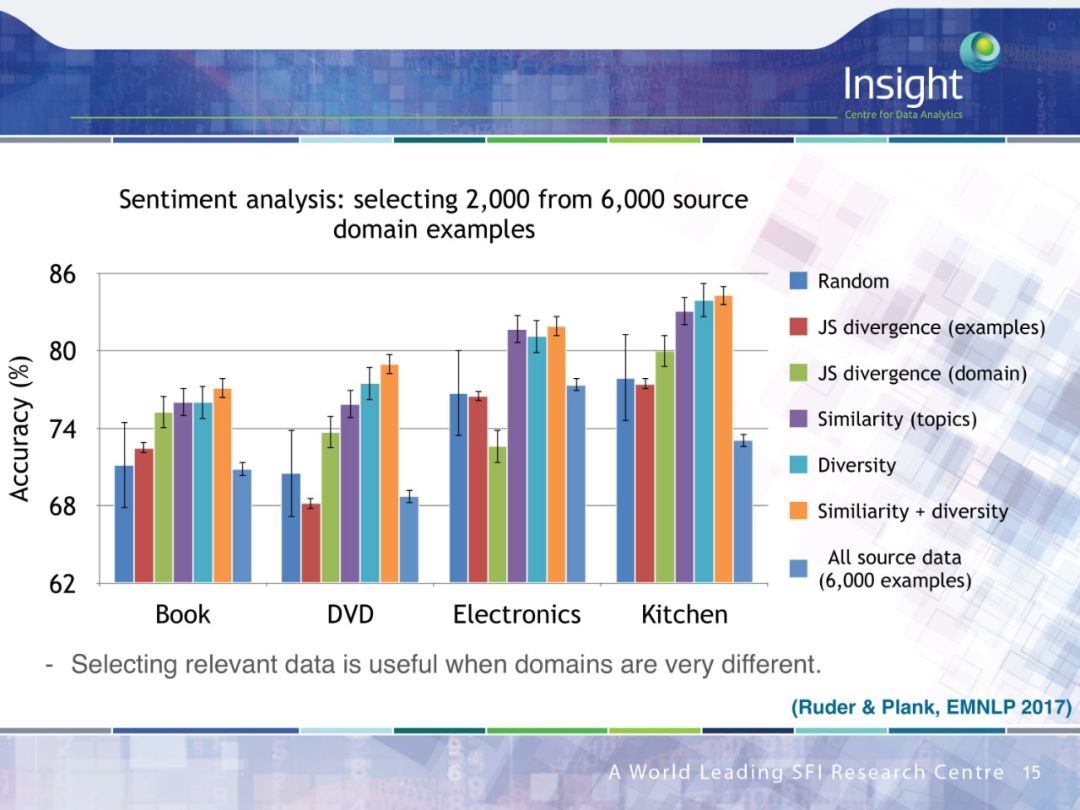

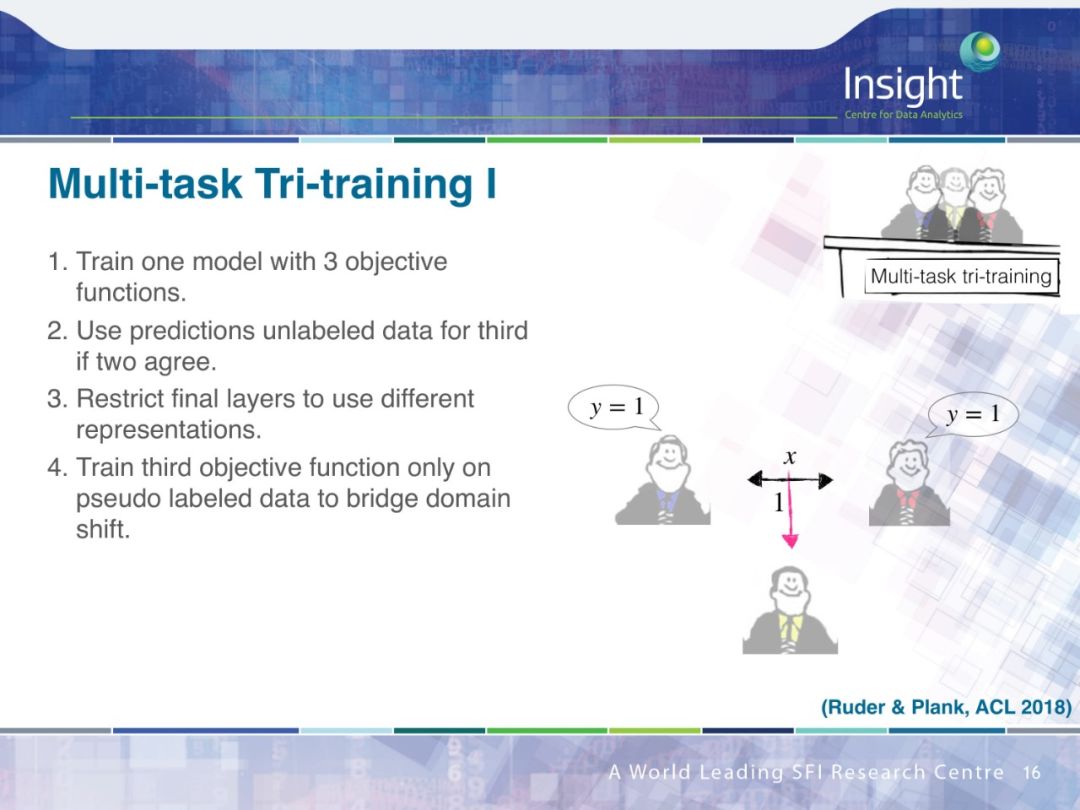

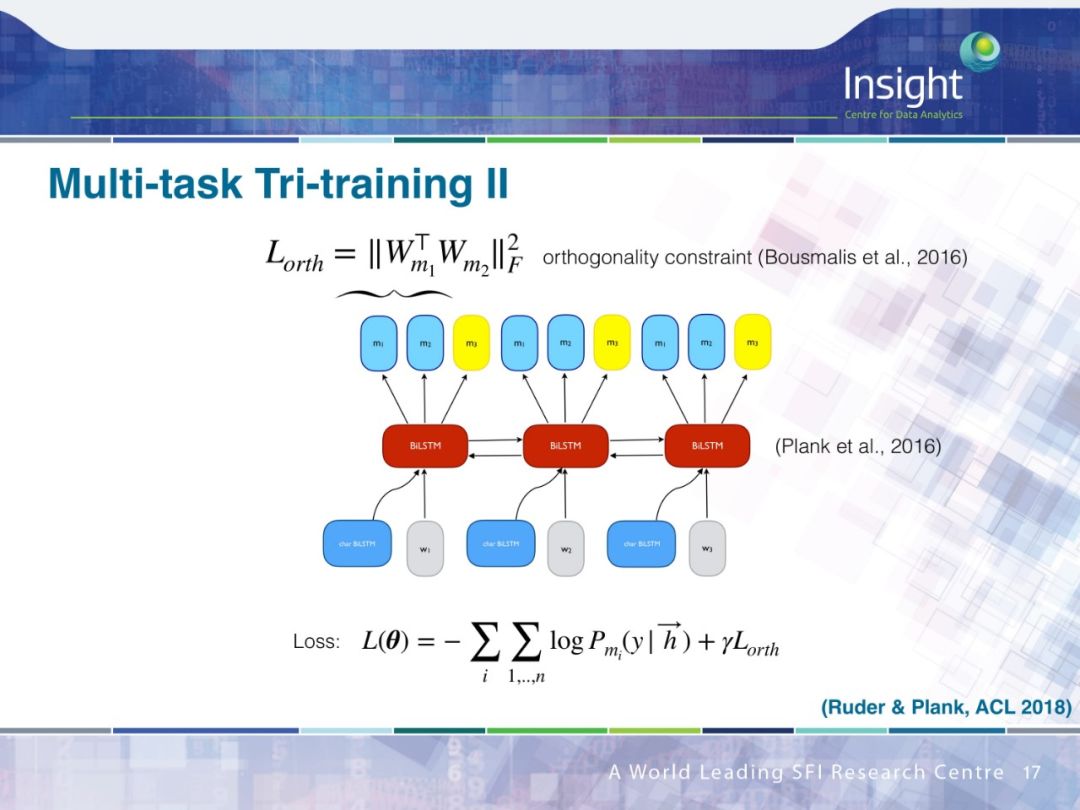

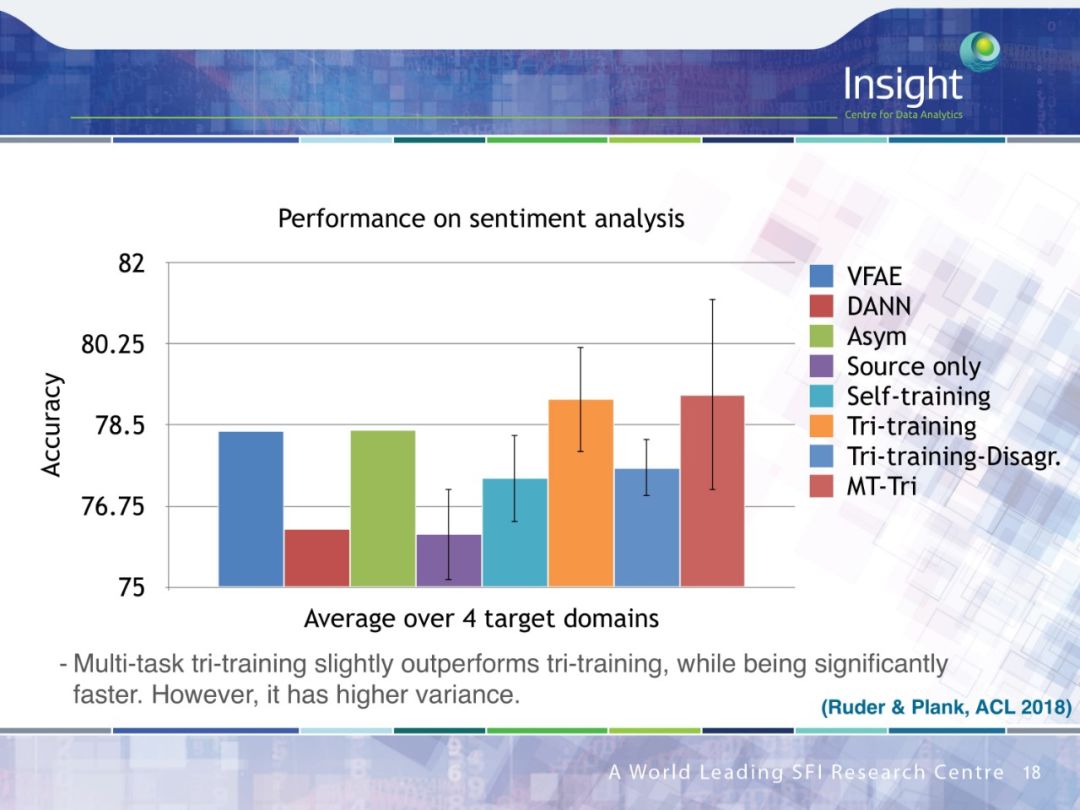

領域適應(Domain Adaption)

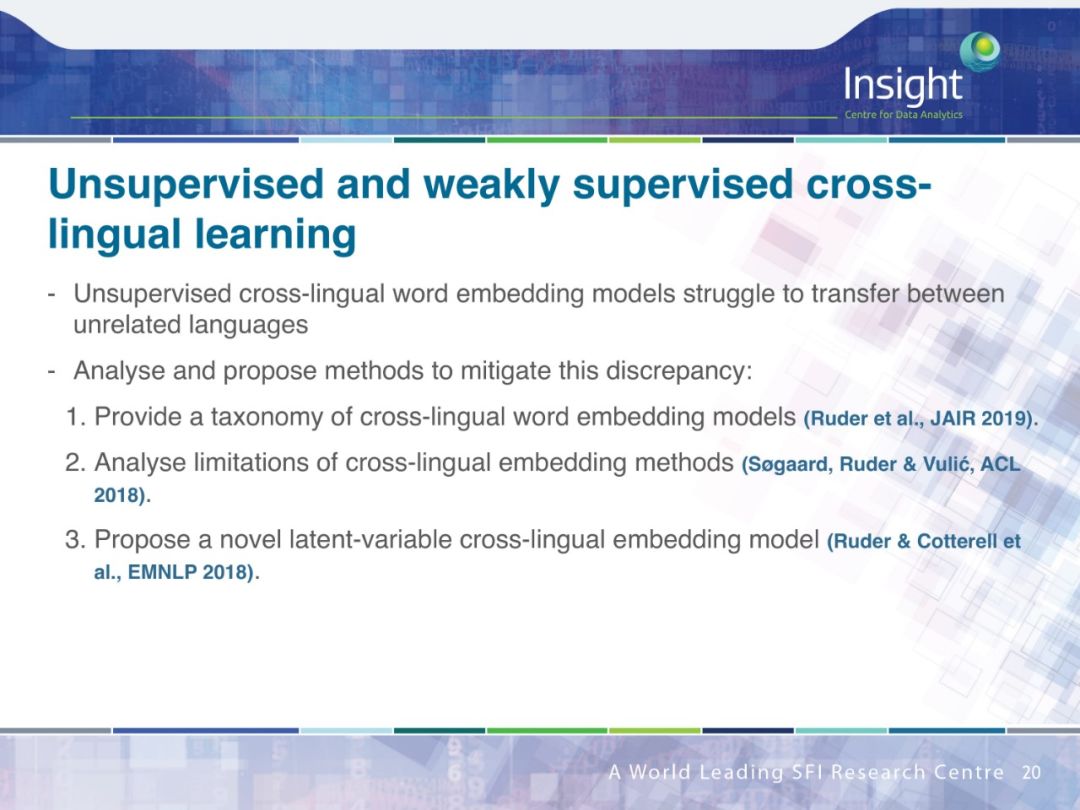

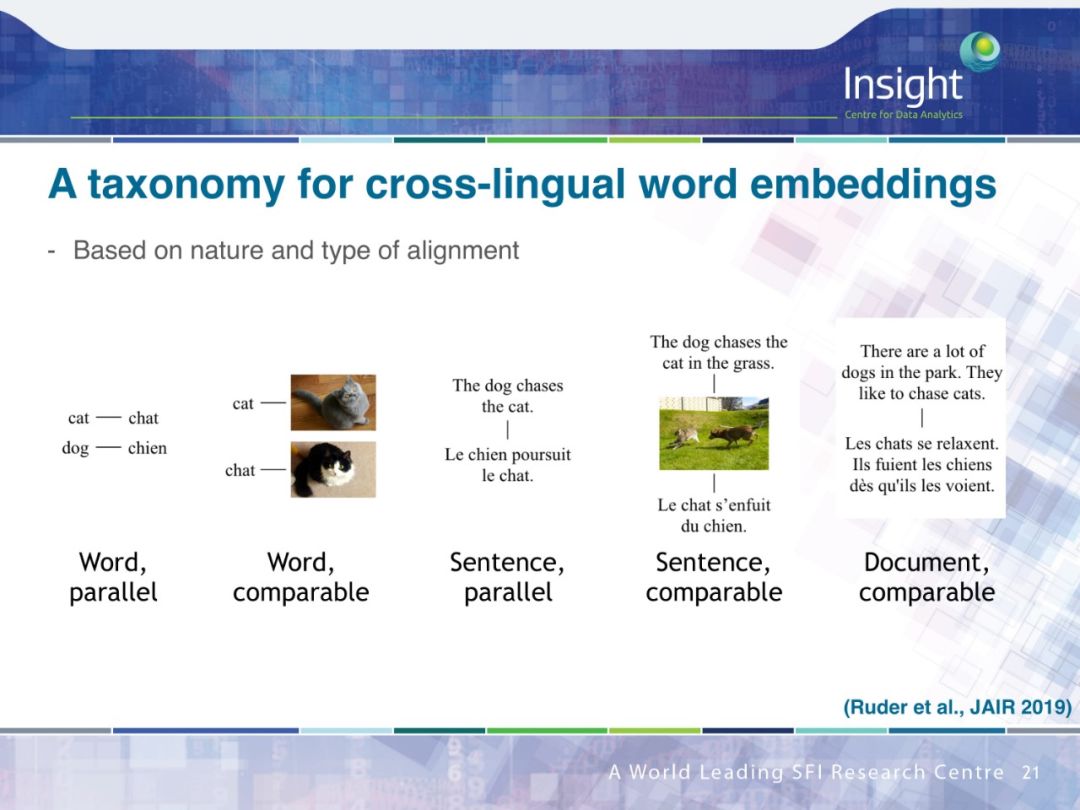

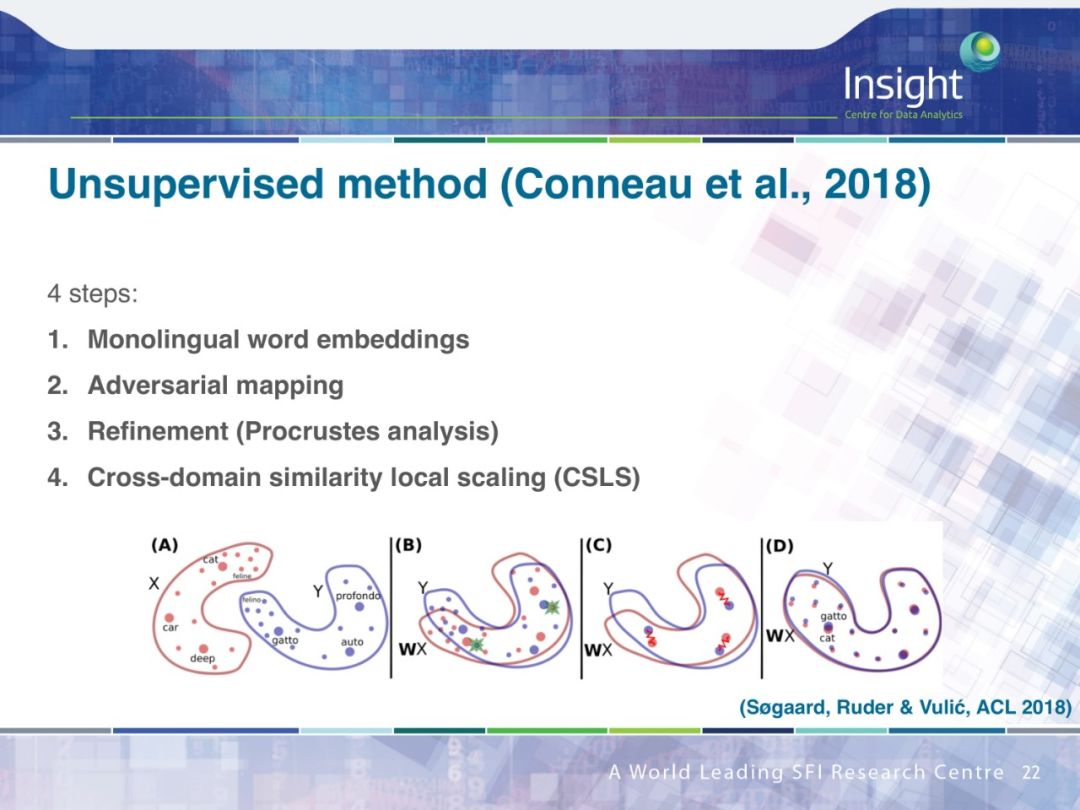

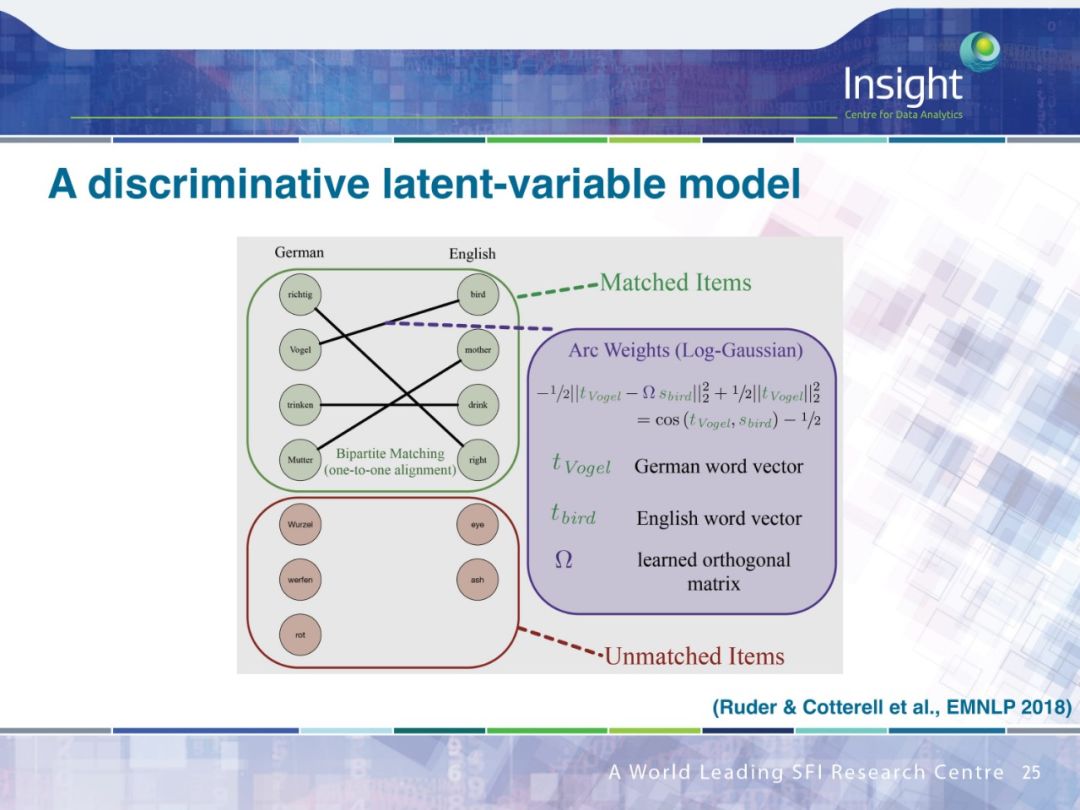

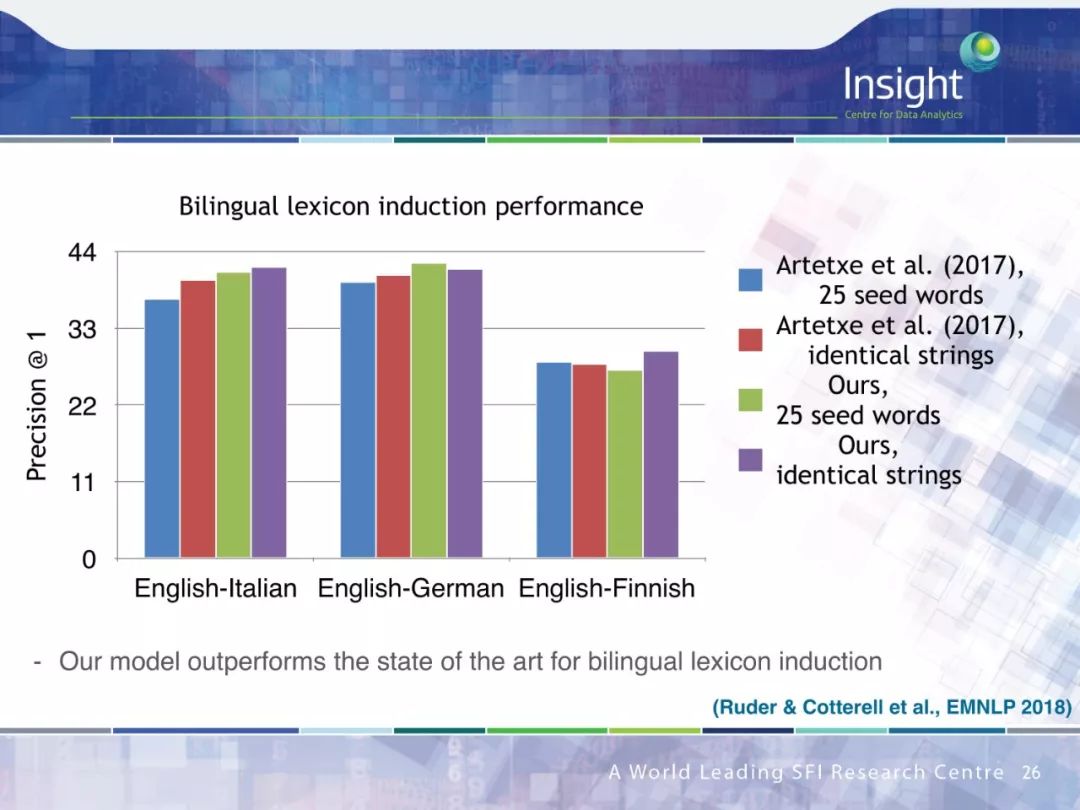

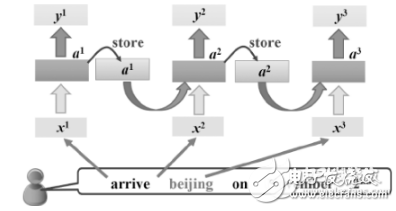

跨語種學習(Cross-lingual learning)

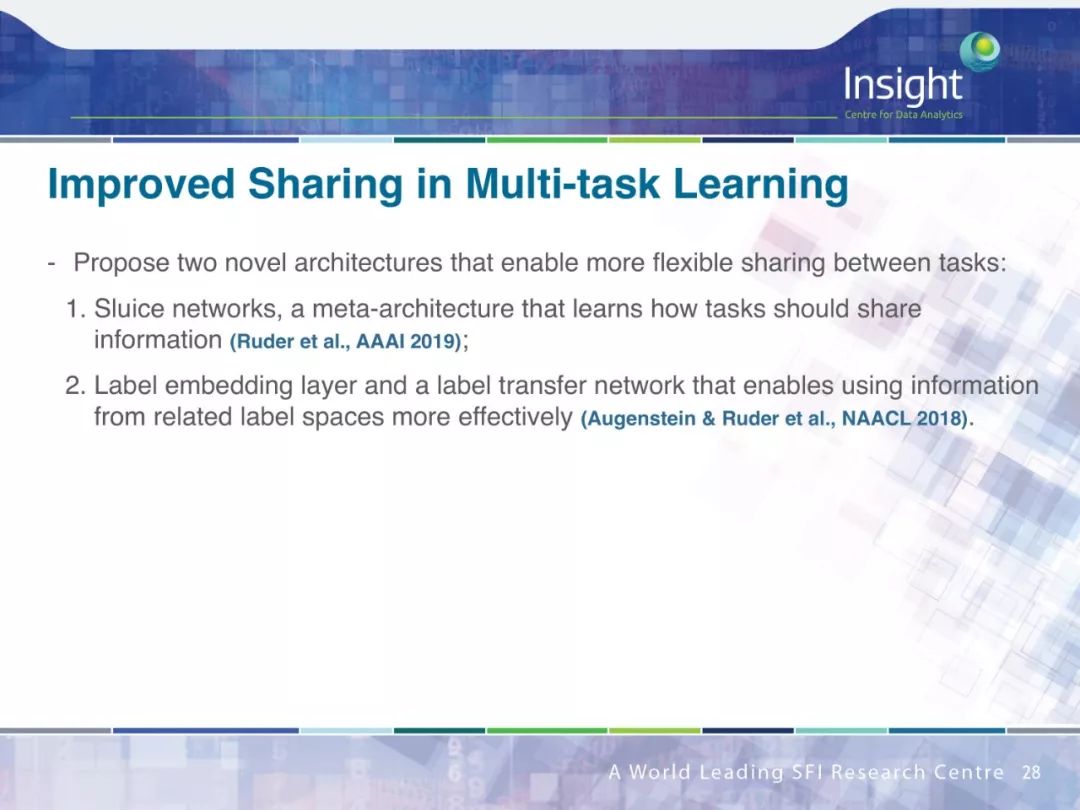

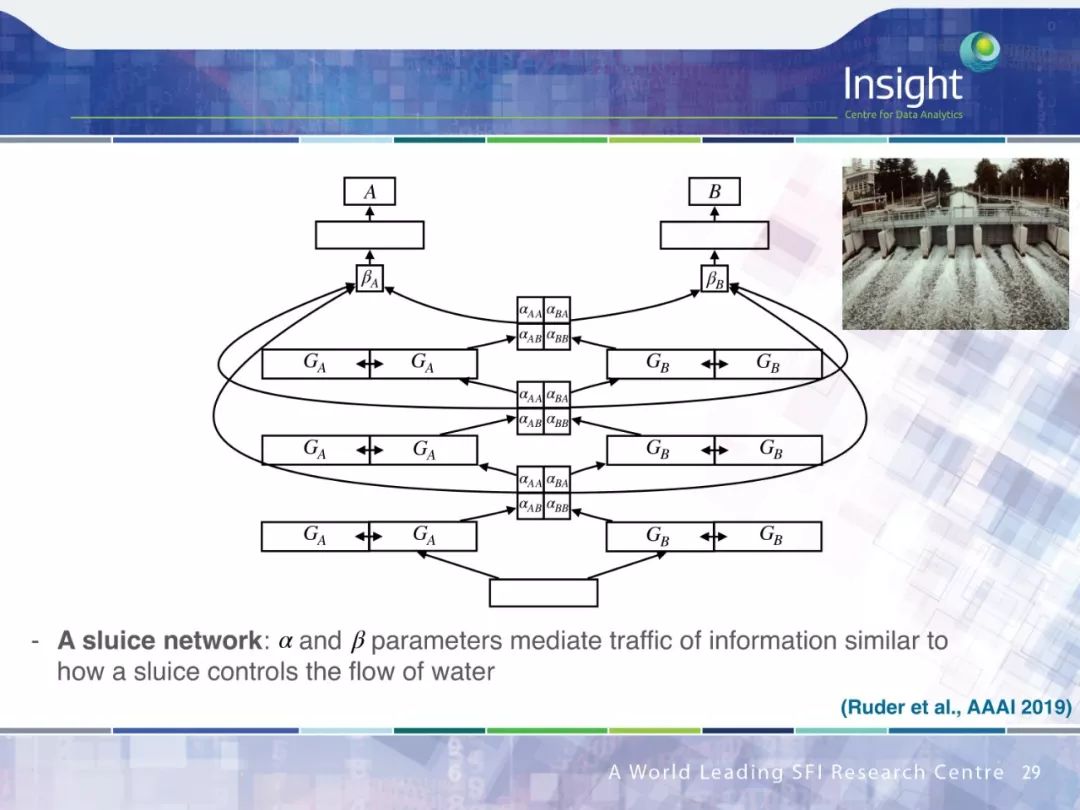

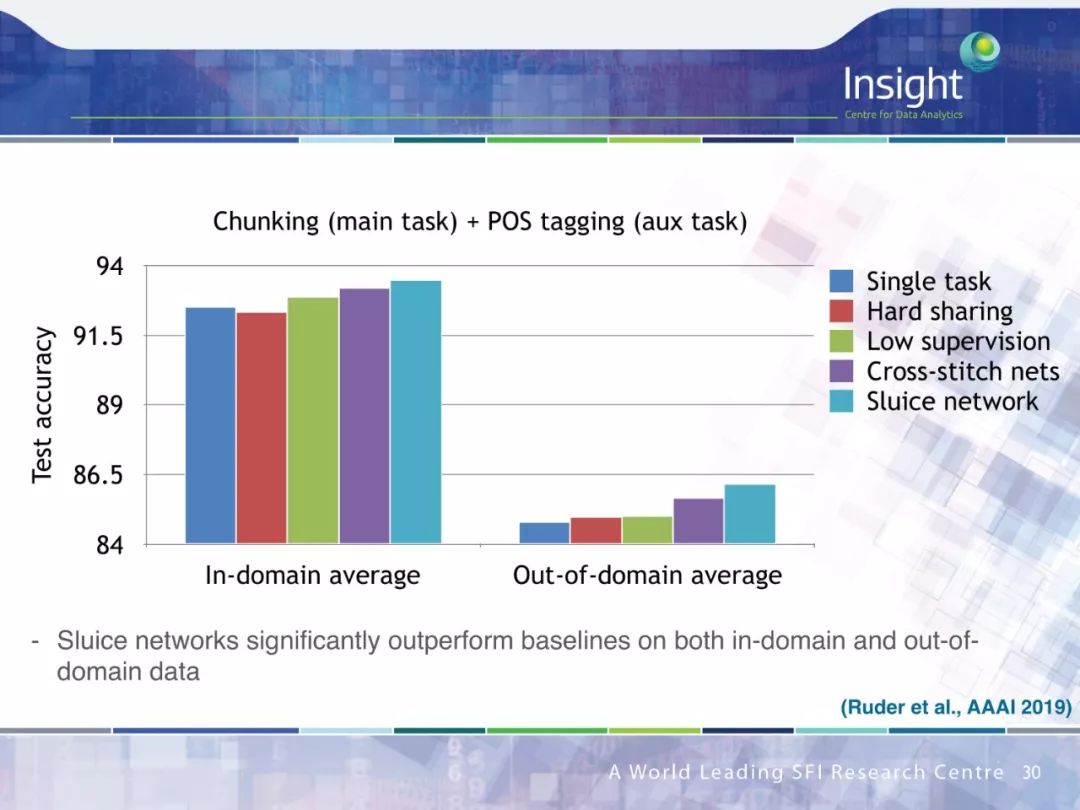

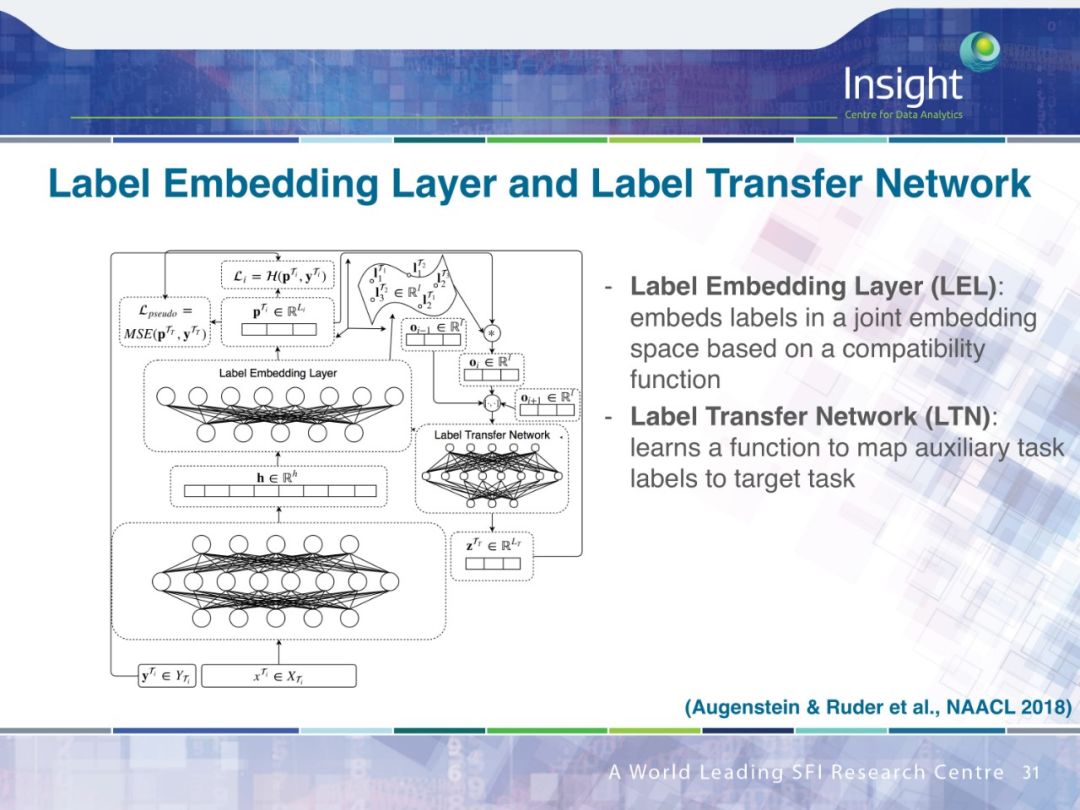

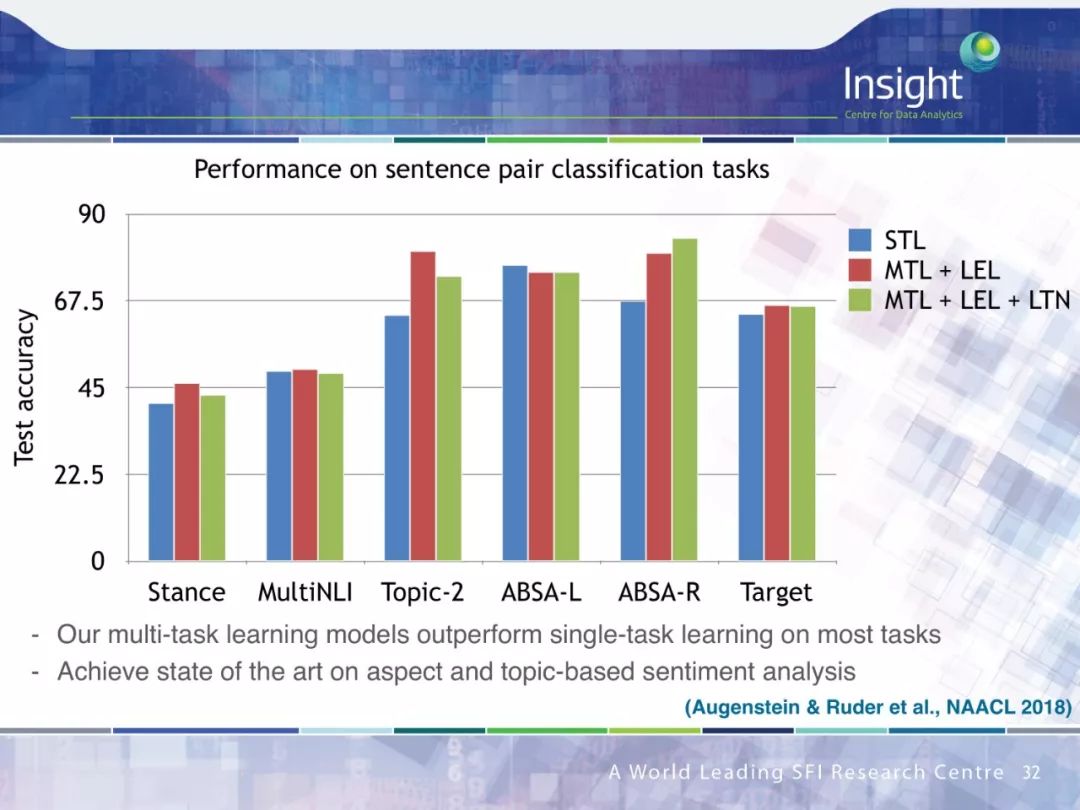

多任務學習(Multi-task learning)

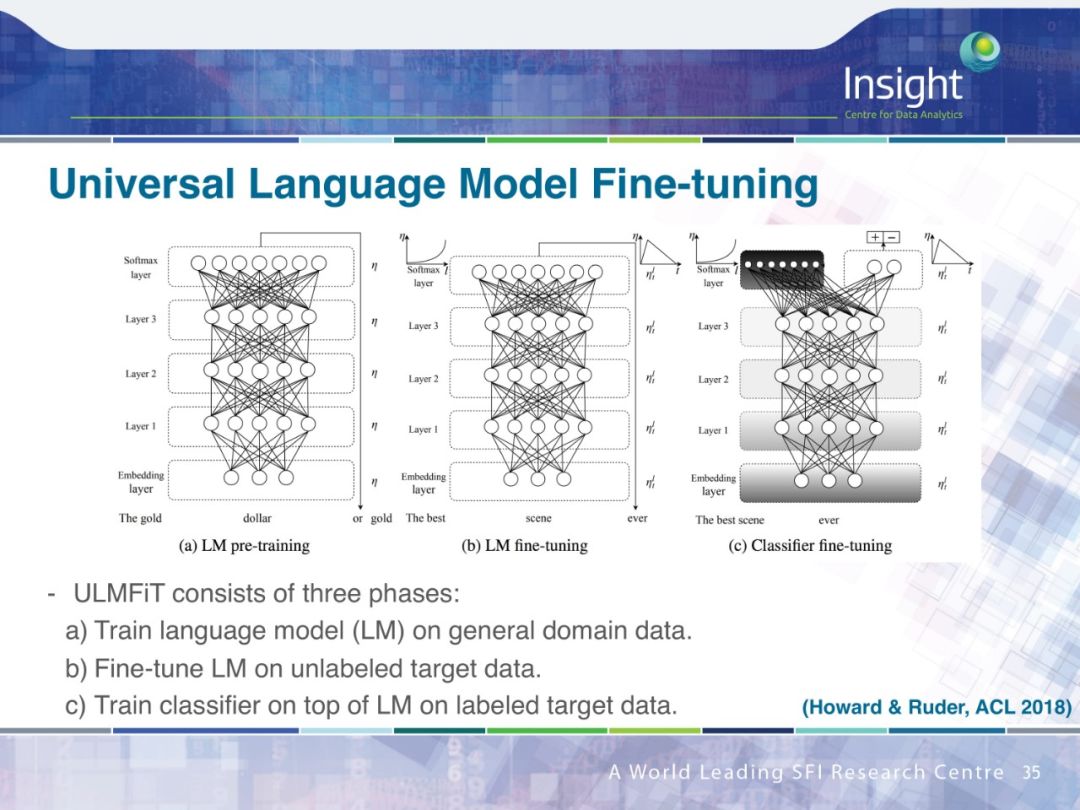

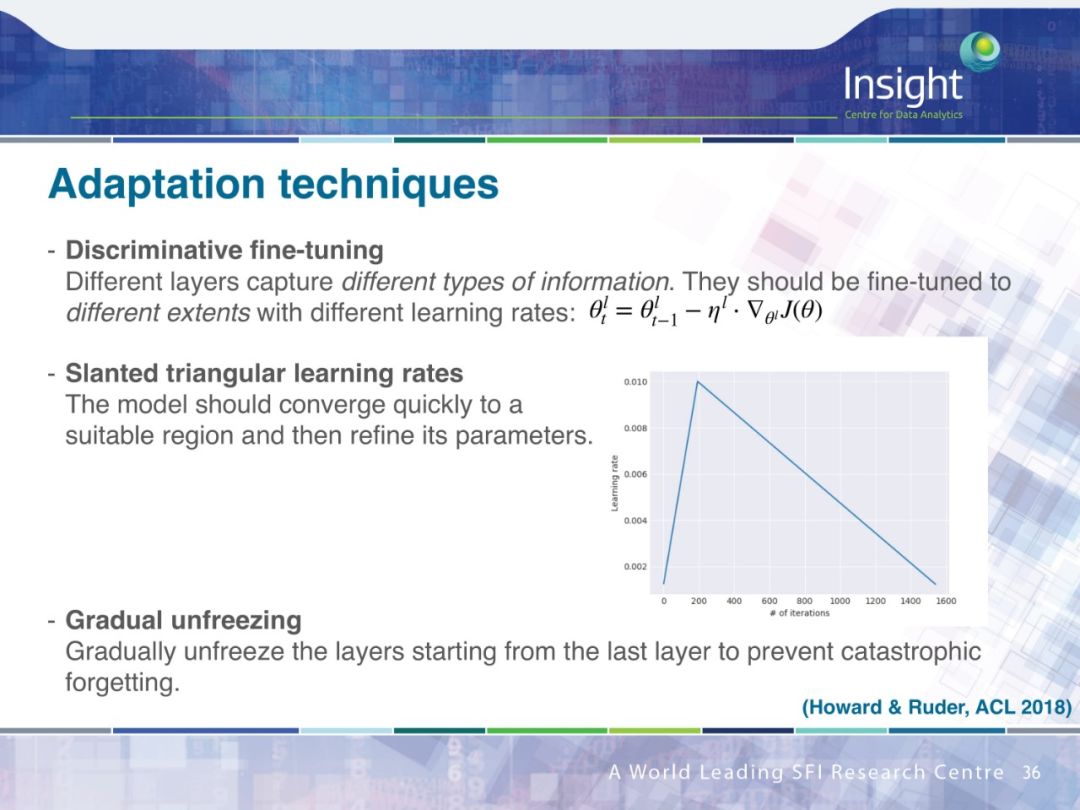

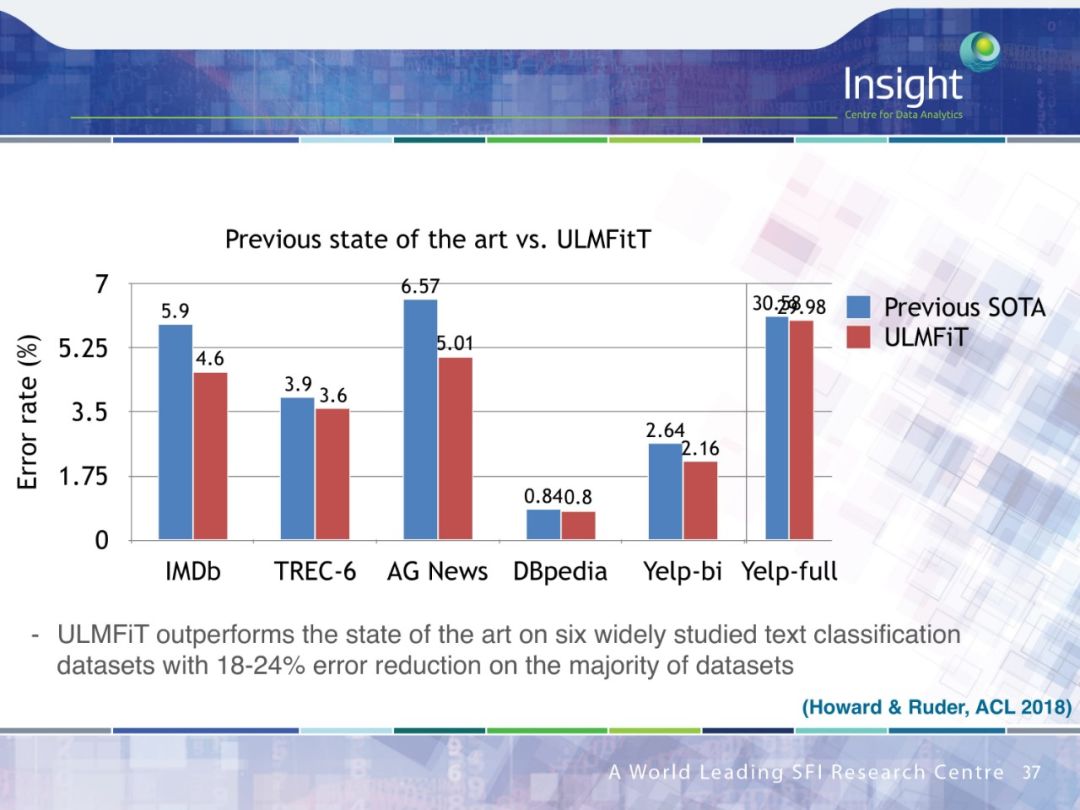

序列遷移學習(Sequential transfer learning)

具體內容可在 Sebastian Ruder 博士的完整答辯 PPT 中查看。

-

神經網絡

+關注

關注

42文章

4771瀏覽量

100718 -

自然語言處理

+關注

關注

1文章

618瀏覽量

13552 -

nlp

+關注

關注

1文章

488瀏覽量

22033

原文標題:NLP博士答辯41頁PPT,面向自然語言處理的神經網絡遷移學習

文章出處:【微信號:AI_era,微信公眾號:新智元】歡迎添加關注!文章轉載請注明出處。

發(fā)布評論請先 登錄

相關推薦

RNN在自然語言處理中的應用

面向自然語言處理的神經網絡遷移學習的答辯PPT

面向自然語言處理的神經網絡遷移學習的答辯PPT

評論