Google AI的研究人員的最新研究提出一個(gè)全新概念:剛度(Stiffness),為探索神經(jīng)網(wǎng)絡(luò)的訓(xùn)練和泛化問題提供了一個(gè)新視角。

Google AI的研究人員最近在arxiv發(fā)表的一篇新論文,探索了神經(jīng)網(wǎng)絡(luò)的訓(xùn)練和泛化問題的一個(gè)新視角。

論文題為“Stiffness: A New Perspective on Generalization in Neural Networks”,作者是谷歌 AI 蘇黎世研究中心的Stanislav Fort等人。

論文提出“剛度”(stiffness)這個(gè)概念,透過這個(gè)概念研究了神經(jīng)網(wǎng)絡(luò)的訓(xùn)練和泛化問題。

研究人員通過分析一個(gè)示例中的小梯度步驟如何影響另一個(gè)示例的損失來測(cè)量網(wǎng)絡(luò)的“剛度”。

具體來說,他們?cè)?個(gè)分類數(shù)據(jù)集(MNIST、FASHION MNIST、CIFAR-10、CIFAR-100)上分析了全連接卷積神經(jīng)網(wǎng)絡(luò)的剛度。他們關(guān)注的是剛度如何隨著1) 類隸屬度(class membership),2)數(shù)據(jù)點(diǎn)之間的距離,3)訓(xùn)練迭代,和4)學(xué)習(xí)率而變化。

研究表明,當(dāng)在固定的驗(yàn)證集上計(jì)算時(shí),剛度與泛化(generalization)直接相關(guān)。剛度函數(shù)的靈活性較差,因此不太容易對(duì)數(shù)據(jù)集的特定細(xì)節(jié)進(jìn)行過擬合。

結(jié)果表明,“剛度”的概念有助于診斷和表征泛化。

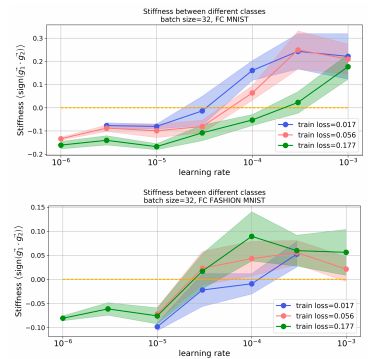

學(xué)習(xí)率的選擇對(duì)學(xué)習(xí)函數(shù)的剛度特性有顯著影響。高學(xué)習(xí)率會(huì)導(dǎo)致函數(shù)逼近在更大的距離上“更剛”(stiffer),并且學(xué)習(xí)到的特征可以更好地泛化到來自不同類的輸入。另一方面,較低的學(xué)習(xí)率似乎能學(xué)到更詳細(xì)、更具體的特征,即使在訓(xùn)練集上導(dǎo)致同樣的損失,也不能泛化到其他類。

這表明,高學(xué)習(xí)率的優(yōu)勢(shì)不僅在于收斂所需的步驟更少,還在于它們傾向于學(xué)習(xí)的特性具有更高的泛化性,即高學(xué)習(xí)率充當(dāng)了有效的正則化器。

剛度(Stiffness)的定義

剛度的定義如下:

如果點(diǎn) 處的損失相對(duì)于網(wǎng)絡(luò)權(quán)重的梯度是

處的損失相對(duì)于網(wǎng)絡(luò)權(quán)重的梯度是 ,并且點(diǎn)

,并且點(diǎn) 處的梯度是?

處的梯度是? ,則我們定義“剛度”為

,則我們定義“剛度”為 。

。

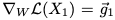

圖1:“剛度”概念的圖示

如圖1所示,“剛度”可以看做是通過應(yīng)用基于另一個(gè)輸入的梯度更新引起的輸入損失的變化,相當(dāng)于兩個(gè)輸入的梯度之間的梯度對(duì)齊(gradient alignment)。

實(shí)驗(yàn)和結(jié)果

基于類隸屬度關(guān)系的剛度特性

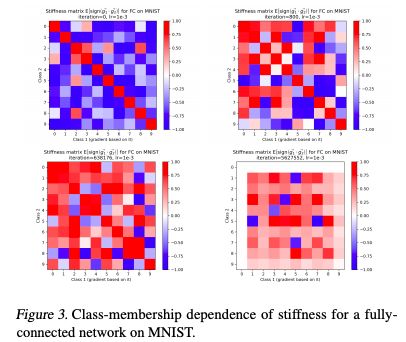

我們基于驗(yàn)證集數(shù)據(jù)點(diǎn)的類隸屬度(class membership )作為訓(xùn)練迭代函數(shù),研究了驗(yàn)證集數(shù)據(jù)點(diǎn)的剛度特性。

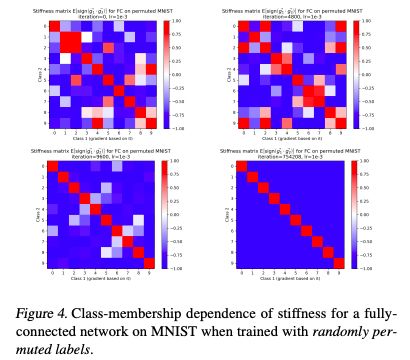

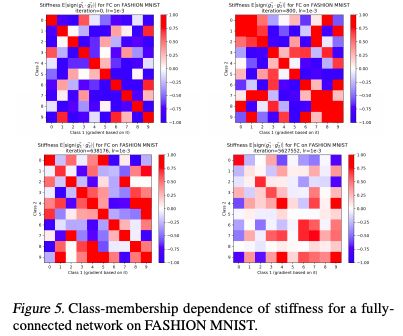

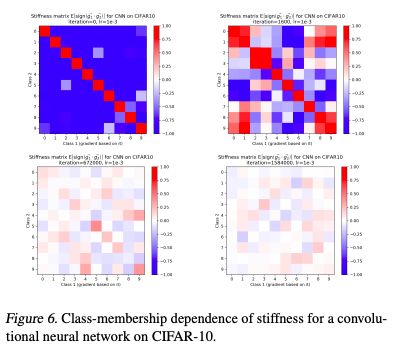

對(duì)于帶有真實(shí)標(biāo)簽的MNIST、FASHION MNIST和CIFAR-10數(shù)據(jù)集,結(jié)果分別顯示為圖3、圖5、圖6,對(duì)于帶有隨機(jī)排列訓(xùn)練集標(biāo)簽的MNIST數(shù)據(jù)集,結(jié)果為圖4.

圖3:MNIST上完全連接網(wǎng)絡(luò)剛度的Class-membership dependence

圖4:MNIST上完全連接網(wǎng)絡(luò)剛度的Class-membership dependence,訓(xùn)練時(shí)使用隨機(jī)排列的標(biāo)簽。

圖5:FASHION MNIST上完全連接網(wǎng)絡(luò)剛度的Class-membership dependence

圖6:CIFAR-10上卷積神經(jīng)網(wǎng)絡(luò)剛度的Class-membership dependence

圖3、圖5和圖6都顯示了4個(gè)訓(xùn)練階段的剛度矩陣:初始化階段(任何梯度步驟之前)、優(yōu)化早期階段和兩個(gè)后期階段。

學(xué)習(xí)率對(duì)剛度的影響

圖8:在MNIST 和 FASHION MNIST上以不同學(xué)習(xí)率訓(xùn)練,不同類別的剛度。

如圖8所示,這兩幅圖給出了三種不同訓(xùn)練損失的 class dependent剛度矩陣。較高的學(xué)習(xí)率導(dǎo)致來自不同類的輸入之間的剛度更高,表明它們學(xué)習(xí)的特性在不同類之間更加可泛化(generalizable)。

結(jié)論

我們探討了神經(jīng)網(wǎng)絡(luò)剛度的概念,并用它來診斷和表征泛化。我們研究了在真實(shí)數(shù)據(jù)集上訓(xùn)練的模型的剛度,并測(cè)量了其隨訓(xùn)練迭代、類隸屬度、數(shù)據(jù)點(diǎn)之間的距離和學(xué)習(xí)率的選擇而變化的情況。為了探討泛化和過擬合,我們重點(diǎn)研究了驗(yàn)證集中數(shù)據(jù)點(diǎn)的剛度。

總結(jié)而言,本文定義了剛度的概念,證明了它的實(shí)用性,為更好地理解神經(jīng)網(wǎng)絡(luò)中的泛化特性提供了一個(gè)新的視角,并觀察了其隨學(xué)習(xí)率的變化。

-

Google

+關(guān)注

關(guān)注

5文章

1762瀏覽量

57509 -

神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

42文章

4771瀏覽量

100720 -

數(shù)據(jù)集

+關(guān)注

關(guān)注

4文章

1208瀏覽量

24691

原文標(biāo)題:你的模型剛不剛?谷歌提出“剛度”概念,探索神經(jīng)網(wǎng)絡(luò)泛化新視角

文章出處:【微信號(hào):AI_era,微信公眾號(hào):新智元】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

東京大學(xué)的研究人員:新開發(fā)的電子皮膚有一個(gè)LED顯示屏

Google研究人員開發(fā)增強(qiáng)現(xiàn)實(shí)顯微鏡檢測(cè)癌細(xì)胞

帶你了解AI研究人員年薪百萬背后的真相

深度學(xué)習(xí)全新打開方式Google Brain提出概念激活向量新方法

研究人員們提出了一系列新的點(diǎn)云處理模塊

Facebook的研究人員提出了Mesh R-CNN模型

Google AI發(fā)布一項(xiàng)新研究 可以“近乎即時(shí)”地預(yù)報(bào)天氣

研究人員已經(jīng)使用機(jī)器學(xué)習(xí)來開發(fā)血液測(cè)試

AI研究人員如何應(yīng)對(duì)透明AI

研究人員發(fā)現(xiàn)一個(gè)可竊取AWS憑證的加密貨幣蠕蟲

Google AI的研究人員的最新研究提出一個(gè)全新概念:剛度(Stiffness)

Google AI的研究人員的最新研究提出一個(gè)全新概念:剛度(Stiffness)

評(píng)論