國防高級研究計劃局(DARPA)正在推行一項前所未有的機器學(xué)習(xí)“突破性”技術(shù),即開創(chuàng)一種網(wǎng)絡(luò)安全新技術(shù),旨在同時阻止多重攻擊并盡量阻止現(xiàn)有防御系統(tǒng)無法識別的新型攻擊。

旨在大規(guī)模改進實時AI和機器學(xué)習(xí)的DARPA主導(dǎo)的“終身學(xué)習(xí)機”(L2M)計劃依賴于這一基本前提:某些基于機器學(xué)習(xí)的系統(tǒng)可能難以識別、集成并組織某些復(fù)雜且尚未被大眾認識到的新信息。

DARPA信息創(chuàng)新辦公室項目經(jīng)理和馬薩諸塞大學(xué)計算機科學(xué)教授Hava Siegelmann說道:“如果面對的攻擊過于不同尋常,系統(tǒng)可能無法識別并阻止它們。因此我希望有這種能夠在實踐中學(xué)習(xí)的機器學(xué)習(xí)模型。有些情況下系統(tǒng)并不知道該怎么做。”

新興高科技計劃的目標(biāo)可以通過“實時訓(xùn)練”來解釋。如果機器在實時進行分析的同時學(xué)習(xí)最困難或最模糊的事物,那么,正如Siegelmann解釋的那樣: “我們不受訓(xùn)練集的束縛(先前編譯或存儲的信息)。我們將舊數(shù)據(jù)和新數(shù)據(jù)放在一起,以便在全部培訓(xùn)數(shù)據(jù)上重新訓(xùn)練網(wǎng)絡(luò)。“

正如Siegelmann解釋的那樣,存在某些從未見過的細微差別或數(shù)據(jù)排列。當(dāng)然,這些都與機器學(xué)習(xí)通常可以分析的內(nèi)容背道而馳。

此外,人工智能似乎也有一些限制,這意味著它可能還沒有能力完全消化和吸收一些非常主觀的變量,如“情感”與”本能”、某些需要通過人類認知而實現(xiàn)的獨特決策、或任何與計算機算法、數(shù)學(xué)公式或一些純科學(xué)分析方法不兼容的東西。

相反地,根據(jù)一些行業(yè)計算機科學(xué)家,通過利用包括語音模式、歷史行為以及許多其他類型數(shù)據(jù)的數(shù)據(jù)庫,AI現(xiàn)在處于能夠處理更多主觀事物的前沿。

有趣的是,Seigelmann解釋說,LM2與人類生物現(xiàn)象有一些概念上的相似之處。她說,實時輸入和輸出之間的先進協(xié)同作用類似于嬰兒理解周圍環(huán)境的機制。

“當(dāng)嬰兒出生時,它一直在學(xué)習(xí)如何適應(yīng)并學(xué)習(xí)。如果一個機器能夠立刻將新信息添加并同步至現(xiàn)存數(shù)據(jù)庫以快速吸收并理解它,那么它就能快速識別并計算新信息。”Siegelmann補充道。

探索與創(chuàng)建與計算機算法相關(guān)的生物學(xué)絕非前所未有。五角大樓科學(xué)家長期以來一直沉浸在被稱為“仿生學(xué)”的學(xué)科中。在這一學(xué)科中,鳥類和蜜蜂的集群模式成為了開發(fā)無人機新算法的一種分析方式,使它們能夠協(xié)調(diào)集成功能,準(zhǔn)確群集或進行串聯(lián)操作而不會發(fā)生碰撞。

除了正在迅速發(fā)展的L2M工作外,Siegelmann還強調(diào)了一項相關(guān)但又截然不同的專注于網(wǎng)絡(luò)安全方向的探索。這項研究旨在阻止比尋常攻擊更為先進的網(wǎng)絡(luò)攻擊。

這一被稱為AI反欺騙魯棒性保證(Guarantee AI Robustness Against Deception,GARD)的網(wǎng)絡(luò)安全概念(計劃)的目的在于了解一種更為復(fù)雜的新型網(wǎng)絡(luò)攻擊。正如Siegelmann所說,這一研究“使得機器學(xué)習(xí)更敏感,使人工智能更強大且更有韌性。”

GARD計劃旨在開發(fā)解決新興入侵的方法。這些入侵意在“欺騙”、“混淆”或誤導(dǎo)它正在攻擊的機器學(xué)習(xí)系統(tǒng)。

Siegelmann說。:“這種攻擊可能涉及一種會向機器學(xué)習(xí)系統(tǒng)發(fā)送一些東西以使AI以一種不可預(yù)期的方式作出響應(yīng)的算法,實際上是混淆并欺騙算法強迫它做出決定。”

如果此類攻擊成功,攻擊者可以(比如說)指示AI系統(tǒng)允許攻擊者訪問受保護的網(wǎng)絡(luò),并如Siegelmann所比喻的那樣,“打開一扇門”。

Siegelmann根據(jù)輸入和輸出之間的某種協(xié)同作用對其進行了解釋。DARPA的一位官員說,這種方法使網(wǎng)絡(luò)安全能夠跟蹤并阻止比當(dāng)前常見手法更廣泛的攻擊方法。

DARPA官員在一份書面聲明中解釋道。:“當(dāng)前的防御工作旨在防范預(yù)先定義的特定對抗性攻擊。它們?nèi)菀讛〗o超出其測試設(shè)計參數(shù)的攻擊。GARD尋求以一種不同的方式來進行機器學(xué)習(xí)防御。“

雖然GARD的努力是基于(早已存在的)科學(xué)的,這一項目其實仍處于初級階段。DARPA剛剛向業(yè)界發(fā)出廣泛宣傳以征求意見,并計劃在今年12月前正式啟動該計劃。

Siegelmann補充說:“我們將促使AI更好地創(chuàng)建防御制度,通過保護現(xiàn)有機器或建設(shè)更新的機器學(xué)習(xí)模型,這樣我們就可以保護現(xiàn)有的機器學(xué)習(xí)方法了。”

-

AI

+關(guān)注

關(guān)注

87文章

31000瀏覽量

269333 -

機器學(xué)習(xí)

+關(guān)注

關(guān)注

66文章

8422瀏覽量

132740

原文標(biāo)題:AI和機器學(xué)習(xí)獲五角大樓”重用”,創(chuàng)建更強大的網(wǎng)絡(luò)防御制度

文章出處:【微信號:szwlw26059696,微信公眾號:物聯(lián)網(wǎng)之聲】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

相關(guān)推薦

傳統(tǒng)機器學(xué)習(xí)方法和應(yīng)用指導(dǎo)

替代GPS!美國五角大樓重金研發(fā)量子傳感器,這是最成熟的量子技術(shù)

美國將中微公司移出制裁清單

恩智浦eIQ AI和機器學(xué)習(xí)開發(fā)軟件增加兩款新工具

AI大模型與傳統(tǒng)機器學(xué)習(xí)的區(qū)別

RISC-V如何支持不同的AI和機器學(xué)習(xí)框架和庫?

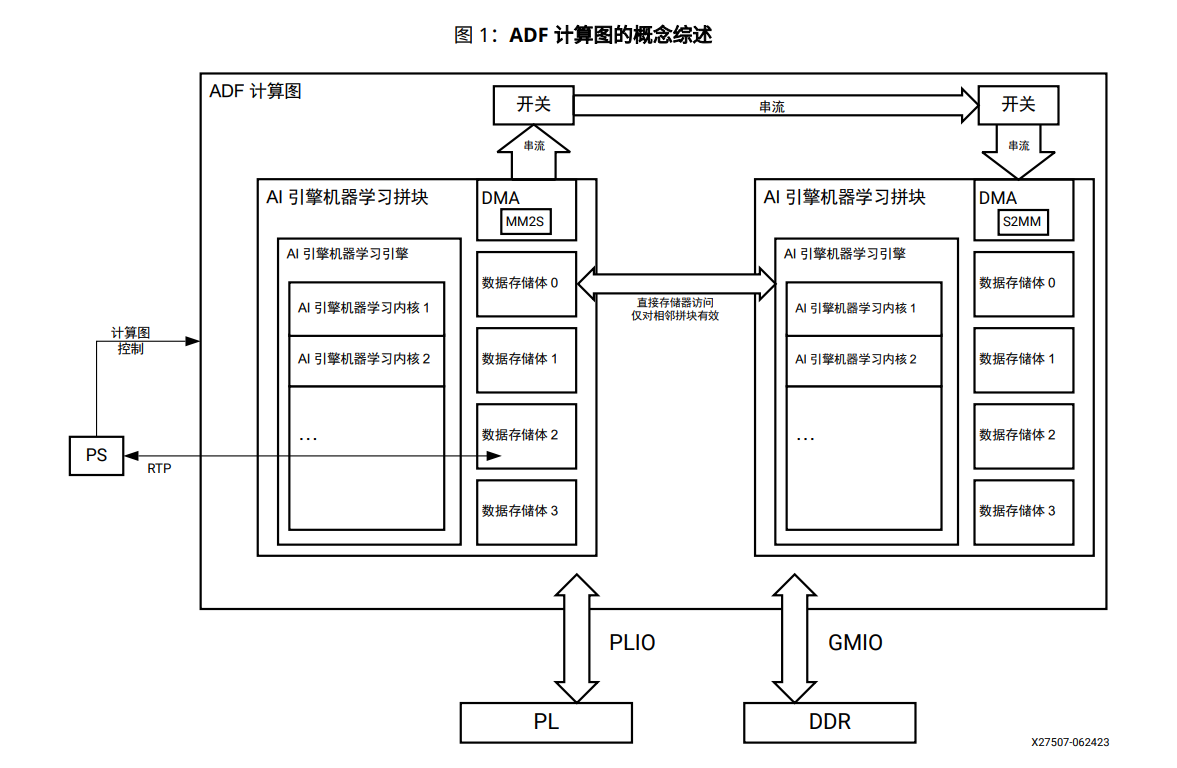

AI引擎機器學(xué)習(xí)陣列指南

邊緣AI網(wǎng)關(guān),將具備更強大的計算和學(xué)習(xí)能力

FPGA在深度學(xué)習(xí)應(yīng)用中或?qū)⑷〈鶪PU

DC3漏洞披露計劃已接獲5635份研究員報告,總數(shù)逾5萬

分析 丨AI算法愈加復(fù)雜,但是機器視覺的開發(fā)門檻在降低

AI和機器學(xué)習(xí)受五角大樓”重用”,以用來創(chuàng)建更強大的網(wǎng)絡(luò)防御制度

AI和機器學(xué)習(xí)受五角大樓”重用”,以用來創(chuàng)建更強大的網(wǎng)絡(luò)防御制度

評論