隨著高級輔助駕駛系統已經逐漸應用到大眾車型中,這一技術的安全性也受到越來越多的關注。

近日,騰訊科恩實驗室公布了一項在特斯拉 Model S 上進行的安全性研究,并發布報告指出了三個缺陷。其中包括一個與雨刷相關的視覺識別缺陷和兩個輔助駕駛相關的缺陷。

該團隊通過不同方法誤導車輛對環境、道路的感知,進而讓車輛作出“開啟雨刷”、“變道”的錯誤決策。此外,該團隊還通過攻擊輔助駕駛系統實現用游戲手柄控制車輛行進。

視頻|實驗過程展示(來源:騰訊科恩實驗室)

一、雨刷的視覺識別缺陷

正常情況下,特斯拉能夠在圖像識別技術的支持下,自動根據天氣狀況開啟雨刷功能并調節雨刷工作速度。

在實驗中,團隊將特斯拉停在一個室內環境中,在車輛前播放特定的干擾畫面,使車輛得出了下雨的錯誤判斷,導致雨刷自動啟動。實驗室表示,這是利用 AI 對抗樣本生成技術生成特定圖像并實現了對汽車的干擾,而在隨機生成的畫面中則不會出現這種情況。

(來源:騰訊科恩實驗室)

二、車道的視覺識別缺陷:三張紙片將特斯拉“騙”上錯誤路線。

特斯拉 Autopilot 輔助駕駛系統能夠識別道路上的車道線,進行沿道路行進和變道等操作。

在科恩實驗室發布的視頻演示中,道路特定位置上擺放三張小紙片,一般情況下人類駕駛員都難以輕易察覺紙片的存在,然而特斯拉在 Autopilot 駕駛模式下行駛到該位置時,突然作出轉向決策進入到隔壁的逆行車道。

(來源:騰訊科恩實驗室)

從結果上來看,紙片的放置干擾了車輛對車道的判斷,最終導致車輛作出如此離奇的決策。

騰訊團隊在報告中指出,在天氣識別和車道識別上,特斯拉都是基于視覺識別技術感知環境,再作出決策。團隊研究了特斯拉車道識別過程,在實際的道路上擺放了數個紙片,實現了物理上的對抗圖像攻擊(adversarial image attack),讓汽車產生了錯誤的車道判斷。

事實上,盡管機器學習在很多視覺識別任務上都有很好的表現,但同時也存在問題,機器學習易受到對抗樣本的干擾,甚至是一些人類難以察覺的擾動都會讓系統產生完全不同的判斷。此次特斯拉被誤導的實驗現象也符合這一原理。

對這一結果,特斯拉回應表示,這是人為改變了汽車所處的物理環境,引起了特斯拉行進的變化。在現實情況下,駕駛員的操作可以覆蓋 Autopilot 的決策。特斯拉再次強調駕駛員應該隨時準備好接管汽車。

三、遙控器操控車輛行駛

科恩實驗室此前曾利用漏洞獲得了 Model S(版本 2018.6.1)的 Autopilot 控制權,在最新的實驗中,團隊實現了在 Autopilot 系統沒有被車主主動開啟的情況下,也可以利用 Autopilot 功能實現通過游戲手柄對車輛行駛方向進行操控。

(來源:騰訊科恩實驗室)

對這一漏洞,特斯拉回應表示,報告里面提到的漏洞已在 2017 年的一次安全更新中修復了。此外,特斯拉稱多年來并沒有用戶反映有車輛被遙控器操控的案例出現。

在智能化程度越來越高的情況下,車上的系統漏洞成為一個越來越被重視的問題。事實上,所有的操作系統都無可避免地存在漏洞。在過去 4 年里,特斯拉一直進行著一個漏洞獎勵項目,對每個發現特斯拉漏洞人給予上萬美元的獎勵。而對于已經發現的漏洞,特斯拉則能在一次次的升級中進行修復。

不過話說回來,車輛的安全與用戶的人身安全息息相關, 特別是隨著自動駕駛技術的運用,在未來很長一段時間內,關于車輛系統安全問題的爭議還將一直持續下去。

而對于普通的車主來說,汽車智能化程度的提升毫無疑問能夠提升我們的用車體驗,但同時我們必須接受的是,自動駕駛系統可能永遠無法達到永不犯錯、無懈可擊的程度。因此,對輔助駕駛系統保持一個警惕的心,保持注意力、拿好方向盤,隨時將車輛掌握在自己手里才是正解。

-

特斯拉

+關注

關注

66文章

6313瀏覽量

126581 -

視覺識別

+關注

關注

3文章

89瀏覽量

16745

原文標題:三張貼紙"欺騙"一臺特斯拉,騰訊科恩實驗室指出Autopilot視覺識別缺陷

文章出處:【微信號:deeptechchina,微信公眾號:deeptechchina】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

開源項目 ! 利用邊緣計算打造便攜式視覺識別系統

【實戰】Python+OpenCV車道線檢測識別項目:實現L2級別自動駕駛必備(配套課程+平臺實踐)

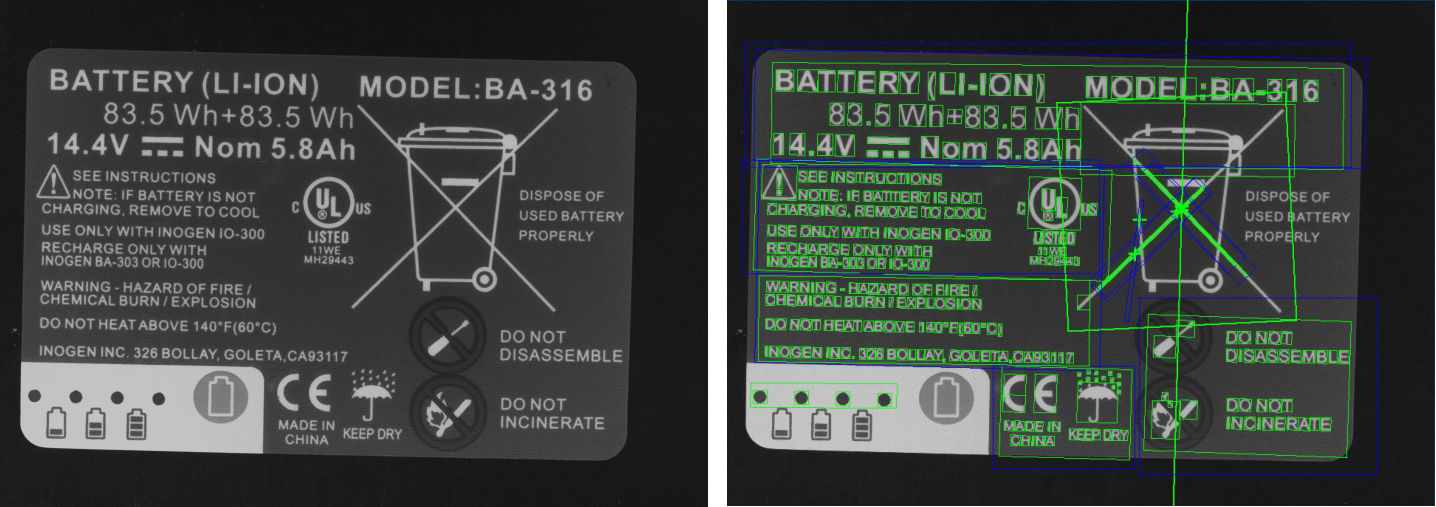

工業視覺在條碼/二維碼識別領域的應用

特斯拉智能駕駛|從視覺優先的技術路徑到未來的挑戰?

產品標簽OCR識別缺陷檢測系統方案

AIDI工業AI視覺檢測軟件介紹

機器視覺如何檢測橡膠圈外觀尺寸檢測?

機器視覺的圖像目標識別方法綜述

2023年工業視覺缺陷檢測經驗分享

視覺檢測設備的分類

機器視覺在織物缺陷圖像識別中的應用與分析

特斯拉因顯示字體錯誤召回219萬輛汽車

計算機視覺:AI如何識別與理解圖像

車道的視覺識別缺陷:三張紙片將特斯拉“騙”上錯誤路線

車道的視覺識別缺陷:三張紙片將特斯拉“騙”上錯誤路線

評論