說話,看起來是一件毫不費力的事情。但事實上,說話卻是人類執行的最復雜的活動之一。它需要精確、動態地協調聲道咬合結構中的肌肉、嘴唇、舌頭、喉部和下頜。

當由于中風、肌萎縮側索硬化癥或其他神經系統疾病而導致言語中斷時,喪失說話能力可能是毀滅性的。

昨天,Nature 雜志發表了加州大學舊金山分校的一項最新成果——該校神經外科華裔教授 Edward Chang 及同事開發出一種可以將腦活動轉化為語音的解碼器,創造了更接近能夠恢復說話功能的腦機接口。

腦機接口旨在幫助癱瘓患者直接從大腦中“讀取”他們的意圖,并利用這些信息控制外部設備或移動癱瘓的肢體,這項技術目前能夠使癱瘓的人每分鐘最多能打出8個單詞。

而這次Nature分享的方法,使用深度學習方法直接從大腦信號中產生口語句子,達到150個單詞,接近正常人水平。

馬斯克也擁有一家腦機接口公司。他認為,科學可以通過腦機接口擴大人類的能力。比如說,人們可以通過心靈感應來傳達復雜的概念,不再需要用語言來表達。

找到腦軀干里對語言與四肢控制的操縱區域是探索腦運動很重要的一步。日后也許我們會向情緒控制更進一步。這一步會更難,但是突破性理解腦的關鍵之一。

科幻小說中的未來真的能實現嗎?你覺得呢?以下,Enjoy:

本文綜合自/ DeepTech深科技(ID:deeptechchina)、新智元(ID:AI_era)

許多患有神經疾病的患者因喪失語言能力,需要依賴特定的通訊設備進行溝通,這類設備利用腦機接口或者頭部、眼睛的動作來控制光標選擇字母,從而說出他們想說的話。但是,這個過程比人類的正常語速慢得多,往往是在蹦單詞。

4 月 25 日,Nature 雜志發表了加州大學舊金山分校(University of California San Francisco)的一項最新成果,該校神經外科華裔教授 Edward Chang 及同事開發出一種可以將腦活動轉化為語音的解碼器。這套人類語音合成系統,通過解碼與人類下頜、喉頭、嘴唇和舌頭動作相關的腦信號,并合成出受試者想要表達的語音。

視頻 | 神經解碼的語音合成演示(來源:UCSF Neurosurgery)

研究人員表示,腦機接口正迅速成為恢復功能喪失的臨床可行手段,這項最新的研究成果解決了癱瘓和失語患者所面臨的重大挑戰,并可能是讓他們恢復“說話”能力的重要一步。

在Nature雜志同時配發的評論文章中,埃默里大學和佐治亞理工學院的 Chethan Pandarinath 和 Yahia Ali 認為,這種使用控制嘴唇、舌頭、喉部和下頜運動的神經信號合成語音的腦機接口設備,可以成為在失語者中恢復語音功能的奠基性工作。

解讀大腦的意圖

說話似乎是一件毫不費力的事,但實際上說話卻是人類執行的最復雜的活動之一。它需要精確、動態地協調聲道咬合結構中的肌肉、嘴唇、舌頭、喉部和下頜。

當一個人因中風、肌萎縮側索硬化(霍金即患此病)或其他神經系統疾病而喪失語言功能和溝通能力時,對他的影響和打擊可能是毀滅性的。

如果有一種技術,能將神經活動轉化為言語,那對于因神經損傷而無法溝通的人來說將具有變革性。理論上說,腦機接口技術可以通過直接從大腦“讀取”人的意圖,并使用該信息來控制外部設備或移動癱瘓的肢體,來幫助癱瘓的人完成說話或運動。

在科幻世界里,意念控制的實現可以順手拈來、輕而易舉。而在現實世界中,其背后的腦機接口技術已有近百年的歷史。

科學家們也一直希望在該領域實現科學研究與應用技術的突破,為許多當前仍無法解答的難題提供更好的探索工具,幫助人類進一步了解自己的大腦,進而預防、診斷、治療腦部疾病及其他重大疾病,并將這一技術廣泛應用于睡眠管理、智能生活和殘疾人康復等領域。

圖 | 使用特制語音合成器的史蒂芬·霍金(來源:newzpole.com)

目前,一些用于大腦控制打字的腦機接口技術,依賴于測量頭部或眼睛的殘余非語言運動,或者依賴于控制光標以逐個選擇字母并拼出單詞,已經可以幫助癱瘓的人通過設備每分鐘輸出多達 8 個單詞。

這些技術已經給有嚴重溝通障礙的患者帶來了巨大的生活改善,但與自然語音每分鐘 150 個單詞的平均速度比起來,現有技術的輸出速度還是太慢了,距離通過腦機接口實現自然語音的流暢交流還有很大差距。

直接通過大腦活動信號來合成語音,是一種頗有前景的替代方案。拼寫只是離散字母的連續串聯,而語音則是一種高效的通信形式。

與基于拼寫的方法相比,直接語音合成具有幾個主要優點。除了以自然語速傳遞無約束詞匯的能力之外,直接語音合成還能捕獲語音的韻律元素,例如音調、語調,這些是文本輸出所不具備的。

此外,當前替代通信設備的實際限制是學習和使用它們所需的認知努力。因此,對于由肌萎縮性側索硬化或腦干中風引起的癱瘓患者,通過直接記錄來自大腦皮層的神經控制信號來合成語音,是實現自然語言高通信速率的唯一手段,也是最直觀的方法。

2017 年, 本文作者 Edward Chang 以及他的研究生 Claire Tang 就曾在 Science 雜志發表論文,闡述大腦皮層顳上回神經元在語言中的重要性。研究發現了人類大腦中用于辨別相對聲調變化的神經元,這種神經元可以幫助人類在語言中明確表達感情、交流思想。

圖 | Edward Chang 教授(來源:UCSF)

但揭示大腦信號如何控制聲道發音部位的運動仍具有挑戰性。因為說話這一過程需要對聲道咬合部位進行非常精確和快速的多維控制。

而且,語音合成還存在一個與以往完全不同的挑戰,就是解碼聲道運動和聲音之間復雜的對應關系。自然語音產生涉及 100 多塊小肌肉,從肌肉運動到聲音的映射也不是一對一的。

每分鐘能夠生成150單詞,接近正常人類水平

加州大學舊金山分校的研究人員與5名志愿者合作,志愿者們接受了一項被稱為“顱內監測”的實驗,其中電極被用于監測大腦活動,作為癲癇治療的一部分。

許多癲癇患者的藥物治療效果并不好,他們選擇接受腦部手術。在術前,醫生必須首先找到病人大腦中癲癇發作的“熱點”,這一過程是通過放置在大腦內部或表面的電極來完成的,并監測明顯的電信號高峰。

精確定位“熱點”的位置可能需要數周時間。在此期間,患者通過植入大腦區域或其附近的電極來度日,這些區域涉及運動和聽覺信號。這些患者一般會同意利用這些植入物進行額外的實驗。

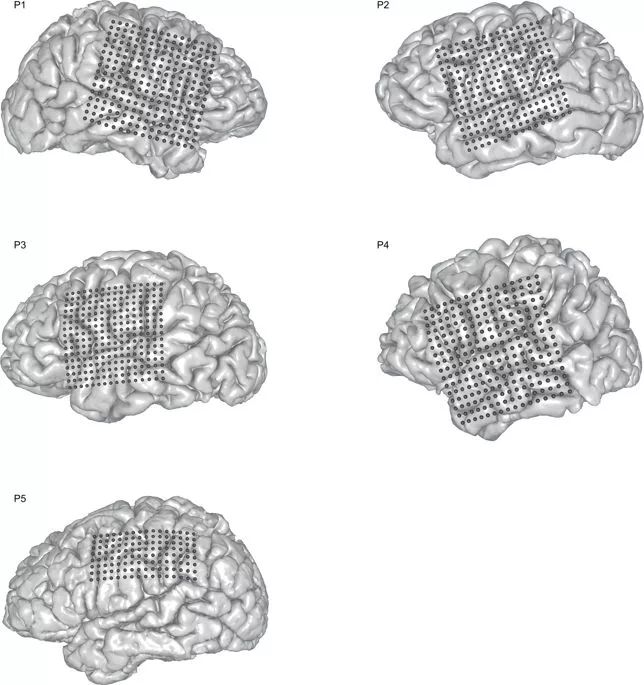

ECoG電極陣列由記錄大腦活動的顱內電極組成

此次招募的五名志愿者同意測試虛擬語音發生器。每個患者都植入了一兩個電極陣列:圖章大小的、包含幾百個微電極的小墊,放置在大腦表面。

實驗要求參與者背誦幾百個句子,電極會記錄運動皮層中神經元的放電模式。研究人員將這些模式與患者在自然說話時嘴唇,舌頭,喉部和下頜的微小運動聯系起來。然后將這些動作翻譯成口語化的句子。

參與的志愿者大腦中的電極陣列位置

實驗要求母語為英語的人聽這些句子,以測試虛擬語音的流暢性。研究發現,大約70%的虛擬系統生成的內容是可理解的。

最終,這套新系統每分鐘能夠生成150單詞,接近自然講話的語速水平。而以前基于植入物的通信系統每分鐘可以生成大約8個單詞。

合成能聽懂的語音

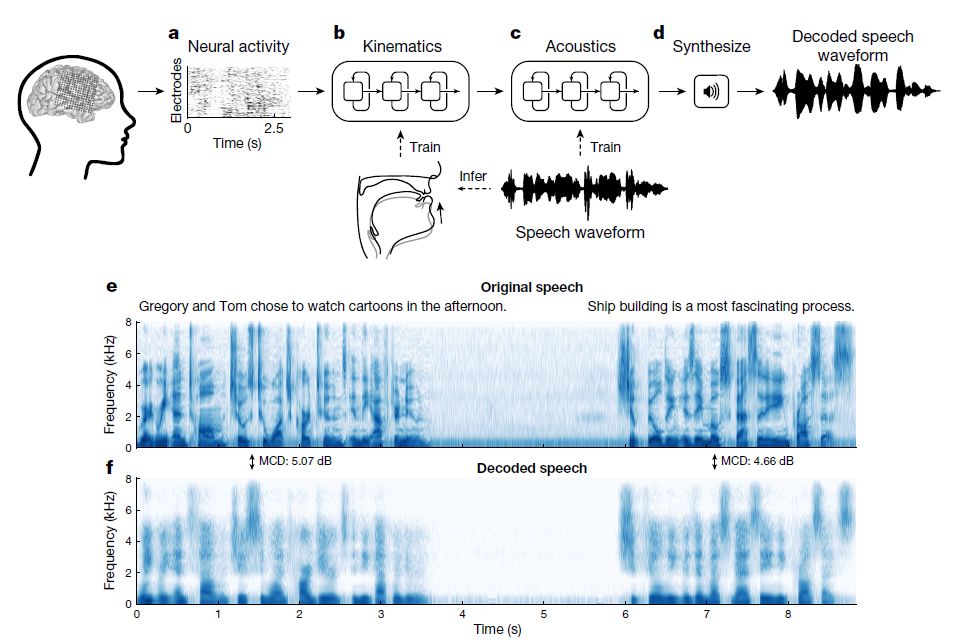

在Nature的這項最新研究中,為了實現將腦信號轉換為可理解的合成語音,并且是以流利說話者的速度輸出,研究人員設計了一種神經解碼器,明確地利用人類皮層活動中編碼的運動學和聲音表征來合成可聽語音。

研究人員招募 5 名正在接受癲癇治療的參與者,作為癲癇治療的一部分,他們會通過電極監測大腦活動。研究人員在 5 名受試者大聲說出幾百個句子時,記錄下他們的高密度腦電圖(ECoG)信號,并跟蹤控制語音和發生部位運動的大腦區域活動。

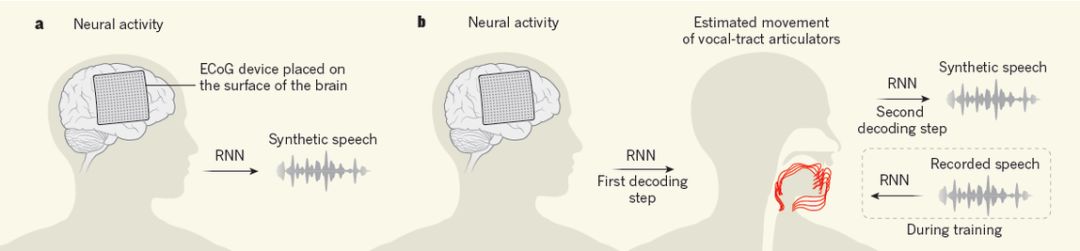

為了重建語音,研究人員設計了一種循環神經網絡(RNN),首先將記錄的皮質神經信號轉化為聲道咬合關節運動,然后將這些解碼的運動轉化為口語句子。

圖 | 用于語音合成的腦機接口(來源:Nature)

以前的語音合成研究采用了上圖 a 的方法,即使用腦電圖設備監測大腦語音相關區域的神經信號,并嘗試使用循環神經網絡將這些信號直接解碼為合成語音。

而 Edward Chang 以及同事開發了一種不同的方法,將解碼分為兩個步驟。

第一步,將神經信號轉換成聲道咬合部位的運動(紅色),這其中涉及語音產生的解剖結構(嘴唇、舌頭、喉和下頜)。而為了實現神經信號到聲道咬合部位運動的轉化,就需要大量聲道運動與其神經活動相關聯的數據。但研究人員又難以直接測量每個人的聲道運動,因此他們建立了一個循環神經網絡,根據以前收集的大量聲道運動和語音記錄數據庫來建立關聯。

第二步,將聲道咬合部位的運動轉換成合成語音。

圖 | 神經解碼語音合成過程(來源:Nature)

研究人員的這種兩步解碼方法,產生的語音失真率明顯小于使用直接解碼方法所獲得的語音。在包含 101 個句子的試驗中,聽者可以輕松地識別并記錄下合成的語音。

在另外的測試中,一名受試者首先按要求說出句子,然后再不出聲地做出相同的發音動作。結果表明,無聲言語的合成效果不如有聲言語,但是研究人員認為仍有可能解碼無聲言語的特征。

所有當前用于語音解碼的方法都需要使用發聲語音訓練解碼器,因此,基于這些方法的腦機接口技術也就不能讓不會說話的人上手就用。對于已經喪失說話能力的患者來說,無法發聲訓練解碼器是一個大問題。

但 Edward Chang 表示,雖然語音解碼的準確性大大降低,但受試者在沒有聲音的情況下模仿發音仍然可以進行語音合成。至于那些不再產生語音相關運動的個體是否適用這套最新的語音合成腦機接口系統,還需要未來的進一步研究。

Chethan Pandarinath 和 Yahia Ali 認為,無論是在語音重建的準確性方面,還是在聽眾對所產生語句的辨識力方面,Edward Chang 及其同事的研究結果都為語音合成腦機接口的概念驗證提供了令人信服的證據。

(來源:麻省理工科技評論)

不過,要使該系統真正成為一個臨床可行的語音合成腦機接口,還存在許多挑戰,畢竟重構語音的可懂度(intelligibility)仍遠低于自然語音。好在,通過收集更大的數據集并繼續開發基礎計算方法,或許可以進一步改善語音合成腦機接口技術。

由于不能直接在動物身上進行相關研究,這在一定程度上限制了人類語言產生的研究進展,但近十年來,隨著深度學習和人工神經網絡的出現,以及多學科協作的能力,從探索語言相關大腦區域的開創性臨床研究,到語音合成腦機接口的概念證明,都取得了引人注目的快速發展。

隨著語音合成腦機接口的概念證明,我們期待有關臨床試驗的早日開展,也期待那些語言障礙患者能夠早日重獲自由說話并與世界重新聯系的能力。

華裔科學家解碼,馬斯克腦機接口公司也會有新動作

Nature這篇文章的作者之一是加州大學舊金山分校神經外科教授Edward Chang博士。

Edward Chang博士的研究重點是言語、運動和人類情感的大腦機制,同時他也是加州大學舊金山分校和加州大學伯克利分校的合作單位——神經工程與假肢中心的聯合負責人。該中心匯集了工程、神經病學和神經外科方面的專家,以開發最先進的生物醫學技術,用以恢復神經系統殘疾患者的功能,如癱瘓和言語障礙。

Edward Chang博士表示,這次在Nature上的研究,“我們通過解碼大腦活動提升語音的清晰度,模擬的語音比從大腦中提取聲音表示的合成語音更準確、更自然。”

人類將大腦與計算機相連的努力越來越多。

上個月,美國一組科學家在biorxiv.org上發表一篇論文,稱找到了快速將電線植入大鼠大腦的方法,論文中描述這個過程是“向人類大腦直接插入計算機潛在系統邁出的重要一步”。

研究人員將他們的系統稱為“縫紉機”(sewing machine),科學家在實驗室中移除一塊老鼠的頭骨并插入一根針頭,將柔性電極送入老鼠的腦組織。

彭博新聞報道,這組科學家與馬斯克的腦機接口公司Neuralink有各種松散關聯。

Neuralink于2016年注冊為加州的一家醫學研究公司,該公司聘請了來自不同大學的幾位知名神經科學家,并與加州大學戴維斯分校的實驗室簽約,對靈長類動物進行研究。

本周三,當Twitter用戶詢問Neurink的進展時,馬斯克說,“可能會在幾個月內宣布一些值得注意的事情。”

馬斯克認為,腦機接口技術能在2021年之前治療嚴重的腦損傷。此外,科學可以通過腦機接口擴大人類的能力。他舉了一個例子:人們可以通過心靈感應來傳達復雜的概念,“你不需要用語言表達”。

人類是否有一天會與機器合并?馬斯克認為,人類已經在某種程度上做到了這一點,因為智能手機等近乎無所不在的技術,因此腦機接口這項工作應該繼續下去。

這可能會導致科幻未來,因為人們可以在腦海中下載外語,你覺得呢?

-

解碼

+關注

關注

0文章

182瀏覽量

27412 -

人工智能

+關注

關注

1793文章

47567瀏覽量

239426 -

語音合成

+關注

關注

2文章

90瀏覽量

16178

原文標題:人工智能可以“讀取”你的大腦了

文章出處:【微信號:jingzhenglizixun,微信公眾號:機器人博覽】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

人工智能可以“讀取”你的大腦了

人工智能可以“讀取”你的大腦了

評論