最常見的機器學習算法是學習映射Y = f(X)來預測新X的Y,這叫做預測建模或預測分析,我們的目標是盡可能作出最準確的預測。 我們不知道函數f的樣子或形式,如果知道的話,我們將會直接使用它,不需要用機器學習算法從數據中學習。

下面將概述常用的機器學習算法:

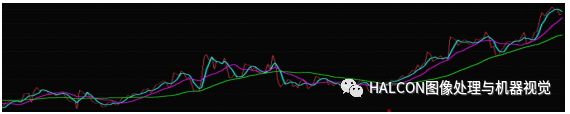

1、線性回歸

線性回歸的表示是一個方程,它通過找到輸入變量的特定權重(稱為系數B),來描述一條最適合表示輸入變量x與輸出變量y關系的直線。可能是統計學和機器學習中最知名和最易理解的算法之一,預測建模主要關注最小化模型誤差或者盡可能作出最準確的預測,以可解釋性為代價。

2、Logistic回歸

Logistic回歸與線性回歸相似,目標都是找到每個輸入變量的權重,即系數值。與線性回歸不同的是,Logistic回歸對輸出的預測使用被稱為 logistic 函數的非線性函數進行變換。 它是一個快速的學習模型,并且對于二分類問題非常有效。

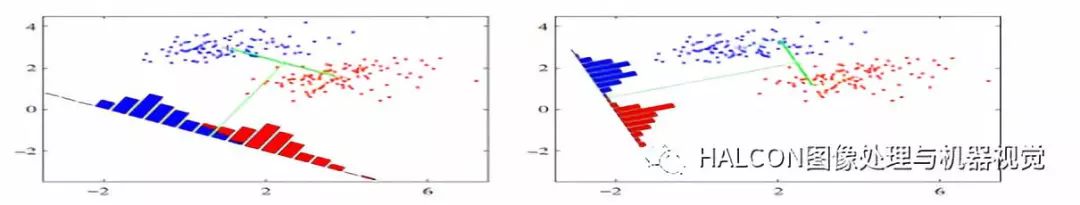

3、線性判別分析(LDA)

線性判別分析進行預測的方法是計算每個類別的判別值,并對具備最大值的類別進行預測。該技術假設數據呈高斯分布,因此最好預先從數據中刪除異常值。這是處理分類預測建模問題的一種簡單而強大的方法。

4、分類與回歸樹

決策樹的葉節點包含一個用于預測的輸出變量y,通過遍歷該樹的分割點,直到到達一個葉節點并輸出該節點的類別值就可以作出預測。決策樹模型的表示是一個二叉樹,學習速度和預測速度都很快,可以解決大量問題,并且不需要對數據做特別準備。

5、樸素貝葉斯

樸素貝葉斯是一個簡單但是很強大的預測建模算法,該模型由兩種概率組成,這兩種概率都可以直接從訓練數據中計算出來:1)每個類別的概率;2)給定每個x的值,每個類別的條件概率。如果數據是實值時,通常假設一個高斯分布,這樣可以簡單的估計這些概率。

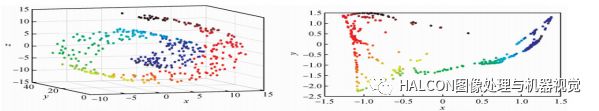

6、K近鄰算法

KNN 算法在整個訓練集中搜索K個最相似實例(近鄰)并匯總這 K 個實例的輸出變量,以預測新數據點。KNN需要大量內存或空間來存儲所有數據,但是只有在需要預測時才執行計算(或學習)。可以隨時更新和管理訓練實例,以保持預測的準確性。

7、學習向量量化

學習向量量化(簡稱 LVQ)是一種人工神經網絡算法,它允許你選擇訓練實例的數量,并精確地學習這些實例應該是什么樣的。在學習之后,最相似的近鄰通過計算每個碼本向量和新數據實例之間的距離找到。然后返回最佳匹配單元的類別值作為預測。

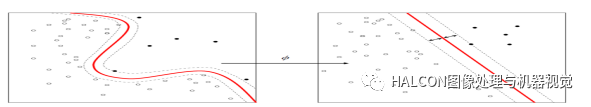

8、支持向量機(SVM)

超平面是分割輸入變量空間的一條線,超平面和最近的數據點之間的距離被稱為間隔,分開兩個類別的最好的或最理想的超平面具備最大間隔。實際上,優化算法用于尋找最大化間隔的系數的值。

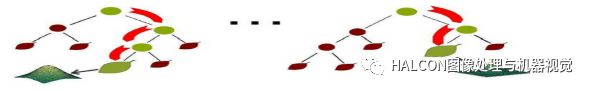

9、Bagging

Bagging 是從數據樣本中估算數量的一種強大的統計方法。在訓練數據中抽取多個樣本,然后對每個數據樣本建模。當你需要對新數據進行預測時,每個模型都進行預測,并將所有的預測值平均以便更好的估計真實的輸出值。

10、隨機森林

隨機森林是對Bagging方法的一種調整,在隨機森林的方法中決策樹被創建以便于通過引入隨機性來進行次優分割,而不是選擇最佳分割點。針對每個數據樣本創建的模型將會與其他方式得到的有所不同,可以更好的估計真實的輸出值。

-

算法

+關注

關注

23文章

4713瀏覽量

95536 -

建模

+關注

關注

1文章

317瀏覽量

61618 -

機器學習

+關注

關注

66文章

8507瀏覽量

134731

原文標題:機器學習十大算法

文章出處:【微信號:NeXt8060,微信公眾號:HALCON圖像處理與機器視覺】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

華邦電子總結芯片行業十大黑話

【「# ROS 2智能機器人開發實踐」閱讀體驗】視覺實現的基礎算法的應用

十大鮮為人知卻功能強大的機器學習模型

機器學習模型市場前景如何

年度電解槽十大品牌+年度制氫十大供應商,穩石氫能榮獲兩大獎項!

華為發布2025智能光伏十大趨勢

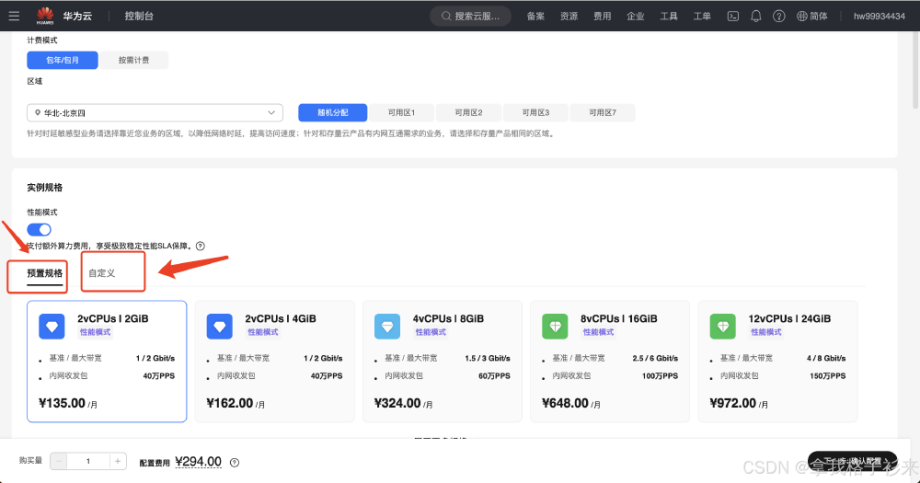

華為云 Flexus X 實例部署安裝 Jupyter Notebook,學習 AI,機器學習算法

NPU與機器學習算法的關系

人工智能、機器學習和深度學習存在什么區別

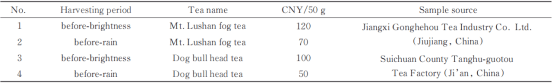

LIBS結合機器學習算法的江西名優春茶采收期鑒別

中國信通院發布“2024云計算十大關鍵詞”

評論