神經網絡結構是提高深度神經網絡性能的基礎。研究人員開發出了首個通過語法引導的神經網絡生成器AOGNets,它能更有效地在原始數據中提取信息,在圖像分類、目標檢測和分割方面的表現優于包括ResNets、DenseNets、ResNeXts和DualPathNets在內最先進的神經網絡。

北卡羅萊納州立大學的研究人員開發了一個通過語法指導的網絡生成器來打造深度神經網絡的新框架。在實驗測試中,被稱為AOGNets的新網絡在視覺識別任務方面優于現有的最先進的框架,包括廣泛使用的ResNet和DenseNet系統。

作為這項研究中一篇論文的作者,北卡羅萊納州立大學電子與計算機工程副教授吳田富博士說:“與我們對比過的任何一個網絡相比,AOGNets都具有更好的預測精度。” AOGNets也更容易解釋,這意味著用戶可以看到系統是如何得出結論的。”

新框架對系統架構使用了一個組合語法方法,該方法可以從以前的網絡系統上獲取最佳實踐,從而更有效地從原始數據中提取有用的信息。

吳教授說:“我們發現,層次和組合語法為我們提供了一種簡單、優雅的方法來統一以前系統架構所采用的方法,據我們所知,這是第一個將語法用于網絡生成的成果。”

為了測試他們的新框架,研究人員開發了AOGNets,并將其用三個圖像分類基準(CIFAR-10、CIFAR-100和ImageNet-1K)進行了測試。

“在公平比較下,AOGNets的表現明顯優于其他所有最先進的網絡,包括ResNets, DenseNets, ResNeXts和DualPathNets。” 吳田富說:”利用圖像網絡中的網絡剖分度量,AOGNets獲得了最高的模型可解釋性分。AOGNets在對抗性防御和平臺不可知( platform-agnostic)部署(移動vs云)方面進一步顯示出巨大的潛力。”

研究人員還使用vanilla Mask R-CNN系統在微軟Coco基準測試中測試了AOGNets在目標檢測和實例語義分割方面的表現。

“在模型尺寸更小、推理時間相似或更短的情況下,AOGNets比ResNet和ResNeXt獲得了更好的結果。” 吳教授表示:“結果表明,在目標檢測和分割任務中,AOGNets具有較好的學習效果。”

這些測試是相關的,因為圖像分類是視覺識別的核心基礎任務之一,而ImageNet是標準的大規模分類基準。同樣,目標檢測和分割是兩個核心的高級視覺任務,而MS-COCO是最廣泛使用的基準之一。

“為了評估用于視覺識別中進行深度學習的新網絡體系結構,它們是黃金試驗臺。” 吳田富說道:“AOGNets是在一個有原則的語法框架下開發的,并在ImageNet和MS-COCO下都得到了顯著的改進,從而對許多實際應用中的表示學習顯示出潛在的廣泛和深刻的影響。”

-

神經網絡

+關注

關注

42文章

4789瀏覽量

101608 -

視覺識別

+關注

關注

3文章

90瀏覽量

16849

原文標題:AOGNets:首個語法生成網絡,視覺識別優于當前最先進框架

文章出處:【微信號:AI_era,微信公眾號:新智元】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

《AI Agent 應用與項目實戰》閱讀心得2——客服機器人、AutoGen框架 、生成式代理

Google兩款先進生成式AI模型登陸Vertex AI平臺

開源項目 ! 利用邊緣計算打造便攜式視覺識別系統

一種降低VIO/VSLAM系統漂移的新方法

庫克稱iPhone16是最先進的iPhone

基于迅為RK3588開發板的AI圖像識別方案

生成對抗網絡(GANs)的原理與應用案例

Transformer模型在語音識別和語音生成中的應用優勢

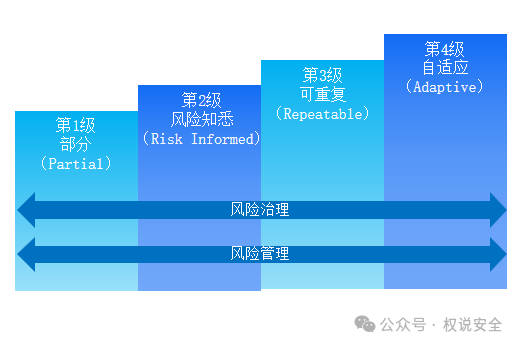

專家解讀 | NIST網絡安全框架(3):層級配置

CubeIDE生成的代碼框架會卡在MX_X_CUBE_AI_Process()函數中是怎么回事?

螞蟻集團發布首個開源金融場景多智能體框架

基于毫米波雷達的手勢識別神經網絡

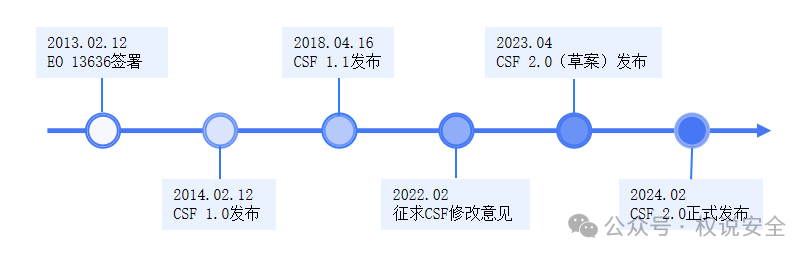

專家解讀 | NIST網絡安全框架(1):框架概覽

首個語法生成網絡 視覺識別優于當前最先進框架

首個語法生成網絡 視覺識別優于當前最先進框架

評論