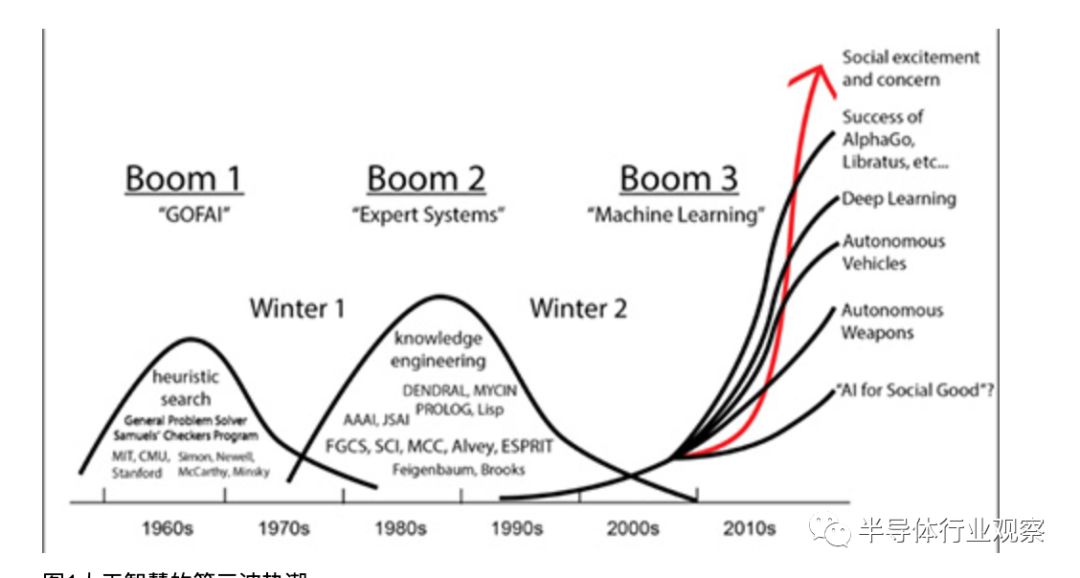

近年來(lái)科技熱潮一波接一波,2013年、2014年開(kāi)始倡議物聯(lián)網(wǎng)、穿戴式電子,2016年開(kāi)始人工智能,2018年末則為5G。人工智能過(guò)往在1950年代、1980年代先后熱議過(guò),但因多項(xiàng)技術(shù)限制與過(guò)度期許而回復(fù)平淡,2016年隨云端資料日多與影音辨識(shí)需求再次走紅(圖1)。

圖1人工智能的第三波熱潮。

人工智能的運(yùn)用分成兩個(gè)階段,一是學(xué)習(xí)訓(xùn)練階段,二是推理階段,此與應(yīng)用程序相類似,程序開(kāi)發(fā)階段即為學(xué)習(xí)訓(xùn)練階段,程序正式上線執(zhí)行運(yùn)作則為推理階段。開(kāi)發(fā)即是船艦在船塢內(nèi)打造或維修,執(zhí)行則為船艦出海航行作業(yè)執(zhí)勤(圖2)。

圖2人工智能訓(xùn)練與推理的差別。

訓(xùn)練與推理階段對(duì)運(yùn)算的要求有所不同,訓(xùn)練階段需要大量繁復(fù)的運(yùn)算,且為了讓人工智能模型獲得更佳的參數(shù)調(diào)整數(shù)據(jù),運(yùn)算的精準(zhǔn)細(xì)膩度較高,而推理階段則相反,模型已經(jīng)訓(xùn)練完成,不再需要龐大運(yùn)算量,且為了盡快獲得推理結(jié)果,允許以較低的精度運(yùn)算。

例如一個(gè)貓臉辨識(shí)應(yīng)用,訓(xùn)練階段要先提供成千上萬(wàn)張各種帶有貓臉的照片來(lái)訓(xùn)練,并從中抓出各種細(xì)膩辨識(shí)特點(diǎn),但真正設(shè)置在前端負(fù)責(zé)辨識(shí)來(lái)者是否為貓的推理運(yùn)算,只是辨識(shí)單張臉,運(yùn)算量小,且可能已簡(jiǎn)化特征,只要簡(jiǎn)單快速運(yùn)算即可得到結(jié)果(是貓或不是)。

推理專用芯片需求顯現(xiàn)

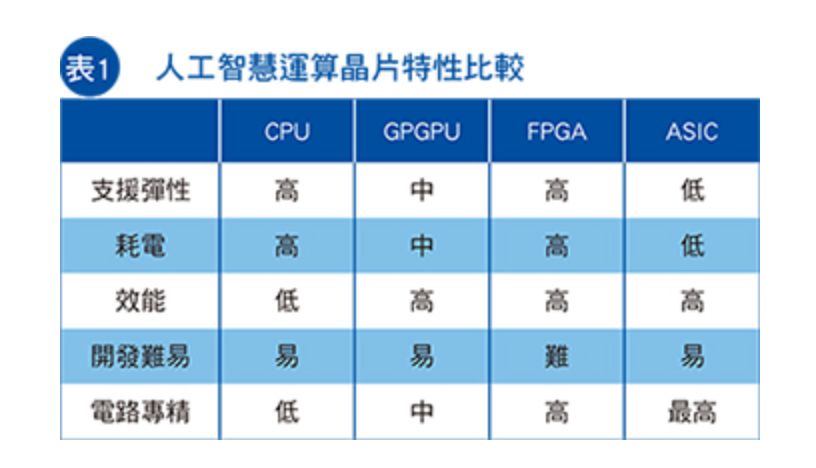

對(duì)于人工智能的訓(xùn)練、推理運(yùn)算,近年來(lái)已普遍使用CPU之外的芯片來(lái)加速,例如GPGPU、FPGA、ASIC等,特別是GPGPU為多,原因在于GPGPU的高階軟體生態(tài)較為完備、可支援多種人工智能框架(Framework),相對(duì)的FPGA需要熟悉低階硬體電路者方能開(kāi)發(fā),而ASIC通常只針對(duì)限定的軟體或框架最佳化(表1)。雖然FPGA與ASIC較有難度與限制,但仍有科技大廠愿意投入,如Microsoft即主張用FPGA執(zhí)行人工智能運(yùn)算,Google則針對(duì)TensorFlow人工智能框架開(kāi)發(fā)ASIC,即Cloud TPU芯片。

人工智能模型的開(kāi)發(fā)(訓(xùn)練)與執(zhí)行(推理)過(guò)往多使用同一芯片,用該芯片執(zhí)行訓(xùn)練運(yùn)算后也用該芯片執(zhí)行推理運(yùn)算。但近1、2年來(lái)隨著訓(xùn)練成果逐漸增多,成熟的人工智能模型逐漸普及,以相同芯片負(fù)責(zé)推理運(yùn)算的缺點(diǎn)逐漸浮現(xiàn)。以GPGPU而言,芯片內(nèi)具備大量的平行運(yùn)算單元是針對(duì)游戲繪圖、專業(yè)繪圖或高效能運(yùn)算而設(shè)計(jì),可運(yùn)算32、64位元浮點(diǎn)數(shù),這在人工智能模型訓(xùn)練階段亦適用,但到推理階段,可能只需16位元浮點(diǎn)、16位元整數(shù)、8位元整數(shù)等運(yùn)算即可求出推理結(jié)果,甚至是4位元整數(shù)便足夠。如此過(guò)往的高精度大量平行運(yùn)算單元便大材小用,電路與功耗均有所浪費(fèi),所以需要人工智能的推理專用處理芯片。

半導(dǎo)體廠紛發(fā)展推理芯片

推理芯片的需求在人工智能重新倡議后的2年開(kāi)始浮現(xiàn),但在此之前已有若干產(chǎn)品,如2014年Google對(duì)外揭露的探戈專案(Project Tango)即使用Movidius公司的Myriad芯片(圖3)。

圖3 Intel Movidius Myriad X芯片

Movidius之后于2016年推出Myriad 2芯片,同樣也在2016年,Intel購(gòu)并Movidius取得Myriad 1/2系列芯片,并接續(xù)推出Myriad X芯片。Google除探戈專案外其他硬體也采用Intel/Movidius芯片,如2017年的Google Clips人工智能攝影機(jī)、2018年Google AIY Vision人工智能視覺(jué)應(yīng)用開(kāi)發(fā)套件等。

不過(guò)真正受業(yè)界矚目的仍在2018年,包含NVIDIA推出T4芯片(嚴(yán)格而論是已帶芯片的加速介面卡)(圖4)、Google推出Edge TPU芯片(圖5),以及Amazon Web Services在2018年11月宣告將在2019年推出Inferentia芯片,均為推理型芯片。

圖4 NVIDIA展示T4介面卡

圖5 Google Edge TPU小于一美分銅板。

另外,臉書(shū)(Facebook)也已經(jīng)意識(shí)到各形各色的推理型芯片將會(huì)在未來(lái)幾年內(nèi)紛紛出籠,為了避免硬體的多元分歧使軟體支援困難,因此提出Glow編譯器構(gòu)想,期望各人工智能芯片商能一致支援該編譯標(biāo)準(zhǔn),目前Intel、Cadence、Marvell、Qualcomm、Esperanto Technologies(人工智能芯片新創(chuàng)業(yè)者)均表態(tài)支持。

與此同時(shí),臉書(shū)也坦承開(kāi)發(fā)自有人工智能芯片中,并且將與Intel技術(shù)合作;目前臉書(shū)技術(shù)高層已經(jīng)表示其芯片與Google TPU不相同,但是無(wú)法透露更多相關(guān)的技術(shù)細(xì)節(jié)。而Intel除了在2016年購(gòu)并Movidius之外,在同一年也購(gòu)并了另一家人工智能技術(shù)業(yè)者Nervana System,Intel也將以Nervana的技術(shù)發(fā)展推理芯片。

推理芯片不單大廠受吸引投入新創(chuàng)業(yè)者也一樣積極,Habana Labs在2018年9月對(duì)特定客戶提供其推理芯片HL-1000的工程樣品,后續(xù)將以該芯片為基礎(chǔ)產(chǎn)制PCIe介面的推理加速卡,代號(hào)Goya。Habana Labs宣稱HL-1000是目前業(yè)界最快速的推理芯片(圖6)。

圖6 Habana Labs除推出HL-1000推理芯片Goya外也推出訓(xùn)練芯片Gaudi。

云端機(jī)房/快速反應(yīng)推理芯片可分兩種取向

透過(guò)前述可了解諸多業(yè)者均已投入發(fā)展推理芯片,然嚴(yán)格而論推理芯片可分成兩種取向,一是追求更佳的云端機(jī)房效率,另一是更快速即時(shí)反應(yīng)。前者是將推理芯片安置于云端機(jī)房,以全職專精方式執(zhí)行推理運(yùn)算,與訓(xùn)練、推理雙用型的芯片相比,更省機(jī)房空間、電能與成本,如NVIDIA T4。

后者則是將推理芯片設(shè)置于現(xiàn)場(chǎng),例如配置于物聯(lián)網(wǎng)閘道器、門(mén)禁攝影機(jī)內(nèi)、車用電腦上,進(jìn)行即時(shí)的影像物件辨識(shí),如Intel Movidius Myriad系列、Google Edge TPU等。

設(shè)置于機(jī)房?jī)?nèi)的推理芯片由于可自電源插座取得源源不絕的電能,因此仍有數(shù)十瓦用電,如NVIDIA T4的TDP(Thermal Design Power)達(dá)70瓦,相對(duì)的現(xiàn)場(chǎng)設(shè)置的推理芯片必須適應(yīng)各種環(huán)境可能,例如僅以電池供電運(yùn)作,因此盡可能節(jié)約電能,如Google Edge TPU的TDP僅1.8瓦。現(xiàn)場(chǎng)型目前觀察僅有車用例外,由于汽車有蓄電瓶可用,電能充沛性居于電池與電源插座間,因此芯片功耗表現(xiàn)可高些。

為能快速反應(yīng)推理芯片精度須調(diào)整

如前所述,推理芯片為能即時(shí)快速求解,通常會(huì)采較低精度進(jìn)行運(yùn)算,過(guò)去過(guò)于高效能運(yùn)算的64位元雙精度浮點(diǎn)數(shù)(Double Precision, DP),或用于游戲與專業(yè)繪圖的32位元單精度浮點(diǎn)數(shù)(Single Precision, SP)可能都不適用,而是降至(含)16位元以下的精度。

例如Intel Movidius Myriad X原生支援16位元浮點(diǎn)數(shù)(新稱法為半精度Half-Precision, HP)與8位元整數(shù);Google Edge TPU則只支援8位元、16位元整數(shù),未支援浮點(diǎn)數(shù);NVIDIA T4則支援16與32位元浮點(diǎn)數(shù)外,也支援8位元與4位元整數(shù)。

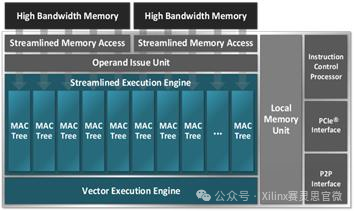

進(jìn)一步的,推理芯片可能同時(shí)使用兩種以上的精度運(yùn)算,例如NVIDIA T4可同時(shí)執(zhí)行16位元浮點(diǎn)數(shù)與32位元浮點(diǎn)數(shù)的運(yùn)算,或者尚未推出的AWS Inferentia宣稱將可同時(shí)執(zhí)行8位元整數(shù)與16位元浮點(diǎn)數(shù)的運(yùn)算(圖7),同時(shí)使用兩種以上精度的作法亦有新詞,稱為混精度(Mixed Precision, MP)運(yùn)算。

圖7 AWS預(yù)告2019年將推出自家推理芯片Inferentia,將可同時(shí)推算整數(shù)與幅點(diǎn)數(shù)格式。圖片來(lái)源:AWS

上述不同位元表達(dá)長(zhǎng)度的整數(shù)、浮點(diǎn)數(shù)格式,一般寫(xiě)成INT4(Integer)、INT8、FP16、FP32(Float Point)等字樣,另也有強(qiáng)調(diào)可針對(duì)不帶正負(fù)表達(dá),單純正整數(shù)表達(dá)的格式運(yùn)算,如Habana Labs的HL-1000強(qiáng)調(diào)支援INT8/16/32之余,也支援UINT8/16/32格式,U即Unsigned之意。

推理芯片雖然支援多種精度格式,然精度愈高運(yùn)算效能也會(huì)較低,以NVIDIA T4為例,在以INT4格式推算下可以有260 TOPS的效能,亦即每秒有260個(gè)Tera(10的12次方)運(yùn)算,而改以INT8格式時(shí)則效能減半,成為130 TOPS,浮點(diǎn)格式也相同,以FP16格式運(yùn)算的效能為65 TFOPS(F=Float),而以FP32格式運(yùn)算則降至8.1 TFLOPS,浮點(diǎn)格式的位元數(shù)增加一倍效能退至1/8效能,比整數(shù)退減程度高。

推理芯片前景仍待觀察芯片商須步步為營(yíng)

推理芯片是一個(gè)新市場(chǎng),重量級(jí)芯片業(yè)者與新興芯片商均積極投入發(fā)展,但就數(shù)個(gè)角度而言其后續(xù)發(fā)展難以樂(lè)觀,主要是超規(guī)模(Hyperscale)云端機(jī)房業(yè)者自行投入發(fā)展。

例如Google在云端使用自行研發(fā)的Cloud TPU芯片,針對(duì)Google提出的人工智能框架TensorFlow最佳化,如此便限縮了Intel、NVIDIA的機(jī)會(huì)市場(chǎng)(雖然2019年1月NVIDIA T4已獲Google Cloud采用并開(kāi)放Beta服務(wù))。而Google也在2018年提出針對(duì)人工智能框架TensorFlow Lite最佳化的Edge TPU,如此也可能排擠過(guò)往已使用的Intel Movidius芯片。

類似的,臉書(shū)過(guò)去使用NVIDIA Tesla芯片,但隨著臉書(shū)力主采行PyTorch技術(shù),以及與Intel合作發(fā)展人工智能芯片,未來(lái)可能減少購(gòu)置NVIDIA芯片。而Intel與臉書(shū)合作開(kāi)發(fā),也意味著臉書(shū)無(wú)意購(gòu)置Intel獨(dú)立自主發(fā)展的人工智能芯片,即便Intel于此合作中獲得收益,也比全然銷售完整芯片來(lái)得少,Intel須在技術(shù)上有所讓步妥協(xié),或提供客制服務(wù)等。

AWS方面也相同,AWS已宣告發(fā)展自有推理芯片,此意味著NVIDIA T4的銷售機(jī)會(huì)限縮,其他業(yè)者的推理芯片也失去一塊大商機(jī)。AWS同樣有其人工智能技術(shù)主張,如MXNet。

如此看來(lái),人工智能芯片的軟體技術(shù)主導(dǎo)權(quán)與芯片大買(mǎi)家,均在超規(guī)模機(jī)房業(yè)者身上,芯片商獨(dú)立研發(fā)、獨(dú)立供應(yīng)人工智能芯片的機(jī)會(huì)將降低,未來(lái)遷就超規(guī)模機(jī)房業(yè)者,對(duì)其提供技術(shù)合作與客制的可能性增高。因此推理芯片會(huì)以企業(yè)為主要市場(chǎng),多數(shù)企業(yè)面對(duì)芯片商并無(wú)議價(jià)能力、技術(shù)指導(dǎo)能力,仍會(huì)接受芯片商自主研發(fā)銷售的芯片。

訓(xùn)練/推理兩極化

除了推理芯片市場(chǎng)外,人工智能的訓(xùn)練芯片市場(chǎng)也值得觀察,由于人工智能應(yīng)用的開(kāi)發(fā)、訓(xùn)練、參數(shù)調(diào)整等工作并非時(shí)時(shí)在進(jìn)行,通常在歷經(jīng)一段時(shí)間的密集開(kāi)發(fā)訓(xùn)練后回歸平淡,直到下一次修改調(diào)整才再次進(jìn)入密集運(yùn)算。類似船只多數(shù)時(shí)間出海航行,僅少數(shù)時(shí)間進(jìn)入船塢整修,或軟體多數(shù)時(shí)間執(zhí)行,少數(shù)時(shí)間進(jìn)行改版修補(bǔ)。

因此,企業(yè)若為了人工智能應(yīng)用的開(kāi)發(fā)訓(xùn)練購(gòu)置大量的伺服器等運(yùn)算力,每次訓(xùn)練完成后,大量的伺服器將閑置無(wú)用,直到下一次參數(shù)調(diào)整、密集訓(xùn)練時(shí)才能再次顯現(xiàn)價(jià)值。鑒于此,許多企業(yè)傾向?qū)⒚芗?xùn)練的運(yùn)算工作交付給云端服務(wù)供應(yīng)商,依據(jù)使用的運(yùn)算量、運(yùn)算時(shí)間付費(fèi),而不是自行購(gòu)置與維護(hù)龐大運(yùn)算系統(tǒng),如此訓(xùn)練芯片的大買(mǎi)家也會(huì)是云端服務(wù)商。

不過(guò)企業(yè)須要時(shí)時(shí)運(yùn)用人工智能的推理運(yùn)算,如制造業(yè)的生產(chǎn)良率檢測(cè)、醫(yī)療業(yè)的影像診斷等,部份推理運(yùn)算不講究即時(shí)推算出結(jié)果,亦可拋丟至云端運(yùn)算,之后再回傳運(yùn)算結(jié)果,但追求即時(shí)反應(yīng)者仍須要在前端現(xiàn)場(chǎng)設(shè)置推算芯片,此即為一可爭(zhēng)取的市場(chǎng),除了獨(dú)立的芯片商Intel、NVIDIA積極外,云端業(yè)者也在爭(zhēng)取此市場(chǎng),如Google已宣布Edge TPU不僅自用也將對(duì)外銷售,國(guó)內(nèi)的工控電腦業(yè)者已有意配置于物聯(lián)網(wǎng)閘道器中。

由此看來(lái),人工智能軟體技術(shù)的標(biāo)準(zhǔn)走向、訓(xùn)練芯片的大宗買(mǎi)家、訓(xùn)練的運(yùn)算力服務(wù)等均為超規(guī)模業(yè)者,加上推理芯片的自主化,推理與訓(xùn)練的前后整合呼應(yīng)等,均不利芯片商的發(fā)展,芯片商與超規(guī)模業(yè)者間在未來(lái)數(shù)年內(nèi)必須保持亦敵亦友的態(tài)勢(shì),一方面是大宗芯片的買(mǎi)家,另一方面是技術(shù)的指導(dǎo)者、潛在的芯片銷售競(jìng)爭(zhēng)者。

所以,未來(lái)的企業(yè)將會(huì)減少購(gòu)置訓(xùn)練用的人工智能芯片,并盡可能的使用云端運(yùn)算力進(jìn)行短暫且密集的訓(xùn)練;而對(duì)于時(shí)時(shí)與現(xiàn)場(chǎng)營(yíng)運(yùn)連結(jié)的部份,則會(huì)配置推理用芯片,且以即時(shí)反應(yīng)、低功耗的推理芯片為主。至于機(jī)房端的推理芯片,仍然會(huì)是云端業(yè)者為主要采購(gòu)者,次之為大企業(yè)為自有機(jī)房而添購(gòu),以增進(jìn)機(jī)房運(yùn)算效率為主。

由上述來(lái)看似乎云端服務(wù)商占足優(yōu)勢(shì),不過(guò)科技持續(xù)變化中,目前已有人提出供需兩端均分散的作法,即家家戶戶釋出閑置未用的CPU、GPU運(yùn)算力,匯集成龐大的單一運(yùn)算力,供有密集訓(xùn)練需求的客戶使用。

此作法甚至導(dǎo)入區(qū)塊鏈技術(shù),供需雙方采代幣系統(tǒng)運(yùn)作,需要運(yùn)算力者購(gòu)買(mǎi)數(shù)位代幣,釋出運(yùn)算力者可獲得代幣,代幣再透過(guò)市場(chǎng)交易機(jī)制與各地的法定發(fā)行貨幣連結(jié),如此可跳略過(guò)云端供應(yīng)商,一樣在短時(shí)間獲得密集運(yùn)算力。

不過(guò),完全零散調(diào)度型的作法,仍有可能無(wú)法即時(shí)湊得需求運(yùn)算力,或因?yàn)樵谌蚋鞯卣{(diào)度運(yùn)算力,反應(yīng)速度恐有不及,且發(fā)展者多為小型新創(chuàng)業(yè)者,現(xiàn)階段仍難對(duì)AWS、Google等大型云端服務(wù)商競(jìng)爭(zhēng),僅能若干削弱其價(jià)值,追求穩(wěn)定充沛效能者仍以AWS、Google為首選。

面對(duì)完全分散化的趨勢(shì),國(guó)際大型云端業(yè)者亦有所因應(yīng),例如AWS原即有EC2 Spot Instance服務(wù),對(duì)于機(jī)房閑置未租出去的運(yùn)算效能,或有人臨時(shí)退租退用所釋出的效能,能夠以折扣方式再賣或轉(zhuǎn)讓,類似客機(jī)即將起飛,未賣盡的座位票價(jià)較低廉,或飯店將入夜的空房折扣租出等,以便減少固定成本的負(fù)擔(dān)。

不過(guò),Spot Instance這類的超折扣機(jī)會(huì)可遇不可求,或有諸多限制(最高僅能連續(xù)運(yùn)算6個(gè)小時(shí)),以便維持正規(guī)租用者的質(zhì)感,如此與前述完全分散化的運(yùn)算調(diào)度服務(wù)相去不遠(yuǎn),均帶有較高的不確定性。

-

芯片

+關(guān)注

關(guān)注

456文章

50884瀏覽量

424154 -

物聯(lián)網(wǎng)

+關(guān)注

關(guān)注

2909文章

44700瀏覽量

373933 -

AI

+關(guān)注

關(guān)注

87文章

30991瀏覽量

269278 -

5G

+關(guān)注

關(guān)注

1354文章

48466瀏覽量

564513

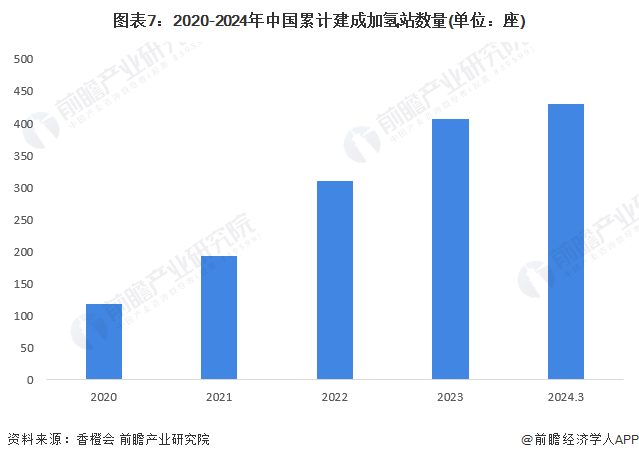

原文標(biāo)題:為什么說(shuō)AI推理芯片大有可為

文章出處:【微信號(hào):iawbs2016,微信公眾號(hào):寬禁帶半導(dǎo)體技術(shù)創(chuàng)新聯(lián)盟】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

炬芯科技:混合AI架構(gòu)大有可為,2025端側(cè)AI是IoT設(shè)備關(guān)鍵

芯和半導(dǎo)體:國(guó)產(chǎn)EDA大有可為

蘇茨克維預(yù)測(cè):推理型AI將帶來(lái)不可預(yù)測(cè)性

AI推理CPU當(dāng)?shù)溃珹rm驅(qū)動(dòng)高效引擎

AMD助力HyperAccel開(kāi)發(fā)全新AI推理服務(wù)器

如何基于OrangePi?AIpro開(kāi)發(fā)AI推理應(yīng)用

為什么說(shuō)AI推理芯片大有可為?

為什么說(shuō)AI推理芯片大有可為?

評(píng)論