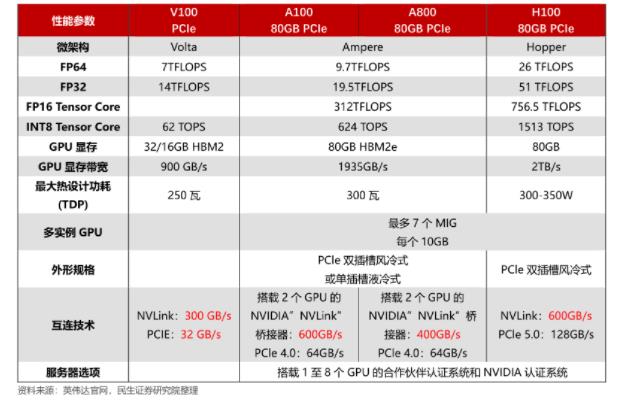

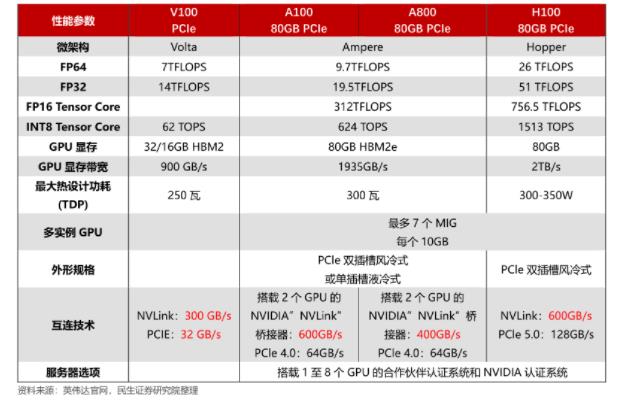

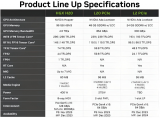

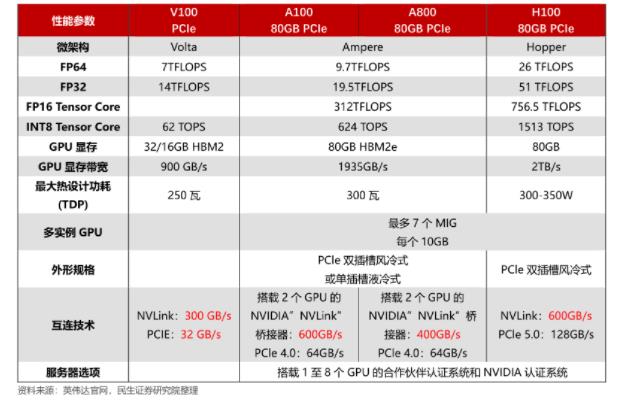

英偉達前段時間發布GH 200包含 36 個 NVLink 開關,將 256 個 GH200 Grace Hopper 芯片和 144TB 的共享內存連接成一個單元。除此之外,英偉達A100、A800、H100、V100也在大模型訓練中廣受歡迎。

2023-06-29 11:23:58 25396

25396

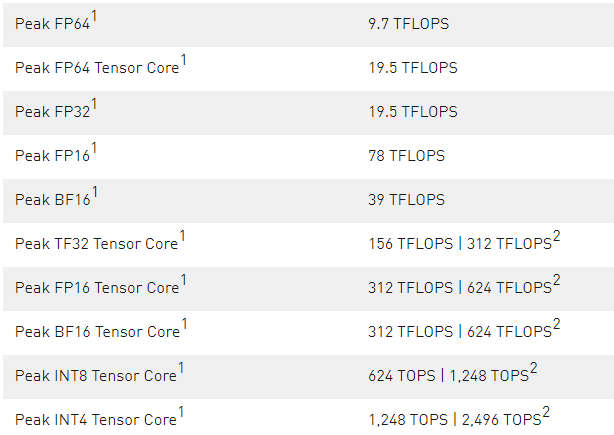

基于Ampere架構的GPU計算加速器,專為高性能計算、人工智能和機器學習等領域而設計。它擁有高達6912個CUDA核心(在32GB版本中),是目前最強大的數據中心GPU之一。A100支持更快的訓練速度和更大的模型容量,適用于需要進行大規模并行計算的應用程序。 H100是英偉達公司的InfiniBand適

2023-08-09 17:31:33 32510

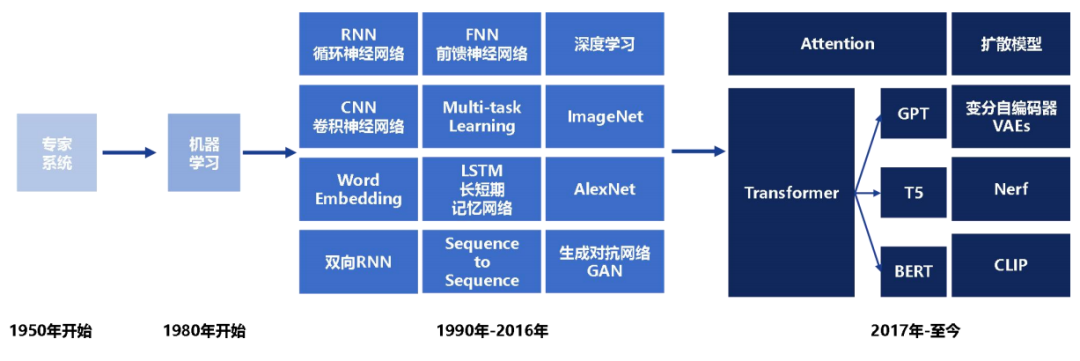

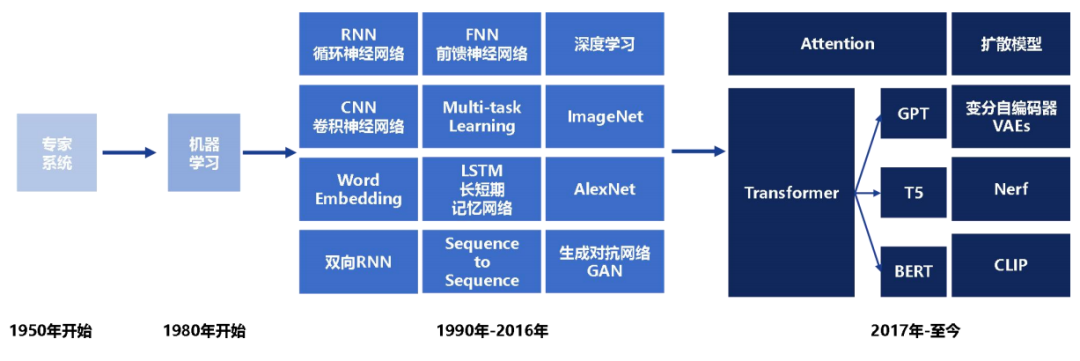

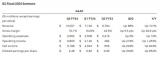

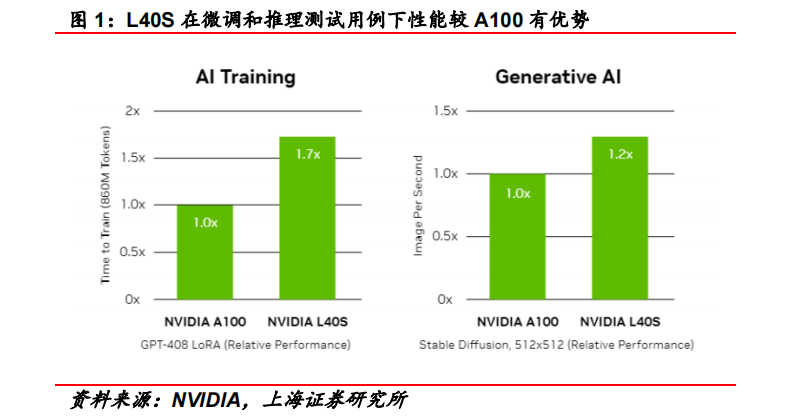

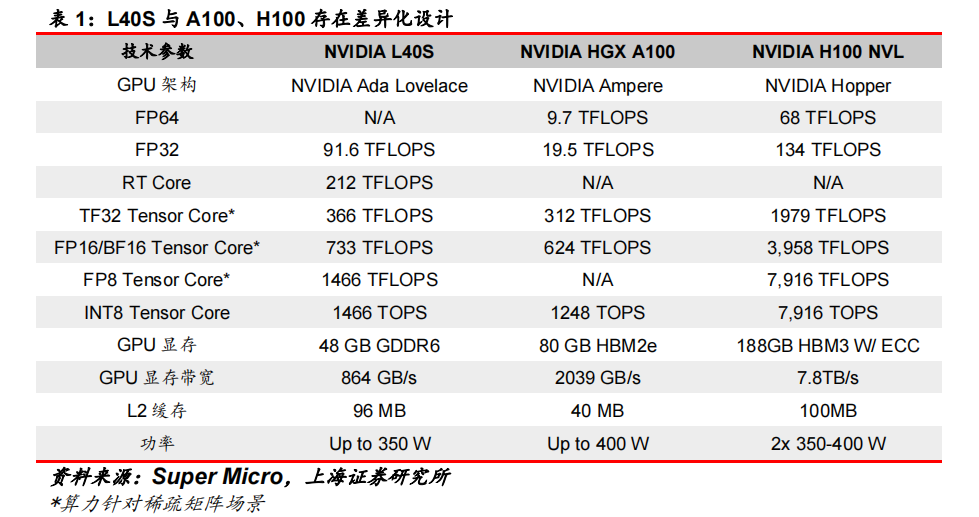

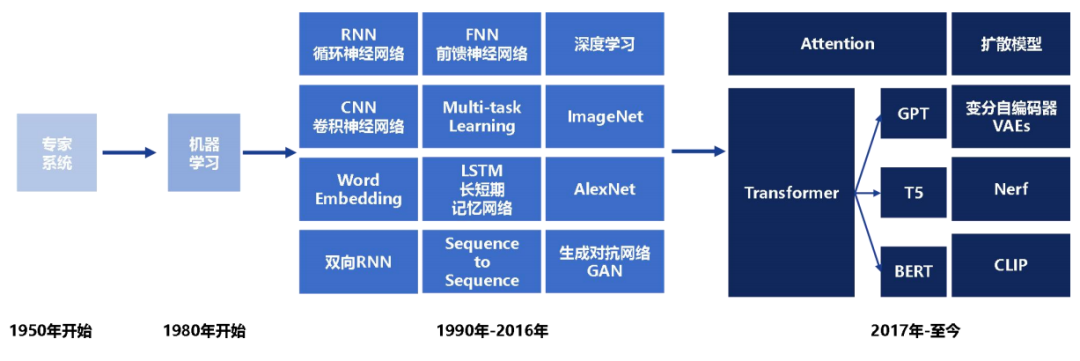

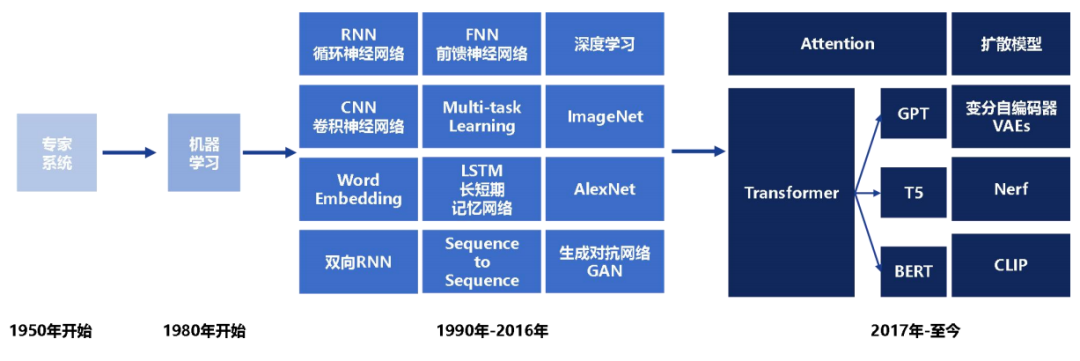

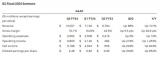

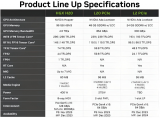

32510 隨著生成式AI應用的迅猛發展,我們正處在前所未有的大爆發時代。在這個時代,深度學習模型的部署成為一個亟待解決的問題。盡管GPU在訓練和推理中扮演著關鍵角色,但關于它在生成式AI領域的誤解仍然存在。近期英偉達L40S GPU架構成為了熱門話題,那么與A100和H100相比,L40S有哪些優勢呢?

2023-10-07 09:43:18 1112

1112

用于NVIDIA DGXTM A100和NVIDIA DGX StationTM A100系統的NVIDIA A100 80GB GPU也于今日發布,預計將于本季度發貨。

2020-11-17 12:03:01 3734

3734 A100 GPU 的新 MIG 功能可以將每個 A100 劃分為多達七個 GPU 加速器以實現最佳利用率,有效提高了 GPU 資源利用率和 GPU 訪問更多用戶和 GPU 加速應用程序。

2022-04-06 09:54:45 7603

7603

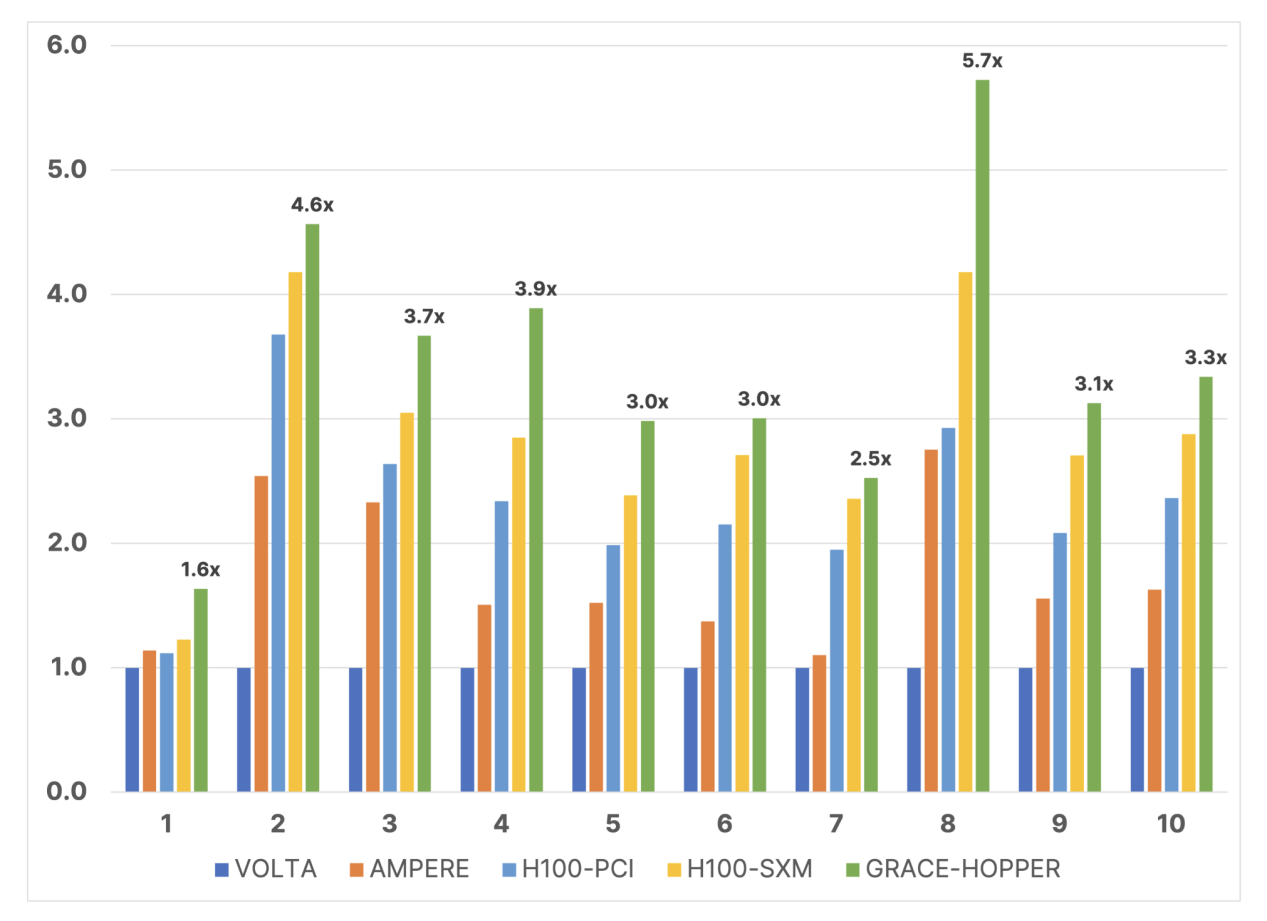

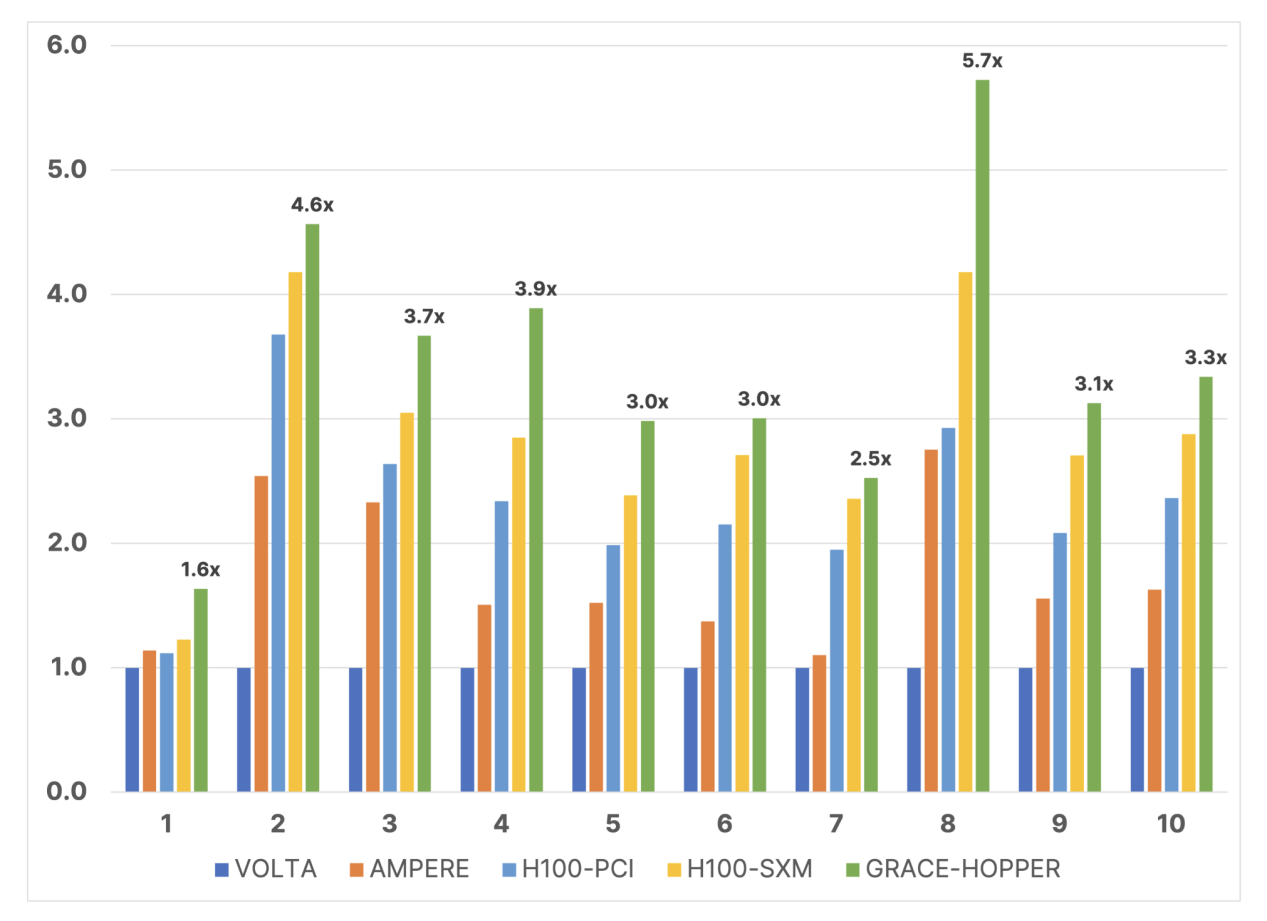

、H100的現狀,對Hopper GPU(H100)的性能有了大致的了解,但Grace Hopper作為一個異構計算平

2023-09-06 01:10:00 1137

1137

H.264視頻編碼標準狀況分析H.264視頻編碼技術先進性H.264和MPEG-4的比較對比分析,哪個好?

2021-04-20 06:38:15

的加密貨幣業務的下滑原因不能簡單歸結于加密貨幣市場的總體趨勢。 GPU挖礦效率不敵專用挖礦芯片,礦工紛紛流失英偉達的加密貨幣業務部門的核心問題是對GPU挖礦的需求下降。由于用于制造顯卡的芯片的計算能力不足

2018-08-24 10:11:50

GPU技術大會,從黃仁勛那里聽到:數據中心已成為全新的計算單元。黃仁勛之所以有這樣的底氣,就在于這次發布會上推出了一款全新處理器DPU,以及圍繞該處理器的軟件生態架構DOCA。據英偉達的介紹,DPU可以

2022-03-29 14:42:53

在 8 月 14 日的 SIGGRAPH 2018 大會上,英偉達 CEO 黃仁勛正式發布了新一代 GPU 架構 Turing(圖靈),以及一系列基于圖靈架構的 GPU,包括全球首批支持即時光線追蹤

2018-08-15 10:59:45

CPLD與FPGA對比分析哪個好?

2021-06-21 06:10:12

CPLD與FPGA的對比分析哪個好?

2021-11-05 08:20:40

RAM有哪些分類?特點是什么?DRAM和SRAM對比分析哪個好?

2022-01-20 07:16:10

LTE與WiMAX對比分析哪個好?

2021-05-31 06:22:29

Arduino和STM32各自的特點是什么?STM32和Arduino對比分析哪個好?

2021-11-04 06:34:07

恩智浦S32V/英偉達DRIVE PX2/TI的TDA4/寒武紀1M/高通SA8155對比分析哪個好?

2021-09-30 07:03:20

剛買回來的華美A100路由器,馬上想刷一下固件試一試攝像頭功能,可為什么根據視頻一樣的方法就是刷不進去呢? 步驟跟視頻一樣,但是最后是出現TTTTT字樣不是....字樣,就是刷不進去。

2019-02-28 22:30:06

深圳市港禾科技有限公司所上傳的產品圖片均為實物拍攝。A100 40GB 80GB 由于電子元器件價格因市場浮動,網站展示價格僅為參考價,不能作為最后成交價格,具體價格請與業務

2022-11-26 17:03:09

;VFG-SYS-821GE-TNHR 1 Base Configuration 8UX13HGX H100 8GPU(Rear I/O),X13DEG-OAD*12 CPU P4X-S

2024-01-02 09:35:32

據國外媒體報道,圖形處理器廠商英偉達周四推出了他們首款基于安培架構的GPU英偉達A100,采用7nm工藝制造,集成超過540億個晶體管。

2020-05-15 10:33:42 1698

1698 5 月 14 日,英偉達一年一度的 GTC 大會在線上開幕。受疫情影響,這場大會一推再推,終于通過線上直播的形式得以與觀眾見面。此次大會上,英偉達正式發布NVIDIA A100,全新的數據中心

2020-05-15 11:34:25 5018

5018 達新一代GPU架構安培,并帶來了基于安培架構GPU A100的DGX-A100 AI系統和面向邊緣AI計算的EGX A100。

2020-05-15 14:48:00 7763

7763 同時,也發布了全球最先進的AI系統—— NVIDIA DGX A100系統,單節點AI算力達到創紀錄的5 PFLOPS,5個DGX A100系統組成的一個機架,算力可媲美一個AI數據中心。以及發布

2020-06-02 17:11:45 3709

3709 英偉達最新的NVIDIA DGX A100被命名為通用的AI集成架構系統,核心是8 塊A100 Tensor Core GPU,CPU部分采用了兩塊 AMD Rome 7742(共有128個核心)。想象一下,假如收購了Arm,英偉達就有可能使用自研的CPU(像蘋果一樣),這樣會大幅降低產品成本。

2020-08-03 14:36:51 1243

1243 根據英偉達官方的消息,在 AWS 運行 NVIDIA GPU 十周年之際,AWS 發布了采用全新 A100 的 Amazon EC2 P4d 實例。 IT之家了解到,現在已全面上市的全新 AWS

2020-11-04 15:34:55 2907

2907 在發布A100 80GB加速卡之后,NVIDIA也更新了自家的DGX A100產品線,最多可達640GB HBM2e顯存了。此外,還有全新的DGX Station A100工作站,配備了4個A100 80GB顯存,還上了壓縮機制冷。

2020-11-17 10:26:19 3900

3900 據該公司CEO黃仁勛介紹,A100采用臺積電當時最先進的7納米工藝打造,擁有540億個晶體管,面積高達826mm2,GPU的最大功率也達到了400W。又因為同時搭載了三星HBM2顯存、第三代TensorCore和帶寬高達600GB/s的新版NVLink,英偉達的A100在多個應用領域也展現出強悍的性能。

2020-11-17 15:51:08 2623

2623

英偉達現已發布 A100 80GB GPU,適用于 NVIDIA HGX AI 超級計算平臺,相比上一款產品顯存翻倍。 英偉達表示,A100 80GB 的顯存是其前身的兩倍,為研究人員和工程師提供

2020-11-17 16:04:05 2103

2103 近日 Microsoft Azure 宣布正式推出 ND A100 v4 VM 系列,這是適用于超級計算級 AI 和 HPC 負載的強大虛擬機,由 NVIDIA A100 Tensor Core

2021-06-11 16:53:54 2083

2083 NVIDIA發布新一代產品—NVIDIA H100,H100是一款超大的芯片,采用TSMC 4N工藝,具有800億個晶體管,也是首款采用HBM3標準的GPU。

2022-03-23 17:21:42 2476

2476

GTC2022大會亮點:NVIDIA發布全新AI計算系統—DGX H100,借助NVLink連接,DGX使八塊H100成為了一個巨型GPU。

2022-03-24 15:06:31 1574

1574

今日凌晨,NVIDIA(英偉達)發布了基于最新Hopper架構的H100系列GPU和Grace CPU超級芯片!

2022-03-26 09:07:05 2380

2380 藍海大腦宣布服務器產品線全力支持最新的 NVIDIA H100 GPU。藍海大腦服務器產品在單機上最多可支持4、8甚至9個H100 GPU,可為多種人工智能場景提供超強算力、靈活的資源調度和成熟的生態支持。

2022-03-31 11:47:09 1067

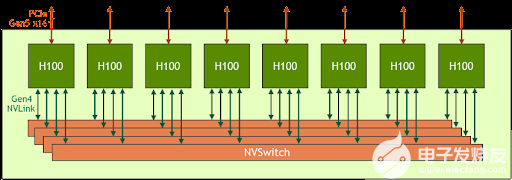

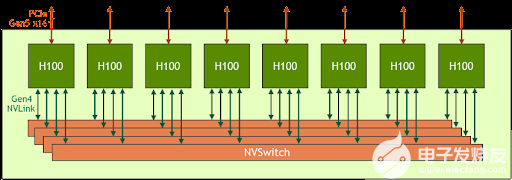

1067 HGX H100 8- GPU 是新一代 Hopper GPU 服務器的關鍵組成部分。它擁有八個 H100 張量核 GPU 和四個第三代 NV 交換機。每個 H100 GPU 都有多個第四代

2022-04-20 10:54:19 2108

2108

今年的 GTC22 上 NVIDIA 發布其首款基于 Hopper 架構的 GPU —NVIDIA H100。

2022-07-18 10:35:23 1300

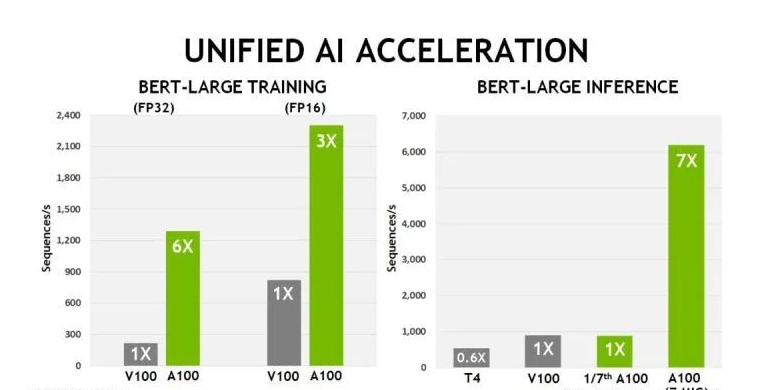

1300 在行業標準 AI 推理測試中,NVIDIA H100 GPU 創造多項世界紀錄、A100 GPU 在主流性能方面展現領先優勢、Jetson AGX Orin 在邊緣計算方面處于領先地位。

2022-09-13 15:29:19 2352

2352 在H100發布之際,英偉達還帶來一個“重磅產品”——Transformer Engine。在Transformer大火之際推出這么一個產品,無疑是煉丹師福音。

2022-10-24 15:26:29 2259

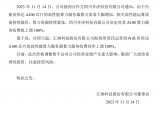

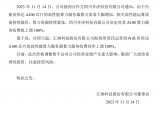

2259 此前被禁止出貨的A100 GPU一種替代產品。業內預計A800 GPU的某些性能肯定會被限制或閹割。 對于上市時間的話預計A800 GPU將在第三季度投產。 此前英偉達公司稱被美國政府要求限制出口兩款被用于加速人工智能任務的最新兩代旗艦GPU計算芯片A100和H100。 美方無理打壓,違反國際經

2022-11-08 16:07:19 2715

2715 ,不能通過編程超過限制的性能。 今年8月的最后一天,英偉達發布公告稱,公司收到美國政府通知,要求對中國大陸以及中國香港、俄羅斯的客戶出口的高端GPU芯片,需要申請出口許可證,其中覆蓋到A100和H100等幾款GPU,同時未來性能等于或高于A100的產品都會受

2022-11-09 07:15:01 7427

7427 英偉達確認,已經向中國提供新的計算圖形芯片A800,作為被禁運的A100的替代品,性能稍遜,但符合出口管制規定。 為了賺錢,老黃又為中國「開后門」了?? 美國芯片制造商英偉達證實,正在向中國提供一種

2022-11-09 11:44:15 2078

2078 英偉達A100、H100兩款數據中心加速GPU(GPGPU)禁令連續劇又迎來了新的劇情:英偉達宣稱推出一款新的GPGPU A800,符合美國近期的出口管制規定,從而可持續供應中國市場。 當A100

2022-11-10 10:29:20 603

603

英偉達GTC:ChatGPT專用Hopper GPU H100 NVL來了 ChatGPT 一經推出火爆程度讓人咋舌,似乎一夜之間就將生成式 AI、大語言模型推到了風口浪尖。英偉達估計也要笑出

2023-03-23 16:55:46 3017

3017

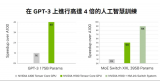

專為生成式AI設計的GPU:HBM密度是英偉達H100的2.4倍,帶寬是英偉達H100的1.6倍。

2023-06-20 10:47:47 605

605 nvidia的a100、h100和其他ai gpu目前使用控制臺來制造晶片和2.5包的前端工程。nvidia ai gpu使用的hbm芯片由sk海力士獨家提供。但是tsmc沒有能力處理2.5d包裝所需的所有工作。

2023-07-20 10:45:23 538

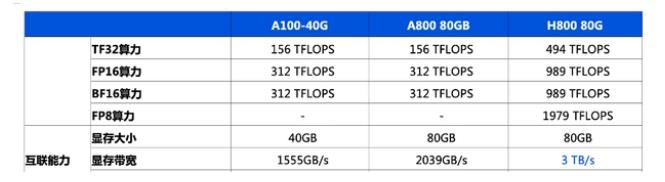

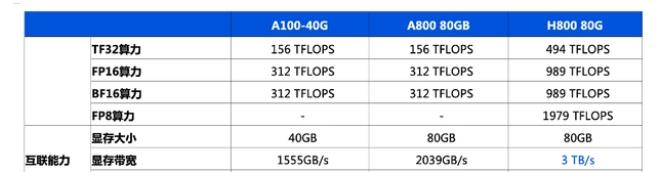

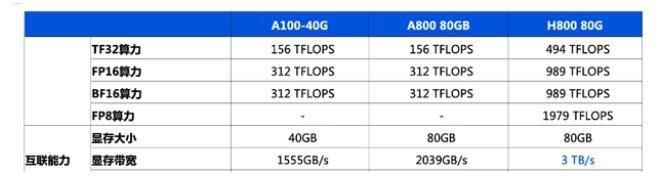

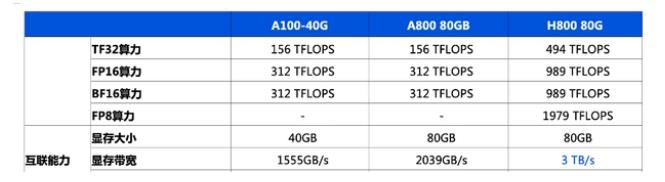

538 時間推回到2022年11月,英偉達推出了中國特供版GPU芯片A800,可以直接取代A100系列,是專門為了解決美國商務部半導體出口新規而設計。其芯片數據傳輸速率為400GB/s,低于A100的600GB/s,內存帶寬最高為2TB/s。

2023-07-31 14:15:18 7511

7511

英偉達a100和h100哪個強? 英偉達A100比H100更強。英偉達A100在處理大型模型和數據集時可能比V100表現更優秀。 H100 是一款針對大模型專門優化過的芯片,使用臺積電 5nm 定制

2023-08-07 17:32:59 10412

10412 英偉達a100和a800的區別 英偉達A100和A800是兩種不同的產品, 主要區別如下: 1. 架構不同:A100使用Ampere架構,A800使用Volta架構。 2. 計算能力不同:A100

2023-08-07 17:57:02 29561

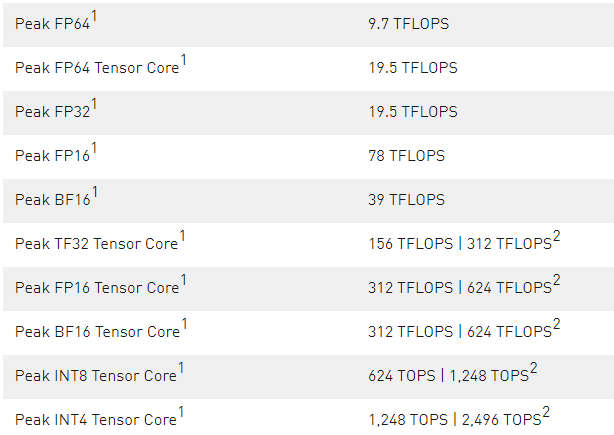

29561 英偉達a100顯卡算力介紹 英偉達A100顯卡是一款專為數據中心設計的顯卡,采用了全新的Ampere架構,配備了6912個CUDA核心,算力高達19.5 TFLOPS。 此外,A100還采用了新一代

2023-08-07 17:59:10 5434

5434 英偉達a100和a800參數對比 以下是英偉達A100和A800的主要參數對比: | 參數 | A100 | A800 | |? | 架構 | Ampere | Ampere | | CUDA核心

2023-08-07 18:00:35 9843

9843

英偉達A100和H100的區別 英偉達A100和H100是兩種不同的產品。A100是英偉達在2020年推出的一款基于Ampere架構的數據中心GPU,主要用于高性能計算和人工智能應用。A100具有

2023-08-07 18:06:03 22944

22944 英偉達A100和3090的區別 英偉達A100是一款面向數據中心的計算加速器,其主要優勢是支持數據中心最新的AI、機器學習和高性能計算工作負載。它配備了專門的張量核心和加速器,可以比普通GPU更快

2023-08-07 18:54:12 2559

2559 寬帶。英偉達A100還配備了英偉達的第三代NVLink互連技術和第二代NVSwitch交換機,可以實現高帶寬、低延遲的GPU-GPU通信,提升集群中的計算效率

2023-08-08 11:54:02 8143

8143

為7.8FP32/3.9FP64 exaFLOPS。 4. 存儲:英偉達4090有1TB的高速HBM2存儲,英偉達A100則有40GB -80GB HBM2存儲,但A100也可以配置為另一種版本,即帶有320GB GDDR6存儲的A100 PC

2023-08-08 11:59:22 22929

22929 英偉達A100和A40的對比 A100是英偉達推出的一款強大的數據中心GPU,采用全新的Ampere架構。它擁有高達6,912個CUDA核心和40GB的高速HBM2顯存。可以實現高達19.5

2023-08-08 15:08:34 11418

11418 英偉達A100是什么系列? 全球都在關注生成式人工智能;特別是OpenAI發布ChatGPT以來,生成式人工智能技術一下就被拔高。在大模型訓練中,A100是非常強大的GPU。英偉達的AI芯片這個時候

2023-08-08 15:13:48 2001

2001 英偉達A100的簡介 A100都是非常強大的GPU。英偉達A100、A800、H100、V100也在大模型訓練中廣受歡迎。特別是OpenAI發布ChatGPT以來,全球都在關注生成式人工智能。 英偉

2023-08-08 15:17:16 7309

7309 英偉達A100的優勢分析 在大模型訓練中,A100是非常強大的GPU。A100是英偉達推出的一款強大的數據中心GPU,采用全新的Ampere架構。擁有高達6,912個CUDA核心和40GB的高速

2023-08-08 15:25:22 2540

2540 ,但 A100 的算力是前者的 20 倍。 A100是英偉達推出的一款強大的數據中心GPU,采用全新的Ampere架構。它擁有高達6,912個CUDA核心和40GB的高速HBM2顯存。可以實現高達

2023-08-08 15:28:45 21152

21152 英偉達a100有國產替代嗎? 目前尚未出現明確可替代英偉達A100的國產產品,但中國國內的企業正在積極推進相關領域的研發和生產。例如,中國科技巨頭華為正在開發自主研發的AI芯片,其已發布的昇騰910

2023-08-08 15:37:12 3476

3476 英偉達h800和a100參數對比 NVIDIA H800和A100是兩款高端的GPU產品,下面是它們的參數對比: 1.架構: H800采用的是Volta架構,而A100則是NVIDIA

2023-08-08 15:53:57 23308

23308

英偉達h800和a100的區別 NVIDIA H800和A100是NVIDIA的兩種不同類型的GPU,具有不同的架構和特點。以下是它們之間的區別: 1. 架構:H800使用NVIDIA Volta

2023-08-08 16:05:01 12825

12825

英偉達h800和h100的區別 其實大白話就是,A100、H100是原版,特供中國市場的減配版是A800、H800。A100、H100是價格更便宜,性能更好,但是不賣,A800、H800性能

2023-08-08 16:06:55 32420

32420

雖然目前尚未確定gpu的準確配置,但英偉達 h100 80gb hbm2e運算卡gpu (14592 cuda core, 26 fp64 tflops, 1513 fp16 tflops

2023-08-16 11:05:16 699

699 gh200和h100性能對比 隨著計算機的普及和技術的不斷提高,CPU發熱問題越來越重要。因此,散熱器作為一種重要的CPU散熱裝置,起到了非常重要的作用。其中,GH200和H100散熱器都是較為知名

2023-08-16 17:33:27 565

565 gh200和h100哪個更好 在冷靜分析的基礎上,我認為GH200和H100各有優缺點,沒有絕對的好與不好之分。以下是我對GH200和H100性能、價格、安裝等方面做出的詳細比較和評價,希望能

2023-08-16 17:33:58 666

666 雖然目前尚未確定gpu的準確配置,但nvidia h100 80gb hbm2e運算卡gpu (14592 cuda core, 26 fp64 tflops, 1513 fp16 tflops

2023-08-17 10:22:48 240

240 gh200和h100性能對比 隨著計算機的普及和技術的不斷提高,CPU發熱問題越來越重要。因此,散熱器作為一種重要的CPU散熱裝置,起到了非常重要的作用。其中,GH200和H100散熱器都是較為知名

2023-08-17 10:51:35 877

877 玉龍810和A100對比 在現今市面上的電視機品牌中,玉龍和海信已經成為了熱門的選購品牌之一。而在選擇這些品牌的時候,很多消費者會被糾結的問題就是該選擇哪一款型號,這也是那些價位比較相似的型號之間

2023-08-17 11:09:47 567

567 據Tae Kim透露,金融咨詢公司Raymond James推算,每個h100芯片的費用為3320美元。但是,目前還不清楚bom成本分析進行得有多深入。如果這是純粹的制造成本(晶片和其他部件的平均收益率)的問題,英偉達仍需支付相當大的銷售成本。

2023-08-21 11:13:25 498

498 mi300芯片和h100性能參數對比 MI300芯片和H100芯片都是目前市場上比較常見的芯片,其性能參數直接關系到設備的使用體驗和性能表現。本文將詳細對比MI300芯片和H100芯片的性能參數

2023-08-22 16:46:29 1485

1485 英偉達v100與A100的差距有哪些? 在當今人工智能和深度學習技術日益發展的時代,高性能計算機顯卡已成為支持這些技術發展的關鍵。英偉達是高性能計算機顯卡領域的領導者之一,其v100和A100顯卡

2023-08-22 16:46:33 13149

13149 升騰910和英偉達A100的區別 升騰910和英偉達A100代表著兩個不同的領域,這兩種芯片是為不同的目的設計的。升騰910是華為公司開發的一種AI芯片,而英偉達A100是一種數據中心的GPU加速器

2023-08-31 17:06:01 42122

42122 升騰910和英偉達h100對比? 隨著人工智能計算進入快速發展的階段,AI芯片的性能也越來越得到人們的關注,其中兩款最受關注的芯片必須是華為的升騰910以及英偉達的H100,兩者各有優劣,下面將對

2023-08-31 17:06:57 11462

11462 據《衛報》報道,拜登政府決定對Nvidia的A100和H100產品以及基于它們的服務器實施出口許可證的原因之一,是為了阻止中國的人工智能發展,防止這些GPU被轉售到中國。

2023-09-01 15:57:06 583

583 、TensorFlow、PyTorch、Batchnorm、Scale、Crop算子、L40S、A100、H100、A800、H800

2023-09-22 14:13:09 605

605

市場研究公司Omdia近日發布報告稱,預計英偉達二季度用于AI和高性能計算應用的H100 GPU的出貨量超過了900噸。并且預計其在未來幾個季度的GPU銷量將大致相同,因此英偉達今年將銷售約3600 噸重的H100 GPU。

2023-09-28 14:50:55 1250

1250

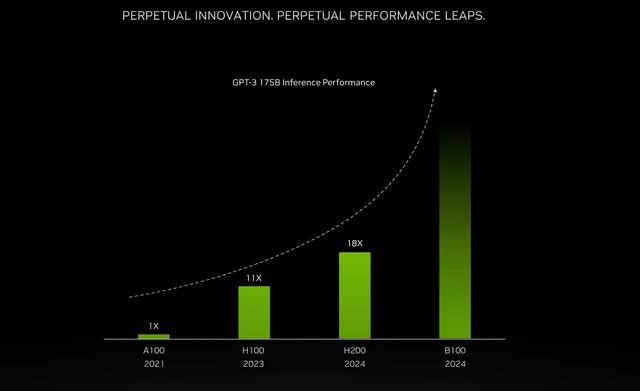

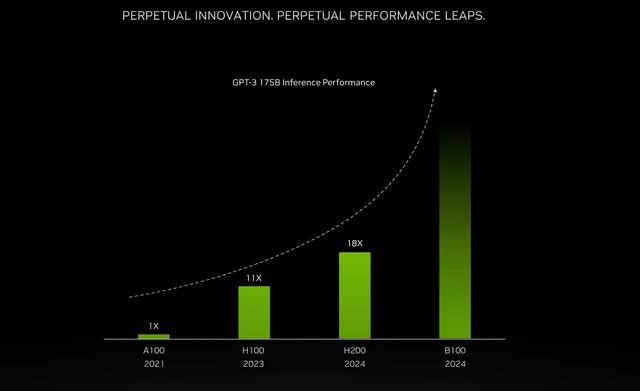

市場有關負責人表示,h100是英偉達gpu中規格最高的技術,但b100的影響力比h100更大,今后將采用3至4納米工程和芯片設計。隨著sk海力士決定獨家向英偉達提供可驅動新一代b100 gpu的最新hbm3e顯示器存儲器,該公司將躍升為ai業界的半導體主要企業。

2023-10-17 09:23:47 492

492 昂貴 H100 的一時洛陽紙貴,供不應求,大模型訓練究竟需要多少張卡呢?GPT-4 很有可能是在 10000 到 20000 張 A100 的基礎上訓練完成的[8]。按照 Elon Musk 的說法

2023-10-29 09:48:13 4188

4188

首先,我們首先要說的是,如果您現在想要訓練基礎模型(例如 ChatGPT),那么 NVIDIA H100 80GB SXM5 仍然是首選 GPU。一旦基礎模型經過訓練,通常可以在成本和功耗顯著降低的部件上根據特定領域的數據或推理來定制模型。

2023-11-08 15:35:53 470

470

但據悉,三種新型AI芯片不是“改良型”,而是“縮小型”。用于ai模型教育的hgx h20的帶寬和計算速度是有限的。整體計算能力理論上比nvidia的h100 gpu芯片低80%左右。h20是h100的20%的綜合計算性能。

2023-11-13 09:41:58 746

746 目前,用于高端推理的 GPU 主要有三種:NVIDIA A100、NVIDIA H100 和新的 NVIDIA L40S。我們將跳過NVIDIA L4 24GB,因為它更像是低端推理卡。

2023-11-13 16:13:31 572

572

本周四,一些媒體首次報道了英偉達特供芯片的消息。報道稱,這三款新產品是在 H100 GPU 的基礎版本基礎上進行修改的,采用的是最新架構,但性能大幅度縮減。H100 GPU 是一種用于人工智能訓練的高端 GPU,已于 2022 年 8 月被禁止在國內銷售。

2023-11-13 16:44:13 413

413

2023年,所有的目光都集中在英偉達新推出的H100 GPU上,它是A100更強大的后繼者。雖然H100集群正在建設中(并非沒有障礙),但研究人員依賴于V100、A100和RTX 3090。英偉達產品的競爭壽命相當驚人:2017年發布的V100目前仍然是人工智能研究中最常用的芯片。

2023-11-14 15:56:58 264

264

半導體芯情了解到,A100是英偉達最新推出的一款高性能計算芯片,采用了全新的Ampere架構,Ampere架構是NVIDIA于 GTC 2020發布的GPU架構,NVIDIA Ampere 由540億晶體管組成,是7nm芯片。

2023-11-14 16:30:16 561

561

這樣,在云端使用 H100 GPU 的排隊時間可能會縮短。數據中心提供商和前比特幣挖礦公司正在開設具有 H100 集群的數據中心。這些公司承諾以大型云提供商成本的一小部分提供 H100 GPU 計算,而大型云提供商對 H100 GPU 加速的虛擬機收取高價。

2023-11-23 15:59:22 569

569 爭奪剩余的市場而戰。然而,MI300X對英偉達的H100構成了有力的競爭,甚至微軟的首席技術官最近都表示,他認為AMD最終在這個市場上將非常有競爭力。

2023-12-10 11:30:00 582

582

根據預測,若H100的年利用率保持在61%,那么單臺設備每年將耗電3740千瓦小時左右。如果英偉達在2023年售出150萬塊H100,2024年再增加至200萬塊,那么到2024年底,將有350萬塊H100芯片投入使用,其總年用電量將高達130.91億千瓦小時(13091.82GWh)。

2023-12-28 09:29:47 373

373 一句話總結,H100 vs. A100:3 倍性能,2 倍價格 值得注意的是,HCCS vs. NVLINK的GPU 間帶寬。 對于 8 卡 A800 和 910B 模塊而言,910B HCCS 的總帶寬為392GB/s,與 A800 NVLink (400GB/s) 相當。

2023-12-29 11:43:55 1208

1208

首當其沖的就是A100GPU。OpenAI使用的是3,617臺HGXA100服務器,包含近3萬塊英偉達GPU。國內云計算相關專家認為,做好AI大模型的算力最低門檻是1萬枚英偉達A100芯片。

2024-01-03 15:57:37 364

364

英偉達H200和H100是兩款不同的AI芯片,它們各自具有獨特的特點和優勢。以下是關于這兩款芯片的一些比較。

2024-03-07 15:53:52 438

438 英偉達H200和A100在多個方面存在差異。

2024-03-07 16:18:22 308

308 英偉達H200和A100兩款芯片在性能、架構、內存以及應用場景等多個方面存在顯著的區別。

2024-03-07 16:23:44 438

438 電子發燒友網報道(文/李彎彎)近日,英偉達高端GPU對中國供應受到限制的消息,引起熱議。8月31日,英偉達發布公告稱,美國通知公司向中國出口A100和H100芯片將需要新的許可證要求,同時DGX

2022-09-03 07:47:00 6221

6221 ,不能通過編程超過限制的性能。 ? 今年8月的最后一天,英偉達發布公告稱,公司收到美國政府通知,要求對中國大陸以及中國香港、俄羅斯的客戶出口的高端GPU芯片,需要申請出口許可證,其中覆蓋到A100和H100等幾款GPU,同時未來性能等于或高于A100的產品都會

2022-11-09 09:23:59 6683

6683 電子發燒友網報道(文/李彎彎)上個月,美國發布更新針對AI芯片的出口管制規定,新措施意在填補去年10月發布法規中的漏洞。這樣意味著,除了英偉達A100/H100之外,其針對中國市場推出的替代版本

2023-11-09 09:08:41 2961

2961 和B100兩款芯片。來源:英偉達官網 ? 首款搭載HBM3e 的GPU ,推理速度幾乎是H100 的兩倍 ? 與A100和H100相比,H200最

2023-11-15 01:15:00 2221

2221

電子發燒友App

電子發燒友App

評論