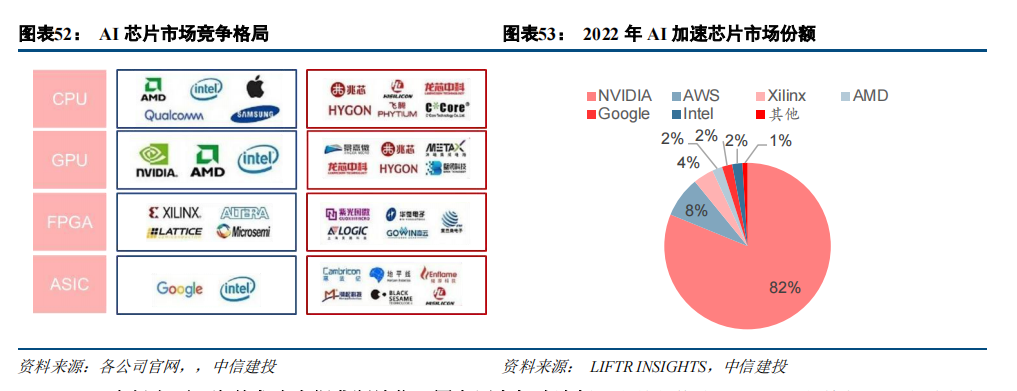

海外龍頭廠商占據壟斷地位,AI 加速芯片市場呈現“一超多強”態勢。數據中心 CPU 市場上,英特爾份額有所下降但仍保持較大領先優勢,AMD 持續搶占份額勢頭正盛。AI 加速芯片市場上,英偉達憑借硬件優勢和軟件生態一家獨大,在訓練、推理端均占據領先地位。根據 Liftr Insights 數據,2022 年數據中心 AI 加速市場中,英偉達份額達 82%,其余海外廠商如 AWS 和 Xilinx 分別占比 8%、4%,AMD、Intel、Google 均占比 2%。

龍芯CPU技術研究報告合集處理器

國內廠商起步較晚正逐步發力,部分加速芯片領域已經涌現出一批破局企業,但目前多為初創企業規模較小,技術能力和生態建設仍不完備,在高端 AI 芯片領域與海外廠商仍存在較大差距。未來,隨著美國持續加大對中國高端芯片的出口限制,AI 芯片國產化進程有望加快。

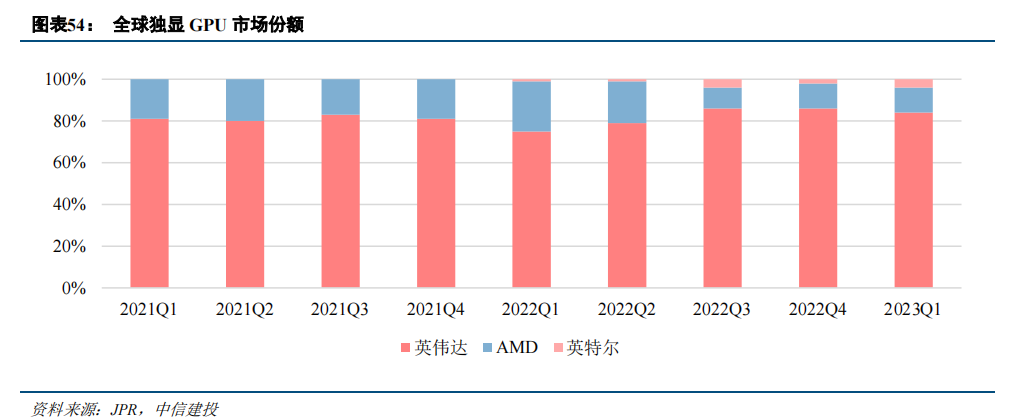

GPU 市場方面,海外龍頭占據壟斷地位,國產廠商加速追趕。當前英偉達、AMD、英特爾三巨頭霸占全球 GPU 芯片市場的主導地位。集成 GPU 芯片一般在臺式機和筆記本電腦中使用,性能和功耗較低,主要廠商包括英特爾和 AMD;獨立顯卡常用于服務器中,性能更高、功耗更大,主要廠商包括英偉達和 AMD。分應用場景來看,應用在人工智能、科學計算、視頻編解碼等場景的服務器 GPU 市場中,英偉達和 AMD 占據主要份額。根據 JPR,2023 年 Q1 英偉達的獨立顯卡(包括 AIB 合作伙伴顯卡)的市場份額達 84%, AMD 和 Intel則分別占比 12%、4%。

圖形渲染GPU:2006 年起,英偉達 GPU架構保持約每兩年更新一次的節奏,各代際產品性能提升顯著,生態構建完整,Geforce 系列產品市占率長期保持市場首位,最新代際 GeForce RTX 40 系列代表了目前顯卡的性能巔峰,采用全新的 Ada Lovelace 架構,臺積電 5nm 級別工藝,擁有 760 億晶體管和 18000 個 CUDA 核心,與 Ampere 相比架構核心數量增加約 70%,能耗比提升近兩倍,可驅動 DLSS 3.0 技術。性能遠超上代產品。AMD 獨立 GPU 在 RDNA 架構迭代路徑清晰,RDNA3 架構采用 5nm 工藝和 chiplet 設計,比 RDNA 2 架構有 54%每瓦性能提升,預計 2024 年前 RDNA 4 架構可正式發布,將采用更為先進的工藝制造。

目前國內廠商在圖形渲染 GPU 方面與國外龍頭廠商差距不斷縮小。芯動科技的“風華 2 號”GPU 像素填充率 48GPixel/s,FP32 單精度浮點性能 1.5TFLOPS,AI 運算(INT8)性能 12.5TOPS,實測功耗 4~15W,支持 OpenGL4.3、DX11、Vulkan 等 API,實現國產圖形渲染 GPU 突破。景嘉微在工藝制程、核心頻率、浮點性能等方面雖落后于英偉達同代產品,但差距正逐漸縮小。2023 年順利發布 JM9 系列圖形處理芯片,支持 OpenGL 4.0、HDMI 2.0 等接口,以及 H.265/4K 60-fps 視頻解碼,核心頻率至少為 1.5GHz,配備 8GB顯存,浮點性能約 1.5TFlops,與英偉達 GeForce GTX1050 性能相近,有望對標 GeForce GTX1080。

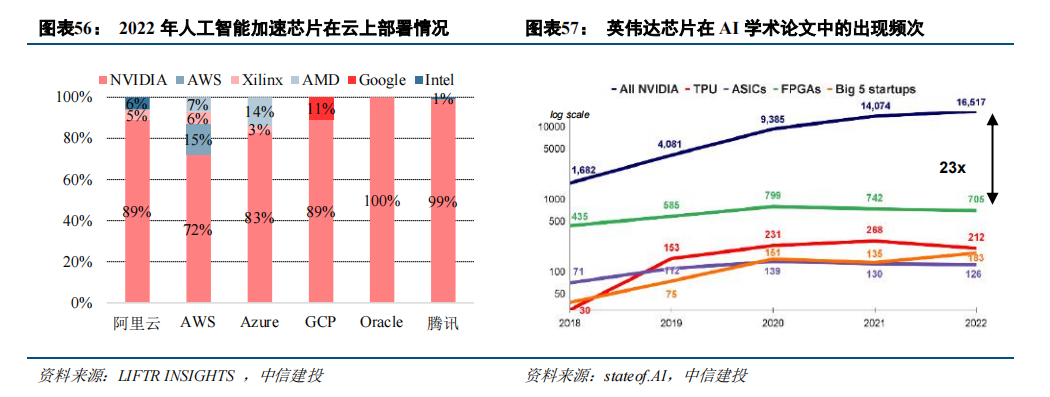

GPGPU:英偉達和 AMD 是目前全球 GPGPU 的領軍企業。英偉達的通用計算芯片具備優秀的硬件設計,通過 CUDA 架構等全棧式軟件布局,實現了 GPU 并行計算的通用化,深度挖掘芯片硬件的性能極限,在各類下游應用領域中,均推出了高性能的軟硬件組合,逐步成為全球 AI 芯片領域的主導者。根據 stateof.AI 2022 報告,英偉達芯片在 AI 學術論文中的出現頻次遠超其他類型的 AI 芯片,是學術界最常用的人工智能加速芯片。

在 Oracle 以及騰訊云中,也幾乎全部采用英偉達的 GPU 作為計算加速芯片。AMD 2018 年發布用于數據中心的Radeon Instinct GPU 加速芯片,Instinct 系列基于 CDNA 架構,如 MI250X 采用 CDNA2 架構,在通用計算領域實現計算能力和互聯能力的顯著提升,此外還推出了對標英偉達 CUDA 生態的 AMD ROCm 開源軟件開發平臺。英偉達的 H100 及 A100、AMD 的 MI100、MI200 系列等是當前最為主流的 GPGPU 產品型號。

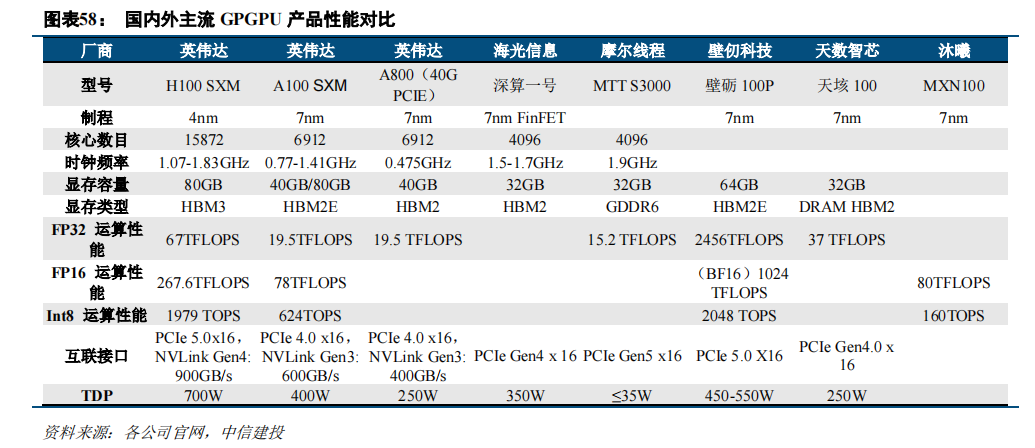

國內 GPGPU 廠商正逐步縮小與英偉達、AMD 的差距。英偉達憑借其硬件產品性能的先進性和生態構建的完善性處于市場領導地位,國內廠商雖然在硬件產品性能和產業鏈生態架構方面與前者有所差距,但正在逐步完善產品布局和生態構建,不斷縮小與行業龍頭廠商的差距。國內主要 GPGPU 廠商及產品如下:

1)海光信息:公司第一代 DCU 產品深算一號已于 2021 年實現商業化應用,采用 7nm 制程,基于大規模并行計算微結構進行設計,能支持 FP64 雙精度浮點運算,同時在單精度、半精度、整型計算方面表現同樣優異,是一款計算性能強大、能效比較高的通用協處理器,且該產品集成片上高帶寬內存芯片,可以在大規模數據計算過程中提供優異的數據處理能力,高速并行數據處理能力強大,在典型應用場景下,主要性能指標可對標 AMDMI100、英偉達 P100,接近英偉達 A100;第二代 DCU 產品深算二號處于研發階段,進展順利。DCU 系列產品全面兼容“類 CUDA”環境,因此能夠較好地適配、適應國際主流商業計算軟件和人工智能軟件,公司積極參與開源軟件項目,加快了公司產品的推廣速度,并實現與 GPGPU 主流開發平臺的兼容。未來有望廣泛應用于大數據處理、人工智能、商業計算等領域。

2)天數智芯:2021 年 11 月宣布量產國內首款云端 7nm GPGPU 產品卡“天垓 100”,采用業界領先的臺積電 7nm FinFET 制造工藝、2.5D CoWoS 封裝技術,搭配臺積電 65nm 工藝的自研 Interposer(中介層),集成多達240 億個晶體管,整合 32GB HBM2 內存、存儲帶寬達 1.2TB,支持 FP32、FP/BF16、INT32/16/8 等多精度數據混合訓練,系統接口 PCIe 4.0 x16。支持國內外主流 GPGPU 生態和多種主流深度學習框架。

3)壁仞科技:2022 年 9 月針對人工智能訓練、推理,及科學計算等更廣泛的通用計算場景推出 BR100 系列通用 GPU 芯片,目前主要包括 BR100、BR104 兩款芯片,基于壁仞科技原創芯片架構研發,采用 7nm 制程,可容納 770 億顆晶體管,并在國內率先采用 Chiplet 技術,新一代主機接口 PCIe 5.0,支持 CXL 互連協議,雙向帶寬最高達 128GB/s,具有高算力、高通用性、高能效三大優勢。創下全球算力紀錄,16 位浮點算力達到 1000T以上、8 位定點算力達到 2000T 以上,單芯片峰值算力達到 PFLOPS 級別,達到國際廠商在售旗艦產品 3 倍以上,創下國內互連帶寬紀錄。

4)摩爾線程:2022 年基于自研第二代 MUSA 架構處理器“春曉”GPU 推出針對數據中心的全功能 MTT?S2000/S3000。MTT S3000 具有 PCIe Gen5 接口,FP32 算力為 15.2 TFLOPS,核心頻率 1.9 GHz,顯存容量 32 GB,支持 MUSA 安全引擎 1.0 以及 GPU 彈性切分技術,支持在云端的虛擬化和容器化。此外,摩爾線程推出了完備的 MUSA 軟件棧,可幫助 MUSA 開發者快速基于摩爾線程全功能 GPU 開發各種不同的應用軟件,并可通過CUDA ON MUSA 兼容 CUDA 語言開發。

5)沐曦:沐曦首款異構 GPGPU 產品 MXN100 采用 7nm 制程, 已于 2022 年 8 月回片點亮, 主要應用于推理側;應用于 AI 訓練及通用計算的產品 MXC500 已于 2022 年 12 月交付流片,公司計劃 2024 年全面量產。2023 年發布首款 AI 推理 GPU 加速卡——曦思 N100 及解決方案在安防領域的應用。曦思 N100 是一款面向云端數據中心應用的 AI 推理 GPU 加速卡,內置異構的 GPGPU 通用處理器核心“MXN100”,同時集成了HBM2E 高帶寬內存,單卡的 INT8 整數算力達 160TOPS,FP16 浮點算力則達 80TFLOPS,具備高帶寬、低延時特性。支持 128 路編碼和 96 路解碼的高清視頻處理能力,兼容 HEVC(H.265)、H.264、AV1、AVS2 等多種視頻格式,最高支持 8K 分辨率。

ASIC 市場方面,由于其一定的定制化屬性,市場格局較為分散。在人工智能領域,ASIC 也占據一席之地。

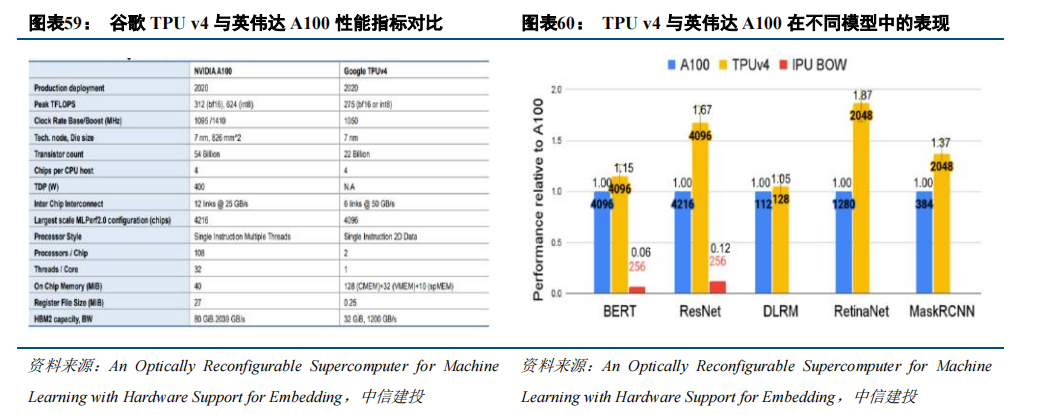

其中谷歌處于相對前沿的技術地位,自 2016 年以來,就推出了專為機器學習定制的 ASIC,即張量處理器(Tensor?Processing Unit,TPU),近期,谷歌首次公布了其用于訓練人工智能模型的 AI 芯片 TPU v4 的詳細信息,其采用低精度計算,在幾乎不影響深度學習處理效果的前提下大幅降低了功耗、加快運算速度,同時使用了脈動陣列等設計來優化矩陣乘法與卷積運算,對大規模矩陣的乘法可以最大化數據復用,減少訪存次數,大幅提升Transformer 模型的訓練速度,同時節約訓練成本。

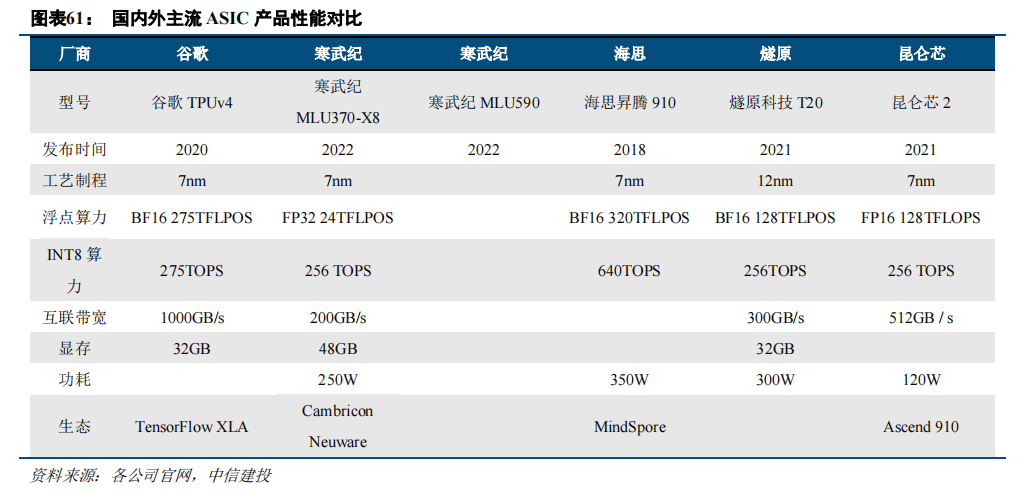

國產廠商快速發展,寒武紀等異軍突起。通過產品對比發現,目前寒武紀、海思昇騰、遂原科技等國產廠商正通過技術創新和設計優化,持續提升產品的性能、能效和易用性,推動產品競爭力不斷提升,未來國產廠商有望在 ASIC 領域持續發力,突破國外廠商在 AI 芯片的壟斷格局。國內主要 AI 用 ASIC 廠商及產品如下:

1)寒武紀:云端人工智能領域,推出思元系列產品。其中,MLU100 芯片是中國首款高峰值云端智能芯片。MLU290 芯片是寒武紀首款云端訓練智能芯片,采用了 7nm 工藝,性能功耗上接近英偉達 A100,理論峰值性分別高達 1024TOPS(INT4)、512TOPS(INT8)。思元 370(MLU370)芯片是寒武紀首款采用 Chiplet(芯粒)技術的人工智能芯片,是寒武紀第二代云端推理產品思元 270 算力的 2 倍。MLU370-X8 與 MLU370-M8 是寒武紀基于思元 370 云端智能芯片打造的兩款不同形態的人工智能加速卡。MLU370-X8 采用雙芯思元 370 配置,為雙槽位 250w 全尺寸智能加速卡,提供 24TFLOPS(FP32)訓練算力和 256TOPS(INT8)推理算力;MLU370-M8 是寒武紀面向數據中心場景打造的 OAM 形態智能加速卡,可提供 32TFLOPS(FP32)訓練算力和 340 TOPS(INT8)推理算力。兩款加速卡均支持寒武紀 MLU-Link 芯片間互聯,可滿足多樣化人工智能模型的訓練和推理需求。

此外,公司正在開展新一代思元 590 的開發,將采用 MLUarch05 全新架構,能夠提供更大的內存容量和更高的內存帶寬,其 I/O 和片間互聯接口也較上代實現大幅升級。

2)華為海思:推出昇騰系列產品。其中昇騰 310 在典型配置下可以輸出 16TOPS@INT8, 8TOPS@FP16,功耗僅為 8W,采用自研華為達芬奇架構,集成豐富的計算單元, 提高 AI 計算完備度和效率,進而擴展該芯片的適用性,全 AI 業務流程加速,大幅提高 AI 全系統的性能,有效降低部署成本。昇騰 910 是業界算力最強的AI 處理器,基于自研華為達芬奇架構 3D Cube 技術,半精度(FP16)算力達到 320 TFLOPS,整數精度(INT8)算力達到 640 TOPS,功耗 310W,可支持云邊端全棧全場景應用。表觀性能上,昇騰 910 芯片性能接近英偉達A100,但華為是基于自研的深度學習框架 MindSpore 與算力芯片進行相互優化,與 Tensorflow/Pytorch 兩大主流深度學習訓練框架的融合度不足,未來仍需要一定的時間進行生態建設。

3)燧原科技:2019 年 12 月首發云端 AI 訓練加速芯片邃思 1.0 及訓練加速卡產品,2020 年推出推理加速卡,2021 年 7 月推出的第二代云端 AI 訓練加速芯片邃思 2.0,單精度 FP32 峰值算力達到 40TFLOPS,單精度張量 TF32 峰值算力達到 160TFLOPS。同時搭載了 4 顆 HBM2E 片上存儲芯片,高配支持 64GB 內存,帶寬達1.8TB/s。

4)昆侖芯:昆侖芯 1 代 AI 芯片于 2020 年量產,在百度搜索引擎、小度等業務中部署數萬片,是國內唯一一款經歷過互聯網大規模核心算法考驗的云端 AI 芯片。昆侖芯 2 代 AI 芯片于 2021 年 8 月量產,是國內首款采用 GDDR6 顯存的通用 AI 芯片,相比昆侖芯 1 代 AI 芯片性能提升 2-3 倍,且在通用性、易用性方面也有顯著增強。昆侖芯 3 代有望在 2024 年規模上市,或將采用了 Huawei Da Vinci(達芬奇) 架構,峰值性能為 256TeraFLOPS,支持更多的運算和深度學習技術,例如 ONNX、TensorFlow 和 PyTorch。

英偉達領先地位穩固。英偉達憑借良好的硬件性能和完善的 CUDA 生態將持續處于領先地位,但起步較晚的挑戰者也在奮起直追,未來有望出現一超多強的多元化競爭格局。訓練市場方面,英偉達高算力 GPU 是當前AI 訓練主流選擇,谷歌 TPU 面臨著通用性的局限,AMD 存在生態構建差距,但在二者的沖擊及云廠商自研芯片的競爭下,AI 訓練市場也或將出現格局的變動。推理市場方面,GPU 具有較好的生態延續性仍占主流,如英偉達針對推理市場的產品 Tesla T4 上的芯片包含了 2560 個 CUDA 內核,性能達到了 FP64 0.25 TFLOPS、FP32 8.1TFLOPS、INT8 達 130 TOPS,可提供多精度推理性能,以及優于 CPU 40 倍的低延時高吞吐量,可以實時滿足更多的請求。但其他解決方案在成本、功耗具有優勢,特定市場競爭格局相對激烈,工作負載不同對應的芯片性能需求不同,T4 PCIe,有望出現各類芯片共存的局面。

國內算力芯片廠商具備較好的入局機會。國產算力芯片市場需求巨大,國內人工智能生態環境較好,在 AI應用領域的步伐處于全球前列,國產 GPU 廠商具孵化和發展的沃土,國內廠商供應鏈多元化的需求帶來了國內AI 芯片廠商適配窗口期,尤其是當前大模型發展早期是適配的黃金窗口期。其中,寒武紀、華為等兼容 CUDA和自建生態是國產廠商發展的兩大趨勢,具備很大的競爭力潛力。短期來看,國內廠商兼容英偉達 CUDA,可以減輕開發和遷移難度,進而快速實現客戶端導入。

同時需要避開英偉達絕對優勢領域,在芯片設計結構上形成差異化競爭;長期來看,國產 GPU 如果完全依賴 CUDA 生態,硬件更新將不得不綁定英偉達的開發進程,應借鑒 AMD、Google 構建自身生態體系,開展軟硬件結合的平臺化布局,并打造不同領域快速落地垂直解決方案的能力,鑄造自己的生態圈核心壁壘。預計硬件性能高效以及能夠構建符合下游需求的生態體系的國產廠商有望脫穎而出。

編輯:黃飛

?

電子發燒友App

電子發燒友App

評論