雖然FPGA一直在數十億美元的小眾市場行走,在整個千億元級IC大盤中只占據一隅,但并不妨礙它的追逐之夢,而AI、自動駕駛、5G等浪潮興起為它的夢想插上了翅膀。就像1984年發明FPGA成為開創者一樣,賽靈思 ACAP(自適應計算加速平臺)首款產品系列Versal 的正式面世,使FPGA完成了從器件到平臺的蝶變,也因而賽靈思將直面英特爾、英偉達的競爭,面對規模高出數倍乃至數十倍的競爭對手,Versal能否讓賽靈思開啟涅槃之旅。

一直在與自己賽跑的FPGA獨行俠——賽靈思(Xilinx),在其2018開發者大會(XDF)上重磅發布了業界7nm自適應計算加速平臺 (ACAP)首款產品——Versal。賽靈思總裁及CEO Victor Peng在解釋Versal名稱意義時說,Versal寓意Versatile (多樣化的)+ Universal(通用的), 代表集多樣性和通用性一體,是一款可面向所有應用、面向所有開發者的平臺級產品。而Versal的面世表明賽靈思已不再是單純的FPGA公司,而轉變成平臺公司。這也意味著賽靈思將不再囿于FPGA做文章,而將染指CPU、GPU等占領的市場,直面與英特爾、英偉達的競爭,Versal憑何給予賽靈思這樣的勇氣?

為何開發ACAP平臺?

或許這是大勢使然。

“隨著摩爾定律的放緩以及大數據、AI、5G、自動駕駛等的發展,對于計算能力和帶寬提出了前所未有的要求,同時新的算法新的框架層出不窮,要應對這一變化就需要靈活應變的架構,而傳統芯片設計的周期已經無法跟上創新的步伐。” Victor Peng強調,“就像自然界的適者生存一樣,在數字世界靈活應變的系統才是最可持續的。”

而這一靈活應變的架構就是異構計算。賽靈思產品及技術營銷高級技術總監Kirk Saban認為,一種架構已無法獨自完成大量的數據處理,需要異構計算。而從過去多年IC發展來看,計算引擎CPU單純采用“工藝縮放scaling”技術發展的道路遇到了很大的挑戰,難以通過等量的計算提升換取等量的性能提升,迫使計算引擎變成并行趨勢。

為此,賽靈思啟動代號為“Evest(珠穆朗瑪)”的計劃,意在打造一個具有靈活應變能力的自適應異構計算加速平臺,支持所有類型的開發者通過優化的軟硬件來為應用加速,同時具備靈活的應變能力,Victor Peng笑言Versal是在業界需求最迫切的時刻雪中送炭。

當然Versal要具備上述“魔力”,賽靈思也投入巨大,數十億美元、上千名工程師、歷時 4 年終才出手。 賽靈思軟件及IP產品執行副總裁Salil Raje 對此表示,在開發過程中,Versal要解決諸多挑戰,不只是硬件如處理器、AI引擎、收發器等整合,還有軟件、7納米FinFET工藝等,是一個非常大的系統工程。賽靈思花了幾千小時的人工來確保軟件工具的簡單易用,對所有架構進行了重新布置,確保這一平臺能夠自上而下的軟件可編程,也進一步提升了準入門檻。

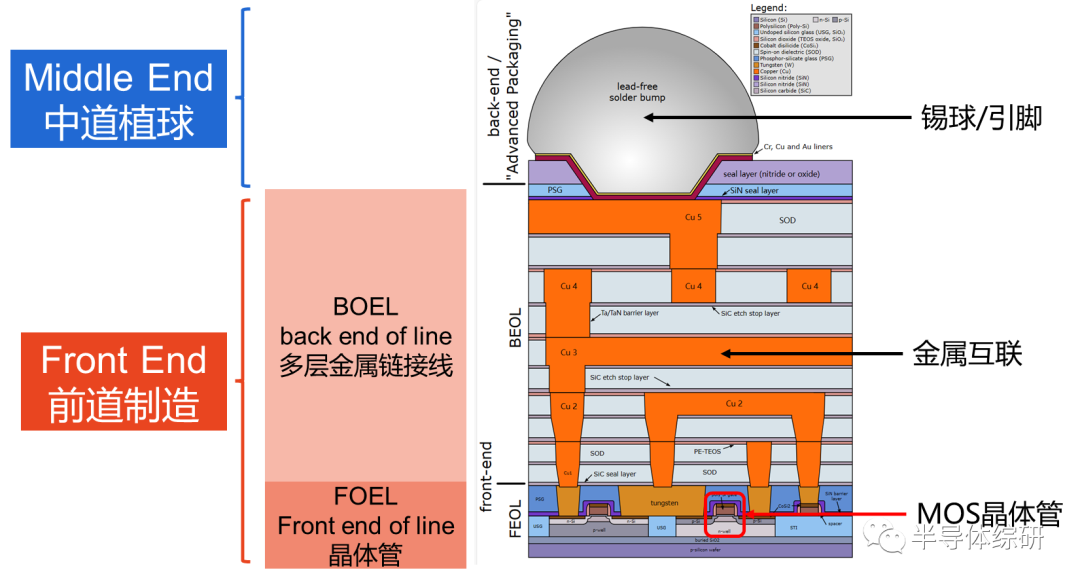

而在這一過程中,FPGA從最初的邏輯門到SoC、MPSoC、RFSoC芯片再進化到ACAP,如在28納米時集成了編解碼處理器,在16納米級別加入了GPU之后,完成了從FPGA器件到平臺ACAP的蝶變,也將開啟賽靈思的新征程。

Versal的功力

被寄與厚望的Versal平臺究竟有何“功力”擔當重任?

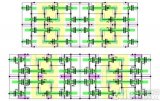

先來看其硬件。賽靈思產品及技術營銷高級技術總監Kirk Saban指出,異構計算平臺必須要有多個不同類型的處理引擎,以應對不同的工作負載。Versal平臺整合了三種類型的可編程處理器即標量引擎雙Arm Cortex-A72和Cortex-R5處理器、自適應引擎PL、智能引擎即AI引擎和DSP引擎,以及前沿的存儲器、高速收發器和多種接口技術等。

這些引擎形成一個緊密集成的異構計算平臺,并且各司其職。Kirk Saban介紹,Arm處理器通常用于控制應用、操作系統、通信接口等;PL執行數據操作和傳輸、非基于向量的計算和連接;AI引擎為基于向量的算法提供了高達五倍的計算密度。同時,這一切與片上網絡 (NoC) 連通,提供對所有三種處理單元類型的存儲器映射訪問,從而比任何一種單獨架構都支持更高的定制和性能提升。

值得一提的是,賽靈思獨創的AI引擎是一種新型硬件模塊,包括用于定點和浮點運算的向量處理器、標量處理器、專用程序和數據存儲器、專用AXI 數據移動通道以及 DMA 和鎖止。它針對計算和DSP進行了優化,可滿足高吞吐量和高性能計算要求。相對于業界領先的GPU,AI 推斷性能預計能提升3-8倍,功耗降低 50%。

在軟件層面,Kirk Saban提到,Versal平臺引入革新性的軟件堆棧即NoC平臺管理控制器,提供了無縫連接的功能,可直接通過軟件進行編程和配置。同時,符合業界標準設計流程的一系列工具、軟件、庫、IP等助力,使得Versal ACAP 的硬件和軟件均可由開發者進行編程和優化,而這在賽靈思的歷史上也是絕無僅有的。

由此,硬件和軟件的共同創新成就了Versal ACAP 這一顛覆性的異構計算平臺,實現了顯著的性能提升。Kirk Saban舉出了具體數字,其速度超過當前最高速的FPGA 20倍、比當今最快的CPU快100倍,同時可實現低于2ms的時延,相信數據中心、有線網絡、5G無線和ADAS等應用將樂見其成。

據悉,Versal平臺組合包括Versal基礎系列(Versal Prime)、Versal旗艦系列(Versal Premium)和HBM系列,提供不同的性能、連接性、帶寬和集成功能。此外,還包括Versal AI系列,包括AI核心(AI Core)系列、AI邊緣系列和AI射頻系列。Versal Prime 系列和AI Core 系列將于2019年下半年上市。前者具廣泛的適用性,用于在線加速和各種工作負載;后者提供高計算性能和最低時延,實現突破性的 AI 推斷吞吐量和性能。

同時,賽靈思還公布了發展路線圖,2020年將推出Premium和AI邊緣系列,下半年將上市AI射頻系列,而HBM將于2021年下半年面世。

其他架構自求多福?

Versal橫空出世,其它選手如CPU、ASIC等如何應對?

畢竟它們各有“苦衷”。Kirk Saban認為,標量處理單元(例如 CPU)在具有不同決策樹和廣泛庫的復雜算法中非常有效,但在性能擴展方面受到限制。而在先進制程后摩爾定律已經不再有效,CPU已無法適應最先進的應用了。

而矢量處理單元(如GPU)在并行計算上效率更高,但由于存儲器層級結構不靈活,它們會受時延和效率的影響。它們可能在某一個功能領域的加速性能不錯,但靈活度不夠,無法適應創新的速度。

并且,通用AI芯片不是正確的方向。Kirk Saban分析說,ASIC針對某個CNN、DNN來優化形成固定功能,一旦有新的算法或者框架就需要重新設計,在目前發展態勢下對于變量少的行業ASIC相對適用,如果變化快ASIC很快就會過時,實際上連谷歌的TPU也概莫能外。

雖然GPU等有著相對完善的生態系統,但Versal作為新興勢力,在生態的構建上也在大張旗鼓,一方面Versal可軟硬件編輯,開發便利;另一方面,在著力與合作伙伴一起互惠共贏。 “Versal不會取代所有的GPU,但肯定會有越來越多的應用采用靈活應變的平臺。”這是Victor Peng的判斷也是寄望。

為何著重AI推斷?

需要指出的是,Versal看重的是AI推斷市場。

Salil Raje指出,AI有訓練和推斷兩大階段。對于訓練來說海量數據非常重要,但延遲和功耗都不那么重要。而無論是在邊緣端還是云端的推斷,數據量很少,實時響應的性能非常重要,對延遲要求極高,而且對功耗也極為看重。

“AI訓練和推斷的要求是不一的,不能把訓練的解決方案直接應用到推斷上。在過去幾年,全球關注的主要是AI訓練,這是因為眾多新的AI應用需要應用AI模型,但今后AI模型將大量應用在云端和邊緣端,因而未來的模式更多的是AI推斷,而不是訓練。”

由此亦帶來了新的挑戰。Salil Raje指出,挑戰在于一是AI創新的速度,就像要追隨移動的靶子一樣。二是需要低時延、高帶寬和高性能,最大的挑戰是功耗。三是要實現整體的應用加速,而不僅是機器學習的加速。

當然,AI訓練也是非常重要的市場。Salil Raje表示,賽靈思也在研發訓練用FPGA方案,不排除進入這一市場的可能性。

中國AI初創企業不應熱衷于造芯

Versal平臺染指AI應用,也預示著賽靈思要直面國內火爆的AI造芯廠商的競爭,對于這一點,賽靈思也有自己的見解。

“中國有大量AI初創企業,也有很多廠商在投入造芯,但賽靈思認為他們其實不一定要熱衷于造芯。因為設計AI芯片目前要采用16納米甚至7納米的工藝,所需的投入是巨大的,風險也很大。” Victor Peng提出了建議,“其實他們可在算法和框架方面深入研究,從這些層面來創造更多的價值;或者采用Versal平臺開發具體應用,而不是投資幾億元去做芯片。”

“就像深鑒科技,兩年前就基于賽靈思產品做AI方面的開發,因此在被收購后其成果可迅速應用到Versal平臺上,深鑒科技最為核心的就是DPU及神經網絡壓縮編譯技術,應用此技術的Versal平臺可適應不同精度不同位寬,并且時延大幅降低。”Salil Raje提及。

而對于華為、阿里都在打造屬于自有AI芯片的情形,Victor Peng表示,這表明目前正處于AI革命的早期,大家都在尋找不同的解決方案,這帶來了眾多機遇。可能有一些領域是適用于固定功能的芯片,但絕大多數應用還將使用靈活平臺作為解決方案。

為何還要推出加速器卡?

除了打造Versal平臺之外,賽靈思也意識到在云端和數據中心的服務器中,FPGA作為一種服務即FaaS的部署正在加快。Victor Peng介紹說,FaaS最初是從亞馬遜開始部署,現已有8個國家在采用,今年賽靈思已培訓超過14000名的開發者,實現了36個應用。在XDF大會上,亞馬遜就面向中國開發者宣布AWS F1覆蓋區域數量翻番,并正式落地中國。

與之相呼應的是,據分析,全球加速器卡的市場將達到120億美元,而中國市場占據半壁江山。

為此,賽靈思還推出了功能強大的加速器卡——Alveo,它的優勢在于客戶可對硬件進行重配置,針對工作負載、新標準和新算法進行調整和優化,并且更加易用,同時性能更加出色。

就機器學習而言,Alveo U250實時推斷吞吐量比高端 CPU高出20 倍,相對于高端GPU等,能讓2毫秒以下的低時延應用性能提升4倍以上,堪稱全球最快的數據中心加速卡。

而且,目前Alveo得到了合作伙伴和 OEM 廠商生態系統的廣泛支持,有14 家合作伙伴開發完成的應用可立即投入部署,國內如華為、阿里云、浪潮等都已在合作,推出基于賽靈思的加速方案。此外,部分OEM芯片廠商將和賽靈思進入更深入合作,認證采用Alveo加速器卡的多個服務器SKU,包括Dell EMC、Fujitsu和IBM等。這些關鍵應用涵蓋AI/ML、視頻轉碼、數據分析、金融風險建模、安全和基因組學等。

阿里云FPGA異構計算研發總監張振祥宣稱,阿里集團采用Faas提升發效率,節省了成本,阿里集團X項目每千片FPGA三年節約TCO成本40%。華為IT智能計算產品線副總裁張小華也提到,華為云與賽靈思緊密合作,實現了線上線下協同的FPGA加速解決方案,以視頻編解碼為例,在在線視頻廣播業務場景下可節約40%的帶寬和存儲空間,為客戶帶來了極大的價值。

電子發燒友App

電子發燒友App

評論