規(guī)則引導(dǎo)的知識圖譜聯(lián)合嵌入方法

人工智能技術(shù)與咨詢?

本文來自《計(jì)算機(jī)研究與發(fā)展》?,作者姚思雨等

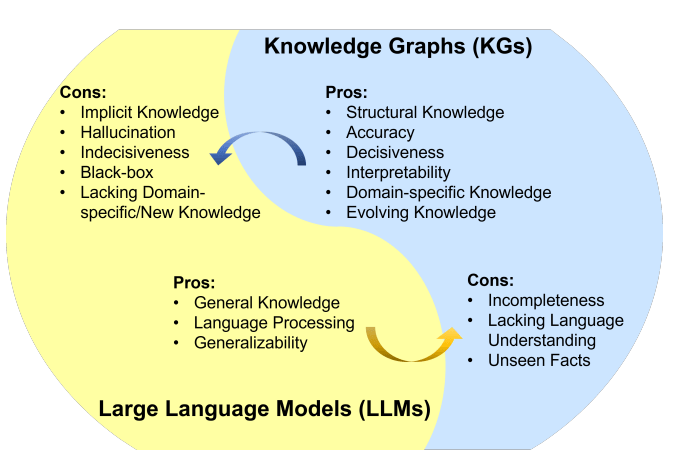

摘 要?近年來,大量研究工作致力于知識圖譜的嵌入學(xué)習(xí),旨在將知識圖譜中的實(shí)體與關(guān)系映射到低維連續(xù)的向量空間中.且所學(xué)習(xí)到的嵌入表示已被成功用于緩解大規(guī)模知識圖譜的計(jì)算效率低下問題.然而,大多數(shù)現(xiàn)有嵌入學(xué)習(xí)模型僅考慮知識圖譜的結(jié)構(gòu)信息.知識圖譜中還包含有豐富的上下文信息和文本信息,它們也可被用于學(xué)習(xí)更準(zhǔn)確的嵌入表示.針對這一問題,提出了一種規(guī)則引導(dǎo)的知識圖譜聯(lián)合嵌入學(xué)習(xí)模型,基于圖卷積網(wǎng)絡(luò),將上下文信息與文本信息融合到實(shí)體與關(guān)系的嵌入表示中.特別是針對上下文信息的卷積編碼,通過計(jì)算單條上下文信息的置信度與關(guān)聯(lián)度來度量其重要程度.對于置信度,定義了一個(gè)簡單有效的規(guī)則并依據(jù)該規(guī)則進(jìn)行計(jì)算.對于關(guān)聯(lián)度,提出了一種基于文本表示的計(jì)算方法.最后,在2個(gè)基準(zhǔn)數(shù)據(jù)集上進(jìn)行的實(shí)驗(yàn)結(jié)果證明了模型的有效性.

關(guān)鍵詞?知識圖譜;表示學(xué)習(xí);圖卷積網(wǎng)絡(luò);上下文信息;文本信息

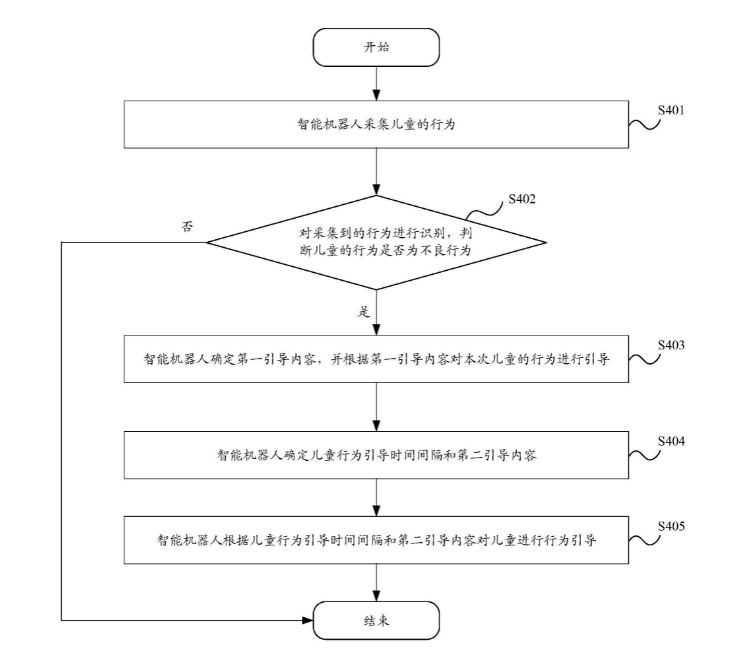

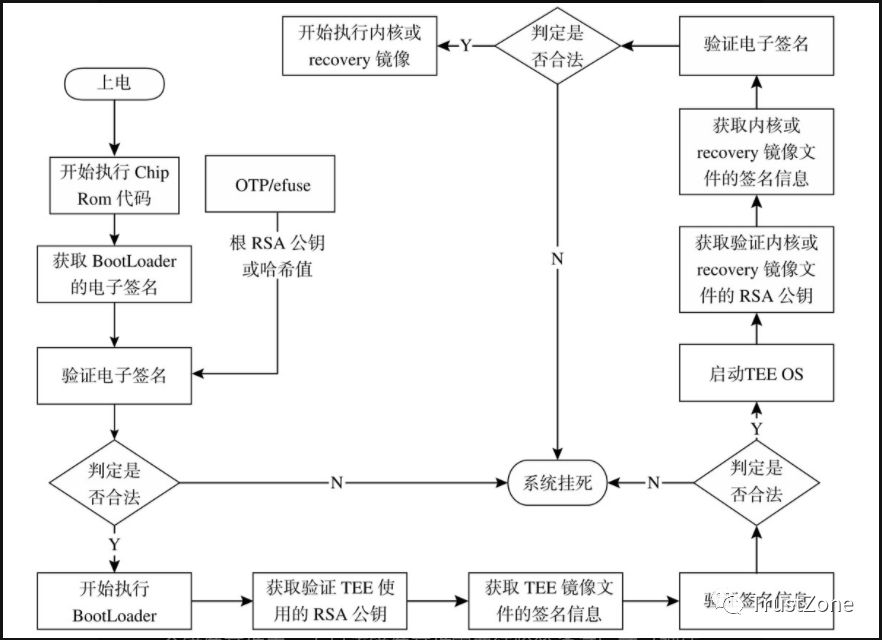

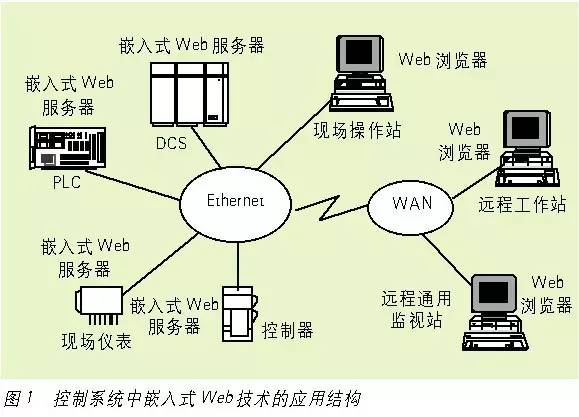

近年來,由于具有表達(dá)能力強(qiáng)、歧義性低、模式統(tǒng)一、且支持推理等優(yōu)點(diǎn),知識圖譜已被廣泛用于組織和發(fā)布各領(lǐng)域的結(jié)構(gòu)化數(shù)據(jù).通常,知識圖譜由實(shí)體、實(shí)體所具有的屬性以及實(shí)體間的關(guān)系所組成.例如,其中可能包含有實(shí)體中國、關(guān)系首都以及實(shí)體屬性“China”. 如圖1所示,知識圖譜的基礎(chǔ)構(gòu)成則是描述2個(gè)實(shí)體之間的關(guān)系或?qū)嶓w及其屬性之間關(guān)系的三元組,如(中國,首都,北京)、(中國,英語標(biāo)簽,“China”).

Fig. 1 Several triples which contain the entity Beijing and the related literals

圖1 包含實(shí)體“北京”的若干三元組及文本信息

目前,知識圖譜已被廣泛應(yīng)用在智能問答[1]、推薦系統(tǒng)[2]和信息檢索[3]等任務(wù)中,其突出表現(xiàn)在學(xué)術(shù)與工業(yè)界均獲得了廣泛關(guān)注[4].但是,受益于知識圖譜所包含豐富信息的同時(shí),其龐大的規(guī)模與數(shù)據(jù)稀疏性問題也給知識圖譜的應(yīng)用帶來了挑戰(zhàn).例如,F(xiàn)reebase[5], Yago[6]和Dbpedia[7]等開放領(lǐng)域知識圖譜中通常包含有數(shù)百萬個(gè)實(shí)體,以及上億條描述實(shí)體關(guān)系的三元組.將子圖匹配等傳統(tǒng)圖算法應(yīng)用在這些大規(guī)模知識圖譜上往往存在計(jì)算低效性問題.為此,研究人員提出了知識圖譜嵌入學(xué)習(xí)模型(knowledge graph embedding learning model),將知識圖譜映射到低維、連續(xù)的向量空間中,學(xué)習(xí)實(shí)體與關(guān)系的嵌入表示[8].

通過設(shè)計(jì)特定的表示學(xué)習(xí)機(jī)制,知識圖譜的結(jié)構(gòu)和語義等信息可被編碼在所學(xué)習(xí)到的嵌入表示中.一方面,原本需要對大規(guī)模知識圖譜進(jìn)行頻繁訪問的操作,例如結(jié)構(gòu)化查詢構(gòu)建(structured query construction)[9]、邏輯查詢執(zhí)行(logical query pro-cessing)[10]和查詢放縮(query relaxation)[11],均可在所學(xué)習(xí)到的嵌入表示空間中通過數(shù)值計(jì)算完成,極大地提高了效率.另一方面,知識圖譜的嵌入學(xué)習(xí)提供了一種抽取并高效表示知識圖譜特征信息的方法,類似于自然語言處理領(lǐng)域中被廣泛應(yīng)用的詞嵌入(word embedding),知識圖譜的嵌入表示也為基于知識圖譜的深度學(xué)習(xí)工作提供了極大的便利.

現(xiàn)有知識圖譜嵌入學(xué)習(xí)模型大多僅關(guān)注知識圖譜中以三元組表示的結(jié)構(gòu)信息.例如,Bordes等人提出了基于翻譯機(jī)制(translation mechanism)的TransE模型[12],其目標(biāo)任務(wù)為鏈接預(yù)測(link prediction)與三元組分類(triple classification),概括而言就是判斷知識圖譜中給定的2個(gè)實(shí)體之間是否存在某個(gè)關(guān)系.因此TransE模型僅關(guān)注所學(xué)習(xí)到的嵌入表示對單條三元組結(jié)構(gòu)信息的編碼,其在嵌入學(xué)習(xí)過程中將知識圖譜簡化為互不相關(guān)的三元組的有限集合.因此,TransE及其后續(xù)改進(jìn)模型[13-16]對知識圖譜中上下文信息的編碼能力非常弱,很難應(yīng)用于語義相關(guān)的任務(wù).針對這一問題,相繼有一些基于上下文信息的嵌入表示模型被提出,如GAKE[17], RDF2Vec[18].但是它們?nèi)匀粌H關(guān)注知識圖譜中由子圖、路徑等結(jié)構(gòu)所表示的上下文信息.例如,在學(xué)習(xí)圖1中實(shí)體北京的嵌入表示時(shí),上述方法僅關(guān)注(中國,首都,北京)與(北京,位于,華北)等描述實(shí)體間關(guān)系的三元組,而忽略了北京的簡介、英文標(biāo)簽等文本信息.顯然,文本信息的缺失限制了所學(xué)到嵌入表示對語義信息的表達(dá).

為解決這一問題,本文提出了一種規(guī)則引導(dǎo)的知識圖譜聯(lián)合嵌入學(xué)習(xí)模型.受Vashishth等人[19]所提出的圖卷積網(wǎng)絡(luò)啟發(fā),模型首先通過多關(guān)系型圖卷積將實(shí)體在知識圖譜中的上下文信息編碼到實(shí)體的嵌入表示中.與Vashishth等人的工作所不同的是,本文認(rèn)為實(shí)體的多條上下文信息應(yīng)該具有不同的重要程度,并且某條上下文信息的重要程度取決于2個(gè)因素:該條上下文信息的置信度,以及其相對于實(shí)體的關(guān)聯(lián)度.為此,本文提出了一條簡單有效的規(guī)則引導(dǎo)上下文信息置信度的計(jì)算,并基于知識圖譜中的文本信息表示提出了實(shí)體與其上下文信息之間關(guān)聯(lián)度的計(jì)算方法.最后,模型將圖卷積網(wǎng)絡(luò)所編碼的嵌入表示與文本信息的向量表示整合,以鏈接預(yù)測任務(wù)的結(jié)果作為訓(xùn)練目標(biāo),學(xué)習(xí)知識圖譜中實(shí)體與關(guān)系的嵌入表示.

本文貢獻(xiàn)主要體現(xiàn)在3個(gè)方面:

1) 基于圖卷積網(wǎng)絡(luò),創(chuàng)新地提出了一種聯(lián)合考慮知識圖譜中上下文信息與文本信息,由規(guī)則引導(dǎo)的嵌入表示學(xué)習(xí)模型.

2) 針對上下文信息在圖卷積中的重要程度,提出了應(yīng)用規(guī)則以及知識圖譜中文本信息來計(jì)算單條上下文信息置信度與關(guān)聯(lián)度的新方法.

3) 在基準(zhǔn)數(shù)據(jù)集上進(jìn)行了充分的實(shí)驗(yàn),并與相關(guān)的知識圖譜嵌入學(xué)習(xí)方法進(jìn)行了對比,實(shí)驗(yàn)結(jié)果驗(yàn)證了本文模型的有效性.

1 相關(guān)工作

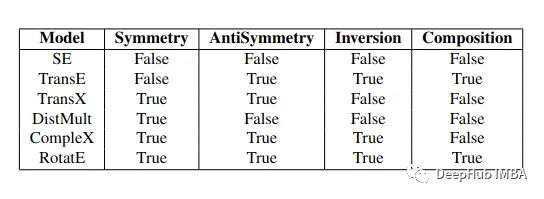

本節(jié)對與本文工作較相關(guān)的知識圖譜嵌入學(xué)習(xí)模型進(jìn)行介紹,由于本文所提出的模型是基于圖神經(jīng)網(wǎng)絡(luò)的,因此分別介紹基于圖神經(jīng)網(wǎng)絡(luò)的知識圖譜嵌入學(xué)習(xí)模型和其他非圖神經(jīng)網(wǎng)絡(luò)的嵌入學(xué)習(xí)模型.

1.1 基于圖神經(jīng)網(wǎng)絡(luò)的模型

基于圖神經(jīng)網(wǎng)絡(luò)的模型主要包括R-GCN[20], W-GCN[21], CompGCN[19]等.該類模型通常將圖卷積網(wǎng)絡(luò)作為編碼器,對圖結(jié)構(gòu)數(shù)據(jù)進(jìn)行編碼,并結(jié)合對應(yīng)的解碼器進(jìn)行知識圖譜上的鏈接預(yù)測、節(jié)點(diǎn)分類等任務(wù).在R-GCN中,每層網(wǎng)絡(luò)中節(jié)點(diǎn)與關(guān)系的特征利用權(quán)重矩陣進(jìn)行計(jì)算,并通過領(lǐng)域聚合的方式傳遞至后續(xù)網(wǎng)絡(luò)層.具體而言,R-GCN利用基分解和塊對角分解構(gòu)造特定關(guān)系的權(quán)重矩陣,以處理不同類型的鄰居關(guān)系,將其與鄰居節(jié)點(diǎn)信息進(jìn)行融合,并傳遞到目標(biāo)實(shí)體上進(jìn)行更新.W-GCN在圖卷積網(wǎng)絡(luò)聚合過程中為每個(gè)權(quán)重矩陣分配可學(xué)習(xí)的權(quán)重參數(shù),使模型獲得更優(yōu)的實(shí)體嵌入表示.CompGCN則提出了針對中心節(jié)點(diǎn)的領(lǐng)域信息聚合方法,在理論上使用多種“實(shí)體-關(guān)系”組合算法對當(dāng)前主流的基于多關(guān)系的圖卷積網(wǎng)絡(luò)模型進(jìn)行了概括.

1.2 非圖神經(jīng)網(wǎng)絡(luò)的模型

非圖神經(jīng)網(wǎng)絡(luò)的嵌入學(xué)習(xí)模型類別較多,主要包括基于翻譯機(jī)制的模型,如TransE[12]及其后續(xù)改進(jìn)模型,包括TransH[13],TransR[14],TransD[15],TransAH[16],基于上下文信息的模型,如GAKE[17],RDF2Vec[18],基于張量分解的模型,如ComplEx[22],RESCAL[23].

其中,基于翻譯機(jī)制的模型應(yīng)用較為廣泛.該類模型通常僅關(guān)注知識圖譜的結(jié)構(gòu)信息,將實(shí)體之間的關(guān)系表示為嵌入向量空間中的某種翻譯操作(translation operation).以TransE為例,其將知識圖譜中的實(shí)體與關(guān)系都表示在同一個(gè)低維歐幾里得空間中,以向量表示一個(gè)實(shí)體或關(guān)系.具體而言,對于知識圖譜中的一條三元組(h,r,t),TransE 將其中的關(guān)系r看作在歐幾里得空間中從頭實(shí)體h到尾實(shí)體t的平移操作,即其期望頭實(shí)體所對應(yīng)的向量h經(jīng)過關(guān)系所對應(yīng)的向量r的平移操作后可以非常逼近尾實(shí)體所對應(yīng)的向量t,即h+r≈t.

TransE的翻譯機(jī)制較為簡單,因此可以高效地應(yīng)用于大規(guī)模知識圖譜,但同時(shí)又限制了其模型的表達(dá)能力,使其難以處理一對多、多對一以及多對多類型的復(fù)雜關(guān)系[14].為解決這一問題,TransE之后相繼有一些翻譯機(jī)制更加復(fù)雜的模型被提出.例如,TransH[15]相對于所給定三元組中關(guān)系的超平面空間設(shè)計(jì)翻譯機(jī)制,TransR[16]則針對知識圖譜中的每一個(gè)關(guān)系額外學(xué)習(xí)一個(gè)矩陣,借助該矩陣將頭、尾實(shí)體通過線性變換映射到相應(yīng)的關(guān)系向量空間中,然后再計(jì)算其翻譯機(jī)制的損失值.

2 聯(lián)合嵌入表示學(xué)習(xí)

本節(jié)首先對知識圖譜嵌入學(xué)習(xí)問題進(jìn)行形式化定義,介紹相關(guān)概念的符號表示,然后詳細(xì)介紹所提出的規(guī)則引導(dǎo)的聯(lián)合嵌入學(xué)習(xí)模型.

2.1 問題定義

本文將知識圖譜表示為

其中

分別代表知識圖譜中的實(shí)體與關(guān)系集合.對于某個(gè)三元組

其中頭尾實(shí)體均屬于實(shí)體集合,即

其中關(guān)系屬于關(guān)系集合,即

知識圖譜的嵌入學(xué)習(xí)問題在于學(xué)習(xí)給定知識圖譜

中任意實(shí)體

與任意關(guān)系

的向量表示e,r∈

d,其中為d嵌入表示的維度.本文通過鏈接預(yù)測任務(wù)評價(jià)所學(xué)習(xí)到的嵌入表示,該任務(wù)可能包括2種情形:給定實(shí)體

與關(guān)系

基于它們的嵌入表示e,r∈

d,預(yù)測另外一個(gè)實(shí)體

使得存在三元組

或

或者給定2個(gè)實(shí)體

基于它們的嵌入表示e,e′∈

d,預(yù)測一個(gè)關(guān)系

使得存在三元組

或

對于任意實(shí)體

與關(guān)系

本文將它們所對應(yīng)的文本信息表示為le與lr.對于實(shí)體

本文將其所有鄰居三元組的集合

視為e的上下文,具體而言

為集合

與集合

的并集,且對于

中任意鄰居三元組,本文認(rèn)為其表達(dá)了節(jié)點(diǎn)e的一條上下文信息.

與Vashishth等人[19]的做法類似,本文也對知識圖譜的關(guān)系集合進(jìn)行擴(kuò)充:

其中

為逆關(guān)系集合.具體而言,對于任意三元組

本文在關(guān)系集合中增加一條逆關(guān)系r-1,并相應(yīng)地將三元組(et,r-1,eh)添加到知識圖譜

中,即

代表自環(huán)關(guān)系集合,即對于任意實(shí)體

在知識圖譜

中添加自環(huán)三元組,即

此外,本文使用

代表實(shí)體e周圍鄰居實(shí)體的集合,

代表實(shí)體e周圍鄰居關(guān)系的集合,例如對于圖1中的實(shí)體北京,其鄰居實(shí)體集合為{華北,中國,…},鄰居關(guān)系集合為{位于,首都,簡介,英文標(biāo)簽,…}.

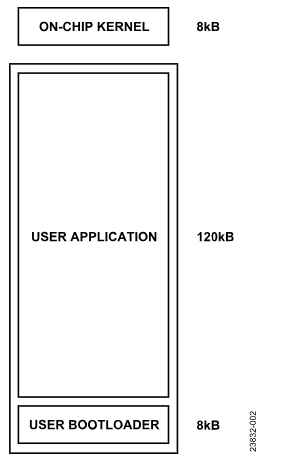

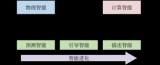

2.2 模型整體架構(gòu)

本文基于知識圖譜的上下文信息與文本信息聯(lián)合學(xué)習(xí)實(shí)體與關(guān)系的嵌入表示.圖2展示了模型的整體架構(gòu),針對節(jié)點(diǎn)eh,其上下文信息

由包括三元組(eh,ri,eti)在內(nèi)的所有鄰居三元組表達(dá).本文模型利用圖卷積網(wǎng)絡(luò),基于

將eh的上下文信息編碼到其嵌入表示中.并且,本文認(rèn)為eh的不同鄰居三元組所各自表達(dá)的上下文信息具有不同的重要程度,通過計(jì)算單條上下文信息的置信度與關(guān)聯(lián)度對其重要程度進(jìn)行度量.

對于置信度計(jì)算,本文針對上下文信息中所包含的關(guān)系提出一條簡單有效的規(guī)則,并基于該規(guī)則在嵌入學(xué)習(xí)之前預(yù)先計(jì)算特定于一對關(guān)系的置信度矩陣C,并在圖卷積過程中利用該矩陣計(jì)算某條上下文信息的置信度,如圖2中標(biāo)有置信度計(jì)算的虛線所示.

Fig. 2 An overview of the core part of the model

圖2 模型核心部分框架圖

?

對于關(guān)聯(lián)度計(jì)算,本文首先利用預(yù)訓(xùn)練語言模型對知識圖譜中實(shí)體與關(guān)系的文本信息進(jìn)行編碼.如圖2所示,對于實(shí)體eh與關(guān)系ri的文本leh與lri,它們的文本向量分別記為Leh與Lri.本文基于實(shí)體與關(guān)系的文本向量表示計(jì)算單條上下文信息與其對應(yīng)實(shí)體之間的關(guān)聯(lián)度,如圖2中標(biāo)有關(guān)聯(lián)度計(jì)算的虛線所示.

值得一提的是,本文所提出的模型采用“編碼器-解碼器”框架(encoder-decoder).上述基于圖卷積網(wǎng)絡(luò)的上下文信息編碼即為編碼器的主要內(nèi)容.除此之外,編碼器還將上述過程學(xué)習(xí)到的實(shí)體與關(guān)系的嵌入表示與它們的文本表示相結(jié)合.本文模型的解碼器則主要基于ConvE模型[24]實(shí)現(xiàn).下面對模型的細(xì)節(jié)進(jìn)行詳細(xì)的介紹.

2.3 編碼器

規(guī)則引導(dǎo)的置信度計(jì)算. 知識圖譜中的關(guān)系并非相互獨(dú)立.對于一個(gè)實(shí)體

當(dāng)e擁有一條鄰居關(guān)系

時(shí),這可能暗示其還同時(shí)擁有另一條鄰居關(guān)系

例如,當(dāng)某個(gè)實(shí)體的一條鄰居關(guān)系為首都時(shí),其很可能擁有另外一個(gè)鄰居關(guān)系市長.因?yàn)轱@然只有城市才可能是“首都”,并且其往往擁有“市長”這一上下文信息.本文認(rèn)為這種關(guān)系間的聯(lián)系可用于對上下文信息的置信度進(jìn)行估算.因此,本文提出以下規(guī)則:對于實(shí)體

當(dāng)其某條上下文信息中包含有關(guān)系

并且

中同時(shí)存在關(guān)系r2,r1≠r2.此時(shí),對于知識圖譜中任意實(shí)體

出現(xiàn)

的概率越高,相對于e而言包含r1的上下文信息置信度越高.例如,當(dāng)某個(gè)實(shí)體擁有一條包含有關(guān)系市長的上下文信息時(shí),如果該實(shí)體同時(shí)擁有關(guān)系首都,那么包含有市長的上下文信息置信度較高,因?yàn)槭锥寂c市長通常同時(shí)出現(xiàn)在實(shí)體的上下文中.

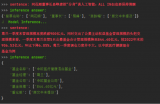

基于上述規(guī)則,本文在進(jìn)行圖卷積網(wǎng)絡(luò)的訓(xùn)練前首先計(jì)算置信度矩陣C∈

表示集合的大小.對于矩陣中的任意參數(shù)Ci,j,0≤i,j≤

其計(jì)算如下:

(1)

其中,分母表示知識圖譜中擁有鄰居關(guān)系ri的實(shí)體的個(gè)數(shù),分子表示同時(shí)擁有鄰居關(guān)系ri與rj的實(shí)體的個(gè)數(shù),i與j在此表示關(guān)系ri與rj在關(guān)系集合

中的索引.

對于圖2中實(shí)體eh,當(dāng)利用其鄰居三元組

通過圖卷積編碼其向量表示eh時(shí),模型會(huì)首先基于置信度矩陣C評價(jià)eh的各個(gè)鄰居三元組.例如,圖2中鄰居三元組(eh,ri,eti)的置信度可以通過式(2)來計(jì)算:

(2)

其中,

代表實(shí)體eti鄰居關(guān)系集合,id(·)表示關(guān)系在

中的索引.值得一提的是,在本文模型的實(shí)現(xiàn)中,置信度計(jì)算被整合到了關(guān)聯(lián)度計(jì)算中對其進(jìn)行詳細(xì)介紹.

基于文本信息的關(guān)聯(lián)度計(jì)算.考慮到知識圖譜中實(shí)體與其不同上下文信息之間關(guān)聯(lián)度的差異,在進(jìn)行實(shí)體嵌入表示的卷積編碼時(shí),關(guān)聯(lián)度高的上下文信息應(yīng)該獲得更多的關(guān)注.為此,本文借助實(shí)體和關(guān)系的文本描述作為輔助信息計(jì)算實(shí)體與其單條上下文信息之間的關(guān)聯(lián)度,用于后續(xù)圖卷積網(wǎng)絡(luò)中實(shí)體嵌入表示的更新.本文首先將知識圖譜中實(shí)體和關(guān)系的文本描述輸入到預(yù)訓(xùn)練的BERT[25]語言模型中,得到它們所對應(yīng)的初始文本表示,然后再分別利用實(shí)體文本轉(zhuǎn)換矩陣與關(guān)系文本轉(zhuǎn)換矩陣計(jì)算它們的最終文本表示.具體而言,對于任意實(shí)體

與關(guān)系

其對應(yīng)文本分別為le與lr,它們通過BERT得到的初始文本表示為

與

轉(zhuǎn)換后的最終文本表示為Le與Lr,其中

本文利用實(shí)體與關(guān)系的文本表示計(jì)算對于某一實(shí)體而言,其單條上下文信息的關(guān)聯(lián)度.如圖2所示,實(shí)體eh的一條鄰居三元組為(eh,ri,eti),本文計(jì)算參數(shù)βi與γi來度量該條鄰居三元組所表示的上下文信息與eh之間的關(guān)聯(lián)度,具體公式為:

(3)

其中,Lej與Leh分別為實(shí)體ej與eh的文本表示,

為實(shí)體eti的鄰居實(shí)體集合.

(4)

其中,Lrj與Lri分別為關(guān)系rj與ri的文本表示,

為實(shí)體eti的鄰居關(guān)系集合,Cid(ri),id(rj)如式(2)所定義.

基于圖卷積網(wǎng)絡(luò)的嵌入更新.本文采用Vashishth等人所提出的CompGCN[19]模型作為圖卷積網(wǎng)絡(luò)的架構(gòu),對知識圖譜上下文信息進(jìn)行編碼.

初始狀態(tài)下,對于任意實(shí)體

與關(guān)系

其嵌入表示為隨機(jī)向量e0與r0,且e0,r0∈

d.以圖2中的實(shí)體eh為例,其嵌入表示通過以下圖卷積過程進(jìn)行更新:

(5)

其中,

表示實(shí)體eh的鄰居三元組集合,

或

針對包含有鄰居關(guān)系ri與鄰居節(jié)點(diǎn)eti的一條上下文信息,αi基于置信度計(jì)算與關(guān)聯(lián)度計(jì)算度量該條上下文信息的重要程度,具體如下:

αi=λ1βi+λ2γi,

(6)

其中,βi由式(3)計(jì)算得到,γi則由式(4)計(jì)算得到;Wt(ri)為CompGCN[19]中定義的關(guān)系類別矩陣,由于知識圖譜中被加入了逆關(guān)系與自環(huán)關(guān)系,Wt(ri)∈

d′×d可能為3種不同的表示,具體為:

(7)

其中函數(shù)f(·)表示循環(huán)關(guān)聯(lián)操作(circular correla-tion)[26],可以將2個(gè)向量x,y∈

d進(jìn)行融合,得到x°y∈

d,每個(gè)維度的數(shù)值計(jì)算為

(8)

遵循CompGCN框架,在對實(shí)體進(jìn)行圖卷積編碼的同時(shí),本文通過轉(zhuǎn)換矩陣Wr∈

d′×d更新關(guān)系的嵌入表示:

(9)

最后,本文將任意實(shí)體

與關(guān)系

的文本表示加入到其嵌入表示中,具體為:

e=e+Le,

(10)

r=r+Lr.

(11)

2.4 解碼器

本文采用ConvE[24]模型作為解碼器,基于所學(xué)習(xí)到的嵌入表示進(jìn)行鏈接預(yù)測,通過提高鏈接預(yù)測的表現(xiàn)更新模型參數(shù).當(dāng)知識圖譜經(jīng)過編碼器編碼后,對于某個(gè)任意構(gòu)成的三元組(eh,r,et),可知其頭尾實(shí)體eh與et的嵌入表示為eh與et,關(guān)系r的嵌入表示為r.ConvE模型首先將eh與r轉(zhuǎn)換成二維形式,即

與

然后計(jì)算該三元組的分?jǐn)?shù)值:

sc(eh,r,et)=

?

(12)

其中,[·]表示相連接,ω表示卷積過濾器,vec(·)為ConvE所定義的維度變換,Wcov為參數(shù)矩陣,f′(·)為非線性函數(shù).當(dāng)式(12)計(jì)算得到的分?jǐn)?shù)值越高,(eh,r,et)越有可能是正確的三元組.

3 實(shí) 驗(yàn)

本節(jié)首先對實(shí)驗(yàn)所使用的數(shù)據(jù)集、對比模型和評價(jià)指標(biāo)等進(jìn)行說明,然后介紹本文所提模型的實(shí)驗(yàn)結(jié)果,并與其他基準(zhǔn)模型進(jìn)行比較與分析.

3.1 數(shù)據(jù)集及對比模型介紹

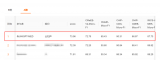

本文在2個(gè)廣泛使用的數(shù)據(jù)集上進(jìn)行試驗(yàn),分別是FB15K-237[27]和WN18[12],其統(tǒng)計(jì)數(shù)據(jù)如表1所示:

Table 1 Summary Statistics of Knowledge Graphs

表1 數(shù)據(jù)集的統(tǒng)計(jì)信息

為驗(yàn)證所提模型的有效性,本文廣泛選取了當(dāng)前被應(yīng)用較多的知識圖譜嵌入學(xué)習(xí)模型作為對比方法,具體包括TransE[11],DistMult[28],ComplEx[22],R-GCN[20],KBGAN[29],ConvE[24],ConvKB[30],SACN[21],HypER[31],RotatE[32],ConvR[33],VR-GCN[34],CompGCN[19].其中,TransE[11]為基于翻譯機(jī)制的嵌入學(xué)習(xí)模型,上文已對其進(jìn)行了詳細(xì)介紹.DistMult[28]將實(shí)體表示為通過神經(jīng)網(wǎng)絡(luò)學(xué)習(xí)到的低維向量,將關(guān)系表示為雙線性或線性映射函數(shù).ComplEx[22]與RESCAL[23]模型類似,屬于基于矩陣/張量分解進(jìn)行鏈接預(yù)測的模型.R-GCN[20],VR-GCN[34]與CompGCN[19]屬于基于圖卷積網(wǎng)絡(luò)的嵌入表示模型,以R-GCN[20]為例,其將知識圖譜中的關(guān)系編碼為矩陣,通過關(guān)系矩陣傳遞相鄰實(shí)體的嵌入信息,并采用了多層圖卷積網(wǎng)絡(luò).KBGAN則應(yīng)用了對抗生成網(wǎng)絡(luò)(generative adversarial network, GAN),在訓(xùn)練過程中生成更具迷惑性的負(fù)例來提高嵌入表示的訓(xùn)練效果.本文應(yīng)用了ConvE[24]模型作為解碼器,在第2節(jié)中對其進(jìn)行了詳細(xì)介紹.ConvKB[30],ConvR[33],SACN[21]與HypER[31]均是基于卷積神經(jīng)網(wǎng)絡(luò)的方法.以HypER[31]為例,其可以生成簡化的與關(guān)系相關(guān)的卷積過濾器,且可被構(gòu)造為張量分解.RotatE[32]與TransE[11]等基于翻譯機(jī)制的模型類似,其將實(shí)體之間的關(guān)系表示為向量空間中從頭實(shí)體到尾實(shí)體的旋轉(zhuǎn).

3.2 評價(jià)方法說明

本文通過鏈接預(yù)測任務(wù)來對模型的有效性進(jìn)行評價(jià).在實(shí)驗(yàn)中,針對被事先去掉頭實(shí)體或尾實(shí)體的測試三元組,本文基于學(xué)習(xí)到的嵌入表示推測其被去掉的頭實(shí)體或尾實(shí)體.具體對于每個(gè)測試三元組,本文選取知識圖譜中的任意實(shí)體作為可能的預(yù)測結(jié)果,并計(jì)算利用該實(shí)體補(bǔ)全測試三元組后的分?jǐn)?shù)值,如式(12)所示,最后對分?jǐn)?shù)值進(jìn)行排序.在此以缺失頭實(shí)體的預(yù)測為例,對于測試集中每個(gè)三元組(eh,r,et),事先刪除其頭實(shí)體eh,然后試圖使用G中的任意實(shí)體

補(bǔ)齊該測試三元組,從而產(chǎn)生候選三元組集合

最后,基于所學(xué)習(xí)到的嵌入表示計(jì)算候選三元組的分?jǐn)?shù)值并進(jìn)行排序,分?jǐn)?shù)值越高表明學(xué)習(xí)到的模型,即嵌入表示,認(rèn)為該結(jié)果更可靠,通過與真實(shí)結(jié)果進(jìn)行比較從而判段所學(xué)習(xí)嵌入表示的優(yōu)劣.

最后采用MR(mean rank),MRR(mean reciprocal rank)和Hit@k作為評價(jià)指標(biāo)[12].其中,MR與MRR均為預(yù)測結(jié)果平均排名的指標(biāo),Hit@k則指預(yù)測結(jié)果排在前k名中的比例,本文具體采用Hit@10,Hit@3和Hit@1.總之,越好的預(yù)測結(jié)果,其MR值越低、MRR值越高、Hit@k也越高.

3.3 實(shí)驗(yàn)設(shè)置

本文實(shí)驗(yàn)代碼使用Python實(shí)現(xiàn),在配置Ubuntu 16.04.6 LTS操作系統(tǒng)的服務(wù)器上完成,其CPU配置為16核Intel Core i7-6900K 3.20 GHz, 內(nèi)存128 GB,GPU配置為4張GeForce GTX 1080 GPU卡.

對于實(shí)體和關(guān)系文本表示向量的編碼,本文借助pretrained-bert-base-uncased預(yù)訓(xùn)練模型(1)https://github.com/google-research/bert,文本向量初始維度為768,轉(zhuǎn)換后的維度為200.在圖卷積網(wǎng)絡(luò)中,實(shí)體和關(guān)系的初始化向量維度為100,即d=100,GCN的維度為200,即d′=200.解碼器中維度轉(zhuǎn)換的高度和寬度分別為10和20,卷積過濾器的大小為7×7,數(shù)量為200.利用Adam優(yōu)化器對整體模型進(jìn)行訓(xùn)練,批大小(batch size)為256,學(xué)習(xí)率(learning rate)為0.001.

本文對TransE模型進(jìn)行了復(fù)現(xiàn),其余模型則引用對比模型論文中所報(bào)告的結(jié)果.

3.4 實(shí)驗(yàn)結(jié)果分析

表2報(bào)告了本文模型與對比模型在鏈接預(yù)測任務(wù)中的實(shí)驗(yàn)結(jié)果.

通過表2可觀察到如下結(jié)果:

1) 本文模型在各個(gè)評價(jià)指標(biāo)上顯著優(yōu)于TransE,DistMult和ComplEx等基準(zhǔn)模型,與SACN,HypER和CompGCN等最新提出的模型十分接近,由此可證明本文模型的有效性.對于FB15K-237數(shù)據(jù)集,本文在Hit@10指標(biāo)上排名第一.

2) 在Hit@1和Hit@3指標(biāo)上也與CompGCN,ConvR,SACN相差極小.具體在Hit@1指標(biāo)上僅比最高的CompGCN低1.51%,在MRR指標(biāo)上與CompGCN相比僅低0.8%.而對于WN18數(shù)據(jù)集,本文模型在MR指標(biāo)上排名第一,在Hit@10和Hit@3指標(biāo)上也與第一名差距微小.具體在Hit@10指標(biāo)上比RotatE低0.2%,在Hit@3指標(biāo)上比ConvR和HypER僅低0.9%.

3) 基于圖神經(jīng)網(wǎng)絡(luò)的嵌入學(xué)習(xí)方法的表現(xiàn)普遍優(yōu)于TransE等僅關(guān)注結(jié)構(gòu)化信息的模型.就本文模型而言,由于其基于圖卷積網(wǎng)絡(luò)對知識圖譜的上下文信息與文本信息進(jìn)行了聯(lián)合嵌入表示,顯著提高了在鏈接預(yù)測任務(wù)中的表現(xiàn).

Table 2 Link Prediction Results on FB15K-237 and WN18

表2 鏈接預(yù)測在FB15K-237和WN18上的結(jié)果

Note: The best performance is in bold.

?

4 總 結(jié)

現(xiàn)有多數(shù)知識圖譜嵌入學(xué)習(xí)方法僅考慮由三元組表示的知識圖譜結(jié)構(gòu)信息,而忽視了知識圖譜中豐富的上下文信息與文本信息,限制了嵌入表示在鏈接預(yù)測等任務(wù)中的表現(xiàn).針對現(xiàn)有方法的這一局限性,本文提出一種利用圖卷積神經(jīng)網(wǎng)絡(luò),結(jié)合知識圖譜的上下文信息與文本信息學(xué)習(xí)嵌入表示的方法.為了對上下文信息的重要程度進(jìn)行細(xì)粒度分析,本文提出一條簡單有效的規(guī)則來計(jì)算上下文信息的置信度,并基于文本信息的向量表示提出計(jì)算上下文信息關(guān)聯(lián)度的方法,加強(qiáng)了對上下文信息的約束和引導(dǎo).最后,通過在2個(gè)廣泛使用的基準(zhǔn)數(shù)據(jù)集上進(jìn)行對比實(shí)驗(yàn),驗(yàn)證了本文模型的有效性.

關(guān)注微信公眾號:人工智能技術(shù)與咨詢。了解更多咨詢!

審核編輯:符乾江

電子發(fā)燒友App

電子發(fā)燒友App

評論