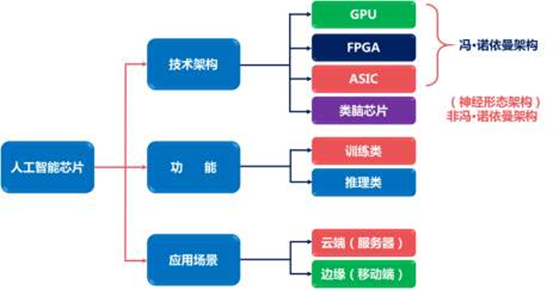

? GPU的并行算力能力很強,但是它也有缺點,就是功耗高,體積大,價格貴。 ? 進入21世紀后,算力需求呈現兩個顯著趨勢:一,算力的使用場景,開始細分;二,用戶對算力性能的要求,越來越高。通用的算力芯片,已經無法滿足用戶的需求。 ? 于是,越來越多的企業,開始加強對專用計算芯片的研究和投資力度。而ASIC(Application Specific Integrated Circuit,專用集成電路),就是一種專用于特定任務的芯片。 ? ? ?

? ASIC的官方定義,是指:應特定用戶的要求,或特定電子系統的需要,專門設計、制造的集成電路。 ? ASIC起步于上世紀70-80年代。早期的時候,曾用于計算機。后來,主要用于嵌入式控制。這幾年,如前面所說,開始崛起,用于AI推理、高速搜索以及視覺和圖像處理等。 ? ? 說到ASIC,我們就不得不提到Google公司大名鼎鼎的TPU。 ? ?

? TPU,全稱Tensor Processing Unit,張量處理單元。所謂“張量(tensor)”,是一個包含多個數字(多維數組)的數學實體。

? 目前,幾乎所有的機器學習系統,都使用張量作為基本數據結構。所以,張量處理單元,我們可以簡單理解為“AI處理單元”。 ? 2015年,為了更好地完成自己的深度學習任務,提升AI算力,Google推出了一款專門用于神經網絡訓練的芯片,也就是TPU v1。

相比傳統的CPU和GPU,在神經網絡計算方面,TPU v1可以獲得15~30倍的性能提升,能效提升更是達到30~80倍,給行業帶來了很大震動。

2017年和2018年,Google又再接再厲,推出了能力更強的TPU v2和TPU v3,用于AI訓練和推理。2021年,他們推出了TPU v4,采用7nm工藝,晶體管數達到220億,性能相較上代提升了10倍,比英偉達的A100還強1.7倍。

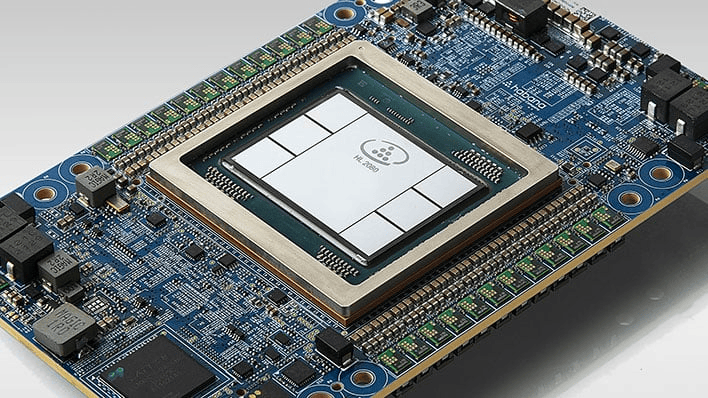

除了Google之外,還有很多大廠這幾年也在搗鼓ASIC。 ? 英特爾公司在2019年底收購了以色列AI芯片公司Habana Labs,2022年,發布了Gaudi 2 ASIC芯片。IBM研究院,則于2022年底,發布了AI ASIC芯片AIU。 ? ?

三星早幾年也搞過ASIC,當時做的是礦機專用芯片。沒錯,很多人認識ASIC,就是從比特幣挖礦開始的。相比GPU和CPU挖礦,ASIC礦機的效率更高,能耗更低。 ? ?

ASIC礦機 ? 除了TPU和礦機之外,另外兩類很有名的ASIC芯片,是DPU和NPU。 ? DPU是數據處理單元(Data Processing Unit),主要用于數據中心。 ? NPU的話,叫做神經網絡處理單元(Neural Processing Unit),在電路層模擬人類神經元和突觸,并用深度學習指令集處理數據。 ? NPU專門用于神經網絡推理,能夠實現高效的卷積、池化等操作。一些手機芯片里,經常集成這玩意。 ? 說到手機芯片,值得一提的是,我們手機現在的主芯片,也就是常說的SoC芯片,其實也是一種ASIC芯片。 ? ?

? ASIC作為專門的定制芯片,優點體現在哪里?只是企業獨享,專用logo和命名? ? 不是的。 ? 定制就是量體裁衣。基于芯片所面向的專項任務,芯片的計算能力和計算效率都是嚴格匹配于任務算法的。芯片的核心數量,邏輯計算單元和控制單元比例,以及緩存等,整個芯片架構,也是精確定制的。 ? 所以,定制專用芯片,可以實現極致的體積、功耗。這類芯片的可靠性、保密性、算力、能效,都會比通用芯片(CPU、GPU)更強。 ? 大家會發現,前面我們提到的幾家ASIC公司,都是谷歌、英特爾、IBM、三星這樣的大廠。

這是因為,對芯片進行定制設計,對一家企業的研發技術水平要求極高,且耗資極為巨大。

做一款ASIC芯片,首先要經過代碼設計、綜合、后端等復雜的設計流程,再經過幾個月的生產加工以及封裝測試,才能拿到芯片來搭建系統。 ? 大家都聽說過“流片(Tape-out)”。像流水線一樣,通過一系列工藝步驟制造芯片,就是流片。簡單來說,就是試生產。 ? ? ? ? ASIC的研發過程是需要流片的。14nm工藝,流片一次需要300萬美元左右。5nm工藝,更是高達4725萬美元。 ? 流片一旦失敗,錢全部打水漂,還耽誤了大量的時間和精力。一般的小公司,根本玩不起。 ? 那么,是不是小公司就無法進行芯片定制了呢? ? 當然不是。接下來,就輪到另一個神器出場了,那就是——FPGA。 ?

? █?FPGA(現場可編程門陣列)

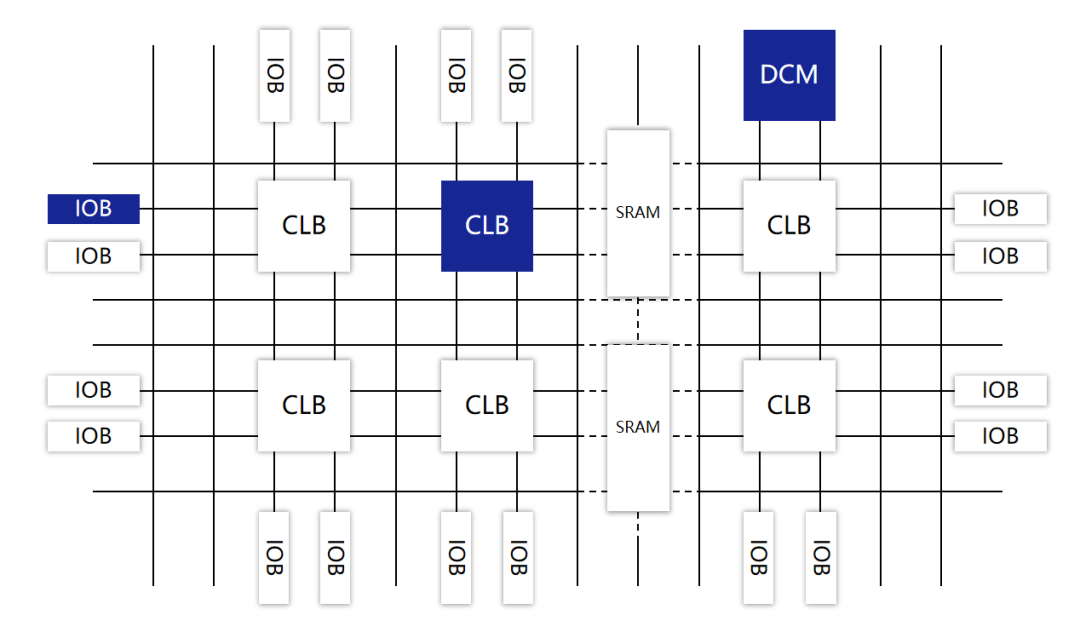

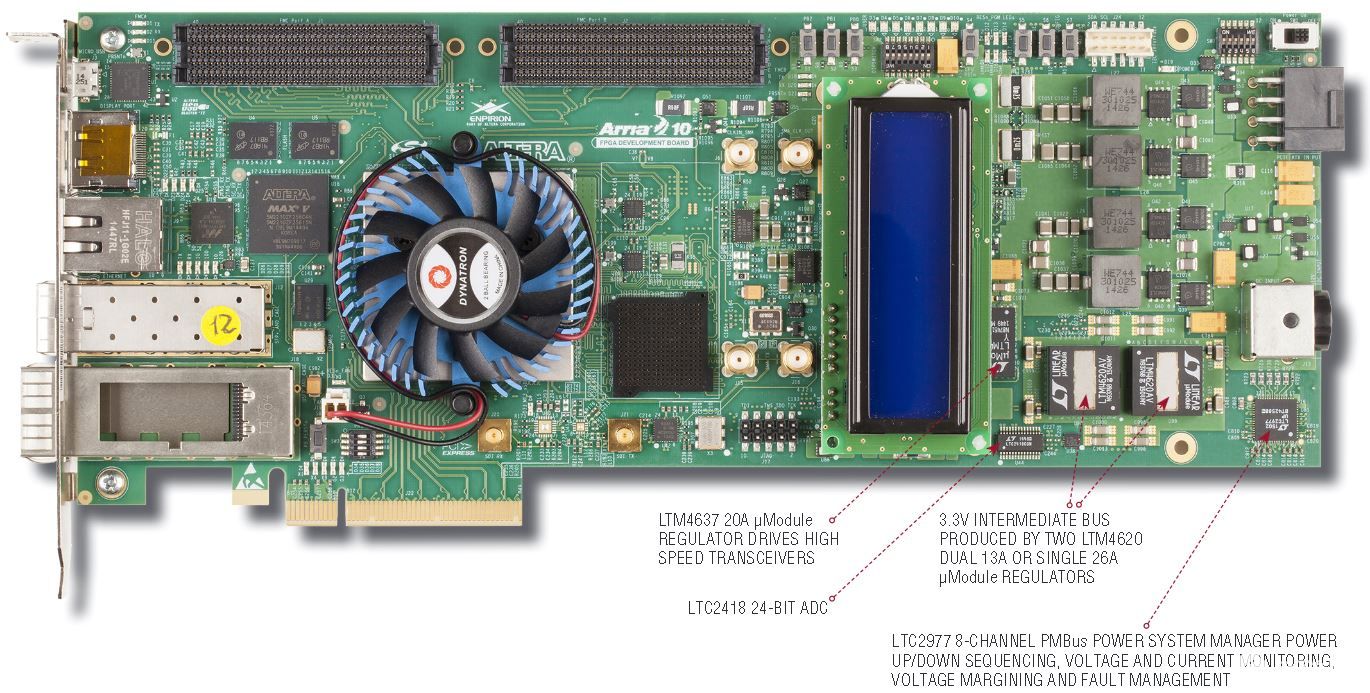

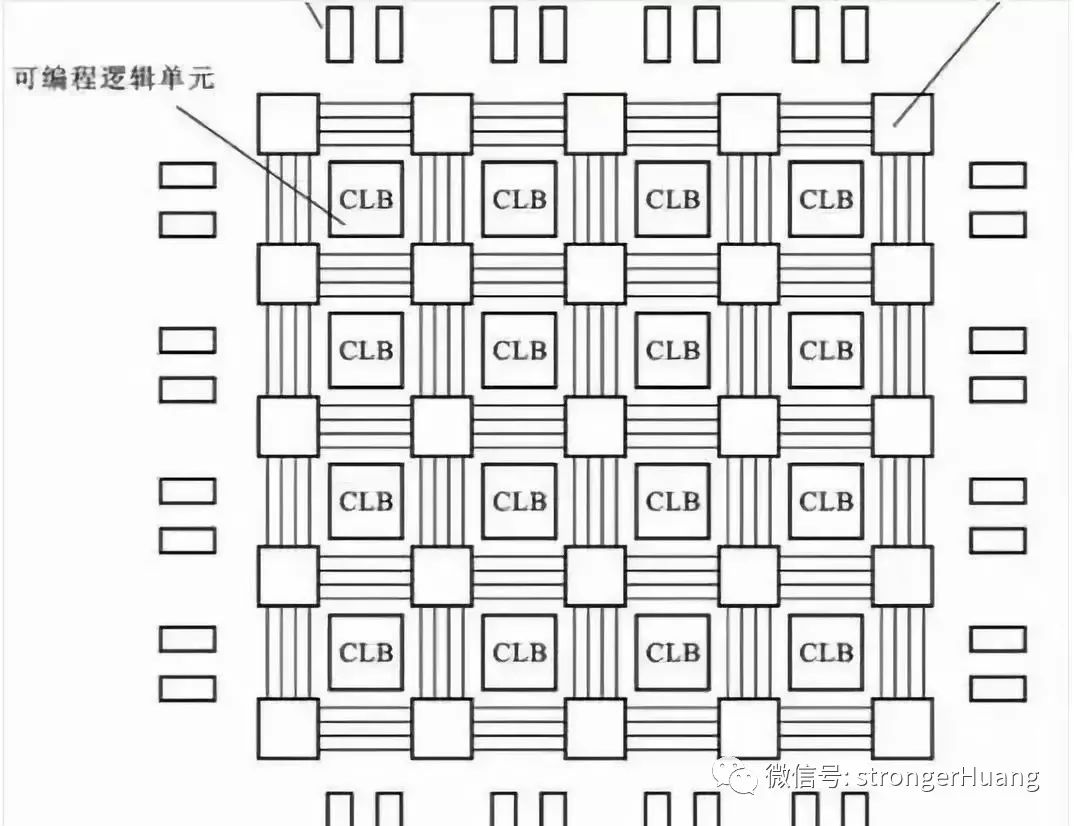

? FPGA,英文全稱Field Programmable Gate Array,現場可編程門陣列。 ? FPGA這些年在行業里很火,勢頭比ASIC還猛,甚至被人稱為“萬能芯片”。 ? 其實,簡單來說,FPGA就是可以重構的芯片。它可以根據用戶的需要,在制造后,進行無限次數的重復編程,以實現想要的數字邏輯功能。 ? 之所以FPGA可以實現DIY,是因為其獨特的架構。 ? FPGA由可編程邏輯塊(Configurable Logic Blocks,CLB)、輸入/輸出模塊(I/O Blocks,IOB)、可編程互連資源(Programmable Interconnect Resources,PIR)等三種可編程電路,以及靜態存儲器SRAM共同組成。 ?

?

CLB是FPGA中最重要的部分,是實現邏輯功能的基本單元,承載主要的電路功能。 ? 它們通常規則排列成一個陣列(邏輯單元陣列,LCA,Logic Cell Array),散布于整個芯片中。 ? IOB主要完成芯片上的邏輯與外部引腳的接口,通常排列在芯片的四周。 ? PIR提供了豐富的連線資源,包括縱橫網狀連線、可編程開關矩陣和可編程連接點等。它們實現連接的作用,構成特定功能的電路。 ? 靜態存儲器SRAM,用于存放內部IOB、CLB和PIR的編程數據,并形成對它們的控制,從而完成系統邏輯功能。 ? CLB本身,又主要由查找表(Look-Up Table,LUT)、多路復用器(Multiplexer)和觸發器(Flip-Flop)構成。它們用于承載電路中的一個個邏輯“門”,可以用來實現復雜的邏輯功能。 ? 簡單來說,我們可以把LUT理解為存儲了計算結果的RAM。當用戶描述了一個邏輯電路后,軟件會計算所有可能的結果,并寫入這個RAM。每一個信號進行邏輯運算,就等于輸入一個地址,進行查表。LUT會找出地址對應的內容,返回結果。

這種“硬件化”的運算方式,顯然具有更快的運算速度。 ? 用戶使用FPGA時,可以通過硬件描述語言(Verilog或VHDL),完成的電路設計,然后對FPGA進行“編程”(燒寫),將設計加載到FPGA上,實現對應的功能。 ? 加電時,FPGA將EPROM(可擦編程只讀存儲器)中的數據讀入SRAM中,配置完成后,FPGA進入工作狀態。掉電后,FPGA恢復成白片,內部邏輯關系消失。如此反復,就實現了“現場”定制。 ? FPGA的功能非常強大。理論上,如果FPGA提供的門電路規模足夠大,通過編程,就能夠實現任意ASIC的邏輯功能。 ? ?

? ? ? 我們再看看FPGA的發展歷程。 ? FPGA是在PAL(可編程陣列邏輯)、GAL(通用陣列邏輯)等可編程器件的基礎上發展起來的產物,屬于一種半定制電路。 ? 它誕生于1985年,發明者是Xilinx公司(賽靈思)。后來,Altera(阿爾特拉)、Lattice(萊迪思)、Microsemi(美高森美)等公司也參與到FPGA這個領域,并最終形成了四巨頭的格局。 ? 2015年5月,Intel(英特爾)以167億美元的天價收購了Altera,后來收編為PSG(可編程解決方案事業部)部門。 ? 2020年,Intel的競爭對手AMD也不甘示弱,以350億美元收購了Xilinx。

于是,就變成了Xilinx(AMD旗下)、Intel、Lattice和Microsemi四巨頭(換湯不換藥)。 ? 2021年,這四家公司的市占率分別為51%、29%、7%和6%,加起來是全球總份額的93%。 ? 不久前,2023年10月,Intel宣布計劃拆分PSG部門,獨立業務運營。 ? 國內FPGA廠商的話,包括復旦微電、紫光國微、安路科技、東土科技、高云半導體、京微齊力、京微雅格、智多晶、遨格芯等。看上去數量不少,但實際上技術差距很大。

? █?ASIC和FPGA的區別

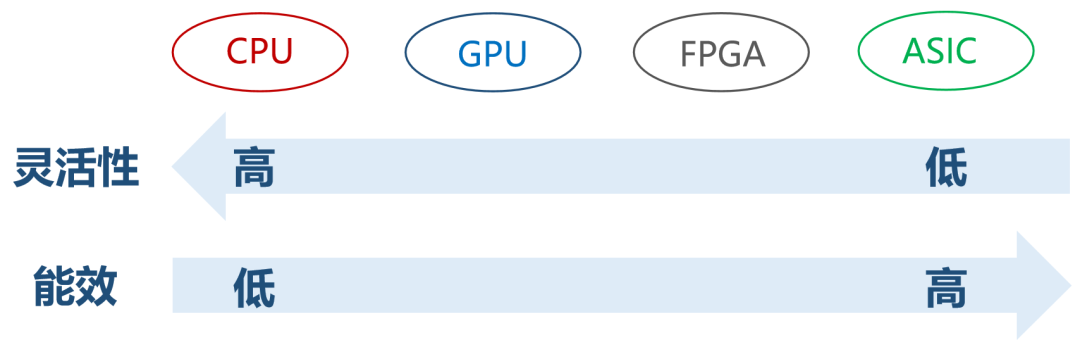

接下來,我們重點說說ASIC和FPGA的區別,還有它們和CPU、GPU之間的區別。 ? ASIC和FPGA,本質上都是芯片。AISC是全定制芯片,功能寫死,沒辦法改。而FPGA是半定制芯片,功能靈活,可玩性強。 ? 我們還是可以通過一個例子,來說明兩者之間的區別。 ? ASIC就是用模具來做玩具。事先要進行開模,比較費事。而且,一旦開模之后,就沒辦法修改了。如果要做新玩具,就必須重新開模。 ? 而FPGA呢,就像用樂高積木來搭玩具。上手就能搭,花一點時間,就可以搭好。如果不滿意,或者想搭新玩具,可以拆開,重新搭。 ? ?

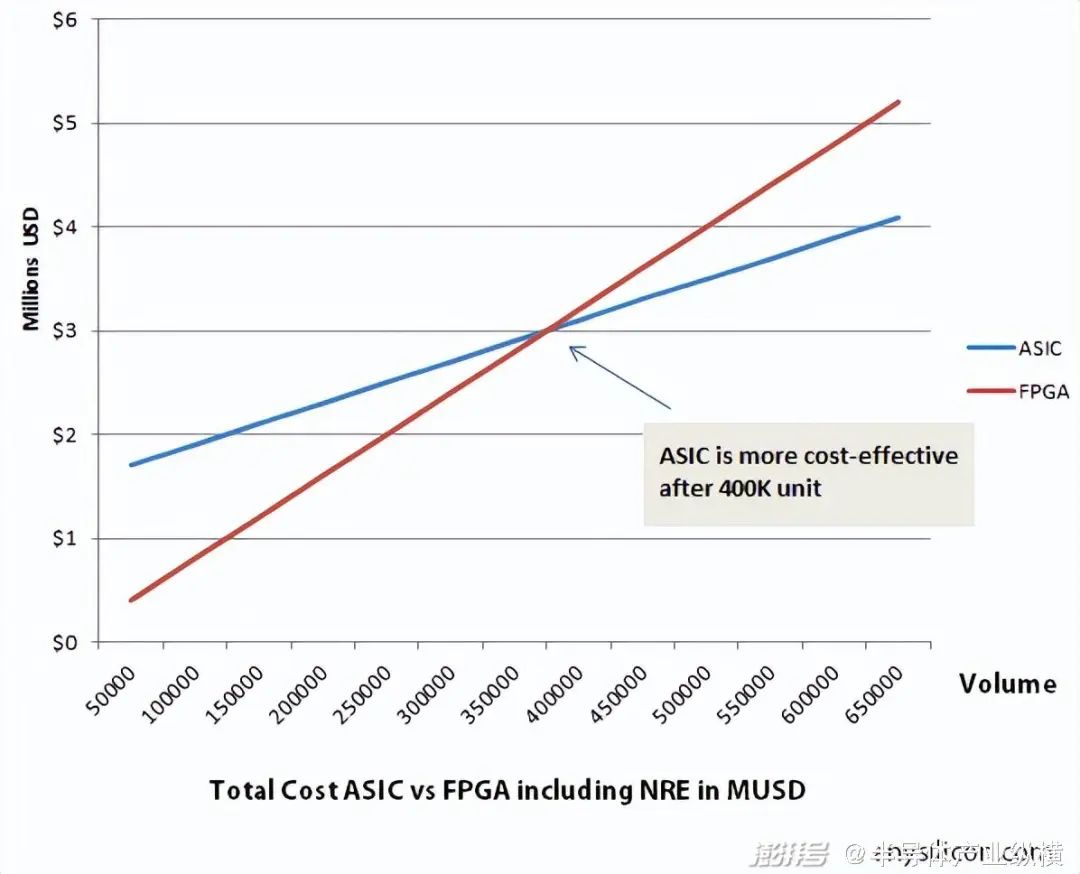

? ? ASIC與FPGA的很多設計工具是相同的。在設計流程上,FPGA沒有ASIC那么復雜,去掉了一些制造過程和額外的設計驗證步驟,大概只有ASIC流程的50%-70%。最頭大的流片過程,FPGA是不需要的。 ? 這就意味著,開發ASIC,可能需要幾個月甚至一年以上的時間。而FPGA,只需要幾周或幾個月的時間。 ? 剛才說到FPGA不需要流片,那么,是不是意味著FPGA的成本就一定比ASIC低呢? ? 不一定。 ? FPGA可以在實驗室或現場進行預制和編程,不需要一次性工程費用 (NRE)。但是,作為“通用玩具”,它的成本是ASIC(壓模玩具)的10倍。 ? 如果生產量比較低,那么,FPGA會更便宜。如果生產量高,ASIC的一次性工程費用被平攤,那么,ASIC反而便宜。 ? 這就像開模費用。開模很貴,但是,如果銷量大,開模就劃算了。 ? 如下圖所示,40W片,是ASIC和FPGA成本高低的一個分界線。產量少于40W,FPGA便宜。多于40W,ASIC便宜。 ?

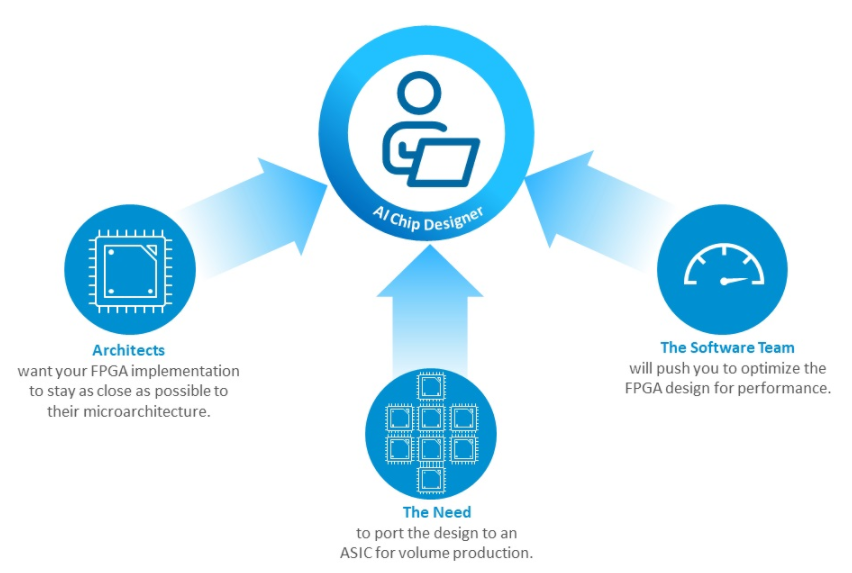

? 從性能和功耗的角度來看,作為專用定制芯片,ASIC是比FPGA強的。 ? FPGA是通用可編輯的芯片,冗余功能比較多。不管你怎么設計,都會多出來一些部件。 ? 前面小棗君也說了,ASIC是貼身定制,沒什么浪費,且采用硬連線。所以,性能更強,功耗更低。 ? FPGA和ASIC,不是簡單的競爭和替代關系,而是各自的定位不同。 ? FPGA現在多用于產品原型的開發、設計迭代,以及一些低產量的特定應用。它適合那些開發周期必須短的產品。FPGA還經常用于ASIC的驗證。 ?

ASIC用于設計規模大、復雜度高的芯片,或者是成熟度高、產量比較大的產品。 ? ? FPGA還特別適合初學者學習和參加比賽。現在很多大學的電子類專業,都在使用FPGA進行教學。

? 從商業化的角度來看,FPGA的主要應用領域是通信、國防、航空、數據中心、醫療、汽車及消費電子。 ? FPGA在通信領域用得很早。很多基站的處理芯片(基帶處理、波束賦形、天線收發器等),都是用的FPGA。核心網的編碼和協議加速等,也用到它。數據中心之前在DPU等部件上,也用。

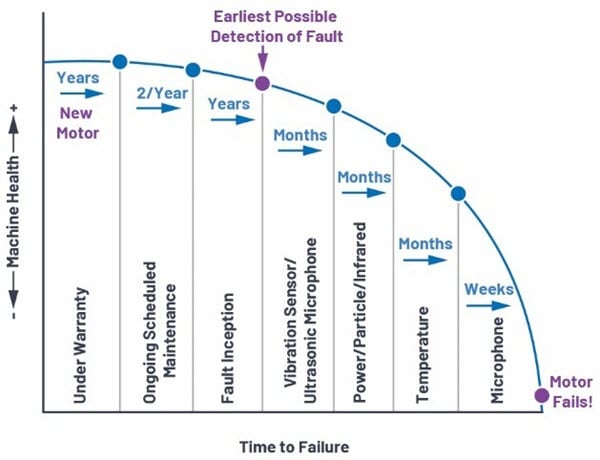

? 后來,很多技術成熟了、定型了,通信設備商們就開始用ASIC替代,以此減少成本。 ? 值得一提的是,最近這些年很熱門的Open RAN,其實很多都是采用通用處理器(Intel CPU)進行計算。這種方案的能耗遠遠不如FPGA和ASIC。這也是包括華為等設備商不愿意跟進Open RAN的主要原因之一。 ? 汽車和工業領域,主要是看中了FPGA的時延優勢,所以會用在ADAS(高級駕駛輔助系統)和伺服電機驅動上。 ? 消費電子用FPGA,是因為產品迭代太快。ASIC的開發周期太長了,等做出東西來,黃花菜都涼了。 ?

? █ FPGA、ASIC、GPU,誰是最合適的AI芯片?

首先,單純從理論和架構的角度,ASIC和FPGA的性能和成本,肯定是優于CPU和GPU的。 ?

? CPU、GPU遵循的是馮·諾依曼體系結構,指令要經過存儲、譯碼、執行等步驟,共享內存在使用時,要經歷仲裁和緩存。 ? 而FPGA和ASIC并不是馮·諾依曼架構(是哈佛架構)。以FPGA為例,它本質上是無指令、無需共享內存的體系結構。

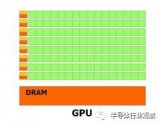

FPGA的邏輯單元功能在編程時已確定,屬于用硬件來實現軟件算法。對于保存狀態的需求,FPGA中的寄存器和片上內存(BRAM)屬于各自的控制邏輯,不需要仲裁和緩存。 ? 從ALU運算單元占比來看,GPU比CPU高,FPGA因為幾乎沒有控制模塊,所有模塊都是ALU運算單元,比GPU更高。 ? 所以,綜合各個角度,FPGA的運算速度會比GPU更快。 ? 再看看功耗方面。 ? GPU的功耗,是出了名的高,單片可以達到250W,甚至450W(RTX4090)。而FPGA呢,一般只有30~50W。

? 這主要是因為內存讀取。GPU的內存接口(GDDR5、HBM、HBM2)帶寬極高,大約是FPGA傳統DDR接口的4-5倍。但就芯片本身來說,讀取DRAM所消耗的能量,是SRAM的100倍以上。GPU頻繁讀取DRAM的處理,產生了極高的功耗。 ? 另外,FPGA的工作主頻(500MHz以下)比CPU、GPU(1~3GHz)低,也會使得自身功耗更低。FPGA的工作主頻低,主要是受布線資源的限制。有些線要繞遠,時鐘頻率高了,就來不及。 ? 最后看看時延。 ? GPU時延高于FPGA。 ? GPU通常需要將不同的訓練樣本,劃分成固定大小的“Batch(批次)”,為了最大化達到并行性,需要將數個Batch都集齊,再統一進行處理。 ? FPGA的架構,是無批次(Batch-less)的。每處理完成一個數據包,就能馬上輸出,時延更有優勢。 ? 那么,問題來了。GPU這里那里都不如FPGA和ASIC,為什么還會成為現在AI計算的大熱門呢?

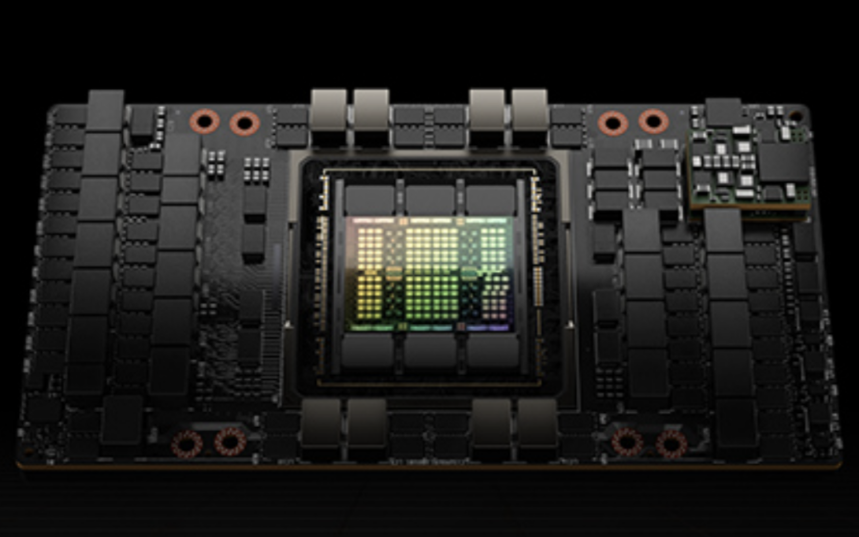

? 很簡單,在對算力性能和規模的極致追求下,現在整個行業根本不在乎什么成本和功耗。 ? 在英偉達的長期努力下,GPU的核心數和工作頻率一直在提升,芯片面積也越來越大,屬于硬剛算力。功耗靠工藝制程,靠水冷等被動散熱,反而不著火就行。

? 他們搗鼓出來的CUDA,是GPU的一個核心競爭力。基于CUDA,初學者都可以很快上手,進行GPU的開發。他們苦心經營多年,也形成了群眾基礎。 ? 相比之下,FPGA和ASIC的開發還是太過復雜,不適合普及。 ? 在接口方面,雖然GPU的接口比較單一(主要是PCIe),沒有FPGA靈活(FPGA的可編程性,使其能輕松對接任何的標準和非標準接口),但對于服務器來說,足夠了,插上就能用。 ? 除了FPGA之外,ASIC之所以在AI上干不過GPU,和它的高昂成本、超長開發周期、巨大開發風險有很大關系。現在AI算法變化很快,ASIC這種開發周期,很要命。

? 綜合上述原因,GPU才有了現在的大好局面。 ? 在AI訓練上,GPU的算力強勁,可以大幅提升效率。 ? 在AI推理上,輸入一般是單個對象(圖像),所以要求要低一點,也不需要什么并行,所以GPU的算力優勢沒那么明顯。很多企業,就會開始采用更便宜、更省電的FPGA或ASIC,進行計算。 ? 其它一些算力場景,也是如此。看重算力絕對性能的,首選GPU。算力性能要求不那么高的,可以考慮FPGA或ASIC,能省則省。 ?

? █ 最后的話

關于CPU、GPU、FPGA、ASIC的知識,就介紹到這里了。 ? 它們是計算芯片的典型代表。人類目前所有的算力場景,基本上都是由它們在負責。 ? 隨著時代的發展,計算芯片也有了新的趨勢。例如,不同算力芯片進行混搭,互相利用優勢。我們管這種方式,叫做異構計算。 ? 另外,還有IBM帶頭搞的類腦芯片,類似于大腦的神經突觸,模擬人腦的處理過程,也獲得了突破,熱度攀升。以后有機會,我再和大家專門介紹。

審核編輯:黃飛

?

電子發燒友App

電子發燒友App

評論