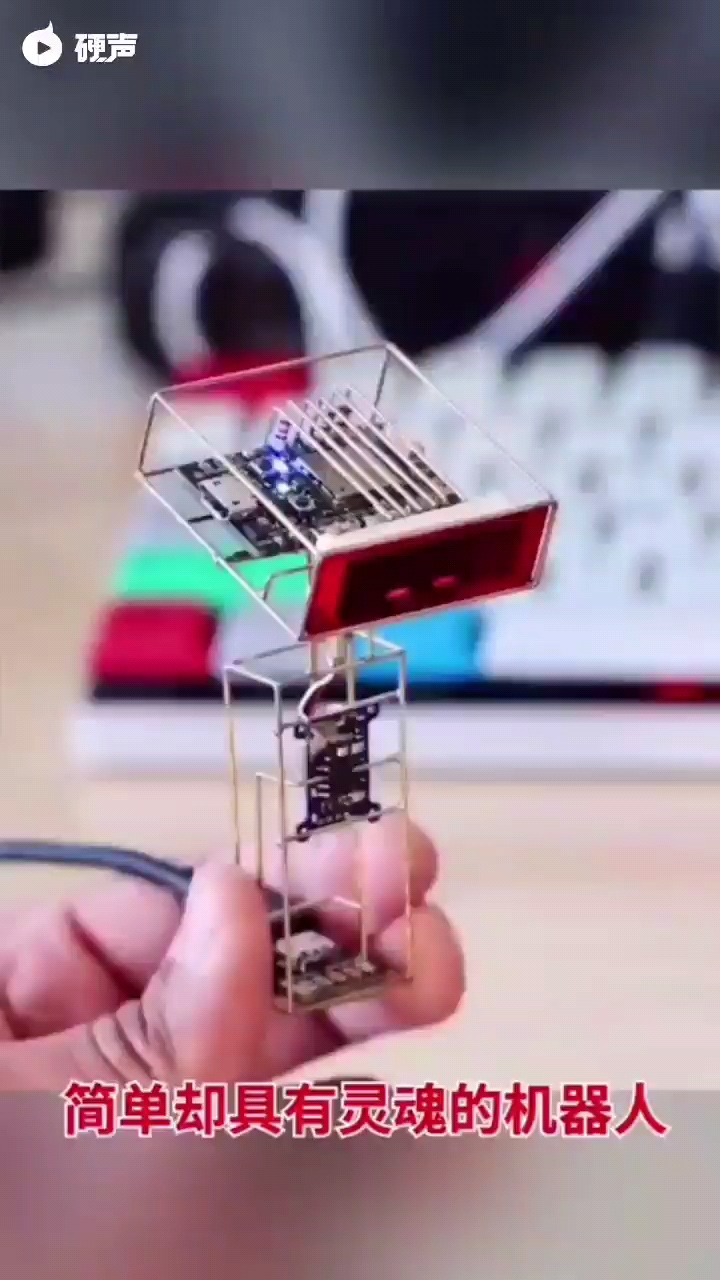

如果我們不能就這意味著什么達(dá)成一致,我們就無法用靈魂來編程一個(gè)有意識(shí)的機(jī)器人。

編寫終結(jié)者 是為了嚇唬我們; 編寫WALL-E是為了讓我們哭泣。機(jī)器人不能做我們在電影中看到的可怕或令人心碎的事情,但問題依然存在: 如果他們可以做什么?

當(dāng)然,我們今天擁有的技術(shù)并不是那么復(fù)雜到足以完成其中任何一項(xiàng)。但是人們一直在問。這些討論的核心是一個(gè)問題:機(jī)器能夠變得有意識(shí)嗎?他們甚至可以發(fā)展 - 或者被編程包含 - 一個(gè)靈魂?至少,算法是否包含類似 靈魂的東西 ?

這些問題的答案完全取決于您如何定義這些問題。到目前為止,自人工智能首次成為學(xué)術(shù)追求以來,我們在70年代尚未找到令人滿意的定義。

以最近在BBC上發(fā)表的一篇文章為例,該文章試圖用靈魂來解決人工智能的問題。作者定義了如何讓一個(gè)不朽的靈魂以一種幾乎立即遠(yuǎn)離神學(xué)領(lǐng)域的方式引導(dǎo)對(duì)話的意義。當(dāng)然,這很好,因?yàn)樘炜罩幸晃淮┲L袍的老人似乎不太可能向Cortana呼吸生命。但它沒有回答核心問題 - 人工智能不僅僅是一種無意識(shí)的工具嗎?

這BBC文章列出的條款 - 即人工智能系統(tǒng),它的作用就好像它有靈魂將被旁觀者來決定。對(duì)于我們中間的宗教和精神,一個(gè)足夠先進(jìn)的算法似乎可以呈現(xiàn)一個(gè)靈魂。那些人可能會(huì)這樣對(duì)待它,因?yàn)樗麄儠?huì)查看人工智能系統(tǒng)的智力,情感表達(dá),行為,甚至可能是對(duì)神的信仰,作為內(nèi)部某些可被定義為靈魂的東西的標(biāo)志。

因此,包含某種人工智能的機(jī)器可以同時(shí)被視為一個(gè)實(shí)體或研究工具,具體取決于您的要求。與許多事情一樣,關(guān)于什么會(huì)使機(jī)器意識(shí)到的爭論大部分歸結(jié)為我們自己投射到算法上的內(nèi)容。

“我對(duì)編程計(jì)算機(jī)的興趣不如培養(yǎng)小原子實(shí)體,” Brigham Young大學(xué)的計(jì)算機(jī)科學(xué)家Nancy Fulda對(duì)未來主義說。“這是模式的發(fā)現(xiàn),獨(dú)特行為的出現(xiàn),首先吸引我進(jìn)入計(jì)算機(jī)科學(xué)。這就是我還在這里的原因。“

富爾達(dá)已經(jīng)訓(xùn)練人工智能算法來理解語境語言,并且正在努力建立一種機(jī)器人心理理論,這是人類(和某些動(dòng)物)心理學(xué)中的一個(gè)原則,它讓我們用自己的想法和意圖認(rèn)識(shí)他人。但是,你知道,對(duì)于機(jī)器人。

“至于計(jì)算機(jī)是否能擁有神圣創(chuàng)造的靈魂:我不敢推測,”富爾達(dá)補(bǔ)充道。

有兩個(gè)主要問題需要解決。第一個(gè)是語義之一:很難定義它有意識(shí)或有意識(shí)的真正意義,或者具有靈魂或靈魂功能的意義,正如BBC的文章所描述的那樣。

第二個(gè)問題是技術(shù)進(jìn)步。與創(chuàng)造人工感知所需的技術(shù)相比 - 無論它看起來像什么樣,或者我們可能選擇定義它 - 甚至我們最先進(jìn)的工程師仍然擠在洞穴中,將棍子揉在一起制造火并煮一些猛烈的猛犸象牛排。

在去年的一個(gè)小組討論中,生物學(xué)家和工程師Christof Koch與認(rèn)知科學(xué)家David Chalmers 就意識(shí)到的意義進(jìn)行了對(duì)比。談話在關(guān)于機(jī)器和僵尸的思辨性思想實(shí)驗(yàn)之間反彈(定義為那些與人無法區(qū)別但缺乏內(nèi)心思維的人)。它經(jīng)常偏離可以用科學(xué)證據(jù)確鑿證明的事物。查爾莫斯認(rèn)為,一臺(tái)比我們今天更先進(jìn)的機(jī)器可以變得有意識(shí),但科赫不同意,基于神經(jīng)科學(xué)和人工智能技術(shù)的現(xiàn)狀。

神經(jīng)科學(xué)文獻(xiàn)認(rèn)為意識(shí)是由我們的大腦構(gòu)建的敘事,它結(jié)合了我們的感官,我們?nèi)绾胃兄澜纾约拔覀兊男袨椤5词乖谶@個(gè)定義中,神經(jīng)科學(xué)家也很難確定我們?yōu)槭裁从幸庾R(shí)以及如何最好地根據(jù)神經(jīng)活動(dòng)來定義它。而對(duì)于宗教來說,這種意識(shí)是否與擁有靈魂所賦予的意識(shí)相同?這甚至都不涉及技術(shù)主題。

帕爾杜比采大學(xué)的哲學(xué)家和倫理學(xué)家翁德熱·貝蘭告訴未來主義說:“人們經(jīng)常將靈魂與思想混淆,或者更具體地說,是產(chǎn)生復(fù)雜行為模式的能力。”

“AI人經(jīng)常將靈魂與心靈混淆”

“靈魂的概念在我們的文化中扮演的角色與我們說某人的靈魂是高尚或墮落的背景交織在一起,”Beran補(bǔ)充道 - 也就是說,它帶來了價(jià)值判斷。“[我]我認(rèn)為所需要的不是人工智能科學(xué)或工程學(xué)的突破,而是一般的概念轉(zhuǎn)變。人們使用他們的語言相互聯(lián)系的敏感性和想象力的轉(zhuǎn)變。“

Beran舉了人工智能產(chǎn)生的藝術(shù)品的例子。通常,這些作品都是為了好玩而呈現(xiàn)的。但是,當(dāng)我們稱某種算法創(chuàng)造“藝術(shù)”的東西時(shí),我們常常不會(huì)考慮算法是僅僅生成了某種形式的圖像或旋律,還是創(chuàng)造了一些有意義的東西 - 不僅是對(duì)觀眾,而且對(duì)自己。當(dāng)然,人類創(chuàng)造的藝術(shù)也常常無法達(dá)到第二組。Beran補(bǔ)充說:“目前尚不清楚什么對(duì)人工智能具有重要意義。”

那么當(dāng)一臺(tái)機(jī)器能夠內(nèi)部思考而不是盲目地?cái)噭?dòng)輸入和輸出時(shí),機(jī)器能夠獲得感知嗎?或者在我們作為一個(gè)社會(huì)認(rèn)為機(jī)器是否有意識(shí)之前,它真的需要內(nèi)部的東西嗎?同樣,我們選擇接近問題的方式以及我們到達(dá)的具體定義使答案變得混亂。

“我相信靈魂不是一種物質(zhì),”捷克科學(xué)院的哲學(xué)家弗拉基米爾·哈夫里克(VladimirHavlík)試圖從進(jìn)化的角度來定義人工智能,他告訴未來主義。“我們可以說它就像一個(gè)連貫的身份,在時(shí)間的流逝和人的代表中永久地構(gòu)成,”他補(bǔ)充說。

哈維利克建議,不要擔(dān)心靈魂的神學(xué)方面,我們可以將靈魂定義為一種經(jīng)得起時(shí)間考驗(yàn)的內(nèi)在品格。從這個(gè)意義上說,他認(rèn)為沒有理由為什么機(jī)器或人工智能系統(tǒng)無法開發(fā)角色 - 它只取決于算法本身。在Havlík看來,角色來自意識(shí),因此開發(fā)這樣一個(gè)角色的AI系統(tǒng)需要基于足夠先進(jìn)的技術(shù),他們可以制作并以一種比較過去結(jié)果與未來預(yù)期的方式反映決策,就像人類如何了解世界。

但是,我們是否可以建立一個(gè)靈魂機(jī)器或有意識(shí)的機(jī)器的問題只對(duì)那些認(rèn)為這些區(qū)別很重要的人來說很重要。人工智能的核心是工具。甚至更復(fù)雜的算法可以繞過線并呈現(xiàn)為有意識(shí)的實(shí)體,是有意識(shí)的生物的再創(chuàng)造,而不是新的思維種類,自我意識(shí)的生物。

“我對(duì)人工智能的態(tài)度基本上是務(wù)實(shí)的,” 聯(lián)邦大學(xué)人工智能研究員Peter Vamplew告訴未來主義。“對(duì)我而言,人工智能系統(tǒng)是否具有真正的智能,或真實(shí)的情感和同理心并不重要。重要的是它的行為方式使其對(duì)人類社會(huì)有益。“

“對(duì)我而言,人工智能系統(tǒng)是否具有真正的智能并不重要。..。..重要的是它的行為方式使其對(duì)人類社會(huì)有益。”

對(duì)于Vamplew來說,機(jī)器是否有靈魂的問題只有在你將靈魂視為一個(gè)概念時(shí)才有意義。他沒有,所以事實(shí)并非如此。他覺得機(jī)器有一天可能會(huì)重新產(chǎn)生令人信服的情緒反應(yīng),并表現(xiàn)得好像是人類,但沒有理由將神學(xué)引入混合體。

并且他不是那種在機(jī)器中感覺真正意識(shí)不可能的人。“我是非常關(guān)鍵的人工意識(shí)的想法,” 貝爾納哥本哈根,哲學(xué)家和人工智能研究員對(duì)未來主義。“我認(rèn)為這是無稽之談。另一方面,人工智能是未來。“

卡斯特魯普最近為科學(xué)美國人撰寫了一篇文章,其中他闡述了他的觀點(diǎn),即意識(shí)是自然宇宙的一個(gè)基本方面,人們利用分離的意識(shí)碎片成為獨(dú)特的個(gè)體。他澄清說,他相信即使是一般的人工智能 - 我們在科幻小說中看到的那種包羅萬象的人工智能的名稱 - 可能有一天會(huì)出現(xiàn),但即使是這樣的人工智能系統(tǒng)也永遠(yuǎn)不會(huì)有私人的,有意識(shí)的內(nèi)心思想就像人類一樣。

“不幸的是,索菲亞充其量是荒謬的。而且,更重要的是,我們?nèi)匀慌c她有關(guān),“Beran說,他指的是Hanson Robotics的部分智能機(jī)器人。

更令人遺憾的是,人們越來越懷疑我們開發(fā)先進(jìn)人工智能的方法很快就會(huì)陷入困境。上周發(fā)表在“紐約時(shí)報(bào)”上的一篇文章引用了多位工程師,他們越來越懷疑我們的機(jī)器學(xué)習(xí),甚至深度學(xué)習(xí)技術(shù)將會(huì)像近年來一樣繼續(xù)增長。

我討厭成為泥巴中的一根棍子。我真的這樣做。但是,即使我們解決關(guān)于意識(shí),有意識(shí),有靈魂意味著什么的語義爭論,我們也可能永遠(yuǎn)缺乏將算法帶到這一點(diǎn)的技術(shù)。

但是,當(dāng)人工智能首次啟動(dòng)時(shí),沒有人能夠預(yù)測它今天可以做的事情。當(dāng)然,人們想象機(jī)器人幫助者是Jetsons或者Epcot的先進(jìn)交通工具,但是他們并不知道會(huì)讓我們到那里的切實(shí)步驟。而今天,我們不知道將我們帶到情感智能,敏感,深思熟慮和真實(shí)內(nèi)省的機(jī)器的切實(shí)步驟。

絕不這是否使不可能任務(wù)-我們只是不知道怎么去還。事實(shí)上,我們還沒有解決關(guān)于在哪里實(shí)際設(shè)置終點(diǎn)線的爭論,這使得它變得更加困難。

“我們還有很長的路要走,”富爾達(dá)說。她建議答案不是拼湊算法,因?yàn)槲覀兘?jīng)常用人工智能解決復(fù)雜問題。

“你無法一次解決一個(gè)人類問題,”富爾達(dá)說。“這是一種格式塔體驗(yàn)。”例如,她認(rèn)為,如果不理解感知和運(yùn)動(dòng),我們就無法理解認(rèn)知。如果不知道如何模仿移情和社會(huì)意識(shí),我們就無法準(zhǔn)確地模擬語音。富爾達(dá)說,試圖將這些碎片一次放在一臺(tái)機(jī)器中,就像通過將適量的油漆倒入罐中來重現(xiàn)蒙娜麗莎。

無論杰作是否在那里等待繪畫,還有待確定。但如果是這樣的話,像富爾達(dá)這樣的研究人員正在爭先恐后地試圖刷中風(fēng)。只要我們繼續(xù)尋求這些問題的答案,技術(shù)就會(huì)向前邁進(jìn)。但是,當(dāng)我們編寫新的代碼,使機(jī)器明天做我們無法想象的事情時(shí),我們?nèi)匀恍枰砬逦覀兿M械念I(lǐng)導(dǎo)地位。

我們是達(dá)芬奇嗎,畫一個(gè)自我陶醉的女人,幾個(gè)世紀(jì)以來會(huì)被欽佩,還是我們會(huì)成為天王星,創(chuàng)造出推翻我們的神?現(xiàn)在,人工智能將完全按照我們告訴AI做的,無論好壞。但是,如果我們轉(zhuǎn)向算法開始,至少,作為有感覺的,我們必須弄清楚這意味著什么。

電子發(fā)燒友App

電子發(fā)燒友App

評(píng)論