將在機(jī)械上超越人類的身體,在數(shù)字上超越人類的頭腦。如果

未來機(jī)器人真的具有(

或部分具有)超人類的能力,那接下來的問題當(dāng)然不是

機(jī)器人和人類誰統(tǒng)治誰那么簡(jiǎn)單的問題。在一個(gè)充斥著

機(jī)器人的世界里,我們?nèi)祟惖纳?/div>

2015-12-29 14:56:59

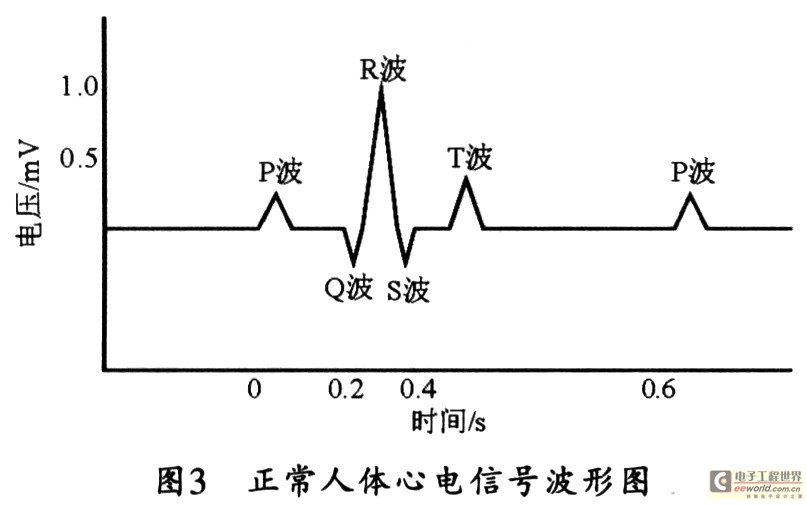

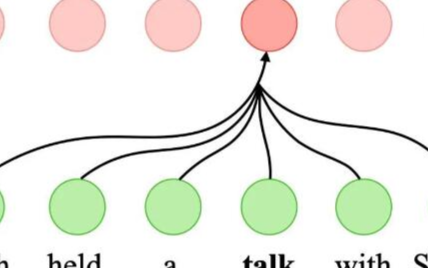

了額外的機(jī)制——注意力機(jī)制,來幫助我們進(jìn)行調(diào)序。下面我們用一張示意圖來看一下,基于RNN的神經(jīng)機(jī)器翻譯的流程:首先我們通過分詞得到輸入源語言詞序列,接下來每個(gè)詞都用一個(gè)詞向量進(jìn)行表示,得到相應(yīng)的詞向量序列

2018-07-06 10:46:12

深度殘差收縮網(wǎng)絡(luò)是深度殘差網(wǎng)絡(luò)的一種新的升級(jí)版本,其實(shí)是深度殘差網(wǎng)絡(luò)、注意力機(jī)制(參照Squeeze-and-Excitation Network,SENet)和軟閾值化的深度集成

2020-11-26 06:33:10

對(duì)于proteus這款軟件,怎樣自學(xué)能夠更好更快的入門,其核心要素在于什么?需要掌握的基本功又有哪些?

2012-06-09 20:58:10

項(xiàng)目計(jì)劃如下:利用帶電池的耳機(jī)式腦電檢測(cè)模塊讀出腦部注意力和放松度信號(hào),加以無線方式傳出(NRF,藍(lán)牙,紅外),利用安芯一號(hào)單片機(jī)做終端,以某種方式接受無線信號(hào),紅外或串口NRF等,將得到的腦部電壓

2013-10-17 15:46:36

畢設(shè)要求做一個(gè)注意力分配實(shí)驗(yàn)設(shè)計(jì)。有些結(jié)構(gòu)完全想不明白。具體如何實(shí)現(xiàn)如下。一個(gè)大概5*5的燈組合,要求隨機(jī)亮。兩個(gè)聲音大小不同的音頻,要求隨機(jī)響,有大、小兩個(gè)選項(xiàng)。以上兩種需要記錄并計(jì)算錯(cuò)誤率。體現(xiàn)在表格上。大家可不可以勞煩幫個(gè)忙,幫我構(gòu)思一下, 或者幫我做一下。拜托大家了。

2019-05-07 20:33:20

集成至未來的機(jī)器學(xué)習(xí)系統(tǒng)中:(1)特征學(xué)習(xí):從射頻信號(hào)數(shù)據(jù)集中,射頻機(jī)器學(xué)習(xí)系統(tǒng)需要學(xué)習(xí)用以在各種各樣民用和軍用信號(hào)中辨認(rèn)和描述信號(hào)的特征。 (2)注意力和特性:正如人可以快速將注意力鎖定至所需目標(biāo)一樣

2017-09-02 09:04:26

統(tǒng),后者是設(shè)備4.嵌入式系統(tǒng)的三個(gè)基本要素:嵌入型、專用性、計(jì)算機(jī)系統(tǒng)若干個(gè)嵌入式系統(tǒng)的例子:嵌入式產(chǎn)品三個(gè)核心要素:功能和性能;處理器芯片;操作系統(tǒng)或者監(jiān)控程序...

2021-12-22 06:48:46

的靈活性,主要由嵌入式硬件平臺(tái) 、 相關(guān)支撐硬件 、 嵌入式操作系統(tǒng) 、 支撐軟件以及應(yīng)用軟件組成。其中, “ 嵌入性 ”、“ 專用性 ” 與 “ 計(jì)算機(jī)系統(tǒng) ” 是嵌入式系統(tǒng)的三個(gè)基本的核心要素,具體來講:嵌入性:指計(jì)算機(jī)計(jì)算機(jī)嵌入到對(duì)象系統(tǒng)中,且滿足對(duì)象系統(tǒng)的環(huán)境要求,如物理環(huán)境(小型) 、 電氣 /

2021-12-22 07:52:11

硬件平臺(tái)、相關(guān)支撐硬件、嵌入式操作系統(tǒng)、支撐軟件以及應(yīng)用軟件組成。其中,“嵌入性”、“專用性”與“計(jì)算機(jī)系統(tǒng)”是嵌入式系統(tǒng)的三個(gè)基本的核心要素,具體來講:嵌入性:指計(jì)算機(jī)計(jì)算機(jī)嵌入到對(duì)象系統(tǒng)中,且滿足對(duì)象系統(tǒng)的環(huán)境要求,如物理環(huán)境(小型)、電氣/氣氛環(huán)境(可靠)、成本(價(jià)廉)等要求。專用性:...

2021-11-08 07:20:07

獨(dú)特的方法,讓總是早起的女兒心甘情愿的呆在床上,以保證她們擁有充足的睡眠。Dan所發(fā)明的是一個(gè)能夠吸引孩子們注意力的訓(xùn)練鬧鐘。這個(gè)鬧鐘以女孩兒們喜愛的卡通人物為模板,每當(dāng)?shù)搅怂X時(shí)間,這些卡通人物就會(huì)

2019-07-09 07:33:38

論文題目是:基于虛擬儀器技術(shù)的駕駛員注意力監(jiān)測(cè)控制系統(tǒng),做了很長時(shí)間了,實(shí)在沒思路,進(jìn)展不下去,跪求大神們指點(diǎn),能夠給我一個(gè)思路和方向。

2015-05-24 17:38:46

摘要:在駕車過程中調(diào)節(jié)空調(diào)溫度或切換電臺(tái)頻道是常有的事,然而有時(shí)卻因?yàn)樾枰獣r(shí)刻掌握方向盤而手忙腳亂,雖然我們中的很多人對(duì)這種情況都早已司空見慣,然而,駕駛員注意力不集中往往是導(dǎo)致交通事故的眾矢之的

2018-09-11 11:50:06

狀態(tài)機(jī)的要素是什么狀態(tài)遷移圖怎么畫?狀態(tài)機(jī)應(yīng)用的注意事項(xiàng)是什么

2021-04-27 06:10:52

和高性能,并具備多項(xiàng)新特性,包括支持兩個(gè)低成本高清圖像傳感器或一個(gè)4K分辨率圖像傳感器的雙攝像頭ISP,能夠處理人臉、物體對(duì)象和手勢(shì)識(shí)別等機(jī)器學(xué)習(xí)任務(wù)。此外,它還集成了獨(dú)立的800MHz

2021-10-15 13:58:18

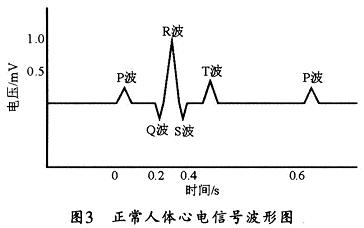

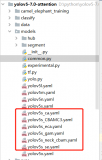

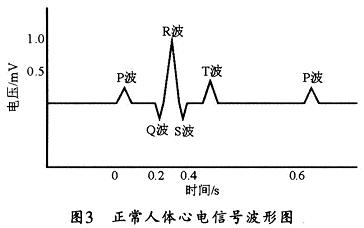

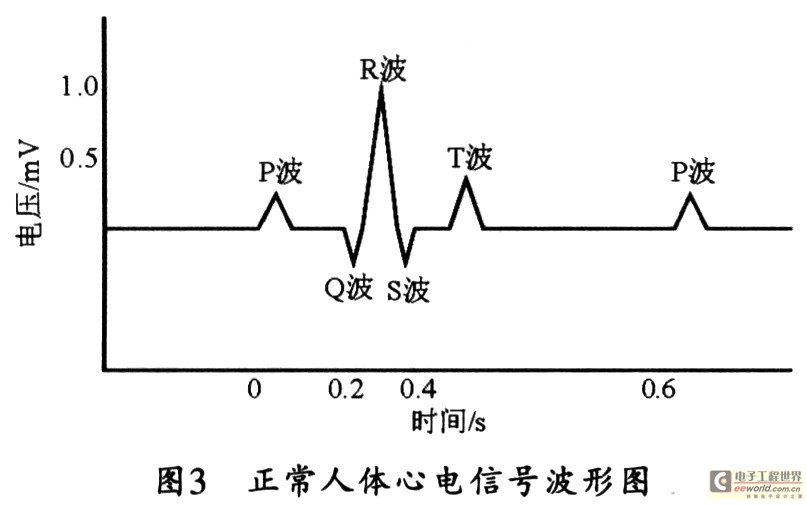

基于心電反饋的注意力缺陷多動(dòng)障礙矯正儀設(shè)計(jì)

0 引言

注意力缺陷多動(dòng)障礙(Attention Deficit Hy-peractivity Disorder,簡(jiǎn)稱ADHD)是兒童和青少年常見的行為問題之一

2009-12-09 10:12:33 1276

1276

基于心電反饋的注意力缺陷多動(dòng)障礙矯正儀設(shè)計(jì)

0 引言

注意力缺陷多動(dòng)障礙(Attention Deficit Hy-peractivity Disorder,簡(jiǎn)稱ADHD)是兒童和青少年常見的行為問題

2009-12-10 10:17:59 631

631

根據(jù)德勤全球的預(yù)測(cè),我們將在 2017 年看到 5G 的部署采取重大、切實(shí)的舉措。首先,擁有 5G 網(wǎng)絡(luò)許多核心要素的增強(qiáng)型 4G 網(wǎng)絡(luò) LTE Advanced(簡(jiǎn)稱LTEAPro)將推出商用

2017-09-20 14:10:50 7

7 方式,而人類沒辦法做到這一點(diǎn)。據(jù)估計(jì),物聯(lián)網(wǎng)的持續(xù)增長,到了2021年,它可能達(dá)到價(jià)值1.6億美元的高點(diǎn),這就意味著會(huì)需要更多的算法來跟上相應(yīng)的數(shù)據(jù)上漲。正如ABI研究所指出的,機(jī)器學(xué)習(xí)的最新進(jìn)展使其能夠進(jìn)行預(yù)測(cè)分析,這意味著采用這些算法的企業(yè)可以更好地預(yù)測(cè)未來的市場(chǎng)趨勢(shì),并更成功地瞄準(zhǔn)未來的客戶。

2018-03-19 22:46:00 347

347 摘要本文提出一種基于注意力機(jī)制的用戶異構(gòu)行為序列的建模框架,并將其應(yīng)用到推薦場(chǎng)景中。

2018-01-25 17:59:14 4457

4457

在當(dāng)前智能制造的熱潮之下,很多企業(yè)都在規(guī)劃建設(shè)智能工廠。眾所周知,智能工廠的規(guī)劃建設(shè)是一個(gè)十分復(fù)雜的系統(tǒng)工程,為了少走彎路,本文整理了在建設(shè)中要考慮的十個(gè)核心要素以及需要關(guān)注的重點(diǎn)維度。

2018-05-24 14:17:56 7209

7209 然而,在基于梯度的學(xué)習(xí)框架(如深度學(xué)習(xí))中存在一個(gè)關(guān)鍵的缺點(diǎn):因?yàn)檫x擇要處理的信息的過程是離散化的,因此也就是不可微分的,所以梯度不能反向傳播到選擇機(jī)制中來支持基于梯度的優(yōu)化。目前研究人員正在努力來解決視覺注意力、文本注意力,乃至更廣泛的機(jī)器學(xué)習(xí)領(lǐng)域內(nèi)的這一缺點(diǎn),這一領(lǐng)域的研究仍然非常活躍。

2018-08-10 08:44:05 5987

5987 此外,通過對(duì)特征向量的 L2 正則化處理來選擇重要性特征,我們的視覺問答框架進(jìn)一步采用硬注意力機(jī)制進(jìn)行增強(qiáng)。我們將最初的版本成為硬注意力網(wǎng)絡(luò) HAN (Hard Attention Network

2018-10-04 09:23:00 5183

5183 在當(dāng)前智能制造的熱潮之下,很多企業(yè)都在規(guī)劃建設(shè)智能工廠。眾所周知,智能工廠的規(guī)劃建設(shè)是一個(gè)十分復(fù)雜的系統(tǒng)工程,為了少走彎路,本文整理了在建設(shè)中要考慮的十個(gè)核心要素以及需要關(guān)注的重點(diǎn)維度。

2018-10-31 16:58:33 6700

6700

12 月22 日,由安全可靠技術(shù)和產(chǎn)業(yè)聯(lián)盟(以下簡(jiǎn)稱安可聯(lián)盟)主辦的安全可靠技術(shù)和應(yīng)用研討會(huì)在廣州順利召開。國科微作為安可聯(lián)盟會(huì)員單位受邀參加,并在大會(huì)上發(fā)布了固態(tài)存儲(chǔ)產(chǎn)品——GOKE 2301 系列SSD,從多個(gè)維度提出了固態(tài)硬盤國產(chǎn)化的核心要素,以便更好地應(yīng)對(duì)行業(yè)市場(chǎng)激增的國產(chǎn)SSD需求。

2018-12-26 08:58:02 1001

1001 本文深入淺出地介紹了近些年的自然語言中的注意力機(jī)制包括從起源、變體到評(píng)價(jià)指標(biāo)方面。

2019-01-25 16:51:17 6045

6045

注意力機(jī)制越發(fā)頻繁的出現(xiàn)在文獻(xiàn)中,因此對(duì)注意力機(jī)制的學(xué)習(xí)、掌握與應(yīng)用顯得十分重要。本文便對(duì)注意力機(jī)制做了較為全面的綜述。

2019-02-17 09:18:22 3587

3587 智能工廠建設(shè)中要考慮的十個(gè)核心要素。

2019-03-01 08:59:53 2151

2151 簡(jiǎn)而言之,深度學(xué)習(xí)中的注意力機(jī)制可以被廣義地定義為一個(gè)描述重要性的權(quán)重向量:通過這個(gè)權(quán)重向量為了預(yù)測(cè)或者推斷一個(gè)元素,比如圖像中的某個(gè)像素或句子中的某個(gè)單詞,我們使用注意力向量定量地估計(jì)出目標(biāo)元素與其他元素之間具有多么強(qiáng)烈的相關(guān)性,并由注意力向量的加權(quán)和作為目標(biāo)的近似值。

2019-03-12 09:49:39 40189

40189 時(shí)記憶(LSTM)的不同位置加入不同類型的注意力機(jī)制,充分利用多注意力機(jī)制的優(yōu)勢(shì),讓模型能夠從不同的角度關(guān)注句子中特定屬性的情感信息,彌補(bǔ)了單一注意力機(jī)制的不足;同時(shí),融合雙向LSTM獨(dú)立編碼的屬性上下文語義信息,獲取更深層次的情感特征,有效識(shí)

2019-05-08 17:07:24 5

5 似性平移不變性相對(duì)注意和圖消息傳遞神經(jīng)網(wǎng)絡(luò)總結(jié)和展望自注意力研究熱點(diǎn)遷移學(xué)習(xí)優(yōu)化和加大模型其他自注意力研究正在進(jìn)行未來展望下節(jié)預(yù)告閱讀更多

2019-07-19 14:40:29 2954

2954

移動(dòng)即服務(wù)(MaaS)被認(rèn)為是智能移動(dòng)的一個(gè)關(guān)鍵要素,而機(jī)器人汽車技術(shù)將是智能移動(dòng)的一個(gè)重要因素,它又高度依賴于嵌入式傳感器。

2020-04-23 11:44:16 515

515 本文提出了一種自監(jiān)督同變注意力機(jī)制(self-supervised equivariant attention mechanism,簡(jiǎn)稱SEAM),利用自監(jiān)督方法來彌補(bǔ)監(jiān)督信號(hào)差異。在強(qiáng)監(jiān)督語義分割的數(shù)據(jù)增廣階段,像素層級(jí)標(biāo)注和輸入圖像需經(jīng)過相同的仿射變換

2020-05-12 10:16:13 7337

7337

四是擴(kuò)大能力拼圖,以高清智能視頻為例,中國電信能提供智能視頻服務(wù)能力,包括可定制機(jī)器視覺、大數(shù)據(jù)分析;支持萬路視頻、直播/點(diǎn)播;EB級(jí)視頻存儲(chǔ);萬路視頻AI識(shí)別分析和百萬級(jí)攝像機(jī)/傳感安全接入,全面助力高清智能視頻的智慧化。

2020-07-02 08:51:44 9584

9584 自注意力網(wǎng)絡(luò)(SANs)在許多自然語言處理任務(wù)中取得顯著的成功,其中包括機(jī)器翻譯、自然語言推理以及語義角色標(biāo)注任務(wù)。

2020-08-31 10:45:02 4670

4670

機(jī)器學(xué)習(xí)的基本過程,羅列了幾個(gè)主要流程和關(guān)鍵要素;繼而展開介紹機(jī)器學(xué)習(xí)主要的算法框架,包括監(jiān)督學(xué)習(xí)算法,無監(jiān)督學(xué)習(xí)算法和常用的降維,特征選擇算法等;最后在業(yè)務(wù)實(shí)踐的過程中,給出了一個(gè)可行的項(xiàng)目管理流程,可供參考。

2020-11-12 10:28:48 10451

10451 和自適應(yīng)激活函數(shù),根據(jù)用戶歷史行為和給定廣告自適應(yīng)地學(xué)習(xí)用戶興趣。引人注意力機(jī)制,區(qū)分不同特征對(duì)預(yù)測(cè)結(jié)果的影響程度,從而增強(qiáng)模型的可解釋性。在3個(gè)公開數(shù)據(jù)集上的實(shí)驗(yàn)結(jié)果表明,相對(duì)LR、PNN等CTR預(yù)估模型,ADIN模型具有更高的AUC值和更

2021-03-12 10:55:11 5

5 情感分析是自然語言處理領(lǐng)域的一個(gè)重要分支,卷積神經(jīng)網(wǎng)絡(luò)(CNN)在文本情感分析方面取得了較好的效果,但其未充分提取文本信息中的關(guān)鍵情感信息。為此,建立一種基于注意力機(jī)制的深度學(xué)習(xí)模型AT-

2021-03-17 09:53:09 12

12 目前多數(shù)利用卷積神經(jīng)網(wǎng)絡(luò)進(jìn)行圖像超分辨率重建的方法忽視對(duì)自然圖像固有屬性的捕捉,并且僅在單一尺度下提取特征。針對(duì)該問題,提出一種基于注意力機(jī)制和多尺度特征融合的網(wǎng)絡(luò)結(jié)構(gòu)。利用注意力機(jī)制融合圖像

2021-03-22 11:18:05 16

16 ,提岀一種基于注意力機(jī)制的狹小空間人群擁擠度分析方法,旨在量化人群,通過卷積神經(jīng)網(wǎng)絡(luò)回歸擁擠率分析當(dāng)前空間內(nèi)的人群擁擠程度。設(shè)計(jì)一個(gè)注意力模塊作為網(wǎng)絡(luò)的前端,通過生成對(duì)應(yīng)尺度的注意力圖區(qū)分背景和人群,保留精確

2021-03-22 11:24:09 7

7 圖像超分辨率重建中的高頻分量通常包含較多輪廓、紋理等細(xì)節(jié)信息,為更好地處理特征圖中的高頻分量與低頻分量,實(shí)現(xiàn)自適應(yīng)調(diào)整信道特征,提岀一種基于特征圖注意力機(jī)制的圖像超分辨重建網(wǎng)絡(luò)模型。利用特征提取

2021-03-22 14:45:36 22

22 基于傳統(tǒng)圖像處理技術(shù)與流水線方式的化學(xué)結(jié)構(gòu)圖像識(shí)別方法通常依賴于人工設(shè)計(jì)的特征,導(dǎo)致識(shí)別準(zhǔn)確率較低。針對(duì)該問題,提岀一種基于空間注意力機(jī)制與通道注意力機(jī)制的化學(xué)結(jié)構(gòu)圖像識(shí)別方法。將化學(xué)結(jié)構(gòu)識(shí)別視為

2021-03-22 15:20:54 7

7 為提升原始SSD算法的小目標(biāo)檢測(cè)精度及魯棒性,提出一種基于通道注意力機(jī)制的SSD目標(biāo)檢測(cè)算法。在原始SSD算法的基礎(chǔ)上對(duì)高層特征圖進(jìn)行全局池化操作,結(jié)合通道注意力機(jī)制增強(qiáng)高層特征圖的語義信息,并利用

2021-03-25 11:04:06 20

20 在自然語言處理任務(wù)中使用注意力機(jī)制可準(zhǔn)確衡量單詞重要度。為此,提出一種注意力增強(qiáng)的自然語言推理模型aESM。將詞注意力層以及自適應(yīng)方向權(quán)重層添加到ESIM模型的雙向LSTM網(wǎng)絡(luò)中,從而更有效地學(xué)習(xí)

2021-03-25 11:34:15 9

9 針對(duì)現(xiàn)有文本情感分析方法存在的無法高效捕捉相關(guān)文本情感特征從而造成情感分析效果不佳的問題提出一種融合雙層多頭自注意力與卷積神經(jīng)網(wǎng)絡(luò)(CNN)的回歸模型 DLMA-CNN。采用多頭自注意力機(jī)制學(xué)習(xí)序列

2021-03-25 15:16:39 6

6 神經(jīng)網(wǎng)絡(luò)、雙向門控循環(huán)單元和注意力機(jī)制提取 PFSHAN模型的語音、字形和語義特征。在特征融合階段,針對(duì)不同單詞對(duì)幽默語言學(xué)特征的貢獻(xiàn)程度不同,且不同幽默語言學(xué)特征和語句之間關(guān)聯(lián)程度不同的問題,采用層次注意力機(jī)制調(diào)整不同幽默語言學(xué)

2021-03-26 15:38:15 14

14 在連續(xù)維度情感識(shí)別任務(wù)中,每個(gè)模態(tài)內(nèi)部凸顯情感表達(dá)的部分并不相同,不同模態(tài)對(duì)于情感狀態(tài)的影響程度也有差別。為此,通過學(xué)習(xí)各個(gè)模態(tài)特征并采用合理的融合方式,提出一種基于層次注意力機(jī)制的多模態(tài)維度情感

2021-04-01 11:20:51 8

8 基于注意力機(jī)制的編解碼模型在文本摘要、杌器翻譯等序列到序列任務(wù)上得到了廣泛的應(yīng)用。在深度學(xué)習(xí)框架中,深層神經(jīng)網(wǎng)絡(luò)能夠提取輸λ數(shù)據(jù)不冋的特征表示,因此傳統(tǒng)編解碼模型中通常堆疊多層解碼器來提高模型性能

2021-04-07 11:35:29 2

2 為提升基于編解碼架構(gòu)的U型網(wǎng)絡(luò)在深度學(xué)習(xí)光流估計(jì)中的精度,提岀了一種結(jié)合注意力機(jī)制的改進(jìn)有監(jiān)督深度學(xué)習(xí)光流網(wǎng)絡(luò)。網(wǎng)絡(luò)由收縮和擴(kuò)張兩部分組成,收縮部分利用一系列卷積層來提取圖像之間的高級(jí)特征,擴(kuò)張部分

2021-04-07 13:56:25 4

4 置預(yù)測(cè)的影響權(quán)重不同,以及長期的歷史信息會(huì)來帶維數(shù)災(zāi)難等,移動(dòng)對(duì)象的位置預(yù)測(cè)面臨著嚴(yán)峻的挑戰(zhàn)。針對(duì)這些挑戰(zhàn),在分析現(xiàn)有預(yù)測(cè)算法的不足的基礎(chǔ)上,提出了一種長短期記憶網(wǎng)絡(luò)(LSTM)和注意力( Attention)機(jī)制相結(jié)合的機(jī)器學(xué)習(xí)模型

2021-04-08 13:51:39 7

7 網(wǎng)絡(luò),分別處理用戶評(píng)論集和物品評(píng)論集。對(duì)評(píng)論文本的內(nèi)容應(yīng)用主題級(jí)注意力機(jī)制,標(biāo)記多組帶有主題信息的單詞(或短語),對(duì)評(píng)論集應(yīng)用評(píng)論級(jí)注意力機(jī)制,標(biāo)記有效的評(píng)論。采用外積為用戶偏好和物品特征建立外積交互矩陣,并對(duì)此矩

2021-04-12 10:33:25 7

7 模玦、分類囂模塊、本體約柬層。在分類器模抉中,引入并改進(jìn)了實(shí)例級(jí)注意力機(jī)制,更妤地學(xué)習(xí)數(shù)據(jù)袋中每個(gè)句子的權(quán)重,有效地降低了遠(yuǎn)程嗌督假設(shè)引入的噪聲干擾及勹子中實(shí)體間的詞語信息干擾。在本體約東層,通過引入領(lǐng)域本體對(duì)抽取結(jié)果進(jìn)

2021-04-12 14:30:53 14

14 這些問題,文中提出了基于深度LSTM和注意力機(jī)制的金融數(shù)據(jù)預(yù)測(cè)模型。首先,該模型能處理復(fù)雜的金融市場(chǎng)數(shù)據(jù)輸入,主要是多序列的輸入;其次,該模型使用深度LSTM網(wǎng)絡(luò)對(duì)金融數(shù)據(jù)進(jìn)行建模,解決了數(shù)據(jù)間長依賴的問題,并能學(xué)習(xí)到

2021-04-23 11:32:44 7

7 臨床特征,對(duì)阿爾茨海默癥進(jìn)行自動(dòng)診斷,并預(yù)測(cè)潛在的預(yù)后風(fēng)險(xiǎn),進(jìn)而提岀了一饣基于層次注意力機(jī)制的多任務(wù)疾病進(jìn)展模型。該模型將疾病自動(dòng)診斷任務(wù)作為主任務(wù),疾病預(yù)后預(yù)測(cè)仼務(wù)作為輔仼務(wù),以提升模型的泛化能力,進(jìn)而

2021-05-07 14:47:21 7

7 針對(duì)跨域服裝檢索中服裝商品圖像拍攝嚴(yán)格約束光照、背景等條件,而用戶圖像源自復(fù)雜多變的日常生活場(chǎng)景,難以避免背景干擾以及視角、姿態(tài)引起的服裝形變等問題。提出一種結(jié)合注意力機(jī)制的跨域服裝檢索方法。利用

2021-05-12 14:19:46 2

2 信息給網(wǎng)絡(luò)造成的影響,在網(wǎng)絡(luò)的特征重建模塊中引入了通道注意力機(jī)制,并融合人臉解析信息提出一種殘差通道注意塊,不僅提高了網(wǎng)絡(luò)特征利用率還加強(qiáng)了人臉先驗(yàn)的約束力度。與現(xiàn)有算法在 Helen, Celebs和LFW數(shù)據(jù)集上進(jìn)行的實(shí)驗(yàn)結(jié)

2021-05-12 16:10:21 5

5 編碼器分別對(duì)詞向量和句向量進(jìn)行編碼,并通過注意力機(jī)制加杈求和以獲得文檔的最終表示。設(shè)計(jì)輔助網(wǎng)絡(luò)對(duì)文本的詞、句進(jìn)行情感評(píng)分,利用該評(píng)分調(diào)整注意力權(quán)重分布。在探究文本的情感信息對(duì)分類性能的影響后,通過輔助網(wǎng)絡(luò)

2021-05-14 11:02:19 5

5 在當(dāng)前智能制造的熱潮之下,很多企業(yè)都在規(guī)劃建設(shè)智能工廠。那么,智能工廠的規(guī)劃要考慮哪些核心要素?關(guān)注哪些維度?

2021-05-14 16:04:07 3849

3849 針對(duì)傳統(tǒng)語義分割網(wǎng)絡(luò)速度慢、精度低的問題,提出一種基于密集層和注意力機(jī)制的快速場(chǎng)景語義分割方法。在 Resnet網(wǎng)絡(luò)中加入密集層和注意力模塊,密集層部分采用兩路傳播方式,以更好地獲得多尺度目標(biāo)

2021-05-24 15:48:33 6

6 在信息抽取過程中,無法被判別的回指易造成信息抽取不完整的情況,這種指代關(guān)系可通過分析當(dāng)前語境下的指代部分、被指代部分、周圍的信息及原文內(nèi)容生成的唯一判別信息進(jìn)行判斷。為此,構(gòu)建一個(gè)多層注意力機(jī)制模型

2021-05-27 17:10:55 2

2 基于注意力機(jī)制等的社交網(wǎng)絡(luò)熱度預(yù)測(cè)模型

2021-06-07 15:12:24 14

14 和翻譯的神經(jīng)機(jī)器翻譯注意機(jī)制的使用。并且提供一些示例明確且詳盡地解釋了注意力機(jī)制的數(shù)學(xué)和應(yīng)用。 在本文中,我將專注于注意力機(jī)

2021-06-16 17:19:56 2376

2376

基于多通道自注意力機(jī)制的電子病歷架構(gòu)

2021-06-24 16:19:30 75

75 基于注意力機(jī)制的跨域服裝檢索方法綜述

2021-06-27 10:33:24 2

2 基于注意力機(jī)制的新聞文本分類模型

2021-06-27 15:32:32 29

29 基于非對(duì)稱注意力機(jī)制殘差網(wǎng)絡(luò)的圖像檢測(cè)

2021-07-05 15:29:13 8

8 無論是商用電腦還是工業(yè)電腦,核心都是主板,而工業(yè)主板由于其應(yīng)用范圍更廣泛,使用環(huán)境更復(fù)雜,因此用戶對(duì)其功能、兼容性、可靠性要求更高。那國產(chǎn)工業(yè)主板的核心要素有哪些? 一、制造工藝 在選購工業(yè)

2021-12-14 15:47:55 1105

1105 很多中國人在選購智能指紋鎖的時(shí)候不知道該從何處下手,(腳手架掛牌)其實(shí)我們只需要通過關(guān)注學(xué)生以下7個(gè)要素,便可以自己知道企業(yè)應(yīng)該選購什么樣的指紋鎖! 1.鎖芯等級(jí) 要評(píng)估一個(gè)鎖的安全級(jí)別,最重

2022-01-29 22:58:08 911

911 我們提出了一種新穎的即插即用融合模塊:雙跨視角空間注意力機(jī)制 (VISTA),以產(chǎn)生融合良好的多視角特征,以提高 3D 目標(biāo)檢測(cè)器的性能。我們提出的 VISTA 用卷積算子代替了 MLP,這能夠更好地處理注意力建模的局部線索。

2022-04-07 09:39:17 1082

1082 工業(yè)主板由于其應(yīng)用范圍更廣泛,使用環(huán)境更復(fù)雜,因此用戶對(duì)其功能、兼容性、可靠性要求更高。那工業(yè)主板的核心要素有哪些? 1、制造工藝 首先要觀察工業(yè)主板的制造工藝。檢測(cè)工業(yè)主板的制造工藝一看主板做工

2022-09-30 15:38:59 477

477 通過引入像素注意力,PAN在大幅降低參數(shù)量的同時(shí)取得了非常優(yōu)秀的性能。相比通道注意力與空域注意力,像素注意力是一種更廣義的注意力形式,為進(jìn)一步的探索提供了一個(gè)非常好的基線。

2022-10-27 13:55:23 718

718 電子發(fā)燒友網(wǎng)站提供《如何用番茄鐘提高注意力.zip》資料免費(fèi)下載

2022-10-28 14:29:36 0

0 工業(yè)主板由于其應(yīng)用范圍更廣泛,使用環(huán)境更復(fù)雜,因此用戶對(duì)其功能、兼容性、可靠性要求更高。那工業(yè)主板的核心要素有哪些? 1、制造工藝 首先要觀察工業(yè)主板的制造工藝。檢測(cè)工業(yè)主板的制造工藝一看主板做工

2022-10-28 17:07:18 762

762 SE注意力模塊的全稱是Squeeze-and-Excitation block、其中Squeeze實(shí)現(xiàn)全局信息嵌入、Excitation實(shí)現(xiàn)自適應(yīng)權(quán)重矯正,合起來就是SE注意力模塊。

2023-05-18 10:23:34 1746

1746

計(jì)算機(jī)視覺中的注意力機(jī)制 卷積神經(jīng)網(wǎng)絡(luò)中常用的Attention 參考 注意力機(jī)制簡(jiǎn)介與分類 注意力機(jī)制(Attention Mechanism) 是機(jī)器學(xué)習(xí)中的一種數(shù)據(jù)處理方法,廣泛應(yīng)用

2023-05-22 09:46:03 0

0 本文簡(jiǎn)介了一種新的深度注意力算法,即深度殘差收縮網(wǎng)絡(luò)(Deep Residual Shrinkage Network)。從功能上講,深度殘差收縮網(wǎng)絡(luò)是一種面向強(qiáng)噪聲或者高度冗余數(shù)據(jù)的特征學(xué)習(xí)

2023-05-24 16:28:23 0

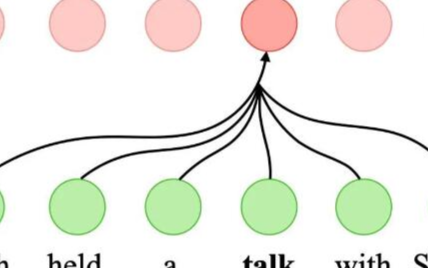

0 ? 視覺注意力機(jī)制的各種模塊是個(gè)好東西,即插即用,可以添加到主流的對(duì)象檢測(cè)、實(shí)例分割等模型的backbone與neck中,實(shí)現(xiàn)輕松漲點(diǎn),本文使用OID數(shù)據(jù)集的2000多張數(shù)據(jù),基于YOLOv5s

2023-06-02 14:52:35 841

841

電子發(fā)燒友網(wǎng)站提供《PyTorch教程11.4之Bahdanau注意力機(jī)制.pdf》資料免費(fèi)下載

2023-06-05 15:11:03 0

0 電子發(fā)燒友網(wǎng)站提供《PyTorch教程11.5之多頭注意力.pdf》資料免費(fèi)下載

2023-06-05 15:04:13 0

0 電子發(fā)燒友網(wǎng)站提供《PyTorch教程11.6之自注意力和位置編碼.pdf》資料免費(fèi)下載

2023-06-05 15:05:22 0

0 11.4. Bahdanau 注意力機(jī)制? Colab [火炬]在 Colab 中打開筆記本 Colab [mxnet] Open the notebook in Colab Colab

2023-06-05 15:44:28 499

499

與較長范圍)在一個(gè)序列中。因此,這可能是有益的

允許我們的注意力機(jī)制聯(lián)合使用查詢、鍵和值的不同表示子空間。

為此,可以使用以下方式轉(zhuǎn)換查詢、鍵和值,而不是執(zhí)行單個(gè)注意力池h獨(dú)立學(xué)習(xí)線性投影。那么

2023-06-05 15:44:29 329

329

在 SageMaker Studio Lab 中打開筆記本

在深度學(xué)習(xí)中,我們經(jīng)常使用 CNN 或 RNN 對(duì)序列進(jìn)行編碼。現(xiàn)在考慮到注意力機(jī)制,想象一下將一系列標(biāo)記輸入注意力機(jī)制,這樣在每個(gè)步驟

2023-06-05 15:44:29 953

953

)提出用注意力機(jī)制解決自然語言推理,并將其稱為“可分解注意力模型”。這導(dǎo)致模型沒有循環(huán)層或卷積層,在 SNLI 數(shù)據(jù)集上以更少的參數(shù)獲得了當(dāng)時(shí)最好的結(jié)果。在本節(jié)中,我們將描述和實(shí)現(xiàn)這種用于自然語言推理

2023-06-05 15:44:42 302

302

具有獨(dú)立電氣的芯片分裂出來。在這過程中,水源進(jìn)行冷卻保護(hù)。晶圓切割四要素,聯(lián)動(dòng)工作,缺一不可。原理很簡(jiǎn)單,精細(xì)活兒卻不那么好干。主軸砂輪劃片機(jī)主軸采用空氣靜壓支承的

2021-12-17 14:17:43 831

831

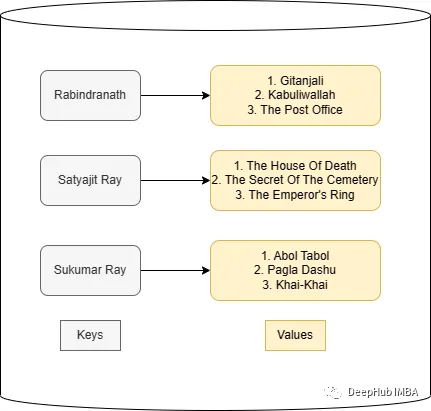

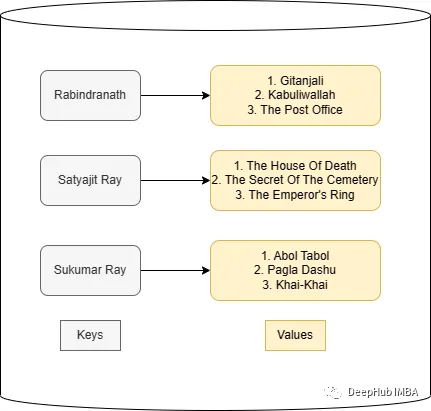

在整個(gè)注意力過程中,模型會(huì)學(xué)習(xí)了三個(gè)權(quán)重:查詢、鍵和值。查詢、鍵和值的思想來源于信息檢索系統(tǒng)。所以我們先理解數(shù)據(jù)庫查詢的思想。

2023-06-29 17:06:20 690

690

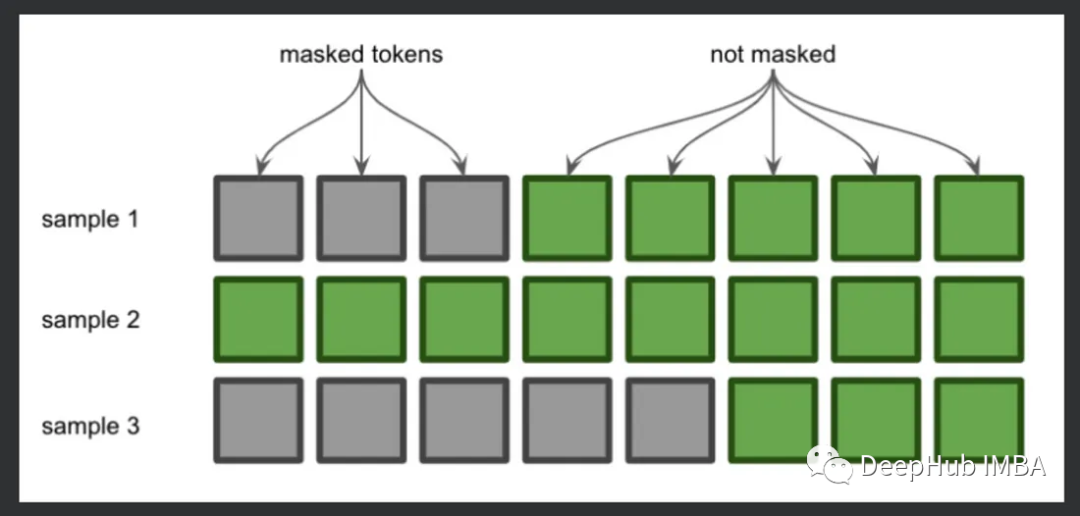

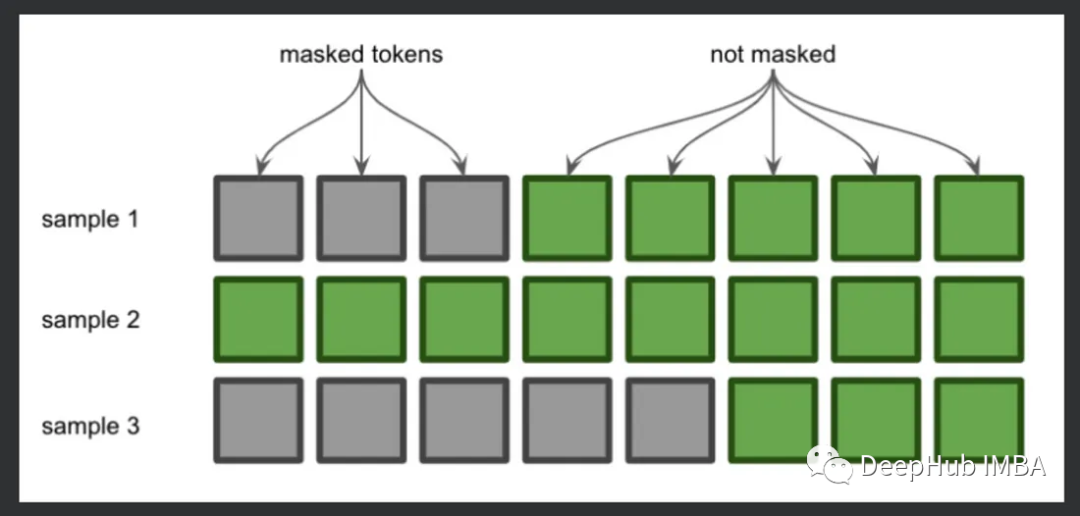

注意力機(jī)制的掩碼允許我們發(fā)送不同長度的批次數(shù)據(jù)一次性的發(fā)送到transformer中。在代碼中是通過將所有序列填充到相同的長度,然后使用“attention_mask”張量來識(shí)別哪些令牌是填充的來做到這一點(diǎn),本文將詳細(xì)介紹這個(gè)掩碼的原理和機(jī)制。

2023-07-17 16:46:19 412

412

電子發(fā)燒友網(wǎng)站提供《新一代MES十大核心要素.docx》資料免費(fèi)下載

2023-12-29 11:14:26 0

0  電子發(fā)燒友App

電子發(fā)燒友App

評(píng)論