美滿電子科技(Marvell)今天宣布,中國搜索引擎巨頭百度在全球首次商用的ARM架構服務器中,采用了Marvell公司的 ARM芯片組。作為世界范圍內首家商用ARM服務器的公司,百度引領并開啟了具有更低能耗和更高性能的全新“綠色數據中心”的新時代。

2013-02-26 11:04:02 1372

1372 Machine Learning SDK 相集成以供預覽。客戶可以使用 Azure 大規模部署的英特爾? FPGA(現場可編程邏輯門陣列)技術,為其模型提供行業領先的人工智能 (AI) 推理性能。

2018-05-16 17:25:03 6184

6184 Nvidia不太可能很快放棄目前在AI培訓處理器市場上的領先優勢,特別是考慮到它也在該領域投入巨資。雖然服務器推理處理器市場競爭更加激烈,但英特爾可能會成為與Nvidia和Xilinx一樣強大的玩家。

2019-03-18 21:07:10 7659

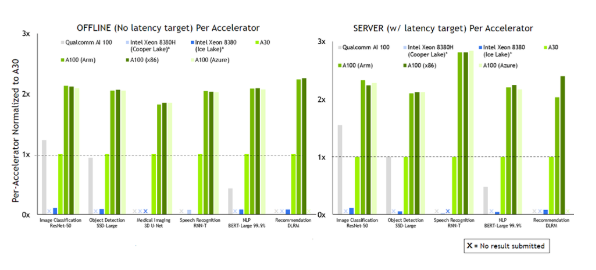

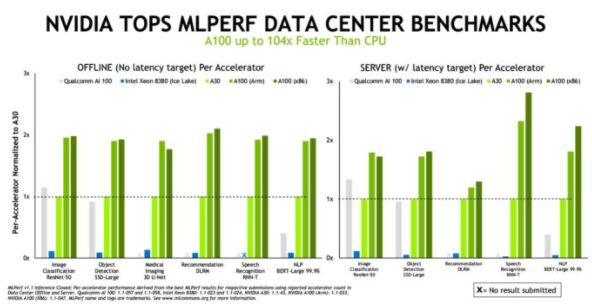

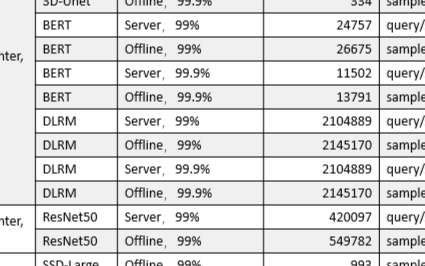

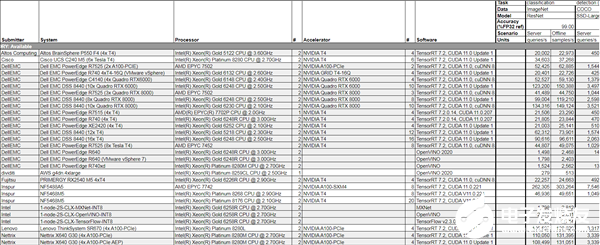

7659 不久前,AI性能基準評測平臺MLPerf公布了2022年首次推理(Inference v2.0)測試成績,NVIDIA的AI平臺表現依然搶眼。

2022-04-15 22:12:00 2738

2738

NVIDIA Turing GPU和Xavier 芯片系統在首個獨立AI推理基準測試 ——MLPerf Inference 0.5中取得第一名。

2019-11-08 16:53:29 5054

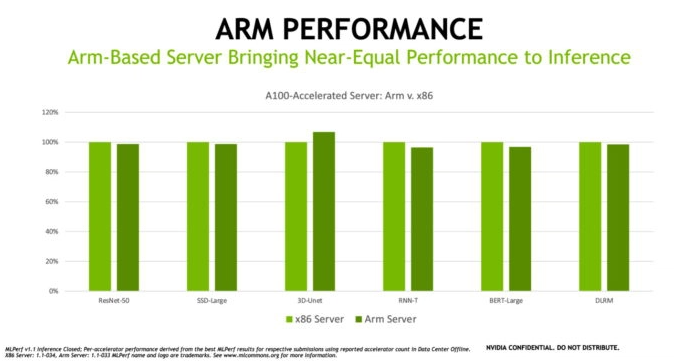

5054 NVIDIA與Arm、Ampere、Cray、富士通、HPE、Marvell攜手構建GPU加速服務器,以滿足從超大規模云到邊緣、從模擬到AI、從高性能存儲到百萬兆級超級計算等多樣化需求。

2019-11-20 09:38:42 1384

1384 NVIDIA憑借A100進一步擴大了在MLPerf基準測試中的領先優勢,實現了比CPU快237倍的AI推理性能,助力企業將AI研究轉化為生產力。

2020-10-22 14:07:58 714

714 寧暢工程師介紹,參加MLPerf Inference(推理)基準測試的X640 G30 AI服務器,最高可支持10張NVIDIA A100 PCIe卡或21張NVIDIA T4 PCIe卡,堪稱“性能猛獸”。

2020-10-23 10:48:37 644

644 arm9linux系統平臺:最近查ARM9上可以用的輕型WEB服務器 ,有BOA, HTTPD , THTTPD 等等,支持資源比較好的 是BOA ,但這種實現方式需要接入互聯網,而且還可能集成

2022-10-28 10:53:39

和數據吞吐量進行優化的服務器和數據中心人工智能和機器學習 (ML) 的需求。否則,人工智能所需的成本、電力和碳將開始超過收益。NVIDIA 率先使用 GPU 來提高數據中心中 HPC 和 AI 的性能

2022-03-29 14:40:21

:具有 AWS Graviton3 處理器的 c7g.4xlarge 實例集群和具有 AWS Graviton2 處理器的 c6g.4xlarge 實例集群實現的 Resnet-50 v1.5 實時推理性能

2022-08-31 15:03:46

Cortex 三兄弟里最追求性能的了,但畢竟不是面向服務器平臺的產品,不能放寬功耗限制去飆性能。于是,在Graviton 公開之前一個月,Arm 發布了面向云計算和邊緣基礎設施的 Neoverse

2022-09-08 14:32:42

的方式之一。作為通用的系統架構,Arm64服務器在多種數據中心應用場景都具有獨特優勢,如存儲,大數據分析,高性能計算,物聯網的邊緣計算,Android應用,容器微服務等等。Arm64服務器基于開放的芯片

2018-06-03 13:20:30

首個獨立AI推理基準測試 ——MLPerf Inference 0.5中取得第一名。由于推理一直是AI市場中最大、同時也是最具競爭力的領域,業內此前一直希望能夠有一套客觀的推理性能測試指標。在參與

2019-11-08 19:44:51

擁有ARM而不僅僅是獲得ARM的許可,Nvidia可以添加特殊的指令來與其GPU建立更緊密的集成。為了獲得最高性能,需要將CPU和GPU集成在一個芯片上,并且由于英特爾正在開發其競爭的Xe系列加速器

2020-09-07 09:49:42

客戶在其環境中擁有nVidia Licensing服務器(vSphere Enterprise Plus和Horizo??n 7)。許可證文件在nVidia企業門戶中生成,并且許可證服務器中安裝了2

2018-09-20 11:41:44

arm9linux系統平臺:最近查ARM9上可以用的輕型WEB服務器 ,有BOA, HTTPD , THTTPD 等等,支持資源比較好的 是BOA ,但這種實現方式需要接入互聯網,而且還可能集成

2022-07-22 14:10:59

現在的進展并不快,因為老測試集里面用例數量龐大。目前,老測試集中的用例數量還遠遠大于新測試集。問題大量的集成測試用例為性能研究提供了方便。筆者通過比較同一測試集在arm64和x86服務器上運行的耗時來

2022-07-12 15:48:13

服務,讓傳感器和相關的控制設備接入,為此,本期blog將向大家介紹如何使用gevent高性能的并發處理庫在draognbaord 410c上來實現一個高性能的TCP服務器。gevent是基于協程

2018-09-25 15:53:03

的示例是在 Arm 上運行 ML 推理的 Linux 應用程序。我們之前已經在MNIST 數據集上訓練了一個神經網絡 來識別手寫數字。使用Arm NN和 Streamline,我們希望了解我們模型

2022-09-27 14:24:27

就不能勝任的話,一臺價值幾萬,甚至幾十萬的服務器在短時間內就要遭到淘汰,這是任何企業都無法承受的。為了保持可擴展性,通常需要在服務器上具備一定的可擴展空間和冗余件(如磁盤陣列架位、PCI和內存條插槽位

2014-08-02 10:42:26

請問一下,關于 ESP8266 模塊在使用 AT 固件的情況下,如何通過域名取得服務器的IP地址和端口號的問題?

2023-03-08 06:36:51

請問一下,關于 ESP8266 模塊在使用 AT 固件的情況下,如何通過域名取得服務器的IP地址和端口號的問題?

2023-03-09 06:21:51

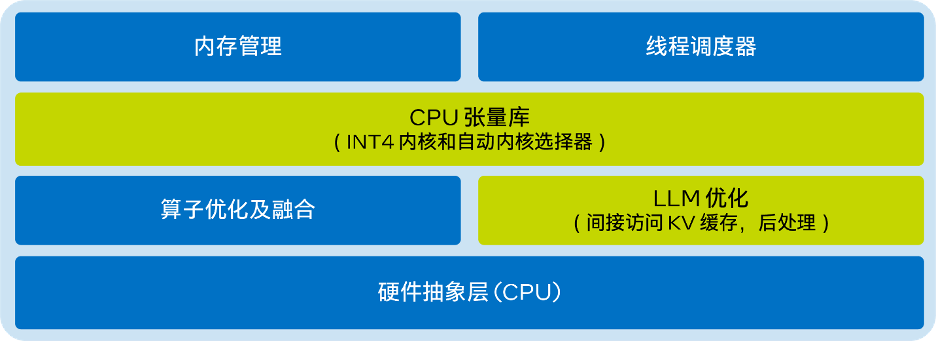

Part 1 OpenPPL ARM Server 簡介OpenPPL Arm Server 定義? 針對高性能 ARM 架構服務器處理器優化的深度學習推理引擎? 目前支持 FP32 及 FP16

2022-03-31 11:51:33

服務器。 MARS3500系列,就是基于RK3588、RK3588S的高密度ARM陣列服務器,可廣泛應用于云手機、云手游、云VR、云電視、云渲染、邊緣計算、移動辦公、網絡輿情監測等領域

2022-07-18 17:54:32

,這在滿足個性化需求和增強服務器安全

性上具有優勢。

Linux服務器還具有出色的性能和穩定性。相比之下,Windows服務器在性能和穩定性方面稍有不足。特別是在處理高負載和

大數據量的情況下

2024-02-22 15:46:15

、穩定的異構計算云基礎設施資源。異構計算GN5規格族實例性能展現相信有了阿里云GPU云服務器的助力,人工智能企業和AI生態一定會取得更多更快的發展。

2017-12-26 11:22:09

`現如今,隨著云計算技術的發展,現在很多企業都紛紛選擇云服務器,正是因為這種方式可以有效降低企業的成本,而且從性能上來說,也是遠遠超于傳統服務器的,使用也十分的方便。然而,還有一些朋友擔心云服務器

2021-03-27 14:31:18

自身的優勢,支持企業業務在彈性擴展能力上的高要求,具有高可用性,滿足企業對數據進行快速恢復需求。云服務器能夠滿足企業在電子商務、企業網站、OA系統、企業ERP/CRM管理軟件、論壇和SNS等等各種需求

2018-07-31 18:35:28

、內存、系統總線等,和通用的計算機架構類似。由于服務器需要提供高可靠的服務,所以在處理能力、穩定性、可靠性、安全性、可擴展性、可管理性等方面要求較高。服務器和電腦功能都是一樣的,也可以將服務器稱之為電腦,只是服務器對穩定性與安全性以及處理器數據能力有更高要求。比如我們隨時瀏覽一個網站,發現這個網站

2021-07-16 07:35:04

的是要知道它提供的選項來提高推理性能。作為開發人員,您會尋找可以壓縮的每一毫秒,尤其是在需要實現實時推理時。讓我們看一下Arm NN中可用的優化選項之一,并通過一些實際示例評估它可能產生

2022-04-11 17:33:06

1.臭皮匠服務器機房分布:國內:福州,湖州,臺州,鎮江,貴州等地國外:美國,新加坡等國2.臭皮匠服務器優勢:我們具有國內技術與服務頂尖的I DC及互聯網云安全服務商!我司整合了國內領先的I DC運營

2018-04-21 15:42:54

推理性能與當前服務器級 CPU 相比,VCK190 能夠提供超過 100 倍的計算性能。下面是基于 C32B6 DPU 內核的 AI 引擎實現的性能示例,批處理 = 6。有關 VCK190 上各種

2022-11-25 16:29:20

嗨,我想知道,如果可以安裝NVIDIA許可證服務器嗎?我沒有找到任何關于此的明確文件。 setup.exe也沒有我能夠使用的任何清晰的開關/參數。謝謝,延以上來自于谷歌翻譯以下為原文Hi, I

2018-09-18 16:18:10

基于SRAM的方法可加速AI推理

2020-12-30 07:28:28

本人現在在做ARM上構建一個web服務器,就是將網頁放在這個服務器上,然后接入internet可以通過PC機上網訪問即可。用的是C#編程,實際實現上還是有些模糊,希望有心人能教教俺,最好能給出服務器和客服端的程序做參考說明,先謝過了。。。

2022-10-28 10:55:15

Tengine是什么?如何在RK3399這一 Arm64 平臺上搭建 Tengine AI 推理框架,并運行圖像識別相關應用?

2022-03-07 07:53:43

Tengine是什么呢?如何在RK3399這一 Arm64平臺上搭建Tengine AI推理框架呢?

2022-03-04 12:31:35

使用 PyTorch 對具有非方形圖像的 YOLOv4 模型進行了訓練。

將 權重轉換為 ONNX 文件,然后轉換為中間表示 (IR)。

無法確定如何獲得更好的推理性能。

2023-08-15 06:58:00

成本比較高,而且不方便工業現場的應用實施,嵌入式系統以及嵌入式小型Web服務器的出現使得Web服務運行在資源、性能有限的嵌入式設備上提供了條件。本文主要介紹嵌入式Web服務器BOA在ARM9嵌入式系統設備板上的移植,并對移植后的BOA服務器進行測試驗證。

2019-10-29 06:48:51

的參考。評估TI處理器模型性能的方式有兩種:TDA4VM入門套件評估模塊(EVM)或TI Edge AI Cloud,后者是一項免費在線服務,可支持遠程訪問TDA4VM EVM,以評估深度學習推理性能。借助

2022-11-03 06:53:28

1、在Arm服務器上Robox安卓容器方案的構建編譯過程和使用方法隨著云計算相關產業蓬勃發展,用戶對移動設備的彈性需求推動出云手機、云游戲等概念,云手機和云游戲就是將云計算技術運用于網絡終端服務

2022-06-17 14:34:24

生成兩個 IR文件(相同的 .xml 文件,但不同的 .bin 文件)

具有不同重量的類似模型,以不同的 fps (27fps 和 6fps) 運行

更多樣化的權重是否會影響 Myriad X 上的推理性能?

2023-08-15 07:00:25

商業發行之前就已經過時了。算法明天需要對架構、內存/數據進行徹底改革資源和能力。推理的夢幻建筑重新定義重寫在計算和交付突破性的人工智能加速和靈活的計算能力超越了服務器級CPU和比GPU/ASIC通用

2020-11-01 09:28:57

(NN)引擎和張量處理架構(Tensor Processing Fabric)技術提供卓越的神經網絡推理性能,具有業界領先的能耗效率(TOPS/W)和面積效率(平方毫米/瓦),可擴展的計算能力范圍從0.5TOPS( 每秒萬億次運算)到幾百TOPS。

2019-09-11 11:52:13

網站權重提高多IP站群服務器,可以大大降低同一IP上的網站數量,如果網站數量在258以下,還可以每個網站分配一個獨立IP,從而可以減少網站之間的分權。4、多ip避免封殺網站受影響如果一個ip多個網站

2023-04-18 16:16:20

荷蘭服務器的十大優勢 1、荷蘭機房眾多,例如荷蘭的阿姆斯特丹機房、萊茵河畔機房等,都是荷蘭乃至歐洲最優質的機房。有需要請聯系TG:@TW_001 2、荷蘭IP眾多,一臺服務器最高可以添加253個IP

2021-12-16 10:26:55

內存也是內存(RAM),具有一些特有的技術從而有著極高的穩定性和糾錯性能。最直觀的分辨服務器內存與普通內存的方法就是看條子上的字有沒有帶ECC模塊。◆◆現我司大量在服務器內存條,收購威剛服務器內存條

2021-09-22 19:20:15

、操作系統等,滿足不同的需求。綜上所述,高防服務器具有很多的優勢,能夠為客戶提供穩定可靠、安全高效、高品質帶寬的網絡服務。因此,在如今互聯網猖獗的環境中,選擇一個好的高防服務器,能夠在網站運營中起到關鍵

2023-03-21 12:40:07

27日消息 ARM與聯發科技(MediaTek)今日宣布擴大雙方長期合作關系,聯發科技取得大量市場領先的高性能ARM知識產權(IP)授權,包括可用于智能手機、智能電視與藍光播放器的ARMMali系列

2012-02-28 09:11:01 737

737 針對CLINK算法在路由改變時擁塞鏈路推理性能下降的問題,建立一種變結構離散動態貝葉斯網模型,通過引入馬爾可夫性及時齊性假設簡化該模型,并基于簡化模型提出一種IP網絡擁塞鏈路推理算法(VSDDB

2018-01-16 18:46:26 0

0 Azure Machine Learning SDK 相集成以供預覽。客戶可以使用 Azure 大規模部署的英特爾 FPGA(現場可編程邏輯門陣列)技術,為其模型提供行業領先的人工智能 (AI) 推理性能。 “作為一家整體技術提供商,我們通過與 Microsoft 密切合作為人工智能提供支持。

2018-05-20 00:10:00 2865

2865 TaiShan系列服務器主要面向大數據、分布式存儲和ARM原生應用等場景,發揮ARM架構在多核、高能效等方面的優勢,為企業構建高性能、低功耗的新計算平臺;例如大數據場景,實現了多核高并發和資源調度調優,計算性能提升20%。基于TaiShan服務器,華為云也將提供彈性云服務、裸金屬服務和云手機服務。

2019-01-09 09:39:05 10813

10813 MLPerf Inference 0.5是業內首個獨立AI推理基準套件,其測試結果證明了NVIDIA Turing數據中心GPU以及 NVIDIA Xavier 邊緣計算芯片系統的性能。

2019-11-29 14:45:02 2696

2696 NVIDIA和多家全球領先的服務器制造商于今日發布多款內置NVIDIA A100的系統。這些系統具有多種不同的設計和配置,可應對AI、數據科學和科學計算領域最復雜的挑戰。

2020-06-24 16:04:33 2585

2585 結合NVIDIA 領先的人工智能技術與 Arm 龐大的計算生態系統,讓創新成果惠及所有客戶 NVIDIA 將建立世界先進的 AI 研究和教育中心來擴大Arm在英國劍橋的研發業務,并打造采用 Arm

2020-09-21 13:44:17 1347

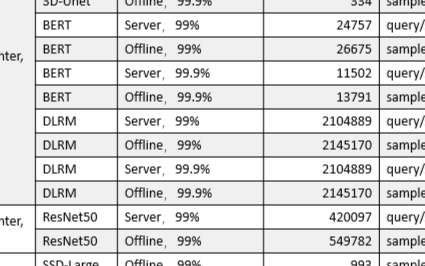

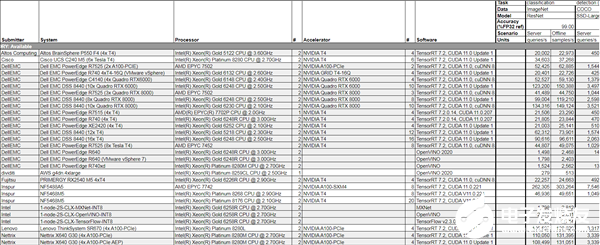

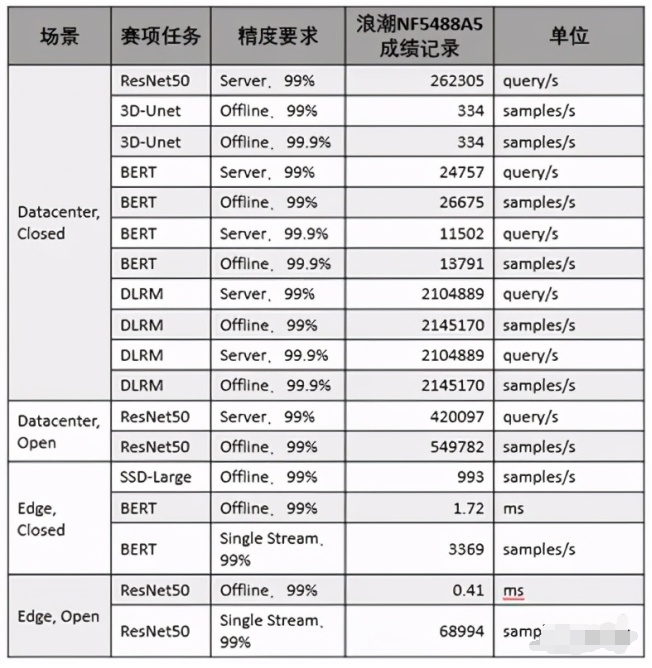

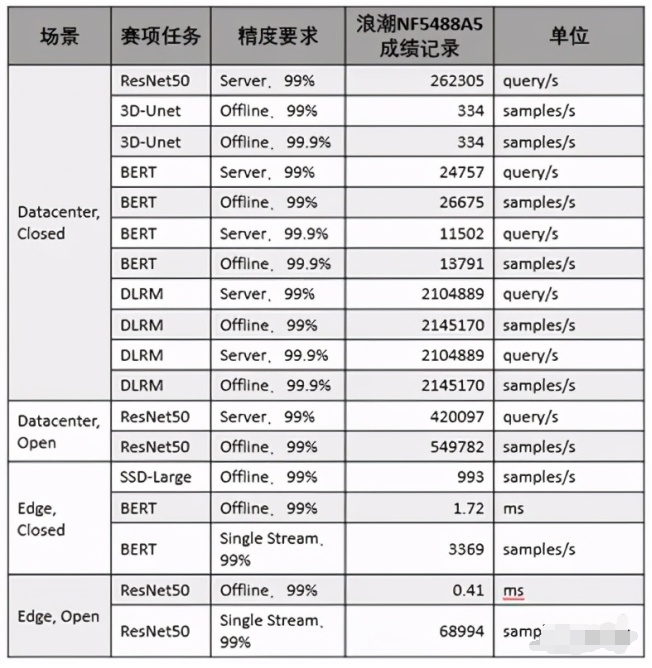

1347 美國東部時間10月21日,全球備受矚目的權威AI基準測試MLPerf公布今年的推理測試榜單,浪潮AI服務器NF5488A5一舉創造18項性能紀錄,在數據中心AI推理性能上遙遙領先其他廠商產品

2020-10-23 16:59:44 1615

1615

的237倍。 MLPerf Inference V0.7部分結果截圖 最新的AI推理測試結果意味著,NVIDIA未來可能在AI推理和訓練市場都占據領導地位,給云端AI推理市場擁有優勢的Intel帶來更大壓力的

2020-10-23 17:40:02 3929

3929

弗洛伊德說:“英偉達在競爭激烈的競爭者中表現出色。” 與(Nvidia)V100(GPU)相比,他們的A100效果驚人,證明了其增強的Tensor核心架構的價值。我贊揚MLPerf添加了新的基準,這些基準越來越代表快速增長的推理機會,例如推薦引擎。

2020-10-24 09:17:15 1995

1995 美國東部時間10月21日,全球倍受矚目的權威AI基準測試MLPerf公布今年的推理測試榜單,浪潮AI服務器NF5488A5一舉創造18項性能記錄,在數據中心AI推理性能上遙遙領先其他廠商產品。

2020-10-26 16:30:44 1709

1709

近日,在GTC China元腦生態技術論壇上,中科極限元、趨動科技、睿沿科技等元腦生態伙伴分享了多個場景下浪潮AI服務器NF5488A5的實測數據,結果表明浪潮NF5488A5大幅提升了智能語音、圖像識別等AI模型的訓練和推理性能,促進了產業AI解決方案的開發與應用。

2020-12-24 15:25:01 2123

2123

一個支持邊緣實時推理的姿態估計模型,其推理性能比OpenPose模型快9倍。

2021-06-25 11:55:52 1450

1450 ,其中的模型數量達數千個,日均調用服務達到千億級別。無量推薦系統,在模型訓練和推理都能夠進行海量Embedding和DNN模型的GPU計算,是目前業界領先的體系結構設計。 傳統推薦系統面臨挑戰 傳統推薦系統具有以下特點: 訓練是基于參數

2021-08-23 17:09:03 4486

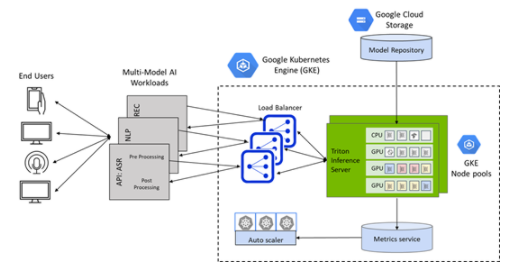

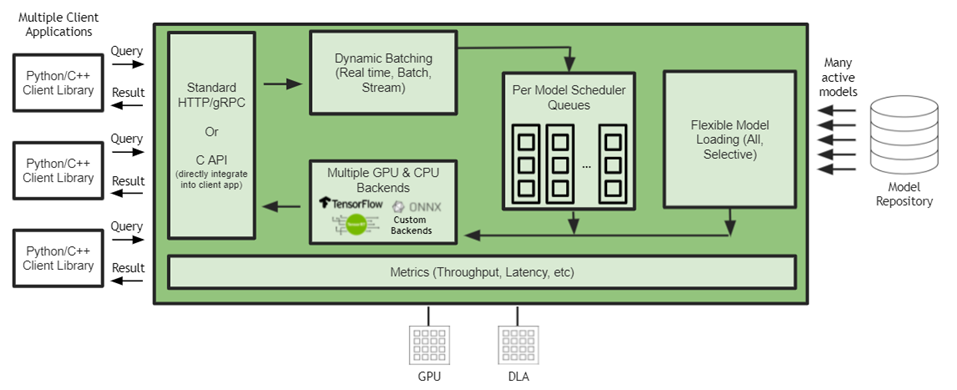

4486 Capital One、Microsoft、Samsung Medison、Siemens Energy、Snap等25000多家客戶都在使用該平臺。 這些更新包括開源NVIDIA Triton推理服務器

2021-11-12 14:42:53 1684

1684 西門子能源公司正在發揮 NVIDIA Triton 推理服務器的強大力量,利用 AI 協助解決全球發電廠在預測性服務管理方面的擔憂。

2021-11-16 16:25:31 3490

3490 Microsoft Teams借助AI生成的實時字幕和轉錄功能,幫助全球學生和職場人士順利進行在線會議。用于訓練的NVIDIA AI計算技術和用于推理語音識別模型的NVIDIA Triton推理服務器進一步提升了這兩個功能。

2022-01-04 14:20:11 1407

1407 Microsoft Teams借助AI生成的實時字幕和轉錄功能,幫助全球學生和職場人士順利進行在線會議。用于訓練的NVIDIA AI計算技術和用于推理語音識別模型的NVIDIA Triton推理服務器進一步提升了這兩個功能。

2022-01-04 17:45:12 1472

1472 能力。 一、GPU服務器處理性能和用例: 1、GPU 用例 雖然投資 GPU 服務器的原因過于廣泛,無法在一篇文章中涵蓋,但我們已經概述了我們在過去幾年中看到的最喜歡的用例。 2、3D處理 GPU 服務器非常適合 2D 和 3D 計算以及渲染 3D 圖形和 GPU 技術,以至于

2022-02-22 16:44:04 1434

1434 NVIDIA Grace CPU是首款面向AI基礎設施和高性能計算的基于Arm Neoverse的數據中心專屬CPU,是當今領先服務器芯片內存帶寬和能效的兩倍。

2022-03-30 14:11:31 1489

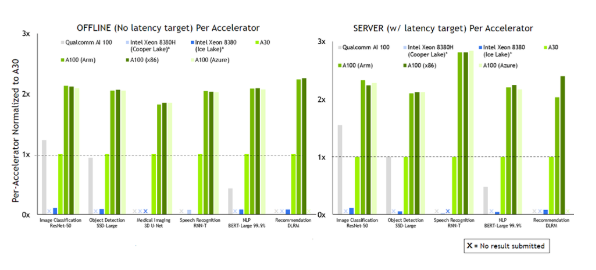

1489 在首次參加行業 MLPerf 基準測試時,基于 NVIDIA Ampere 架構的低功耗系統級芯片 NVIDIA Orin 就創造了新的AI推理性能紀錄,并在邊緣提升每個加速器的性能。

2022-04-08 10:14:44 4200

4200

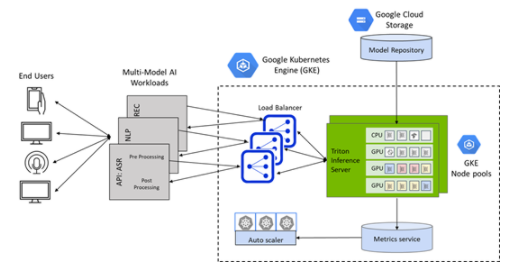

GKE 的 Triton 推理服務器應用程序是一個 helm chart 部署程序,可自動安裝和配置 Triton ,以便在具有 NVIDIA GPU 節點池的 GKE 集群上使用,包括

2022-04-08 16:43:03 1855

1855

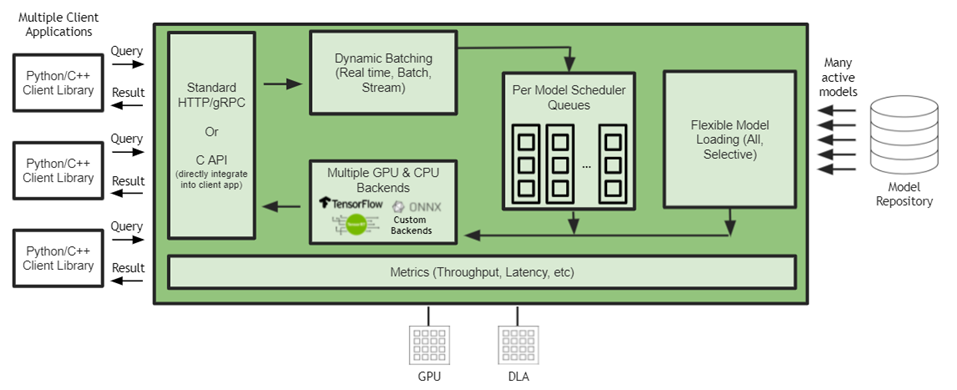

NVIDIA Triton 有助于在每個數據中心、云和嵌入式設備中實現標準化的可擴展生產 AI 。它支持多個框架,在 GPU 和 DLA 等多個計算引擎上運行模型,處理不同類型的推理查詢。通過與 NVIDIA JetPack 的集成, NVIDIA Triton 可用于嵌入式應用。

2022-04-18 15:40:02 2306

2306

網易互娛 AI Lab 的研發人員,基于 Wenet 語音識別工具進行優化和創新,利用 NVIDIA Triton 推理服務器的 GPU Batch Inference 機制加速了語音識別的速度,并且降低了成本。

2022-05-13 10:40:19 1481

1481 最新的 AI 推理基準顯然具有重要意義,因為它是目前可用的最接近真實世界 AI 推理性能的衡量標準。但隨著它的成熟和吸引更多的提交,它也將成為成功部署技術堆棧的晴雨表和新實施的試驗場。

2022-07-08 15:37:55 1246

1246

騰訊云 TI 平臺 TI-ONE 利用 NVIDIA Triton 推理服務器構造高性能推理服務部署平臺,使用戶能夠非常便捷地部署包括 TNN 模型在內的多種深度學習框架下獲得的 AI 模型,并且顯著提升推理服務的吞吐、提升 GPU 利用率。

2022-09-05 15:33:01 1419

1419 螞蟻鏈 AIoT 團隊與 NVIDIA 合作,將量化感知訓練(QAT)技術應用于深度學習模型性能優化中,并通過 NVIDIA TensorRT 高性能推理 SDK 進行高效率部署, 通過 INT8 推理, 吞吐量提升了 3 倍, 助力螞蟻鏈版權 AI 平臺中的模型推理服務大幅降本增效。

2022-09-09 09:53:52 872

872 推理識別是人工智能最重要的落地應用,其他與深度學習相關的數據收集、標注、模型訓練等工作,都是為了得到更好的最終推理性能與效果。

2022-10-26 09:43:57 1370

1370 、NVIDIA 的技術專家將帶來 AI Infra 、 推理引擎 相關的專題分享,包括目前各企業面臨的模型推理挑戰、Triton 的應用及落地的具體方案等,現身說法,干貨十足。此外,還有來自

2023-02-15 16:10:05 207

207 AI推理性能對比 / Ampere 從性能對比上,我們可以看出AmpereOne在AI推理負載上的領先,比如在生成式AI和推薦算法上,AmpereOne的單機架性能是AMD EYPC 9654 Genoa的兩倍或以上,但兩者卻有著近乎相同的系統功耗,AmpereOne的優勢在此展現得一覽無余。

2023-06-13 15:03:51 789

789

AI 服務器確實是整個服務器市場的一部分,但它們是專門為基于云的 AI 模型訓練或推理而設計的。在規格方面,廣義的AI服務器是指搭載AI芯片(如前面提到的GPU、FPGA、ASIC)的服務器,而狹義的定義則包括至少搭載一塊GPU的服務器。

2023-06-21 12:40:02 1208

1208 使用集成模型在 NVIDIA Triton 推理服務器上為 ML 模型管道提供服務

2023-07-05 16:30:34 1082

1082

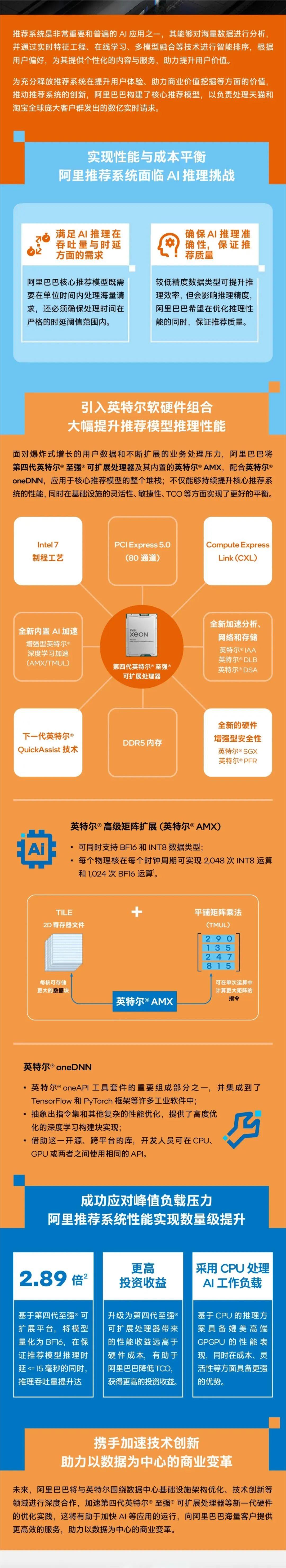

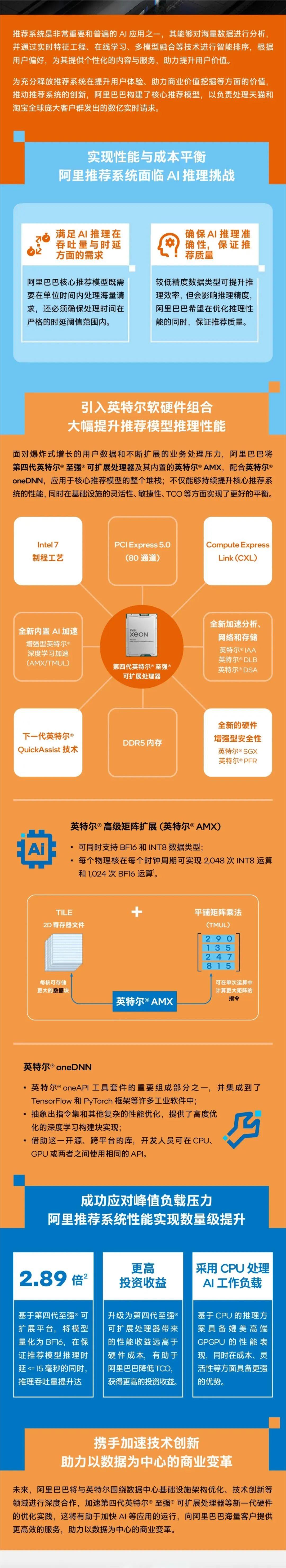

達沃斯論壇|英特爾王銳:AI驅動工業元宇宙,釋放數實融合無窮潛力 英特爾研究院發布全新AI擴散模型,可根據文本提示生成360度全景圖 英特爾內部代工模式的最新進展 原文標題:英特爾? AMX 加速AI推理性能,助阿里電商推薦系統成功應對峰值負載

2023-07-08 14:15:03 294

294

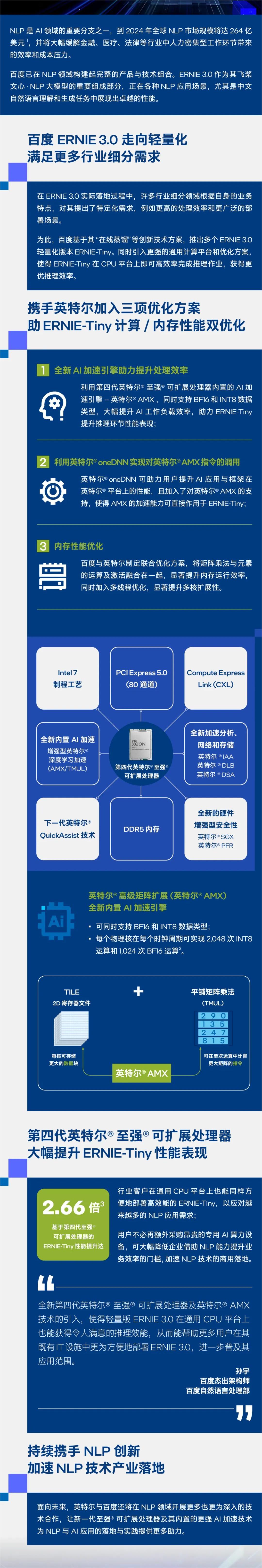

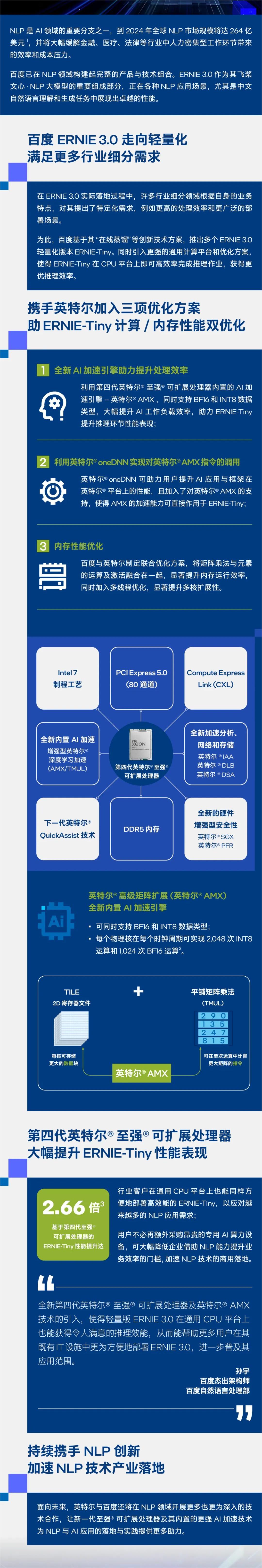

科技賦能千行百業 人民網攜手英特爾啟動“數智加速度”計劃 WAIC 2023:英特爾以技術之力推動邊緣人工智能發展,打造數字化未來“芯”時代 英特爾 AMX 加速AI推理性能,助阿里電商推薦系統成功應對峰值負載壓力 原文標題:英特爾? AMX 助力百度ERNIE-T

2023-07-14 20:10:05 245

245

with NVIDIA 拉斯維加斯 — VMware Explore — 太平洋時間 2023 年 8 月 22 日 — NVIDIA 宣布,全球領先的系統制造商將推出 AI 就緒型服務器,其支持同發布的 VMware

2023-08-23 19:10:09 350

350 英特爾產品在全新MLCommons AI推理性能測試中盡顯優勢 今日,MLCommons公布針對 60 億參數大語言模型及計算機視覺與自然語言處理模型GPT-J的 MLPerf推理v3.1 性能基準

2023-09-12 17:54:32 200

200

超級芯片 首次亮相 MLPerf 行業基準測試,其運行了所有數據中心推理測試,進一步擴大了 NVIDIA H100 Tensor Core GPU 的領先優勢。 總體測試結果表明,NVIDIA AI

2023-09-12 20:40:04 249

249 Hopper超級芯片首次亮相 MLPerf 行業基準測試,其運行了所有數據中心推理測試,進一步擴大了NVIDIA H100 Tensor Core GPU的領先優勢。 ? 總體測試結果表明,NVIDIA AI

2023-09-13 09:45:40 139

139

加利福尼亞州圣克拉拉——Nvidia通過一個名為TensorRT LLM的新開源軟件庫,將其H100、A100和L4 GPU的大型語言模型(LLM)推理性能提高了一倍。 正如對相同硬件一輪又一輪改進

2023-10-23 16:10:19 284

284 ,使用 NVIDIA Triton TM? 推理服務器進行端到端部署 LLM Serving,以及金融行業的 AI、NLP/LLM 應用場景、客戶案例。 通過本次活動,您將了解基于上述產品的 LLM

2023-10-26 09:05:02 174

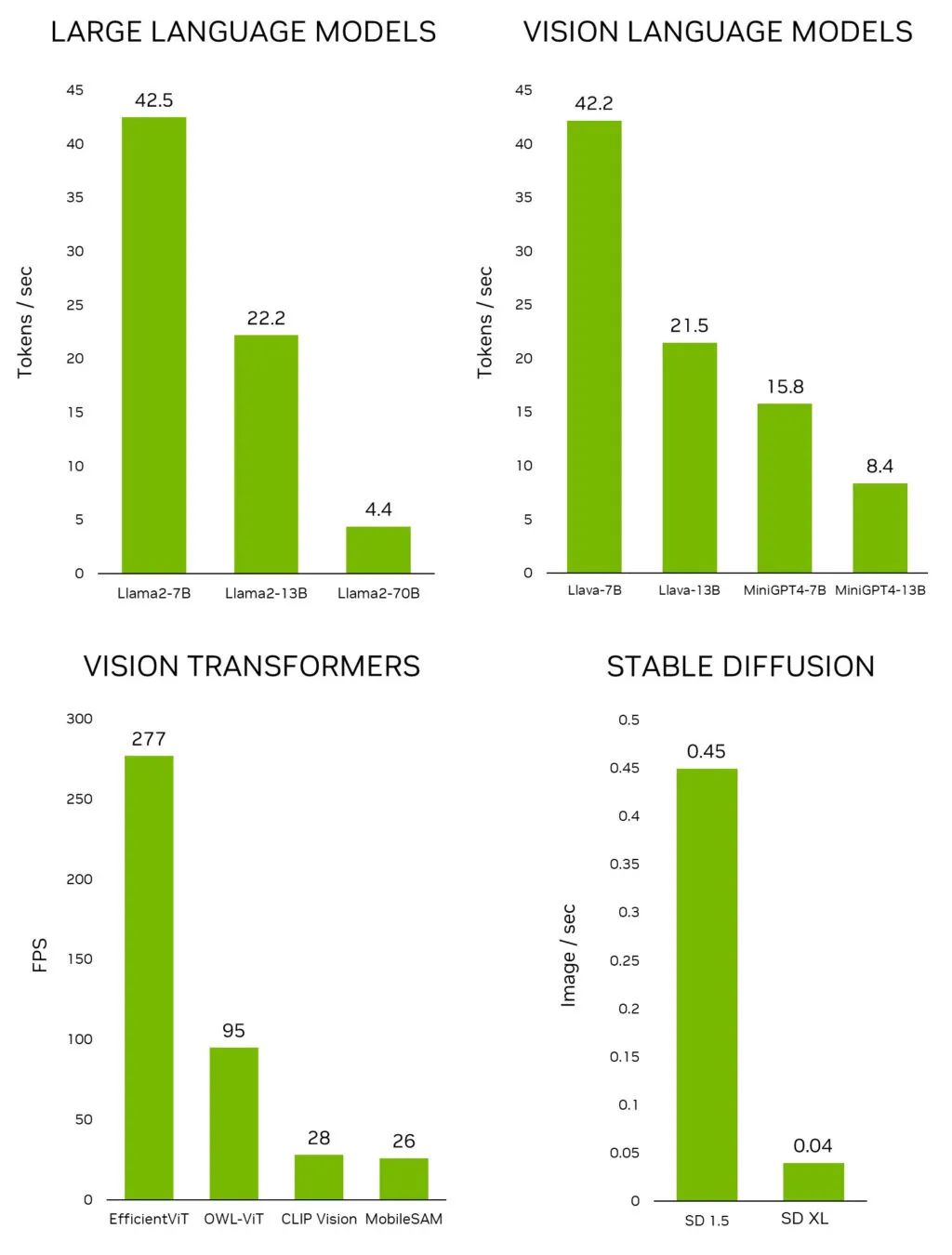

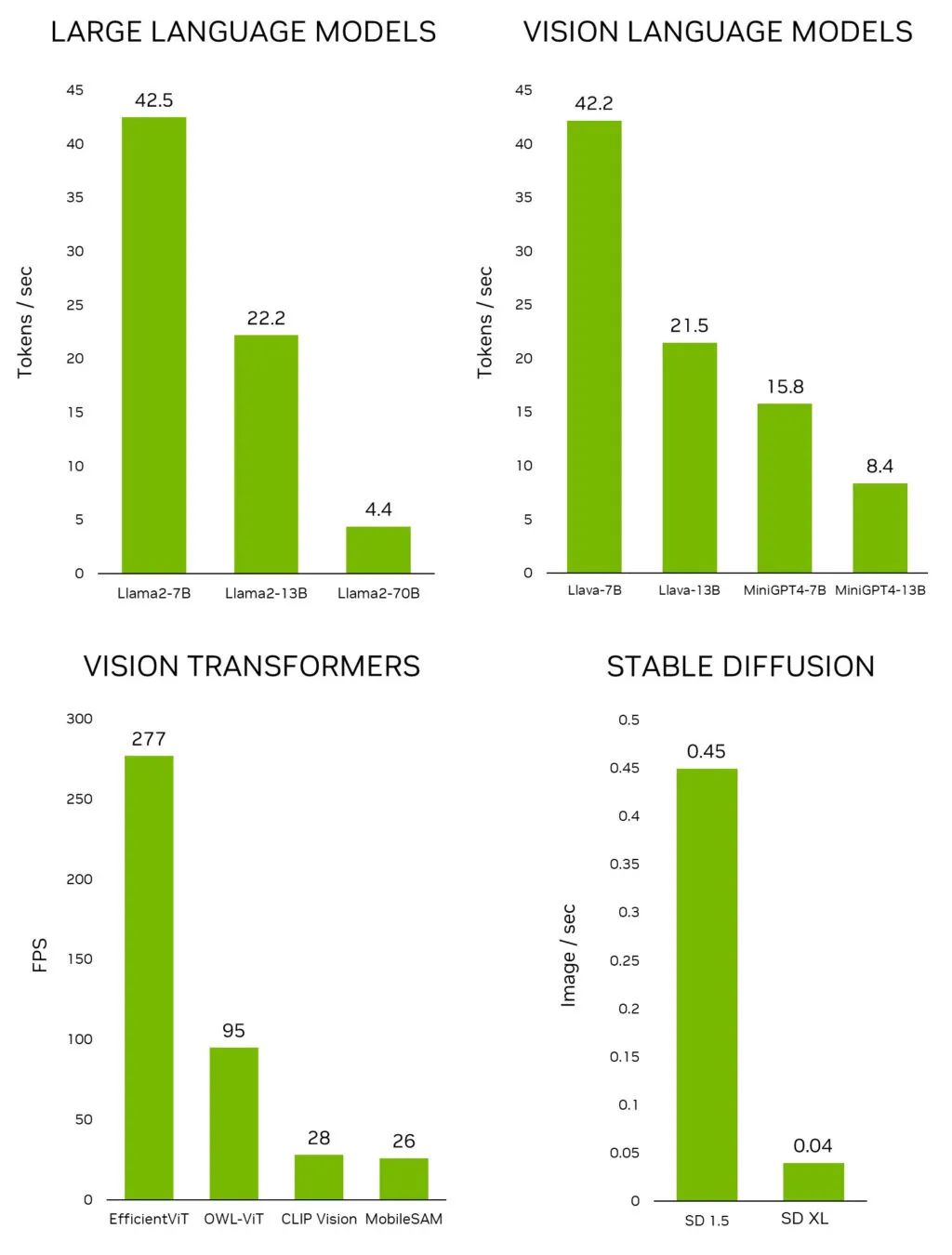

174 上以交互速率運行的 Llama-2-70B 模型。 圖 1. 領先的生成式 AI 模型在? Jetson AGX Orin 上的推理性能 如要在 Jetson 上快速測試最新的模型和應用,請使用 Jetson 生成式 AI 實驗室提供的教程和資源。

2023-11-07 21:25:01 398

398

Tensor Core GPU 和領先的顯存配置,可處理生成式 AI 與高性能計算工作負載的海量數據。 ? NVIDIA H200 是首款采用 HBM3e 的 GPU,其運行更快、更大的顯存容量將進一步加速生成式 AI 與大語言模型,同時

2023-11-14 14:30:01 85

85

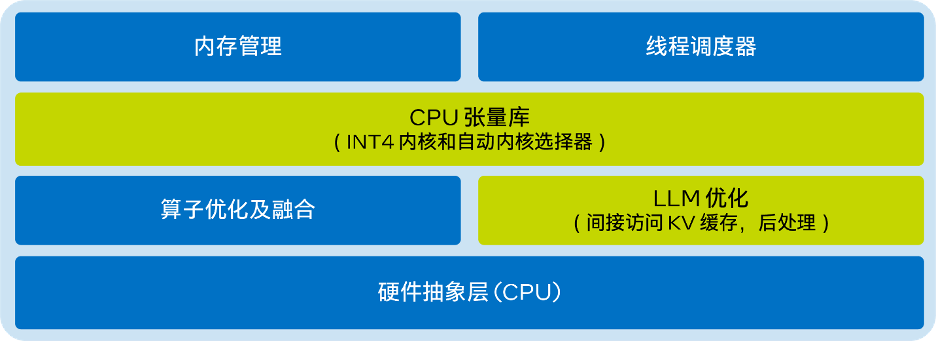

作者: 英特爾公司 沈海豪、羅嶼、孟恒宇、董波、林俊 編者按: 只需不到9行代碼, 就能在CPU上實現出色的LLM推理性能。 英特爾 ?Extension for Transformer 創新

2023-12-01 20:40:03 552

552

那么,什么是Torch TensorRT呢?Torch是我們大家聚在一起的原因,它是一個端到端的機器學習框架。而TensorRT則是NVIDIA的高性能深度學習推理軟件工具包。Torch TensorRT就是這兩者的結合。

2024-01-09 16:41:51 286

286

這家云計算巨頭的計算機視覺和數據科學服務使用 NVIDIA Triton 推理服務器來加速 AI 預測。

2024-02-29 14:04:40 162

162

電子發燒友App

電子發燒友App

評論