使用Isaac Gym來強化學(xué)習(xí)mycobot抓取任務(wù)

2023-04-11 14:57:12 5344

5344

什么是深度強化學(xué)習(xí)? 眾所周知,人類擅長解決各種挑戰(zhàn)性的問題,從低級的運動控制(如:步行、跑步、打網(wǎng)球)到高級的認知任務(wù)。

2023-07-01 10:29:50 1002

1002

Facebook近日推出ReAgent強化學(xué)習(xí)(reinforcement learning)工具包,首次通過收集離線反饋(offline feedback)來實現(xiàn)策略評估(policy evaluation)。

2019-10-19 09:38:41 1347

1347 一:深度學(xué)習(xí)DeepLearning實戰(zhàn)時間地點:1 月 15日— 1 月18 日二:深度強化學(xué)習(xí)核心技術(shù)實戰(zhàn)時間地點: 1 月 27 日— 1 月30 日(第一天報到 授課三天;提前環(huán)境部署 電腦

2021-01-09 17:01:54

利用ML構(gòu)建無線環(huán)境地圖及其在無線通信中的應(yīng)用?使用深度學(xué)習(xí)的收發(fā)機設(shè)計和信道解碼基于ML的混合學(xué)習(xí)方法,用于信道估計、建模、預(yù)測和壓縮 使用自動編碼器等ML技術(shù)的端到端通信?無線電資源管理深度強化學(xué)習(xí)

2021-07-01 10:49:03

深度學(xué)習(xí)常用模型有哪些?深度學(xué)習(xí)常用軟件工具及平臺有哪些?深度學(xué)習(xí)存在哪些問題?

2021-10-14 08:20:47

時間安排大綱具體內(nèi)容實操案例三天關(guān)鍵點1.強化學(xué)習(xí)的發(fā)展歷程2.馬爾可夫決策過程3.動態(tài)規(guī)劃4.無模型預(yù)測學(xué)習(xí)5.無模型控制學(xué)習(xí)6.價值函數(shù)逼近7.策略梯度方法8.深度強化學(xué)習(xí)-DQN算法系列9.

2022-04-21 14:57:39

一:深度學(xué)習(xí)DeepLearning實戰(zhàn)時間地點:1 月 15日— 1 月18 日二:深度強化學(xué)習(xí)核心技術(shù)實戰(zhàn)時間地點: 1 月 27 日— 1 月30 日(第一天報到 授課三天;提前環(huán)境部署 電腦

2021-01-10 13:42:26

,Deep Learning—遷移學(xué)習(xí)5,Deep Learning—深度強化學(xué)習(xí)6,深度學(xué)習(xí)的常用模型或者方法深度學(xué)習(xí)交流大群: 372526178 (資料共享,加群備注楊春嬌邀請)

2018-09-05 10:22:34

不斷變化的,因此深度學(xué)習(xí)是人工智能AI的重要組成部分。可以說人腦視覺系統(tǒng)和神經(jīng)網(wǎng)絡(luò)。2、目標(biāo)檢測、目標(biāo)跟蹤、圖像增強、強化學(xué)習(xí)、模型壓縮、視頻理解、人臉技術(shù)、三維視覺、SLAM、GAN、GNN等。

2020-11-27 11:54:42

方向參考摘要強化學(xué)習(xí)算法已經(jīng)存在了幾十年,并被用于解決各種順序決策問題。然而,這些算法在處理高維環(huán)境時卻面臨著巨大的挑戰(zhàn)。深度學(xué)習(xí)的最新發(fā)展使RL方法能夠為復(fù)雜和有能力的智能體驅(qū)動最佳策略,這可以在這

2021-07-12 08:44:43

強化學(xué)習(xí)的另一種策略(二)

2019-04-03 12:10:44

如何訓(xùn)練AI玩飛機大戰(zhàn)游戲(創(chuàng)號版)

2019-07-01 12:27:34

強化學(xué)習(xí)在RoboCup帶球任務(wù)中的應(yīng)用_劉飛

2017-03-14 08:00:00 0

0 界聲譽卓著。在此前接受CSDN采訪時,楊強介紹了他目前的主要工作致力于一個將深度學(xué)習(xí)、強化學(xué)習(xí)和遷移學(xué)習(xí)有機結(jié)合的Reinforcement Transfer Learning(RTL)體系的研究。那么,這個技術(shù)框架對工業(yè)界的實際應(yīng)用有什么用的實際意義?在本文中,CSDN結(jié)合楊強的另外一個身份國內(nèi)人工智能創(chuàng)業(yè)

2017-10-09 18:23:18 0

0 請訂閱2016年《程序員》 盡管監(jiān)督式和非監(jiān)督式學(xué)習(xí)的深度模型已經(jīng)廣泛被技術(shù)社區(qū)所采用,深度強化學(xué)習(xí)仍舊顯得有些神秘。這篇文章將試圖揭秘

2017-10-09 18:28:43 0

0 深度強化學(xué)習(xí)DRL自提出以來, 已在理論和應(yīng)用方面均取得了顯著的成果。尤其是谷歌DeepMind團隊基于深度強化學(xué)習(xí)DRL研發(fā)的AlphaGo,將深度強化學(xué)習(xí)DRL成推上新的熱點和高度,成為人工智能歷史上一個新的里程碑。因此,深度強化學(xué)習(xí)DRL非常值得研究。

2018-06-29 18:36:00 27596

27596 薩頓在專訪中(再次)科普了強化學(xué)習(xí)、深度強化學(xué)習(xí),并談到了這項技術(shù)的潛力,以及接下來的發(fā)展方向:預(yù)測學(xué)習(xí)

2017-12-27 09:07:15 10857

10857 針對路徑規(guī)劃算法收斂速度慢及效率低的問題,提出了一種基于分層強化學(xué)習(xí)及人工勢場的多Agent路徑規(guī)劃算法。首先,將多Agent的運行環(huán)境虛擬為一個人工勢能場,根據(jù)先驗知識確定每點的勢能值,它代表最優(yōu)

2017-12-27 14:32:02 0

0 本文提出了一種LCS和LS-SVM相結(jié)合的多機器人強化學(xué)習(xí)方法,LS-SVM獲得的最優(yōu)學(xué)習(xí)策略作為LCS的初始規(guī)則集。LCS通過與環(huán)境的交互,能更快發(fā)現(xiàn)指導(dǎo)多機器人強化學(xué)習(xí)的規(guī)則,為強化學(xué)習(xí)系統(tǒng)

2018-01-09 14:43:49 0

0 在風(fēng)儲配置給定前提下,研究風(fēng)電與儲能系統(tǒng)如何有機合作的問題。核心在于風(fēng)電與儲能組成混合系統(tǒng)參與電力交易,通過合作提升其市場競爭的能力。針對現(xiàn)有研究的不足,在具有過程化樣本的前提下,引入強化學(xué)習(xí)算法

2018-01-27 10:20:50 2

2 傳統(tǒng)上,強化學(xué)習(xí)在人工智能領(lǐng)域占據(jù)著一個合適的地位。但強化學(xué)習(xí)在過去幾年已開始在很多人工智能計劃中發(fā)揮更大的作用。

2018-03-03 14:16:56 3924

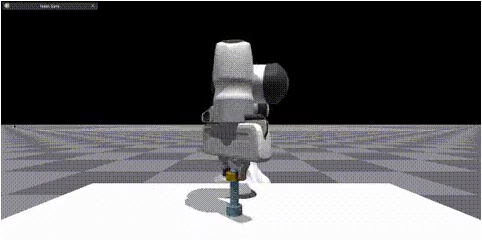

3924 讓我們在強化學(xué)習(xí)社區(qū)感興趣的問題上應(yīng)用隨機搜索。深度強化學(xué)習(xí)領(lǐng)域一直把大量時間和精力用于由OpenAI維護的、基于MuJoCo模擬器的一套基準(zhǔn)測試中。這里,最優(yōu)控制問題指的是讓一個有腿機器人

2018-04-01 09:35:00 4193

4193

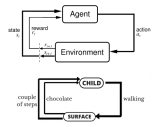

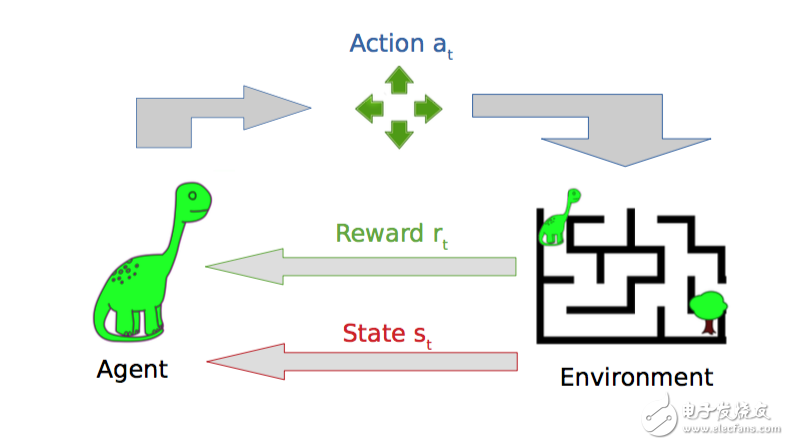

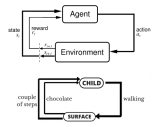

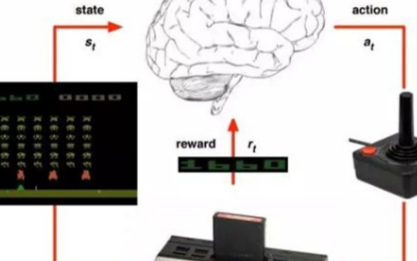

強化學(xué)習(xí)是智能系統(tǒng)從環(huán)境到行為映射的學(xué)習(xí),以使獎勵信號(強化信號)函數(shù)值最大,強化學(xué)習(xí)不同于連接主義學(xué)習(xí)中的監(jiān)督學(xué)習(xí),主要表現(xiàn)在教師信號上,強化學(xué)習(xí)中由環(huán)境提供的強化信號是對產(chǎn)生動作的好壞作一種評價

2018-05-30 06:53:00 1234

1234 當(dāng)我們使用虛擬的計算機屏幕和隨機選擇的圖像來模擬一個非常相似的測試時,我們發(fā)現(xiàn),我們的“元強化學(xué)習(xí)智能體”(meta-RL agent)似乎是以類似于Harlow實驗中的動物的方式在學(xué)習(xí),甚至在被顯示以前從未見過的全新圖像時也是如此。

2018-05-16 09:03:39 4475

4475

自動駕駛汽車首先是人工智能問題,而強化學(xué)習(xí)是機器學(xué)習(xí)的一個重要分支,是多學(xué)科多領(lǐng)域交叉的一個產(chǎn)物。今天人工智能頭條給大家介紹強化學(xué)習(xí)在自動駕駛的一個應(yīng)用案例,無需3D地圖也無需規(guī)則,讓汽車從零開始在二十分鐘內(nèi)學(xué)會自動駕駛。

2018-07-10 09:00:29 4676

4676

前段時間,OpenAI的游戲機器人在Dota2的比賽中贏了人類的5人小組,取得了團隊勝利,是強化學(xué)習(xí)攻克的又一游戲里程碑。

2018-07-13 08:56:01 4439

4439

強化學(xué)習(xí)是人工智能基本的子領(lǐng)域之一,在強化學(xué)習(xí)的框架中,智能體通過與環(huán)境互動,來學(xué)習(xí)采取何種動作能使其在給定環(huán)境中的長期獎勵最大化,就像在上述的棋盤游戲寓言中,你通過與棋盤的互動來學(xué)習(xí)。

2018-07-15 10:56:37 17106

17106

這些具有一定難度的任務(wù) OpenAI 自己也在研究,他們認為這是深度強化學(xué)習(xí)發(fā)展到新時代之后可以作為新標(biāo)桿的算法測試任務(wù),而且也歡迎其它機構(gòu)與學(xué)校的研究人員一同研究這些任務(wù),把深度強化學(xué)習(xí)的表現(xiàn)推上新的臺階。

2018-08-03 14:27:26 4305

4305 結(jié)合 DL 與 RL 的深度強化學(xué)習(xí)(Deep Reinforcement Learning, DRL)迅速成為人工智能界的焦點。

2018-08-09 10:12:43 5789

5789 深度強化學(xué)習(xí)的理論、自動駕駛技術(shù)的現(xiàn)狀以及問題、深度強化學(xué)習(xí)在自動駕駛技術(shù)當(dāng)中的應(yīng)用及基于深度強化學(xué)習(xí)的禮讓自動駕駛研究。

2018-08-18 10:19:57 4854

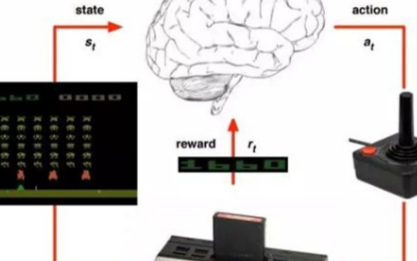

4854 強化學(xué)習(xí)作為一種常用的訓(xùn)練智能體的方法,能夠完成很多復(fù)雜的任務(wù)。在強化學(xué)習(xí)中,智能體的策略是通過將獎勵函數(shù)最大化訓(xùn)練的。獎勵在智能體之外,各個環(huán)境中的獎勵各不相同。深度學(xué)習(xí)的成功大多是有密集并且有效的獎勵函數(shù),例如電子游戲中不斷增加的“分數(shù)”。

2018-08-18 11:38:57 3362

3362 而這時,強化學(xué)習(xí)會在沒有任何標(biāo)簽的情況下,通過先嘗試做出一些行為得到一個結(jié)果,通過這個結(jié)果是對還是錯的反饋,調(diào)整之前的行為,就這樣不斷的調(diào)整,算法能夠學(xué)習(xí)到在什么樣的情況下選擇什么樣的行為可以得到最好的結(jié)果。

2018-08-21 09:18:25 19123

19123

強化學(xué)習(xí)(RL)研究在過去幾年取得了許多重大進展。強化學(xué)習(xí)的進步使得 AI 智能體能夠在一些游戲上超過人類,值得關(guān)注的例子包括 DeepMind 攻破 Atari 游戲的 DQN,在圍棋中獲得矚目的 AlphaGo 和 AlphaGo Zero,以及在 Dota2 對戰(zhàn)人類職業(yè)玩家的Open AI Five。

2018-08-31 09:20:49 3498

3498 強化學(xué)習(xí)是一種非常重要 AI 技術(shù),它能使用獎勵(或懲罰)來驅(qū)動智能體(agents)朝著特定目標(biāo)前進,比如它訓(xùn)練的 AI 系統(tǒng) AlphaGo 擊敗了頂尖圍棋選手,它也是 DeepMind 的深度

2018-09-03 14:06:30 2653

2653 直接的強化學(xué)習(xí)方法很有吸引力,它無需過多假設(shè),而且能自動掌握很多技能。由于這種方法除了建立函數(shù)無需其他信息,所以很容易在改進后的環(huán)境中重新學(xué)習(xí)技能,例如更換了目標(biāo)物體或機械手。

2018-09-05 08:54:15 9616

9616 強化學(xué)習(xí)是一種訓(xùn)練主體最大化獎勵的學(xué)習(xí)機制,對于目標(biāo)條件下的強化學(xué)習(xí)來說可以將獎勵函數(shù)設(shè)為當(dāng)前狀態(tài)與目標(biāo)狀態(tài)之間距離的反比函數(shù),那么最大化獎勵就對應(yīng)著最小化與目標(biāo)函數(shù)的距離。

2018-09-24 10:11:00 6779

6779 按照以往的做法,如果研究人員要用強化學(xué)習(xí)算法對獎勵進行剪枝,以此克服獎勵范圍各不相同的問題,他們首先會把大的獎勵設(shè)為+1,小的獎勵為-1,然后對預(yù)期獎勵做歸一化處理。雖然這種做法易于學(xué)習(xí),但它也改變了智能體的目標(biāo)。

2018-09-16 09:32:03 5336

5336 之前接觸的強化學(xué)習(xí)算法都是單個智能體的強化學(xué)習(xí)算法,但是也有很多重要的應(yīng)用場景牽涉到多個智能體之間的交互。

2018-11-02 16:18:15 21016

21016 本文作者通過簡單的方式構(gòu)建了強化學(xué)習(xí)模型來訓(xùn)練無人車算法,可以為初學(xué)者提供快速入門的經(jīng)驗。

2018-11-12 14:47:39 4570

4570 針對提高視覺圖像特征與優(yōu)化控制之間契合度的問題,本文提出一種基于深度強化學(xué)習(xí)的機械臂視覺抓取控制優(yōu)化方法,可以自主地從與環(huán)境交互產(chǎn)生的視覺圖像中不斷學(xué)習(xí)特征提取,直接地將提取的特征應(yīng)用于機械臂抓取

2018-12-19 15:23:59 22

22 OpenAI 近期發(fā)布了一個新的訓(xùn)練環(huán)境 CoinRun,它提供了一個度量智能體將其學(xué)習(xí)經(jīng)驗活學(xué)活用到新情況的能力指標(biāo),而且還可以解決一項長期存在于強化學(xué)習(xí)中的疑難問題——即使是廣受贊譽的強化算法在訓(xùn)練過程中也總是沒有運用監(jiān)督學(xué)習(xí)的技術(shù)。

2019-01-01 09:22:00 2122

2122

強化學(xué)習(xí)(RL)能通過獎勵或懲罰使智能體實現(xiàn)目標(biāo),并將它們學(xué)習(xí)到的經(jīng)驗轉(zhuǎn)移到新環(huán)境中。

2018-12-24 09:29:56 2949

2949 了一種人工智能系統(tǒng),即通過深度強化學(xué)習(xí)來學(xué)習(xí)走路,簡單來說,就是教“一個四足機器人來穿越熟悉和不熟悉的地形”。

2019-01-03 09:50:13 3286

3286 針對深度強化學(xué)習(xí)中卷積神經(jīng)網(wǎng)絡(luò)(CNN)層數(shù)過深導(dǎo)致的梯度消失問題,提出一種將密集連接卷積網(wǎng)絡(luò)應(yīng)用于強化學(xué)習(xí)的方法。首先,利用密集連接卷積網(wǎng)絡(luò)中的跨層連接結(jié)構(gòu)進行圖像特征的有效提取;然后,在密集連接

2019-01-23 10:41:51 3

3 在一些情況下,我們會用策略函數(shù)(policy, 總得分,也就是搭建的網(wǎng)絡(luò)在測試集上的精度(accuracy),通過強化學(xué)習(xí)(Reinforcement Learning)這種通用黑盒算法來優(yōu)化。然而,因為強化學(xué)習(xí)本身具有數(shù)據(jù)利用率低的特點,這個優(yōu)化的過程往往需要大量的計算資源。

2019-01-28 09:54:22 4705

4705 Google AI 與 DeepMind 合作推出深度規(guī)劃網(wǎng)絡(luò) (PlaNet),這是一個純粹基于模型的智能體,能從圖像輸入中學(xué)習(xí)世界模型,完成多項規(guī)劃任務(wù),數(shù)據(jù)效率平均提升50倍,強化學(xué)習(xí)又一突破。

2019-02-17 09:30:28 3036

3036

在傳統(tǒng)的多智體學(xué)習(xí)過程當(dāng)中,有研究者在對其他智能體建模 (也即“對手建模”, opponent modeling) 時使用了遞歸推理,但由于算法復(fù)雜和計算力所限,目前還尚未有人在多智體深度強化學(xué)習(xí) (Multi-Agent Deep Reinforcement Learning) 的對手建模中使用遞歸推理。

2019-03-05 08:52:43 4556

4556 ANYMAL與被植入了硬性程序的機器人不同,在深度強化學(xué)習(xí)的加持下,ANYMAL具有自我學(xué)習(xí)、自我升級的能力,因而能適應(yīng)更多場景。

2019-03-21 10:07:34 6510

6510 不可否認,深度學(xué)習(xí)的熱度已經(jīng)大大下降,贊美深度學(xué)習(xí)作為AI終極算法的推文少得多了,而且論文正在變得不那么“革命”,現(xiàn)在大家換了個詞,叫:進化。

2019-04-29 08:56:20 3218

3218 近日,Reddit一位網(wǎng)友根據(jù)近期OpenAI Five、AlphaStar的表現(xiàn),提出“深度強化學(xué)習(xí)是否已經(jīng)到達盡頭”的問題。

2019-05-10 16:34:59 2313

2313 近年來,深度強化學(xué)習(xí)(Deep reinforcement learning)方法在人工智能方面取得了矚目的成就,從 Atari 游戲、到圍棋、再到無限制撲克等領(lǐng)域,AI 的表現(xiàn)都大大超越了專業(yè)選手,這一進展引起了眾多認知科學(xué)家的關(guān)注。

2019-05-30 17:29:35 2550

2550

近年來,深度強化學(xué)習(xí)(Deep reinforcement learning)方法在人工智能方面取得了矚目的成就

2019-06-03 14:36:05 2619

2619 在谷歌最新的論文中,研究人員提出了“非政策強化學(xué)習(xí)”算法OPC,它是強化學(xué)習(xí)的一種變體,它能夠評估哪種機器學(xué)習(xí)模型將產(chǎn)生最好的結(jié)果。數(shù)據(jù)顯示,OPC比基線機器學(xué)習(xí)算法有著顯著的提高,更加穩(wěn)健可靠。

2019-06-22 11:17:08 3374

3374 深度學(xué)習(xí)也增強了強化學(xué)習(xí)這一已存在的領(lǐng)域。

2019-07-11 16:06:46 1464

1464 所以,Google這兩篇強化學(xué)習(xí)應(yīng)用于YouTube推薦論文的出現(xiàn)給大家?guī)砹吮容^振奮人心的希望。首先,論文中宣稱效果對比使用的Baseline就是YouTube推薦線上最新的深度學(xué)習(xí)模型;

2019-07-18 11:11:00 8388

8388

近幾年來,強化學(xué)習(xí)在任務(wù)導(dǎo)向型對話系統(tǒng)中得到了廣泛的應(yīng)用,對話系統(tǒng)通常被統(tǒng)計建模成為一個 馬爾科夫決策過程(Markov Decision Process)模型,通過隨機優(yōu)化的方法來學(xué)習(xí)對話策略。

2019-08-06 14:16:29 1836

1836 深度學(xué)習(xí)DL是機器學(xué)習(xí)中一種基于對數(shù)據(jù)進行表征學(xué)習(xí)的方法。深度學(xué)習(xí)DL有監(jiān)督和非監(jiān)督之分,都已經(jīng)得到廣泛的研究和應(yīng)用。

2020-01-30 09:53:00 5546

5546

強化學(xué)習(xí)非常適合實現(xiàn)自主決策,相比之下監(jiān)督學(xué)習(xí)與無監(jiān)督學(xué)習(xí)技術(shù)則無法獨立完成此項工作。

2019-12-10 14:34:57 1092

1092 深度學(xué)習(xí)DL是機器學(xué)習(xí)中一種基于對數(shù)據(jù)進行表征學(xué)習(xí)的方法。深度學(xué)習(xí)DL有監(jiān)督和非監(jiān)督之分,都已經(jīng)得到廣泛的研究和應(yīng)用。

2020-01-24 10:46:00 4734

4734 惰性是人類的天性,然而惰性能讓人類無需過于復(fù)雜的練習(xí)就能學(xué)習(xí)某項技能,對于人工智能而言,是否可有基于惰性的快速學(xué)習(xí)的方法?本文提出一種懶惰強化學(xué)習(xí)(Lazy reinforcement learning, LRL) 算法。

2020-01-16 17:40:00 745

745 本文檔的主要內(nèi)容詳細介紹的是深度強化學(xué)習(xí)的筆記資料免費下載。

2020-03-10 08:00:00 0

0 )的研究人員聯(lián)合發(fā)表了一篇論文,詳細介紹了他們構(gòu)建的一個通過 AI 技術(shù)自學(xué)走路的機器人。該機器人結(jié)合了深度學(xué)習(xí)和強化學(xué)習(xí)兩種不同類型的 AI 技術(shù),具備直接放置于真實環(huán)境中進行訓(xùn)練的條件。

2020-03-17 15:15:30 1354

1354 強化學(xué)習(xí)(RL)是現(xiàn)代人工智能領(lǐng)域中最熱門的研究主題之一,其普及度還在不斷增長。 讓我們看一下開始學(xué)習(xí)RL需要了解的5件事。

2020-05-04 18:14:00 3117

3117

深度學(xué)習(xí)DL是機器學(xué)習(xí)中一種基于對數(shù)據(jù)進行表征學(xué)習(xí)的方法。深度學(xué)習(xí)DL有監(jiān)督和非監(jiān)督之分,都已經(jīng)得到廣泛的研究和應(yīng)用。強化學(xué)習(xí)RL是通過對未知環(huán)境一邊探索一邊建立環(huán)境模型以及學(xué)習(xí)得到一個最優(yōu)策略。強化學(xué)習(xí)是機器學(xué)習(xí)中一種快速、高效且不可替代的學(xué)習(xí)算法。

2020-05-16 09:20:40 3150

3150 深度學(xué)習(xí)DL是機器學(xué)習(xí)中一種基于對數(shù)據(jù)進行表征學(xué)習(xí)的方法。深度學(xué)習(xí)DL有監(jiān)督和非監(jiān)督之分,都已經(jīng)得到廣泛的研究和應(yīng)用。強化學(xué)習(xí)RL是通過對未知環(huán)境一邊探索一邊建立環(huán)境模型以及學(xué)習(xí)得到一個最優(yōu)策略。強化學(xué)習(xí)是機器學(xué)習(xí)中一種快速、高效且不可替代的學(xué)習(xí)算法。

2020-06-13 11:39:40 5527

5527 近期,有不少報道強化學(xué)習(xí)算法在 GO、Dota 2 和 Starcraft 2 等一系列游戲中打敗了專業(yè)玩家的新聞。強化學(xué)習(xí)是一種機器學(xué)習(xí)類型,能夠在電子游戲、機器人、自動駕駛等復(fù)雜應(yīng)用中運用人工智能。

2020-07-27 08:50:15 715

715 Viet Nguyen就是其中一個。這位來自德國的程序員表示自己只玩到了第9個關(guān)卡。因此,他決定利用強化學(xué)習(xí)AI算法來幫他完成未通關(guān)的遺憾。

2020-07-29 09:30:16 2429

2429 訓(xùn)練最新 AI 系統(tǒng)需要驚人的計算資源,這意味著囊中羞澀的學(xué)術(shù)界實驗室很難趕上富有的科技公司。但一種新的方法可以讓科學(xué)家在單臺計算機上訓(xùn)練先機的 AI。2018 年 OpenAI 報告每 3.4 個月訓(xùn)練最強大 AI 所需的處理能力會翻一番,其中深度強化學(xué)習(xí)對處理尤為苛刻。

2020-07-29 09:45:38 581

581 不過,深度神經(jīng)網(wǎng)絡(luò)系統(tǒng)往往需要大量的訓(xùn)練數(shù)據(jù),以及已知答案的帶標(biāo)簽樣本,才能正常地工作。并且,它們目前尚無法完全模仿人類學(xué)習(xí)和運用智慧的方式。

2020-08-28 14:21:06 5743

5743

強化學(xué)習(xí)屬于機器學(xué)習(xí)中的一個子集,它使代理能夠理解在特定環(huán)境中執(zhí)行特定操作的相應(yīng)結(jié)果。目前,相當(dāng)一部分機器人就在使用強化學(xué)習(xí)掌握種種新能力。

2020-11-06 15:33:49 1552

1552 深度強化學(xué)習(xí)是深度學(xué)習(xí)與強化學(xué)習(xí)相結(jié)合的產(chǎn)物,它集成了深度學(xué)習(xí)在視覺等感知問題上強大的理解能力,以及強化學(xué)習(xí)的決策能力,實現(xiàn)了...

2020-12-10 18:32:50 374

374 RLax(發(fā)音為“ relax”)是建立在JAX之上的庫,它公開了用于實施強化學(xué)習(xí)智能體的有用構(gòu)建塊。。報道:深度強化學(xué)習(xí)實驗室作者:DeepRL ...

2020-12-10 18:43:23 499

499 本文主要介紹深度強化學(xué)習(xí)在任務(wù)型對話上的應(yīng)用,兩者的結(jié)合點主要是將深度強化學(xué)習(xí)應(yīng)用于任務(wù)型對話的策略學(xué)習(xí)上來源:騰訊技術(shù)工程微信號

2020-12-10 19:02:45 781

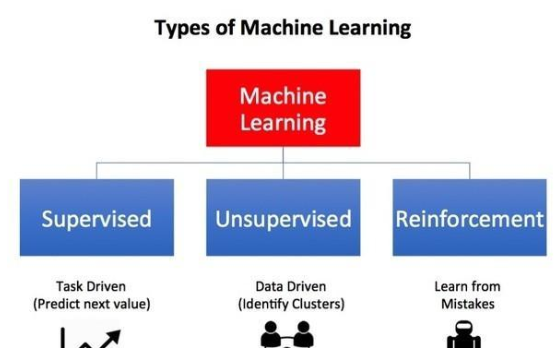

781 強化學(xué)習(xí)( Reinforcement learning,RL)作為機器學(xué)習(xí)領(lǐng)域中與監(jiān)督學(xué)習(xí)、無監(jiān)督學(xué)習(xí)并列的第三種學(xué)習(xí)范式,通過與環(huán)境進行交互來學(xué)習(xí),最終將累積收益最大化。常用的強化學(xué)習(xí)算法分為

2021-04-08 11:41:58 11

11 深度強化學(xué)習(xí)(DRL)作為機器學(xué)習(xí)的重要分攴,在 Alphago擊敗人類后受到了廣泛關(guān)注。DRL以種試錯機制與環(huán)境進行交互,并通過最大化累積獎賞最終得到最優(yōu)策略。強化學(xué)習(xí)可分為無模型強化學(xué)習(xí)和模型

2021-04-12 11:01:52 9

9 當(dāng)機器人遇見強化學(xué)習(xí),會碰出怎樣的火花? 一名叫 Cassie 的機器人,給出了生動演繹。 最近,24 歲的中國南昌小伙李鐘毓和其所在團隊,用強化學(xué)習(xí)教 Cassie 走路 ,目前它已學(xué)會蹲伏走路

2021-04-13 09:35:09 2164

2164

利用深度強化學(xué)習(xí)技術(shù)實現(xiàn)路口信號控制是智能交通領(lǐng)域的硏究熱點。現(xiàn)有硏究大多利用強化學(xué)習(xí)來全面刻畫交通狀態(tài)以及設(shè)計有效強化學(xué)習(xí)算法以解決信號配時問題,但這些研究往往忽略了信號燈狀態(tài)對動作選擇的影響以及

2021-04-23 15:30:53 21

21 目前壯語智能信息處理研究處于起步階段,缺乏自動詞性標(biāo)注方法。針對壯語標(biāo)注語料匱乏、人工標(biāo)注費時費力而機器標(biāo)注性能較差的現(xiàn)狀,提出一種基于強化學(xué)習(xí)的壯語詞性標(biāo)注方法。依據(jù)壯語的文法特點和中文賓州

2021-05-14 11:29:35 14

14 壓邊為改善板料拉深制造的成品質(zhì)量,釆用深度強化學(xué)習(xí)的方法進行拉深過程旳壓邊力優(yōu)化控制。提岀一種基于深度強化學(xué)習(xí)與有限元仿真集成的壓邊力控制模型,結(jié)合深度神經(jīng)網(wǎng)絡(luò)的感知能力與強化學(xué)習(xí)的決策能力,進行

2021-05-27 10:32:39 0

0 一種新型的多智能體深度強化學(xué)習(xí)算法

2021-06-23 10:42:47 36

36 基于深度強化學(xué)習(xí)的無人機控制律設(shè)計方法

2021-06-23 14:59:10 46

46 基于強化學(xué)習(xí)的虛擬場景角色乒乓球訓(xùn)練

2021-06-27 11:34:33 62

62 使用Matlab進行強化學(xué)習(xí)電子版資源下載

2021-07-16 11:17:09 0

0 多Agent 深度強化學(xué)習(xí)綜述 來源:《自動化學(xué)報》,作者梁星星等 摘 要?近年來,深度強化學(xué)習(xí)(Deep reinforcement learning,DRL) 在諸多復(fù)雜序貫決策問題中取得巨大

2022-01-18 10:08:01 1226

1226

本文主要內(nèi)容是如何用Oenflow去復(fù)現(xiàn)強化學(xué)習(xí)玩 Flappy Bird 小游戲這篇論文的算法關(guān)鍵部分,還有記錄復(fù)現(xiàn)過程中一些踩過的坑。

2022-01-26 18:19:34 2

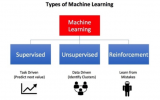

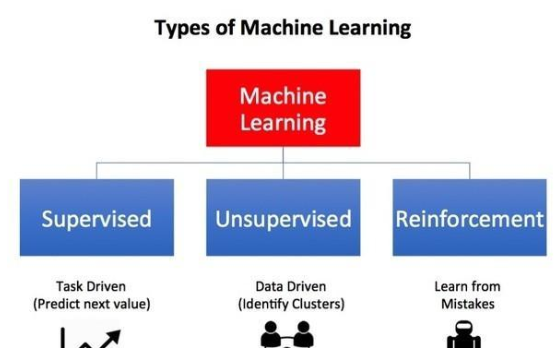

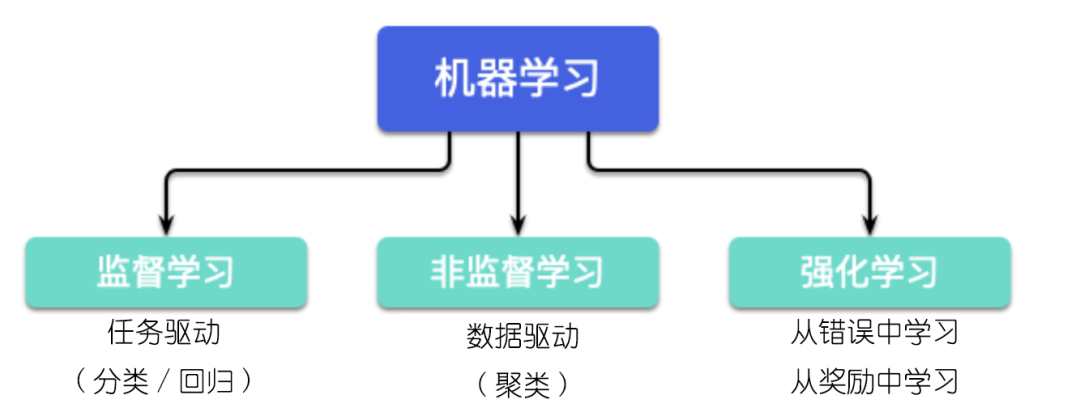

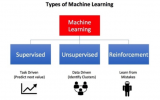

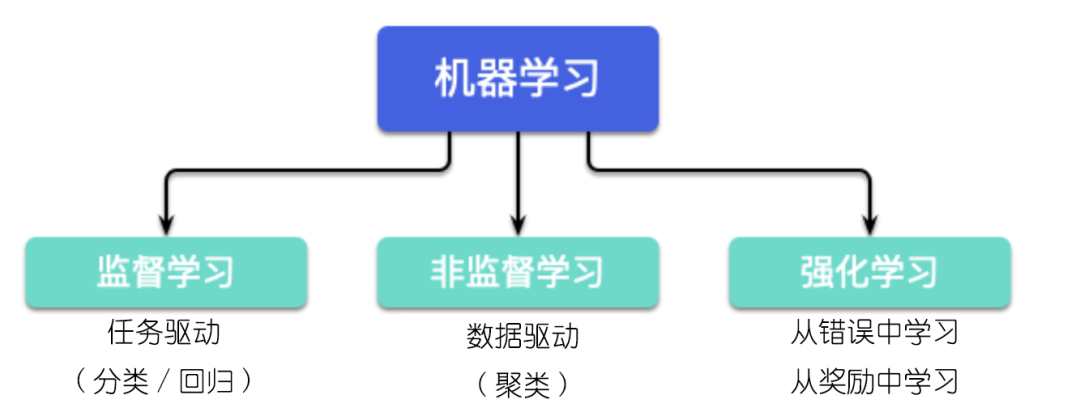

2 來源:DeepHub IMBA 強化學(xué)習(xí)的基礎(chǔ)知識和概念簡介(無模型、在線學(xué)習(xí)、離線強化學(xué)習(xí)等) 機器學(xué)習(xí)(ML)分為三個分支:監(jiān)督學(xué)習(xí)、無監(jiān)督學(xué)習(xí)和強化學(xué)習(xí)。 監(jiān)督學(xué)習(xí)(SL) : 關(guān)注在給

2022-12-20 14:00:02 828

828 電子發(fā)燒友網(wǎng)站提供《ESP32上的深度強化學(xué)習(xí).zip》資料免費下載

2022-12-27 10:31:45 0

0 作者:Siddhartha Pramanik 來源:DeepHub IMBA 目前流行的強化學(xué)習(xí)算法包括 Q-learning、SARSA、DDPG、A2C、PPO、DQN 和 TRPO。這些算法

2023-02-03 20:15:06 747

747 本文介紹了強化學(xué)習(xí)與智能駕駛決策規(guī)劃。智能駕駛中的決策規(guī)劃模塊負責(zé)將感知模塊所得到的環(huán)境信息轉(zhuǎn)化成具體的駕駛策略,從而指引車輛安全、穩(wěn)定的行駛。真實的駕駛場景往往具有高度的復(fù)雜性及不確定性。如何制定

2023-02-08 14:05:16 1441

1441 強化學(xué)習(xí)(RL)是人工智能的一個子領(lǐng)域,專注于決策過程。與其他形式的機器學(xué)習(xí)相比,強化學(xué)習(xí)模型通過與環(huán)境交互并以獎勵或懲罰的形式接收反饋來學(xué)習(xí)。

2023-06-09 09:23:23 355

355 ,可以節(jié)省至多 95% 的訓(xùn)練開銷。 深度強化學(xué)習(xí)模型的訓(xùn)練通常需要很高的計算成本,因此對深度強化學(xué)習(xí)模型進行稀疏化處理具有加快訓(xùn)練速度和拓展模型部署的巨大潛力。 然而現(xiàn)有的生成小型模型的方法主要基于知識蒸餾,即通過迭

2023-06-11 21:40:02 356

356

機械臂抓取擺放及堆疊物體是智能工廠流水線上常見的工序,可以有效的提升生產(chǎn)效率,本文針對機械臂的抓取擺放、抓取堆疊等常見任務(wù),結(jié)合深度強化學(xué)習(xí)及視覺反饋,采用AprilTag視覺標(biāo)簽、后視經(jīng)驗回放機制

2023-06-12 11:25:22 1221

1221

來源:DeepHubIMBA強化學(xué)習(xí)的基礎(chǔ)知識和概念簡介(無模型、在線學(xué)習(xí)、離線強化學(xué)習(xí)等)機器學(xué)習(xí)(ML)分為三個分支:監(jiān)督學(xué)習(xí)、無監(jiān)督學(xué)習(xí)和強化學(xué)習(xí)。監(jiān)督學(xué)習(xí)(SL):關(guān)注在給定標(biāo)記訓(xùn)練數(shù)據(jù)

2023-01-05 14:54:05 419

419

作者:SiddharthaPramanik來源:DeepHubIMBA目前流行的強化學(xué)習(xí)算法包括Q-learning、SARSA、DDPG、A2C、PPO、DQN和TRPO。這些算法已被用于在游戲

2023-02-06 15:06:38 665

665

電子發(fā)燒友網(wǎng)站提供《人工智能強化學(xué)習(xí)開源分享.zip》資料免費下載

2023-06-20 09:27:28 1

1 摘要:基于強化學(xué)習(xí)的目標(biāo)檢測算法在檢測過程中通常采用預(yù)定義搜索行為,其產(chǎn)生的候選區(qū)域形狀和尺寸變化單一,導(dǎo)致目標(biāo)檢測精確度較低。為此,在基于深度強化學(xué)習(xí)的視覺目標(biāo)檢測算法基礎(chǔ)上,提出聯(lián)合回歸與深度

2023-07-19 14:35:02 0

0 訊維模擬矩陣在深度強化學(xué)習(xí)智能控制系統(tǒng)中的應(yīng)用主要是通過構(gòu)建一個包含多種環(huán)境信息和動作空間的模擬矩陣,來模擬和預(yù)測深度強化學(xué)習(xí)智能控制系統(tǒng)在不同環(huán)境下的表現(xiàn)和效果,從而優(yōu)化控制策略和提高系統(tǒng)的性能

2023-09-04 14:26:36 295

295

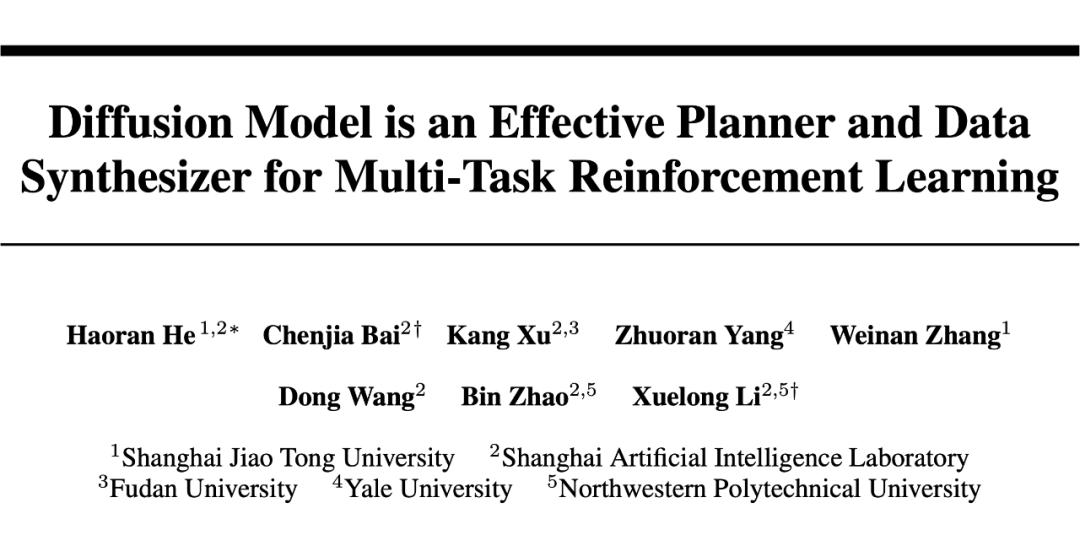

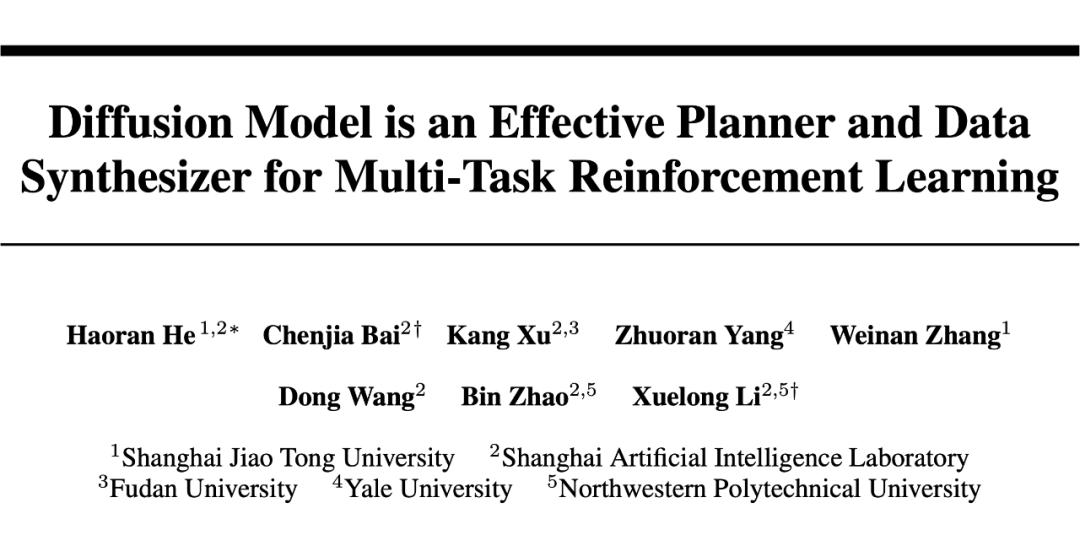

擴散模型(diffusion model)在 CV 領(lǐng)域甚至 NLP 領(lǐng)域都已經(jīng)有了令人印象深刻的表現(xiàn)。最近的一些工作開始將 diffusion model 用于強化學(xué)習(xí)(RL)中來解決序列決策問題

2023-10-02 10:45:02 403

403

強化學(xué)習(xí)是機器學(xué)習(xí)的方式之一,它與監(jiān)督學(xué)習(xí)、無監(jiān)督學(xué)習(xí)并列,是三種機器學(xué)習(xí)訓(xùn)練方法之一。 在圍棋上擊敗世界第一李世石的 AlphaGo、在《星際爭霸2》中以 10:1 擊敗了人類頂級職業(yè)玩家

2023-10-30 11:36:40 1051

1051

電子發(fā)燒友App

電子發(fā)燒友App

評論