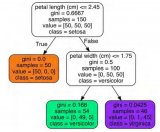

決策樹是最重要的機器學(xué)習(xí)算法之一,其可被用于分類和回歸問題。本文中,我們將介紹分類部分。

2020-10-12 16:39:34 1112

1112

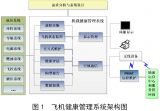

、預(yù)測和管理飛機的運行狀態(tài)。鑒于此,將機器學(xué)習(xí)中的決策樹算法應(yīng)用到故障診斷技術(shù)中,建立了復(fù)雜的數(shù)學(xué)模型,提出了一種基于飛機狀態(tài)參數(shù)構(gòu)成的決策樹的飛機級故障診斷建模方法,對飛機健康管理應(yīng)用的發(fā)展具有一定的參考意義,有利于健康管理系統(tǒng)朝著更加綜合化、智能化、網(wǎng)絡(luò)化和標(biāo)準(zhǔn)化的方向發(fā)展。

2023-11-16 16:40:27 453

453

決策樹算法是機器學(xué)習(xí)領(lǐng)域的基石之一,其強大的數(shù)據(jù)分割能力讓它在各種預(yù)測和分類問題中扮演著重要的角色。

2023-12-13 09:49:56 400

400

非線性分類器,也就是說,通過復(fù)雜的決策邊界來分割解空間。那么,直觀地看,為什么我們認為使用決策樹模型比深度神經(jīng)網(wǎng)絡(luò)要容易得多呢?13. 反向傳播是深度學(xué)習(xí)的關(guān)鍵算法。請列舉一些可能替代反向傳播算法來訓(xùn)練

2018-09-29 09:39:54

決策樹在機器學(xué)習(xí)的理論學(xué)習(xí)與實踐

2019-09-20 12:48:44

在本文中,我們將討論一種監(jiān)督式學(xué)習(xí)算法。最新一代意法半導(dǎo)體 MEMS 傳感器內(nèi)置一個基于決策樹分類器的機器學(xué)習(xí)核心(MLC)。這些產(chǎn)品很容易通過后綴中的 X 來識別(例如,LSM6DSOX)。這種

2023-09-08 06:50:22

我一直在嘗試弄清楚一旦發(fā)生變化的條件,LSM6DSOX 上的機器學(xué)習(xí)核心能夠以多快的速度生成輸出。我正在研究一種需要在不到 50 毫秒內(nèi)進行特征檢測的設(shè)計。我在 STEVAL-MKI109V3 板上

2022-12-20 06:45:43

機器學(xué)習(xí)——決策樹算法分析

2020-04-02 11:48:38

各種機器學(xué)習(xí)的應(yīng)用場景分別是什么?例如,k近鄰,貝葉斯,決策樹,svm,邏輯斯蒂回歸和最大熵模型

2019-09-10 10:53:10

系列文章目錄提示:這里可以添加系列文章的所有文章的目錄,目錄需要自己手動添加例如:第一章 Python 機器學(xué)習(xí)入門之pandas的使用提示:寫完文章后,目錄可以自動生成,如何生成可參考右邊的幫助

2022-02-09 06:47:38

本文檔旨在提供 ISM330DHCX 中可用的機器學(xué)習(xí)內(nèi)核功能信息。機器學(xué)習(xí)處理能力允許將一些算法從應(yīng)用處理器轉(zhuǎn)移到 MEMS傳感器,從而持續(xù)降低功耗。通過決策樹邏輯獲得機器學(xué)習(xí)處理能力。決策樹是由

2023-09-08 07:53:52

校區(qū))第一章:MATLAB入門基礎(chǔ)第二章:MATLAB進階與提高第三章:BP神經(jīng)網(wǎng)絡(luò)第四章:極限學(xué)習(xí)機第五章:支持向量機第六章:決策樹算法與隨機森林第七章:遺傳算法第八章:變量降維與特征選擇第九章:圖像處理

2018-10-23 16:51:05

ML--決策樹與隨機森林

2020-07-08 12:31:39

系列文章目錄提示:這里可以添加系列文章的所有文章的目錄,目錄需要自己手動添加例如:第一章 Python 機器學(xué)習(xí)入門之pandas的使用提示:寫完文章后,目錄可以自動生成,如何生成可參考右邊的幫助

2021-08-13 07:36:45

linux設(shè)備樹詳解 2003 年畢業(yè)于中國科學(xué)技術(shù)大學(xué),電子專業(yè)、軟件專業(yè)...

2021-12-23 08:16:32

]目錄:第一部分 分類第1章 機器學(xué)習(xí)基礎(chǔ) 2第2章 k-近鄰算法 15第3章 決策樹 32第4章 基于概率論的分類方法:樸素貝葉斯 53第5章 Logistic回歸 73第6章

2017-06-01 15:49:24

與信息處理專業(yè),本科以上學(xué)歷;2.有較好數(shù)學(xué)以及信號處理基礎(chǔ),熟悉基本的的數(shù)據(jù)挖掘/機器學(xué)習(xí)模型,如決策樹、回歸、貝葉斯、聚類等算法模型;3.熟悉信號與系統(tǒng)的整體結(jié)構(gòu);4.能夠熟練運用MATLAB

2017-08-18 10:26:22

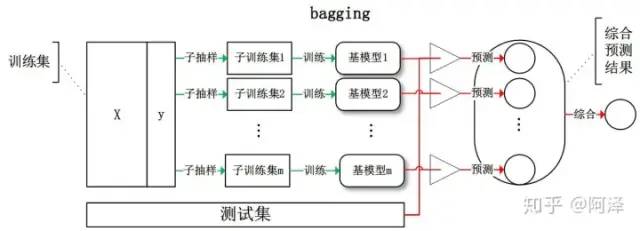

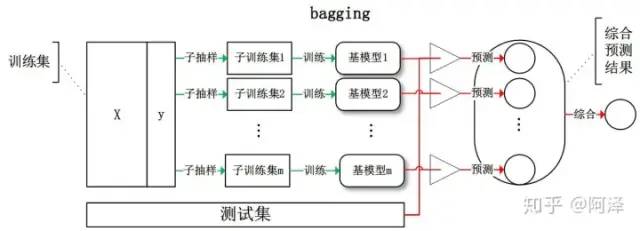

的估計區(qū)間 4、隨機森林隨機森林(Random Forest)是Bagging的擴展變體。隨機森林在以決策樹為基學(xué)習(xí)器構(gòu)建Bagging集成的基礎(chǔ)上,進一步在決策樹的訓(xùn)練過程中引入了隨機屬性選擇。簡單

2018-06-06 10:11:38

也被稱為深度神經(jīng)網(wǎng)絡(luò),因為決策樹的嵌套層次結(jié)構(gòu)的層數(shù)是數(shù)以百萬計的數(shù)據(jù)節(jié)點。讓你的機器學(xué)習(xí)人工智能認證計數(shù)自從第一次工業(yè)革命以來,機器就一直驅(qū)動著我們的生活方式,使之成為當(dāng)今工業(yè)4.0的趨勢。因此,在

2018-08-27 10:16:55

目錄人工智能基本概念機器學(xué)習(xí)算法1. 決策樹2. KNN3. KMEANS4. SVM5. 線性回歸深度學(xué)習(xí)算法1. BP2. GANs3. CNN4. LSTM應(yīng)用人工智能基本概念數(shù)據(jù)集:訓(xùn)練集

2021-09-06 08:21:17

很像一棵樹的枝干,故稱決策樹。隨機森林在機器學(xué)習(xí)中,隨機森林是一個包含多個決策樹的分類器, 并且其輸出的類別是由個別樹輸出的類別的眾數(shù)而定。邏輯回歸邏輯回歸,是一種廣義的線性回歸分析模型,常用于數(shù)據(jù)挖掘

2022-03-05 14:15:07

嵌入式系統(tǒng)之硬件總復(fù)習(xí)提示:這里可以添加系列文章的所有文章的目錄,目錄需要自己手動添加例如:第一章 Python 機器學(xué)習(xí)入門之pandas的使用提示:寫完文章后,目錄可以自動生成,如何生成可

2021-12-16 06:27:44

系列文章目錄提示:這里可以添加系列文章的所有文章的目錄,目錄需要自己手動添加例如:第一章 Python 機器學(xué)習(xí)入門之pandas的使用提示:寫完文章后,目錄可以自動生成,如何生成可參考右邊的幫助

2021-08-13 07:39:46

本文主要介紹支持向量機、k近鄰、樸素貝葉斯分類 、決策樹、決策樹集成等模型的應(yīng)用。講解了支持向量機SVM線性與非線性模型的適用環(huán)境,并對核函數(shù)技巧作出深入的分析,對線性Linear核函數(shù)、多項式

2021-09-01 06:57:36

`隨著科學(xué)技術(shù)的發(fā)展,AI愛好者越來越多,除了一些精通AI的大神,還有很多的技術(shù)小白也對這方面感興趣,他們想學(xué)習(xí)一些機器學(xué)習(xí)的入門知識。今天,訊飛開放平臺就帶來機器學(xué)習(xí)中的一個重要算法——決策樹。在

2018-05-23 09:38:48

統(tǒng)計學(xué)習(xí)方法決策樹

2019-11-05 13:40:43

利用決策樹中CART算法識別印第安人糖尿病患者

2019-05-06 12:16:27

本發(fā)明公開一種基于機器學(xué)習(xí)的車位狀態(tài)預(yù)測方法,基于歷史數(shù)據(jù),建立回歸決策樹模型進而構(gòu)建改進決策樹模型,對每個區(qū)域的停車率進行預(yù)測,基于停車率和用戶喜好度為用戶推薦相應(yīng)的停車區(qū)域,獲取相應(yīng)停車區(qū)域

2023-09-21 07:24:58

我正在開發(fā)一個超低功耗應(yīng)用程序,其中 LSM6DSO32X 的 MLC 用于在發(fā)生有趣的事情時喚醒 mcu,特別是我實現(xiàn)了兩個決策樹,每個決策樹都專注于模式檢測。為了減少錯誤喚醒,我想僅在兩棵樹中

2022-12-22 06:26:34

。比如小時候我們還不認識錢幣,看到一堆紙幣和硬幣,會很自然的把紙幣和硬幣分開,這就是最簡單的聚類原理。2機器學(xué)習(xí)中的經(jīng)典算法機器學(xué)習(xí)中所涉及到的算法有很多,比較典型的算法有決策樹、回歸、神經(jīng)網(wǎng)絡(luò)等

2018-07-27 12:54:20

Tree。如果要求速度優(yōu)先,建議考慮決策樹和線性回歸。分類支持向量機 SVM如果對于分類的準(zhǔn)確性要求比較高,可使用的算法包括Kernel SVM,隨機森林,神經(jīng)網(wǎng)絡(luò)以及Gradient

2019-03-07 20:18:53

,廣義線性模型,2,支持向量機,3,最近鄰居法,4,決策樹,5,神經(jīng)網(wǎng)絡(luò),等等… 但是,從我們的經(jīng)驗來看,這并不總是算法分組最為實用的方法。那是因為對于應(yīng)用機器學(xué)習(xí),你通常不會想,“今天我要訓(xùn)練一個支持向量機

2019-09-22 08:30:00

使用 UNICO(v9.10.0.0),生成具有多個決策樹的 UCF 文件的過程似乎是:1.加載所有決策樹的所有測試數(shù)據(jù),像對單個樹一樣標(biāo)記每個數(shù)據(jù)集(大概標(biāo)簽需要在所有樹中是唯一的)2.使用MLC

2022-12-26 06:30:11

的所有需求。而這三類里又包含許多經(jīng)典算法。而今天,小編就給大家介紹下數(shù)據(jù)挖掘中最經(jīng)典的十大算法,希望它對你有所幫助。一、 分類決策樹算法C4.5C4.5,是機器學(xué)習(xí)算法中的一種分類決策樹算法,它是決策樹

2018-11-06 17:02:30

李航統(tǒng)計學(xué)習(xí)第五章-決策樹

2020-04-29 15:12:25

生成一個將輸入映射到輸出的函數(shù)。訓(xùn)練過程達到我們設(shè)定的損失閾值停止訓(xùn)練,也就是使模型達到我們需要的準(zhǔn)確度等水平。監(jiān)督學(xué)習(xí)的例子:回歸,決策樹,隨機森林,KNN,邏輯回歸等0.2 無監(jiān)督學(xué)習(xí) 工作原理:在

2018-10-23 14:31:12

介紹了決策樹分類技術(shù),并用其對汽車銷售企業(yè)的調(diào)查問卷進行數(shù)據(jù)分析,挖掘出最近一年內(nèi)有購車意愿的客戶的特征,從而提高營銷的成功率。證明了決策樹數(shù)據(jù)挖掘技術(shù)在汽車

2009-09-09 15:49:08 13

13 一個基于粗集的決策樹規(guī)則提取算法:摘要:決策樹是數(shù)據(jù)挖掘任務(wù)中分類的常用方法。在構(gòu)造決策樹的過程中,分離屬性的選擇標(biāo)準(zhǔn)直接影響到分類的效果,傳統(tǒng)的決策樹算法往往

2009-10-10 15:13:34 12

12 基于屬性相似度的決策樹算法:針對ID3 算法的多值偏向問題,提出一種基于屬性相似度的、能夠避免多值偏向問題的ID3 改進算法——NewDtree 算法,并應(yīng)用理論分析方法對NewDtree 算

2009-10-17 23:07:49 15

15 在數(shù)據(jù)挖掘中我們往往會忽略離群數(shù)據(jù),可是這些數(shù)據(jù)卻往往包含重要的信息。本文采用了將決策樹與相異度相結(jié)合的方式進行離群數(shù)據(jù)的挖掘。通過計算決策樹中各屬性的信息

2010-01-15 14:28:05 5

5 以決策樹數(shù)據(jù)挖掘分類算法在金融客戶關(guān)系管理(CRM)中的應(yīng)用為例,進行了數(shù)據(jù)挖掘的嘗試,從中發(fā)現(xiàn)企業(yè)產(chǎn)品的銷售規(guī)律和客戶群特征,從而提高CRM對市場活動和銷售活動的分

2010-08-02 12:18:08 0

0 為提高大規(guī)模數(shù)據(jù)集生成樹的準(zhǔn)確率,提出一種預(yù)生成一棵基于這個數(shù)據(jù)集的決策樹,采用廣度優(yōu)先遍歷將其劃分為滿足預(yù)定義的限制的數(shù)據(jù)集,再對各數(shù)據(jù)集按照一定比例進行隨機采樣,最后將采樣結(jié)果整合為目標(biāo)數(shù)據(jù)集的數(shù)據(jù)采樣方法.通過對一UCI數(shù)據(jù)集進行采樣,并用現(xiàn)

2011-02-14 15:15:15 0

0 引入了基于粗糙集理論的屬性約簡進行屬性的降噪和排序處理,然后結(jié)合決策樹理論的C4.5算法來對自診斷電子稱重儀表進行分析,取信息增益率最大的結(jié)點作為決策樹的根,以此使分裂

2011-10-08 14:43:10 24

24 該方法利用決策樹算法構(gòu)造決策樹,通過對分類結(jié)果中主客觀屬性進行標(biāo)記并邏輯運算,最終得到較客觀的決策信息,并進行實驗驗證。

2012-02-07 11:38:03 26

26 基于決策樹學(xué)習(xí)的智能機器人控制方法!資料來源網(wǎng)絡(luò),如有侵權(quán),敬請見諒

2015-11-30 11:33:44 15

15 關(guān)于決策樹的介紹,是一些很基礎(chǔ)的介紹,不過是英文介紹。

2016-09-18 14:55:04 0

0 為什么要引入隨機森林呢。我們知道,同一批數(shù)據(jù),我們只能產(chǎn)生一顆決策樹,這個變化就比較單一了,這就有了集成學(xué)習(xí)的概念。

2017-10-18 17:47:37 3445

3445

決策樹算法最早源于人工智能的機器學(xué)習(xí)技術(shù),用以實現(xiàn)數(shù)據(jù)內(nèi)在規(guī)律的探究和新數(shù)據(jù)對象的分類預(yù)測U。由于其出色的數(shù)據(jù)分析能力和直觀易懂的結(jié)果展示等特點,決策樹成為一種重要的數(shù)據(jù)挖掘技術(shù)。隨著信息化技術(shù)

2017-10-28 12:58:36 0

0 路徑最短,從而提升分類的速度和準(zhǔn)確率。通過實例對改進算法生成決策樹產(chǎn)生的結(jié)果分析,表明了該算法生成的決策樹結(jié)構(gòu)更簡單,時間復(fù)雜度更優(yōu)。算法更有效。

2017-11-14 14:08:05 1

1 最近打算系統(tǒng)學(xué)習(xí)下機器學(xué)習(xí)的基礎(chǔ)算法,避免眼高手低,決定把常用的機器學(xué)習(xí)基礎(chǔ)算法都實現(xiàn)一遍以便加深印象。本文為這系列博客的第一篇,關(guān)于決策樹(Decision Tree)的算法實現(xiàn),文中我將對決策樹

2017-11-15 13:10:04 14310

14310

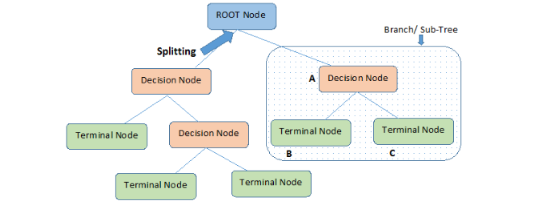

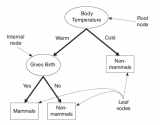

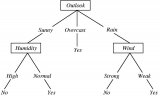

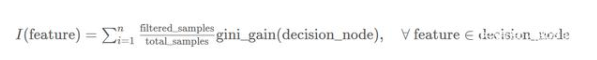

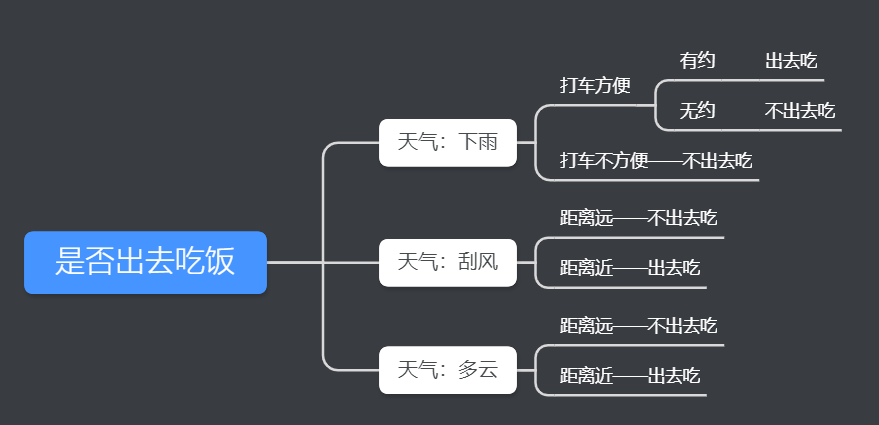

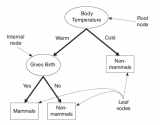

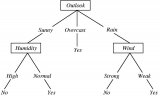

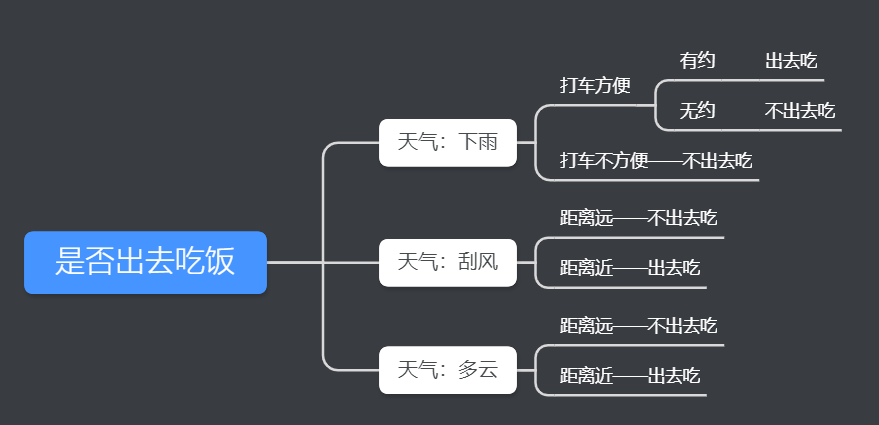

今天,我們介紹機器學(xué)習(xí)里比較常用的一種分類算法,決策樹。決策樹是對人類認知識別的一種模擬,給你一堆看似雜亂無章的數(shù)據(jù),如何用盡可能少的特征,對這些數(shù)據(jù)進行有效的分類。 決策樹借助了一種層級分類的概念

2017-11-16 01:50:01 1429

1429 針對經(jīng)典C4.5決策樹算法存在過度擬合和伸縮性差的問題,提出了一種基于Bagging的決策樹改進算法,并基于MapReduce模型對改進算法進行了并行化。首先,基于Bagging技術(shù)對C4.5算法

2017-11-21 11:57:08 1

1 目前關(guān)于決策樹剪枝優(yōu)化方面的研究主要集中于預(yù)剪枝和后剪枝算法。然而,這些剪枝算法通常作用于傳統(tǒng)的決策樹分類算法,在代價敏感學(xué)習(xí)與剪枝優(yōu)化算法相結(jié)合方面還沒有較好的研究成果。基于經(jīng)濟學(xué)中的效益成本

2017-11-30 10:05:19 0

0 決策樹技術(shù)在數(shù)據(jù)挖掘的分類領(lǐng)域中被廣泛采用。采用決策樹從一致決策表f即條件屬性值相同的樣本其決策值相同)中挖掘有價值信息的相關(guān)研究較為成熟,而對于非一致決策表(即條件屬性值相同的樣本其決策

2017-12-05 14:30:45 0

0 決策樹技術(shù)在數(shù)據(jù)挖掘的分類領(lǐng)域應(yīng)用極其廣泛,可以從普通決策表(每行記錄包含一個決策值)中挖掘有價值的信息,但是要從多值決策表(每行記錄包含多個決策值)中挖掘潛在的信息則比較困難。多值決策表中每行記錄

2017-12-05 15:47:26 0

0 圖看起來非常直觀,并且可以從建樹的原始數(shù)據(jù)集中挖掘出一些關(guān)鍵的信息,因此決策樹圖的繪制是非常必要的。本研究從分子生物學(xué)領(lǐng)域中的基因分型決策樹繪制為實例,淺談如何使用MALAB語言編譯生成AUTOLISP代碼,從而實現(xiàn)可變ID3基因

2017-12-07 11:23:03 1

1 決策樹算法是一種最簡單、最直接、最有效的文本分類算法。最早的決策樹算法是ID3算法,于1986年由Quinlan提出,該算法是一種基于信息熵的決策樹分類算法。由于該算法是以信息熵作為屬性選擇的標(biāo)準(zhǔn)

2017-12-12 11:20:55 0

0 機器學(xué)習(xí)算法的分類是棘手的,有幾種合理的分類,他們可以分為生成/識別,參數(shù)/非參數(shù),監(jiān)督/無監(jiān)督等。 例如,Scikit-Learn的文檔頁面通過學(xué)習(xí)機制對算法進行分組。這產(chǎn)生類別

2017-12-20 20:38:49 2010

2010 提前修復(fù)不一致數(shù)據(jù)。直接在不一致數(shù)據(jù)上進行分類。是該文的核心研究內(nèi)容,對決策樹生成算法的目標(biāo)函數(shù)進行改進。使其能夠直接對不一致數(shù)據(jù)進行分類,并得到較好的分類結(jié)果.對約束條件中的特征對分類結(jié)果的影響進行了多

2017-12-26 16:13:02 0

0 針對靜態(tài)算法對大數(shù)據(jù)和增量數(shù)據(jù)處理不足的問題,構(gòu)造了基于粗決策樹的動態(tài)規(guī)則提取算法,并將其應(yīng)用于旋轉(zhuǎn)機械故障診斷中。將粗集與決策樹結(jié)合,用增量方式實現(xiàn)樣本抽取;經(jīng)過動態(tài)約簡、決策樹構(gòu)造、規(guī)則提取

2017-12-29 14:24:05 0

0 知識挖掘方法。,該方法選擇信息增益率最大的屬性作為分割屬性,通過挖掘數(shù)據(jù)獲取各屬性的最優(yōu)分割點建立門限,利用剪枝策略防止決策樹過擬合或深度過大,最后梳理決策樹生成故障診斷知識。通過對算例和對實際在軌數(shù)據(jù)進

2018-02-23 10:50:30 0

0 決策樹(DT)是在已知各種情況發(fā)生概率的基礎(chǔ)上,通過構(gòu)成決策樹來求取凈現(xiàn)值的期望值大于等于零的概率,評價項目風(fēng)險,判斷其可行性的決策分析方法,是直觀運用概率分析的一種圖解法。由于這種決策分支畫成圖形很像一棵樹的枝干,故稱決策樹。從數(shù)據(jù)產(chǎn)生決策樹的機器學(xué)習(xí)技術(shù)叫做決策樹學(xué)習(xí)。

2018-05-29 07:12:00 1801

1801 隨著人工智能的發(fā)展,人類將會把越來越多的決策權(quán)交給機器。但是,從目前的一些事例看,基于機器學(xué)習(xí)的決策并非那么公正完美,相反,那些決策也滲透著偏見。近期的一份研究報告中,Google的一名研究科學(xué)家

2018-05-11 10:33:00 1350

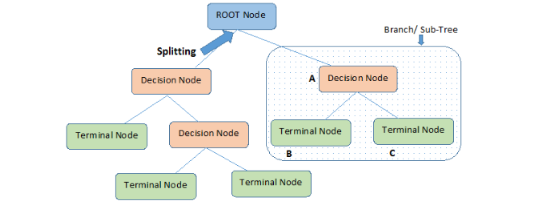

1350 機器學(xué)習(xí)中,決策樹是一個預(yù)測模型,它代表的是對象屬性與對象值之間的一種映射關(guān)系。樹中每個節(jié)點表示某個對象,而每個分叉路徑則代表的某個可能的屬性值,而每個葉結(jié)點則對應(yīng)從根節(jié)點到該葉節(jié)點所經(jīng)歷的路徑

2018-05-28 10:53:25 3913

3913

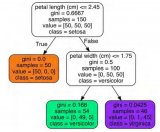

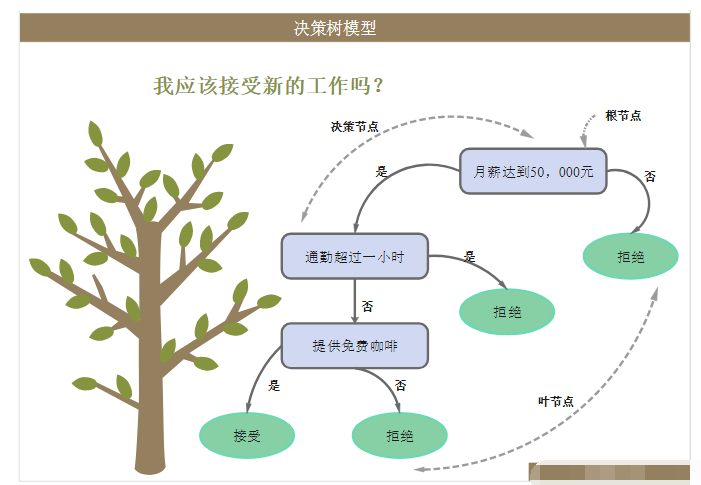

正如你所看到的,決策樹非常直觀,他們的決策很容易解釋。 這種模型通常被稱為白盒模型。 相反,正如我們將看到的,隨機森林或神經(jīng)網(wǎng)絡(luò)通常被認為是黑匣子模型。 他們做出了很好的預(yù)測,并且我們可以輕松檢查他們執(zhí)行的計算以進行這些預(yù)測; 然而,通常很難用簡單的術(shù)語來解釋為什么會做出預(yù)測。

2018-07-16 17:12:01 13941

13941

決策樹(decision tree)算法基于特征屬性進行分類,其主要的優(yōu)點:模型具有可讀性,計算量小,分類速度快。決策樹算法包括了由Quinlan提出的ID3與C4.5,Breiman等提出的CART。其中,C4.5是基于ID3的,對分裂屬性的目標(biāo)函數(shù)做出了改進。

2018-07-21 10:13:29 5369

5369

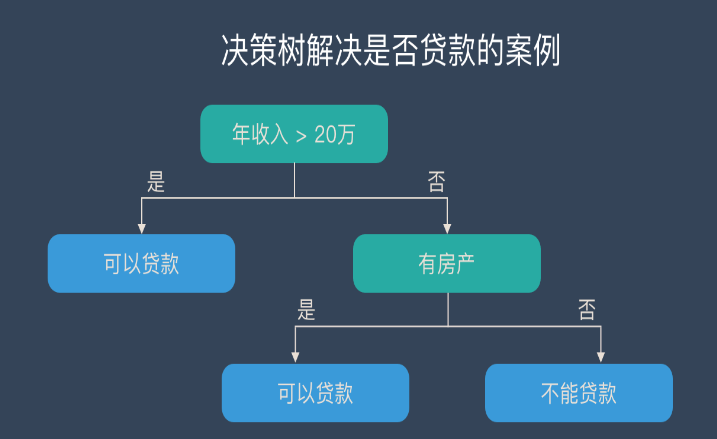

萬萬沒想到,在工程師的手中,我們可以用機器學(xué)習(xí)搭建自己的音以決策樹為例,這是一種常見的機器學(xué)習(xí)算法,并不涉及“神經(jīng)網(wǎng)絡(luò)”、“深度學(xué)習(xí)”的范疇。簡言之,決策樹是一種以遞歸方式學(xué)習(xí)每個特征的閾值并將數(shù)據(jù)分類的系統(tǒng)。

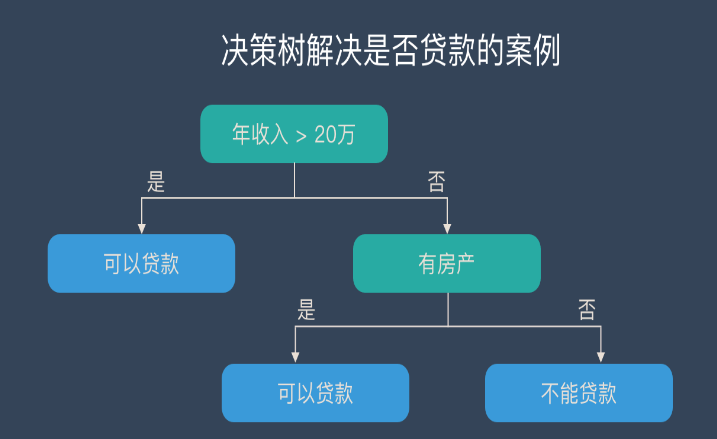

2018-08-01 09:41:43 2689

2689 希望通過所給的訓(xùn)練數(shù)據(jù)學(xué)習(xí)一個貸款申請的決策樹,用于對未來的貸款申請進行分類,即當(dāng)新的客戶提出貸款申請時,根據(jù)申請人的特征利用決策樹決定是否批準(zhǔn)貸款申請。

2018-10-08 14:26:09 5616

5616 C4.5算法:基于ID3算法的改進,主要包括:使用信息增益率替換了信息增益下降度作為屬性選擇的標(biāo)準(zhǔn);在決策樹構(gòu)造的同時進行剪枝操作;避免了樹的過度擬合情況;可以對不完整屬性和連續(xù)型數(shù)據(jù)進行處理,提升了算法的普適性。

2019-02-04 09:45:00 10307

10307

我們知道決策樹容易過擬合。換句話說,單個決策樹可以很好地找到特定問題的解決方案,但如果應(yīng)用于以前從未見過的問題則非常糟糕。俗話說三個臭皮匠賽過諸葛亮,隨機森林就利用了多個決策樹,來應(yīng)對多種不同場景。

2019-04-19 14:38:02 7526

7526

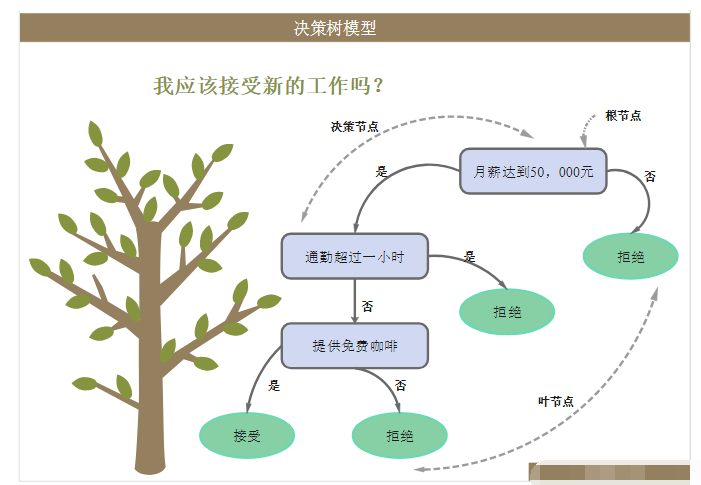

決策樹(Decision Tree)是在已知各種情況發(fā)生概率的基礎(chǔ)上,通過構(gòu)成決策樹來求取凈現(xiàn)值的期望值大于等于零的概率,評價項目風(fēng)險,判斷其可行性的決策分析方法,是直觀運用概率分析的一種圖解法。

2020-01-19 17:06:00 7325

7325 決策樹模型是白盒模型的一種,其預(yù)測結(jié)果可以由人來解釋。我們把機器學(xué)習(xí)模型的這一特性稱為可解釋性,但并不是所有的機器學(xué)習(xí)模型都具有可解釋性。

2020-07-06 09:49:06 3073

3073

來“訓(xùn)練”,通過各種算法從數(shù)據(jù)中學(xué)習(xí)如何完成任務(wù)。機器學(xué)習(xí)傳統(tǒng)的算法包括決策樹、聚類、貝葉斯分類等。從學(xué)習(xí)方法上來分可以分為監(jiān)督學(xué)習(xí)、無監(jiān)督學(xué)習(xí)、半監(jiān)督學(xué)習(xí)、集成學(xué)習(xí)、深度學(xué)習(xí)和強化學(xué)習(xí)。

2020-07-26 11:14:44 10904

10904 決策樹易于理解和解釋,可以可視化分析,容易提取出規(guī)則。

2020-08-27 09:50:07 16399

16399 決策樹是一種解決分類問題的算法,決策樹算法采用樹形結(jié)構(gòu),使用層層推理來實現(xiàn)最終的分類。

2020-08-27 09:52:48 3753

3753 像上面的這樣的二叉樹狀決策在我們生活中很常見,而這樣的選擇方法就是決策樹。機器學(xué)習(xí)的方法就是通過平時生活中的點點滴滴經(jīng)驗轉(zhuǎn)化而來的。

2020-10-10 10:44:19 2316

2316

決策樹是機器學(xué)習(xí)中使用的最流行和功能最強大的分類算法之一。顧名思義,決策樹用于根據(jù)給定的數(shù)據(jù)集做出決策。也就是說,它有助于選擇適當(dāng)?shù)奶卣饕詫浞殖深愃朴谌祟愃季S脈絡(luò)的子部分。

2021-01-13 09:37:41 1207

1207

本文將介紹決策樹的基本概念、決策樹學(xué)習(xí)的3個步驟、3種典型的決策樹算法、決策樹的10個優(yōu)缺點。

2021-01-27 10:03:20 2145

2145

所有的機器學(xué)習(xí)算法中,決策樹應(yīng)該是最友好的了。它呢,在整個運行機制上可以很容易地被翻譯成人們能看懂的語言,也因此被歸為“白盒模型”。

2021-01-29 09:36:40 7099

7099

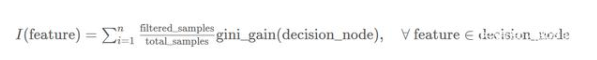

在決策樹中,可能有多個特征,但是一些特征是無關(guān)重要的,一些則是對分類(target)起到?jīng)Q定作用的。

2021-02-18 10:06:29 3815

3815

決策樹是一種解決分類問題的算法,本文將介紹什么是決策樹模型,常見的用途,以及如何使用“億圖圖示”軟件繪制決策樹模型。

2021-02-18 10:12:20 11970

11970

決策樹(DecisionTree)是機器學(xué)習(xí)中一種常見的算法,它的思想非常樸素,就像我們平時利用選擇做決策的過程。決策樹是一種基本的分類與回歸方法,當(dāng)被用于分類時叫做分類樹,被用于回歸時叫做回歸樹。

2021-03-04 10:11:13 7773

7773 為優(yōu)化針對非均衡數(shù)據(jù)的分類效果,結(jié)合猶豫模糊集理論與決策樹算法,提出一種改進的模糊決策樹算法。通過 SMOTE算法對非均衡數(shù)據(jù)進行過采樣處理,使用K- means聚類方法獲得各屬性的聚類中心點,利用

2021-06-09 15:51:47 5

5 基于遺傳優(yōu)化決策樹的建筑能耗預(yù)測模型

2021-06-27 16:19:13 6

6 認為是if-then的集合,也可以認為是定義在特征空間與類空間上的條件概率分布。 決策樹通常有三個步驟:特征選擇、決策樹的生成、決策樹的修剪。 用決策樹分類:從根節(jié)點開始,對實例的某一特征進行測試,根據(jù)測試結(jié)果將實例分配到其子節(jié)點,此時每個子節(jié)點對應(yīng)著該特征

2022-10-20 10:01:36 822

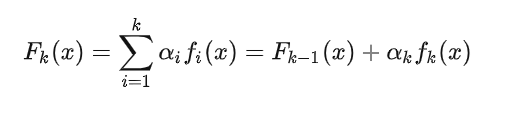

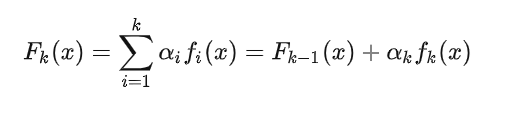

822 本文主要介紹基于集成學(xué)習(xí)的決策樹,其主要通過不同學(xué)習(xí)框架生產(chǎn)基學(xué)習(xí)器,并綜合所有基學(xué)習(xí)器的預(yù)測結(jié)果來改善單個基學(xué)習(xí)器的識別率和泛化性。

2023-02-17 15:52:09 484

484

本文主要介紹基于集成學(xué)習(xí)的決策樹,其主要通過不同學(xué)習(xí)框架生產(chǎn)基學(xué)習(xí)器,并綜合所有基學(xué)習(xí)器的預(yù)測結(jié)果來改善單個基學(xué)習(xí)器的識別率和泛化性。

2023-02-17 15:52:12 341

341

電子發(fā)燒友網(wǎng)站提供《決策樹引擎解決方案.pdf》資料免費下載

2023-09-13 11:17:52 0

0

電子發(fā)燒友App

電子發(fā)燒友App

評論