ArCompany公司的Karen Bennet是一名致力于平臺(tái)、開(kāi)源和封閉源系統(tǒng)以及人工智能技術(shù)的經(jīng)驗(yàn)豐富的工程主管。作為雅虎公司的前工程主管以及Red Hat公司的創(chuàng)始人之一,Karen致力于推動(dòng)技術(shù)革命,他早期在IBM公司專家系統(tǒng)參與人工智能技術(shù)的開(kāi)發(fā),而如今正在見(jiàn)證機(jī)器的快速實(shí)驗(yàn)學(xué)習(xí)和深度學(xué)習(xí)。他撰寫的這篇文章將對(duì)人工智能的現(xiàn)狀進(jìn)行探討。

隨著人工智能的應(yīng)用越來(lái)越廣泛,人們發(fā)現(xiàn)很難駕馭,對(duì)于采用人工智能的承諾在很大程度上還沒(méi)有實(shí)現(xiàn)。雖然人工智能相關(guān)技術(shù)仍在不斷涌現(xiàn),但并未成為所承諾的那樣成為一種普遍力量。以下查看一下令人信服的統(tǒng)計(jì)數(shù)據(jù),以證實(shí)人工智能技術(shù)的發(fā)展:

自2000年以來(lái),人工智能創(chuàng)業(yè)公司數(shù)量增加了14倍。

自2000年以來(lái),風(fēng)險(xiǎn)投資公司對(duì)人工智能初創(chuàng)企業(yè)的投資增長(zhǎng)了6倍。

自2013年以來(lái),需要人工智能技能的工作比例增長(zhǎng)了4.5倍。

截至2017年,Statista公司發(fā)布了以下調(diào)查結(jié)果:截至去年,全球只有5%的企業(yè)將人工智能廣泛納入其流程和產(chǎn)品中,32%的企業(yè)尚未采用,22%的企業(yè)沒(méi)有計(jì)劃采用。

截至2017年,全球商業(yè)組織的人工智能(AI)采用水平

Filip Pieniewski最近在行業(yè)媒體Venturebeat發(fā)表的文章中表示:“人工智能的冬天即將來(lái)臨”。

如今,這種情況正在發(fā)生變化。從表面上看,神經(jīng)信息處理系統(tǒng)大會(huì)(NIPS)會(huì)議仍然座無(wú)虛席,企業(yè)的新聞稿中仍然發(fā)布很多關(guān)于人工智能的文章,特斯拉公司創(chuàng)始人伊隆?馬斯克仍然致力于開(kāi)發(fā)和研究具有前途的自動(dòng)駕駛汽車,谷歌公司不斷推動(dòng)Andrew Ng的線路,認(rèn)為人工智能產(chǎn)業(yè)規(guī)模將比電力行業(yè)更大。但這種敘述開(kāi)始讓人質(zhì)疑。

人們對(duì)自動(dòng)駕駛汽車很感興趣。但在今年春天,一輛自主駕駛車輛撞死一名行人,這引發(fā)了人們的質(zhì)疑,并對(duì)自動(dòng)化系統(tǒng)決策背后的道德規(guī)范表示懷疑。自動(dòng)駕駛車輛問(wèn)題并不是拯救汽車乘客生命一種簡(jiǎn)單的二元選擇,可能將演變成對(duì)于良心、情感和感知的爭(zhēng)論,這使機(jī)器做出合理決定的路徑變得復(fù)雜。

Karen的文章指出:全自動(dòng)駕駛汽車的夢(mèng)想可能比人們意識(shí)到的還要遙遠(yuǎn)。人工智能專家越來(lái)越擔(dān)心,在自動(dòng)駕駛系統(tǒng)能夠可靠地避免事故之前,可能需要數(shù)年甚至數(shù)十年的探索。

Karen解釋說(shuō),以歷史作為預(yù)測(cè)因素,云計(jì)算行業(yè)和網(wǎng)絡(luò)行業(yè)在開(kāi)始以顯著的方式影響人們工作和生活之前花費(fèi)了大約5年時(shí)間,幾乎需要10年的時(shí)間才影響市場(chǎng)的重大轉(zhuǎn)變。人們正在設(shè)想人工智能技術(shù)的類似時(shí)間表。

為了讓每個(gè)人都能夠采用,需要一個(gè)可擴(kuò)展的產(chǎn)品和一個(gè)可供所有人使用的產(chǎn)品,而不僅僅是數(shù)據(jù)科學(xué)家。該產(chǎn)品需要考慮捕獲數(shù)據(jù),準(zhǔn)備數(shù)據(jù),訓(xùn)練模型,以及預(yù)測(cè)的數(shù)據(jù)生命周期。隨著數(shù)據(jù)存儲(chǔ)在云中,數(shù)據(jù)管道可以不斷提取并準(zhǔn)備它們來(lái)訓(xùn)練將進(jìn)行預(yù)測(cè)的模型。模型需要不斷改進(jìn)新的訓(xùn)練數(shù)據(jù),這反過(guò)來(lái)將使模型保持相關(guān)性和透明性。這就是目標(biāo)和承諾。

在沒(méi)有重大用例的情況下構(gòu)建人工智能概念證明

Karen在人工智能初創(chuàng)企業(yè)中工作,其所見(jiàn)證的以及與同行討論時(shí)都是廣泛的人工智能實(shí)驗(yàn),涉及多個(gè)業(yè)務(wù)問(wèn)題,這些問(wèn)題往往停留在實(shí)驗(yàn)室中。

最近他發(fā)布的一篇文章證實(shí)了如今人工智能試點(diǎn)項(xiàng)目的普遍性。文章指出,“人工智能技術(shù)的供應(yīng)商經(jīng)常受到激勵(lì),使他們的技術(shù)聽(tīng)起來(lái)比實(shí)際能力更強(qiáng)——但暗示著比實(shí)際擁有更多的真實(shí)世界的吸引力。..。..企業(yè)中的大多數(shù)人工智能應(yīng)用只不過(guò)是一種試點(diǎn)。”供應(yīng)商推出銷售營(yíng)銷解決方案、醫(yī)療保健解決方案和人工智能的財(cái)務(wù)解決方案只是為了驅(qū)動(dòng)人工智能技術(shù)得到人們?cè)絹?lái)越多的關(guān)注。在任何給定的行業(yè)中,人們發(fā)現(xiàn)在銷售人工智能軟件和技術(shù)的數(shù)百家供應(yīng)商公司中,只有大約三分之一的公司真正擁有知識(shí)和技術(shù)開(kāi)展人工智能的探索和研究。

風(fēng)險(xiǎn)投資商意識(shí)到他們可能在一段時(shí)間內(nèi)看不到投資回報(bào)。然而,很少有模型進(jìn)行普遍的實(shí)驗(yàn)只是人工智能尚未準(zhǔn)備好迎接廣泛應(yīng)用的原因之一。

算法可以為此負(fù)責(zé)嗎?

人們也許聽(tīng)說(shuō)過(guò)人工智能“黑盒”, 這是一種無(wú)法確定決策的方法。這種做法將面向銀行和大型機(jī)構(gòu),這些機(jī)構(gòu)具有強(qiáng)制執(zhí)行問(wèn)責(zé)制的合規(guī)標(biāo)準(zhǔn)和政策。在系統(tǒng)作為黑盒運(yùn)行,只要這些算法的創(chuàng)建已經(jīng)通過(guò)審核,并且已經(jīng)由關(guān)鍵利益相關(guān)者滿足某些標(biāo)準(zhǔn),就可能存在對(duì)算法的固有信任。鑒于壓倒性的生產(chǎn)算法以及由此產(chǎn)生的意外和有害結(jié)果的壓倒性證據(jù),這一概念很快就受到了質(zhì)疑。由于企業(yè)保密措施不當(dāng),缺乏足夠的教育和理解,很難批判性地對(duì)投入、結(jié)果以及為什么會(huì)出現(xiàn)這些結(jié)果進(jìn)行檢查,企業(yè)的許多簡(jiǎn)單系統(tǒng)都像超出了任何有意義審查范圍的黑盒一樣運(yùn)行。

如今的人工智能行業(yè)正處于企業(yè)準(zhǔn)備就緒的早期階段。人工智能非常有用,可以用于發(fā)現(xiàn)并幫助解析大量數(shù)據(jù),但是仍然需要人工干預(yù)作為評(píng)估和處理數(shù)據(jù)及其結(jié)果的指南。

Karen解釋說(shuō),如今的機(jī)器學(xué)習(xí)技術(shù)可以標(biāo)記數(shù)據(jù)以識(shí)別洞察力。但是,作為此過(guò)程的一部分,如果某些數(shù)據(jù)被錯(cuò)誤地標(biāo)記,或者如果沒(méi)有足夠的數(shù)據(jù)表示,或者存在有問(wèn)題的數(shù)據(jù)表示有偏差,則可能會(huì)發(fā)生錯(cuò)誤的決策結(jié)果。

他還指出目前的流程需要不斷完善:目前,人工智能完全是一種關(guān)于決策支持以提供對(duì)業(yè)務(wù)可以得出結(jié)論的見(jiàn)解。在人工智能發(fā)展的下一階段,它可以實(shí)現(xiàn)數(shù)據(jù)中的自動(dòng)化操作,還有其他需要解決的問(wèn)題,如偏見(jiàn)、可解釋性、隱私、多樣性、道德規(guī)范和持續(xù)模型學(xué)習(xí)。

Karen以一個(gè)人工智能模型為例進(jìn)行了說(shuō)明,當(dāng)圖像標(biāo)題暴露了通過(guò)訓(xùn)練學(xué)到的知識(shí)時(shí),可以看到錯(cuò)誤,這些圖像用他們所包含的對(duì)象標(biāo)記。這表明,人工智能產(chǎn)品需要具有常識(shí)世界模型的對(duì)象和人才才能真正理解。僅暴露于有限數(shù)量的標(biāo)記對(duì)象且訓(xùn)練集中的有限多樣性將限制這個(gè)常識(shí)世界模型的有效性。企業(yè)需要研究確定模型如何處理其輸入,并以人類可理解的術(shù)語(yǔ)得出結(jié)論。亞馬遜公司發(fā)布了面部識(shí)別技術(shù)Rekognition,這是目前正在生產(chǎn)并獲得許可使用的技術(shù)的一個(gè)例子,同時(shí)其效果存在明顯差距。

算法正義聯(lián)盟的創(chuàng)始人Joy Buolamwini呼吁暫停這項(xiàng)技術(shù),聲稱它無(wú)效,并且需要更多的監(jiān)督,呼吁在公開(kāi)發(fā)布這些系統(tǒng)之前將更多的政府標(biāo)準(zhǔn)納入這些類型的系統(tǒng)。

人工智能的主要障礙:心態(tài)、文化和遺產(chǎn)

傳統(tǒng)系統(tǒng)轉(zhuǎn)型是當(dāng)今許多組織實(shí)施人工智能的最大障礙。心態(tài)和文化是這些傳統(tǒng)系統(tǒng)的組成部分,它們提供了對(duì)已建立的流程、價(jià)值觀和業(yè)務(wù)規(guī)則的系統(tǒng)觀點(diǎn),這些規(guī)則不僅包括組織的運(yùn)作方式,還包括為什么這些根深蒂固的元素會(huì)給業(yè)務(wù)帶來(lái)重大障礙的原因,尤其是在目前很好的情況下。因此,很多企業(yè)目前沒(méi)有動(dòng)力去放棄基礎(chǔ)設(shè)施。

人工智能是業(yè)務(wù)轉(zhuǎn)型的一個(gè)組成部分,雖然這個(gè)主題與人工智能炒作一樣得到了一些人的質(zhì)疑,但實(shí)現(xiàn)重大變革所需的投資和承諾卻猶豫不決。有一些愿意嘗試特定用例的公司,但卻沒(méi)有準(zhǔn)備好培訓(xùn)、重新設(shè)計(jì)流程和改進(jìn)治理和企業(yè)政策的要求。對(duì)于被迫進(jìn)行這些重大投資的大型組織而言,問(wèn)題不應(yīng)該是投資回報(bào),而是可持續(xù)的競(jìng)爭(zhēng)優(yōu)勢(shì)。

數(shù)據(jù)完整性的問(wèn)題

人工智能如今需要大量數(shù)據(jù)才能產(chǎn)生有意義的結(jié)果,但卻無(wú)法利用其他應(yīng)用程序的體驗(yàn)。雖然Karen認(rèn)為行業(yè)廠商正在進(jìn)行的工作是為了克服這些限制,但在以可擴(kuò)展的方式應(yīng)用模型之前,需要轉(zhuǎn)移學(xué)習(xí)。然而,有些場(chǎng)景可以有效地使用人工智能,例如透露圖像、語(yǔ)音、視頻和翻譯語(yǔ)言的見(jiàn)解。

企業(yè)正在學(xué)習(xí)的重點(diǎn)應(yīng)放在:

(1)數(shù)據(jù)的多樣性,包括跨群體的適當(dāng)表現(xiàn)。

(2)確保創(chuàng)建算法的多樣化體驗(yàn)、觀點(diǎn)和思考。

(3)優(yōu)先考慮數(shù)據(jù)的質(zhì)量而不是數(shù)量

Karen c承認(rèn)這些都是重要的,特別是隨著偏見(jiàn)的引入以及對(duì)數(shù)據(jù)的信任的降低。例如,土耳其語(yǔ)是一種性別中立的語(yǔ)言,但谷歌翻譯中的人工智能模型在轉(zhuǎn)譯成英語(yǔ)時(shí)錯(cuò)誤地預(yù)測(cè)了性別。同樣在癌癥診療中,人們發(fā)現(xiàn)人工智能圖像識(shí)別只在皮膚白皙的人身上進(jìn)行訓(xùn)練。從其計(jì)算機(jī)視覺(jué)示例中,Joy Buolamwini測(cè)試了這些人工智能技術(shù),并意識(shí)到它們?cè)谀行耘c女性之間以及在膚色較淺與較深的皮膚有效工作的差別。“男性的錯(cuò)誤率低至1%,黑人女性的錯(cuò)誤率高達(dá)35%。”由于未能使用不同的訓(xùn)練數(shù)據(jù),因此出現(xiàn)了這些問(wèn)題。

人工智能的概念很簡(jiǎn)單,但是通過(guò)攝取越來(lái)越多的真實(shí)世界數(shù)據(jù),算法變得更加智能,然而能夠解釋決策變得極其困難。數(shù)據(jù)可能是不斷變化的,人工智能模型需要過(guò)濾器來(lái)防止錯(cuò)誤的標(biāo)記,例如一個(gè)黑人被標(biāo)記為大猩猩或者將熊貓標(biāo)記為長(zhǎng)臂猿的圖像。依靠錯(cuò)誤數(shù)據(jù)做出決策的企業(yè)會(huì)導(dǎo)致不明智的結(jié)果。

幸運(yùn)的是,鑒于人工智能的初衷,很少有組織正在根據(jù)當(dāng)今的數(shù)據(jù)做出重大的業(yè)務(wù)決策。從人們看到的情況來(lái)看,大多數(shù)解決方案主要是產(chǎn)品推薦和個(gè)性化營(yíng)銷傳播。由此產(chǎn)生的任何錯(cuò)誤結(jié)論都會(huì)產(chǎn)生較少的社會(huì)影響,至少目前如此。

使用數(shù)據(jù)做出業(yè)務(wù)決策并不新鮮,但改變的是使用的結(jié)構(gòu)化和非結(jié)構(gòu)化數(shù)據(jù)的數(shù)量和組合的指數(shù)級(jí)增長(zhǎng)。人工智能使人們能夠持續(xù)使用來(lái)自其來(lái)源的數(shù)據(jù),并更快地獲得洞察力。對(duì)于具有處理來(lái)自不同來(lái)源的數(shù)據(jù)量的能力和結(jié)構(gòu)的企業(yè)來(lái)說(shuō),這是一個(gè)機(jī)會(huì)。但是,對(duì)于其他組織而言,大量數(shù)據(jù)可能代表風(fēng)險(xiǎn),因?yàn)椴煌膩?lái)源和格式使得信息轉(zhuǎn)換變得更加困難:電子郵件、系統(tǒng)日志、網(wǎng)頁(yè)、客戶成績(jī)單、文檔、幻燈片、非正式聊天、社交網(wǎng)絡(luò),以及爆炸性的富媒體(如圖像和視頻)。數(shù)據(jù)轉(zhuǎn)換仍然是開(kāi)發(fā)清潔數(shù)據(jù)集的絆腳石,因此也是有效的模型。

偏見(jiàn)比人們意識(shí)到的更為普遍

許多商業(yè)模式中存在偏差,需要最大程度地降低風(fēng)險(xiǎn)評(píng)估,優(yōu)化目標(biāo)機(jī)會(huì),雖然它們可能產(chǎn)生有利可圖的業(yè)務(wù)成果,但它們也可能會(huì)導(dǎo)致意外后果,從而加大經(jīng)濟(jì)差異。保險(xiǎn)公司可以使用位置信息或信用評(píng)分?jǐn)?shù)據(jù)向客戶收取不同的保險(xiǎn)費(fèi)用。銀行可能會(huì)拒絕信用評(píng)分較低的潛在客戶,他們已經(jīng)債務(wù)纏身,但可能無(wú)力承擔(dān)較高的貸款利率。

由于采用人工智能不僅會(huì)使現(xiàn)有的偏見(jiàn)持續(xù)下去,而且會(huì)導(dǎo)致經(jīng)濟(jì)和社會(huì)鴻溝的加深,因此對(duì)偏見(jiàn)的警惕性越來(lái)越高。偏見(jiàn)在當(dāng)前算法中呈現(xiàn),以確定再犯的可能性。由一家名為Northpointe的機(jī)構(gòu)創(chuàng)建的修正罪犯的管理分析替代性制裁(COMPAS)。COMPAS的目標(biāo)是評(píng)估庭審聽(tīng)證會(huì)中被告的犯罪風(fēng)險(xiǎn)和預(yù)測(cè)。在最初的COMPAS研究中使用的問(wèn)題類型揭示了人類偏見(jiàn),即該制度延續(xù)了對(duì)待黑人的建議,他們可能會(huì)繼續(xù)犯罪,因此對(duì)他們采用的法律比白人被告更加嚴(yán)厲,而白人繼續(xù)重新犯罪在量刑時(shí)將被寬大處理。由于沒(méi)有公共標(biāo)準(zhǔn),Northpointe公司創(chuàng)建自己的公平定義,并開(kāi)發(fā)一種沒(méi)有第三方評(píng)估的算法。

如果這個(gè)軟件僅僅像未受過(guò)訓(xùn)練的人在線調(diào)查那樣精確,那么人們認(rèn)為法院在作出判決時(shí)應(yīng)該考慮是否公平。雖然人們嘗試修復(fù)現(xiàn)有系統(tǒng)以最大限度地減少這種偏差,但模型對(duì)不同數(shù)據(jù)集進(jìn)行訓(xùn)練以防止未來(lái)的危害至關(guān)重要。

鑒于潛在的商業(yè)和社會(huì)模型存在潛在風(fēng)險(xiǎn),企業(yè)沒(méi)有治理機(jī)制來(lái)監(jiān)督不公平或不道德的決策,這些決定將無(wú)意中影響最終消費(fèi)者。這是在道德規(guī)范下進(jìn)行討論的。

日益增長(zhǎng)的隱私需求

Karen與強(qiáng)大的研究和數(shù)據(jù)團(tuán)隊(duì)合作,這些團(tuán)隊(duì)能夠在整個(gè)平臺(tái)上對(duì)用戶的行為進(jìn)行情境化,不斷研究用戶行為,并了解他們?cè)谝魳?lè)、主頁(yè)、生活方式、新聞等眾多屬性中的傾向。而并沒(méi)有嚴(yán)格的數(shù)據(jù)使用標(biāo)準(zhǔn)或規(guī)定。隱私被降級(jí)為平臺(tái)條款和條件的用戶被動(dòng)協(xié)議。

最近的劍橋分析公司和Facebook公司的數(shù)據(jù)泄露丑聞使個(gè)人數(shù)據(jù)隱私得到了更多人的關(guān)注。Equifax公司等主要信貸機(jī)構(gòu)頻繁發(fā)生數(shù)據(jù)泄露事件。因此,數(shù)據(jù)所有權(quán)、同意和錯(cuò)誤的情境化問(wèn)題使得其成為一個(gè)重要的主題,因?yàn)槿斯ぶ悄軐⒗^續(xù)解決其問(wèn)題。歐洲通用數(shù)據(jù)保護(hù)條例(GDPR)于2018年5月25日生效,將改變組織的游戲規(guī)則,特別是那些收集、存儲(chǔ)和分析個(gè)人用戶信息的組織。它將改變多年來(lái)經(jīng)營(yíng)業(yè)務(wù)的規(guī)則。個(gè)人信息的無(wú)節(jié)制使用已經(jīng)達(dá)到了頂峰,因?yàn)槠髽I(yè)現(xiàn)在將認(rèn)識(shí)到在數(shù)據(jù)使用上存在重大限制。更重要的是,所有權(quán)將受到嚴(yán)重限制。

人們看到這對(duì)廣告推廣的影響。規(guī)模高達(dá)750億美元的廣告行業(yè)預(yù)計(jì)將在2018~2021年以21%的復(fù)合年增長(zhǎng)率增長(zhǎng),但仍然面臨Facebook公司和谷歌公司等行業(yè)寡頭壟斷的阻礙。如今實(shí)施的GDPR法規(guī)讓這些廣告科技公司面臨更重大的風(fēng)險(xiǎn)與責(zé)任:其利害關(guān)系足夠大,以至于廣告商必須非常高度自信,因?yàn)閷?duì)用戶所告知的實(shí)際上是合規(guī)的。對(duì)于最終構(gòu)成違規(guī)的行為似乎有足夠的普遍混淆,人們正在采取廣泛的方法,直到可以準(zhǔn)確了解合規(guī)性是什么。

雖然法規(guī)的監(jiān)管最終會(huì)削弱收入,但至少在目前,移動(dòng)和廣告平臺(tái)行業(yè)也面臨著越來(lái)越嚴(yán)格的審查,因?yàn)樗麄兌嗄陙?lái)一直將消費(fèi)者作為實(shí)現(xiàn)貨幣化的主題。這與對(duì)既定實(shí)踐的審查相結(jié)合,將迫使行業(yè)轉(zhuǎn)變其在收集、匯總、分析和共享用戶信息方面的做法。

實(shí)現(xiàn)隱私需要時(shí)間、重大投資(需要更多關(guān)注的話題),以及影響組織政策、流程和文化的思維方式的變化。

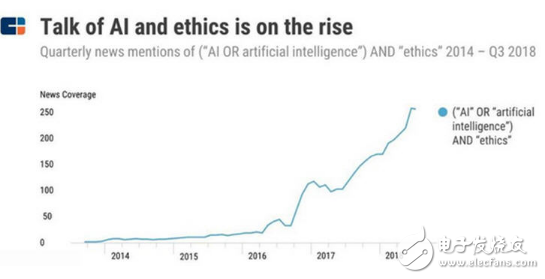

人工智能與倫理學(xué)的必然耦合

人工智能的主要因素確保了社會(huì)效益,包括簡(jiǎn)化流程、增加便利性、改進(jìn)產(chǎn)品和服務(wù),以及通過(guò)自動(dòng)化檢測(cè)潛在危害。放棄后者意味著可以根據(jù)更新的制造流程、服務(wù)和評(píng)估解決方案、生產(chǎn)以及產(chǎn)品質(zhì)量來(lái)輕松地測(cè)量輸入/輸出。

Tech Cos面對(duì)AICB Insights的道德規(guī)范

除了個(gè)人隱私問(wèn)題之外,如今人們看到了一些創(chuàng)新的例子,這些創(chuàng)新與不合情理的邊界相悖。如前所述,谷歌公司決定向美國(guó)國(guó)防部提供人工智能技術(shù)以分析無(wú)人機(jī)拍攝的內(nèi)容,其目的是在一個(gè)名為“Maven計(jì)劃”的項(xiàng)目中創(chuàng)建一個(gè)復(fù)雜的系統(tǒng)來(lái)監(jiān)視城市各個(gè)角落。一些員工離職以抗議谷歌公司的決定。

決策者和監(jiān)管機(jī)構(gòu)需要灌輸新的流程和政策,以正確評(píng)估人工智能技術(shù)的使用方式、用于什么目的,以及流程中是否存在意外后果。 Karen指出了在確定人工智能算法中數(shù)據(jù)使用時(shí)需要考慮的新問(wèn)題:

那么人們?nèi)绾螜z測(cè)敏感數(shù)據(jù)字段并對(duì)其進(jìn)行匿名處理,并同時(shí)保留數(shù)據(jù)集的重要功能?人們能否在短期內(nèi)培訓(xùn)合成數(shù)據(jù)作為替代方案?在創(chuàng)建算法時(shí),人們需要問(wèn)自己:需要哪些數(shù)據(jù)來(lái)提供想要的結(jié)果?此外,人們應(yīng)該創(chuàng)建哪些參數(shù)來(lái)定義模型中的“公平性”,這意味著處理方式有何不同?如果是這樣,為什么?人們?nèi)绾卧谙到y(tǒng)中持續(xù)監(jiān)控這一點(diǎn)?

人工智能的冬季可能是為人工智能做好準(zhǔn)備的機(jī)會(huì)

人工智能技術(shù)已經(jīng)走過(guò)了漫長(zhǎng)的道路,但仍需要更多時(shí)間才能發(fā)展成熟。在日益增加的自動(dòng)化和有意識(shí)地提高認(rèn)知計(jì)算能力的世界中,即將到來(lái)的人工智能的冬天為企業(yè)提供了必要的時(shí)間來(lái)確定人工智能如何適應(yīng)他們的組織以及想要解決的問(wèn)題。人工智能即將出現(xiàn)的損失需要在政策、治理及其對(duì)個(gè)人和社會(huì)的影響中加以解決。

人工智能技術(shù)在下一次工業(yè)革命中的影響要大得多,因?yàn)槠淦毡樾詫⒃谌藗兊纳钪凶兊酶游⒚睢P袠I(yè)專家Geoff Hinton、Fei Fei Lee和Andrew Ng對(duì)人工智能的觀點(diǎn)呼吁人工智能重置,因?yàn)樯疃葘W(xué)習(xí)尚未證明可擴(kuò)展。人工智能技術(shù)所做出的承諾并沒(méi)有減弱,而是對(duì)其實(shí)際到來(lái)的期望被推遲了,可能是5到10年。人們有時(shí)間在深度學(xué)習(xí)、其他人工智能方法以及有效地從數(shù)據(jù)中提取價(jià)值的過(guò)程中解決這些問(wèn)題。商業(yè)準(zhǔn)備、監(jiān)管、教育和研究的高潮是實(shí)現(xiàn)業(yè)務(wù)和消費(fèi)者加速發(fā)展的必要條件,并確保建立適當(dāng)限制技術(shù)的監(jiān)管體系。

電子發(fā)燒友App

電子發(fā)燒友App

評(píng)論