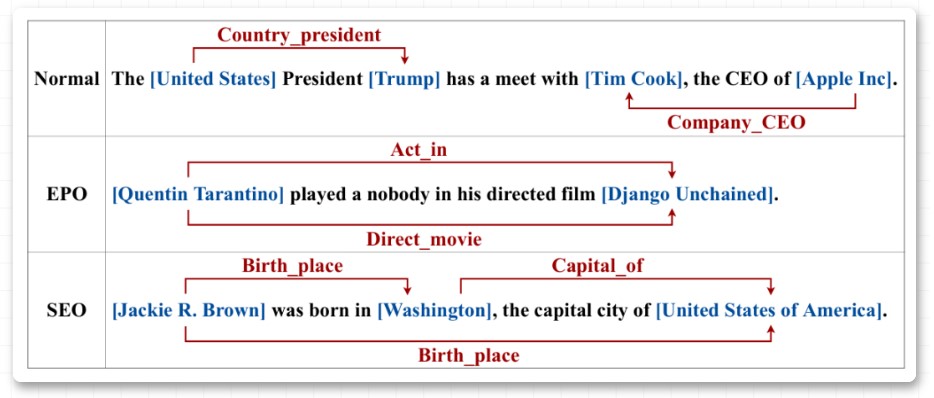

如何用一種級(jí)聯(lián)的并解決嵌套的實(shí)體的三元組抽取模型?

關(guān)系抽取是自然語(yǔ)言處理中一個(gè)比較基礎(chǔ)的任務(wù),除了關(guān)系抽取之外還有類(lèi)似的任務(wù)如:屬性抽取等。

揭秘Prompt的前世今生

作者|閔映乾機(jī)構(gòu)|中國(guó)人民大學(xué)信息學(xué)院碩士方向 | 自然語(yǔ)言處理 來(lái)自 | RUC AI Box 導(dǎo)....

Transformer的復(fù)雜度和高效設(shè)計(jì)及Transformer的應(yīng)用

來(lái)自:AI部落聯(lián)盟 前言 這次我們總結(jié)一下ACL2021中的Transformers,看看2021年....

簡(jiǎn)述文本與圖像領(lǐng)域的多模態(tài)學(xué)習(xí)有關(guān)問(wèn)題

來(lái)自:哈工大SCIR 本期導(dǎo)讀:近年來(lái)研究人員在計(jì)算機(jī)視覺(jué)和自然語(yǔ)言處理方向均取得了很大進(jìn)展,因此融....

應(yīng)用于任意預(yù)訓(xùn)練模型的prompt learning模型—LM-BFF

最近又出了個(gè)比較吸引人眼球的Prompt Learning,甚至該方法還被稱之為NLP的“第四范式”....

基于有效樣本的類(lèi)別不平衡損失

導(dǎo)讀 使用每個(gè)類(lèi)的有效樣本數(shù)量來(lái)重新為每個(gè)類(lèi)的Loss分配權(quán)重,效果優(yōu)于RetinaNet中的Foc....

文本分類(lèi)任務(wù)的Bert微調(diào)trick大全

1 前言 大家現(xiàn)在打比賽對(duì)預(yù)訓(xùn)練模型非常喜愛(ài),基本上作為NLP比賽基線首選(圖像分類(lèi)也有預(yù)訓(xùn)練模型)....

textCNN論文與原理——短文本分類(lèi)

前言 之前書(shū)寫(xiě)了使用pytorch進(jìn)行短文本分類(lèi),其中的數(shù)據(jù)處理方式比較簡(jiǎn)單粗暴。自然語(yǔ)言處理領(lǐng)域包....

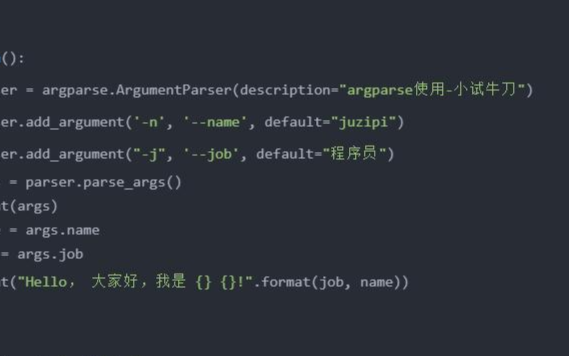

如何讓Python程序參數(shù)輸入更像Linux命令

? 背景 最近一直訓(xùn)練模型,進(jìn)行模型調(diào)參比較,但是隨著模型參數(shù)多起來(lái)了,想獲得不同參數(shù)模型結(jié)果也越來(lái)....

這些機(jī)器學(xué)習(xí)分類(lèi)器性能標(biāo)準(zhǔn)你知道嗎?

在機(jī)器學(xué)習(xí)算法中,在模型訓(xùn)練出來(lái)之后,總會(huì)去尋找衡量模型性能的指標(biāo)。評(píng)價(jià)指標(biāo)是針對(duì)將相同的數(shù)據(jù),使用....

卷積神經(jīng)網(wǎng)絡(luò)CNN的簡(jiǎn)單理論介紹

好久不見(jiàn)各位親們,從上半年畢業(yè)到現(xiàn)在各方面開(kāi)始步入正常軌跡,也開(kāi)始有時(shí)間寫(xiě)點(diǎn)文章了,后續(xù)開(kāi)始陸續(xù)更新....